Clear Sky Science · de

Eine umfassende Bewertung leichter Deep-Learning-Modelle zur Klassifizierung von Tomatenkrankheiten in Edge-Computing-Umgebungen

Schlauer Blick für Tomatenpflanzen

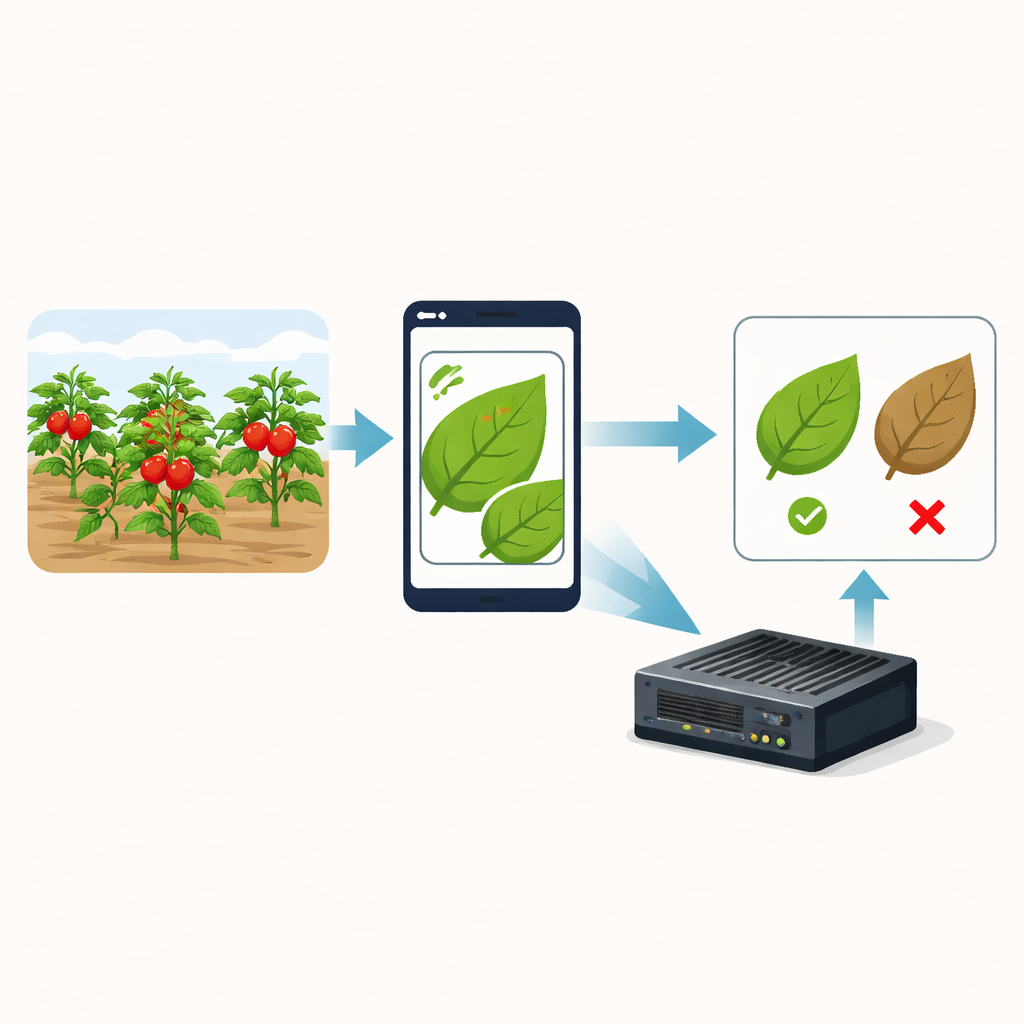

Tomatenanbau weltweit verliert einen großen Teil seines potenziellen Ertrags durch Blattkrankheiten. Heute können Landwirte Fotos von Blättern mit dem Handy oder einer Feldkamera aufnehmen und künstliche Intelligenz (KI) frühzeitig auf Probleme hinweisen lassen. Doch es gibt einen Haken: Viele der genauesten KI-Modelle sind zu ressourcenintensiv, um auf kostengünstigen Geräten in Feldern und Gewächshäusern zu laufen. Diese Studie stellt eine praktische Frage: Welche kompakten KI-Modelle können Tomatenkrankheiten sowohl genau erkennen als auch schnell auf kleinen, preisgünstigen Geräten in unmittelbarer Nähe der Pflanzen laufen?

Warum Blattfotos von Tomaten wichtig sind

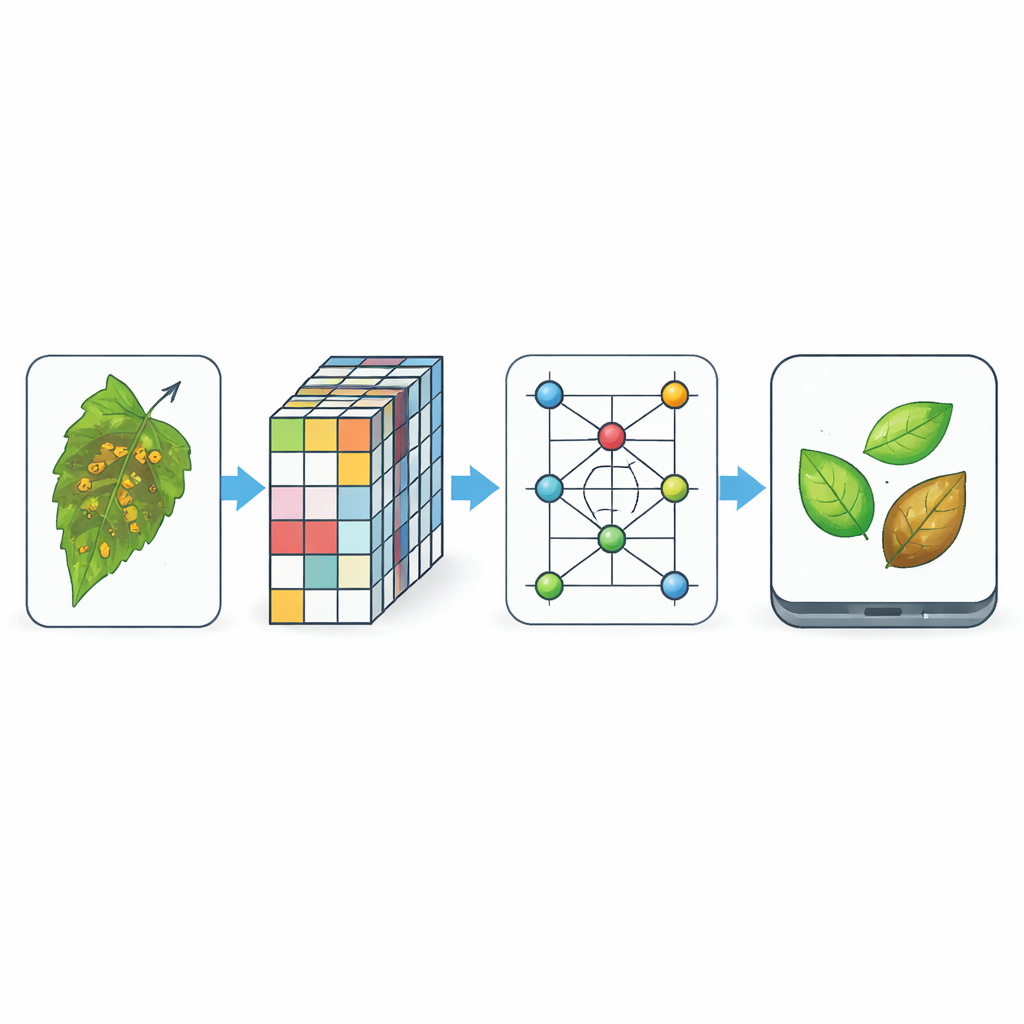

Tomatenkrankheiten zeigen sich oft zuerst als Flecken, Schimmel oder Verfärbungen an den Blättern, und ein frühzeitiges Erkennen kann schwere Ertragsverluste verhindern. Die Autorinnen und Autoren bauen auf einer bekannten öffentlichen Bildsammlung namens PlantVillage auf und konzentrieren sich auf über 18.000 Fotos von Tomatenblättern, die neun Krankheiten sowie gesunde Pflanzen abdecken. Alle Bilder werden standardisiert und während des Trainings leicht verändert, um realistische Variationen wie Beleuchtung, Zoom und kleine Positionsverschiebungen nachzuahmen. So können die Forschenden testen, wie gut verschiedene KI-Modelle visuelle Muster erlernen, die etwa Frühen Befall von Späterem Befall unterscheiden oder ein gesundes Blatt von einem durch ein Virus infizierten Blatt trennen.

Vergleich vieler kleiner, gehirnähnlicher Modelle

Statt allein ein weiteres neues Modell zu entwerfen, richten die Forschenden einen fairen Wettbewerb unter sieben kompakten Deep-Learning-Architekturen ein. Einige sind klassische Bilderkennungsnetzwerke, die in vielen Aufgaben erfolgreich waren, wie VGG16, ResNet50 und DenseNet121. Andere sind neuere Entwürfe, die speziell für den Einsatz auf Smartphones und eingebetteten Geräten optimiert wurden, wie MobileNetV3-Small, ShuffleNetV2 und SqueezeNet. Der letzte Anwärter, MobilePlantViT, ist ein Hybrid, der zwei Ideen kombiniert: traditionelle Faltungsarchitekturen, die feine Details in kleinen Bildbereichen erfassen, und transformerartige Aufmerksamkeit, die weit auseinanderliegende Teile eines Blattes verknüpft, um das Gesamtmuster der Krankheit zu verstehen.

Einblick in die Entscheidungen der KI

Damit Landwirtinnen, Landwirte und Agronomen diesen Modellen vertrauen, reicht Genauigkeit allein nicht aus — sie müssen auch nachvollziehbar sein. Die Autorinnen und Autoren verwenden daher drei verbreitete Methoden der „erklärbaren KI“, die über jedes Blattbild Heatmaps erzeugen und zeigen, welche Bereiche die Entscheidung am stärksten beeinflusst haben. Diese Methoden sind Grad-CAM, LIME und SHAP. Um über das bloße Betrachten dieser farbigen Karten hinauszukommen, führen die Forschenden einen neuen Wert ein, den Perturbation Stability Score. Indem sie einem Bild viele Male ein wenig Rauschen hinzufügen und vergleichen, wie sehr sich die Erklärungs-Maps verändern, können sie messen, wie stabil und verlässlich jede Erklärungsmethode ist. Über die Modelle hinweg liefert SHAP tendenziell die stabilsten Erklärungen, während Grad-CAM klare, hochauflösende Hervorhebungen von erkrankten Bereichen bietet, die gut mit menschlichen Erwartungen übereinstimmen.

Geschwindigkeit und Energieverbrauch auf realer Hardware

Da Feldgeräte oft auf kostengünstige Prozessoren ohne Grafikbeschleuniger angewiesen sind, messen die Forschenden, wie schnell jedes Modell auf Standard-Desktop-CPUs und auf einem Raspberry Pi 5 läuft — einem kleinen, erschwinglichen Computer, der mit Hardware in intelligenten Kameras vergleichbar ist. Sie erfassen Modellgröße, die Anzahl grundlegender Rechenoperationen pro Bild und die Zeit zur Verarbeitung eines einzelnen Fotos unter verschiedenen Thread-Einstellungen. Standardnetzwerke wie VGG16 liefern exzellente Genauigkeit, sind jedoch sehr groß und langsam, während winzige Modelle wie SqueezeNet schnell laufen, aber an Präzision verlieren, besonders bei schwierigeren, verrauschten Bildern und Feldbedingungen. MobilePlantViT sticht hervor: Es erreicht über 99 % Genauigkeit bei sauberen Bildern und bleibt bei realistischeren Tests wettbewerbsfähig, benötigt jedoch nur einen Bruchteil des Speichers und der Rechenleistung und erreicht nahezu Echtzeit-Performance selbst auf eingeschränkter Hardware.

Was das für zukünftige Smart Farms bedeutet

Insgesamt zeigt die Studie, dass gut gestaltete, leichte Modelle hochwertige Bilderkennung an die Feldgrenze bringen können, wo Konnektivität und Energie begrenzt sind. Unter allen getesteten Architekturen bietet MobilePlantViT die beste Kombination aus präziser Diagnose, effizienter Nutzung von Rechenressourcen und klaren visuellen Erklärungen dafür, worauf das Modell „blickt“, wenn es eine Krankheit vorhersagt. Für Erzeugerinnen, Erzeuger und Technologieentwickler weist dies auf eine Zukunft hin, in der kleine, kostengünstige Geräte an Telefonen, Drohnen oder Gewächshaus-Schienen kontinuierlich Tomatenpflanzen scannen, verdächtige Blätter markieren und ihre Warnungen auf eine Weise begründen können, die Agronominnen und Agronomen überprüfen und vertrauen können.

Zitation: Hoang, TM., Bui, VH., Nguyen, VS. et al. A comprehensive evaluation of lightweight deep learning models for tomato disease classification on edge computing environments. Sci Rep 16, 12320 (2026). https://doi.org/10.1038/s41598-026-42439-6

Schlüsselwörter: Erkennung von Tomatenkrankheiten, Edge-AI, leichte Deep-Learning-Modelle, Vision Transformer, erklärbare KI