Clear Sky Science · pt

Avaliação abrangente de modelos leves de deep learning para classificação de doenças do tomate em ambientes de computação de borda

Olhos mais inteligentes para as plantas de tomate

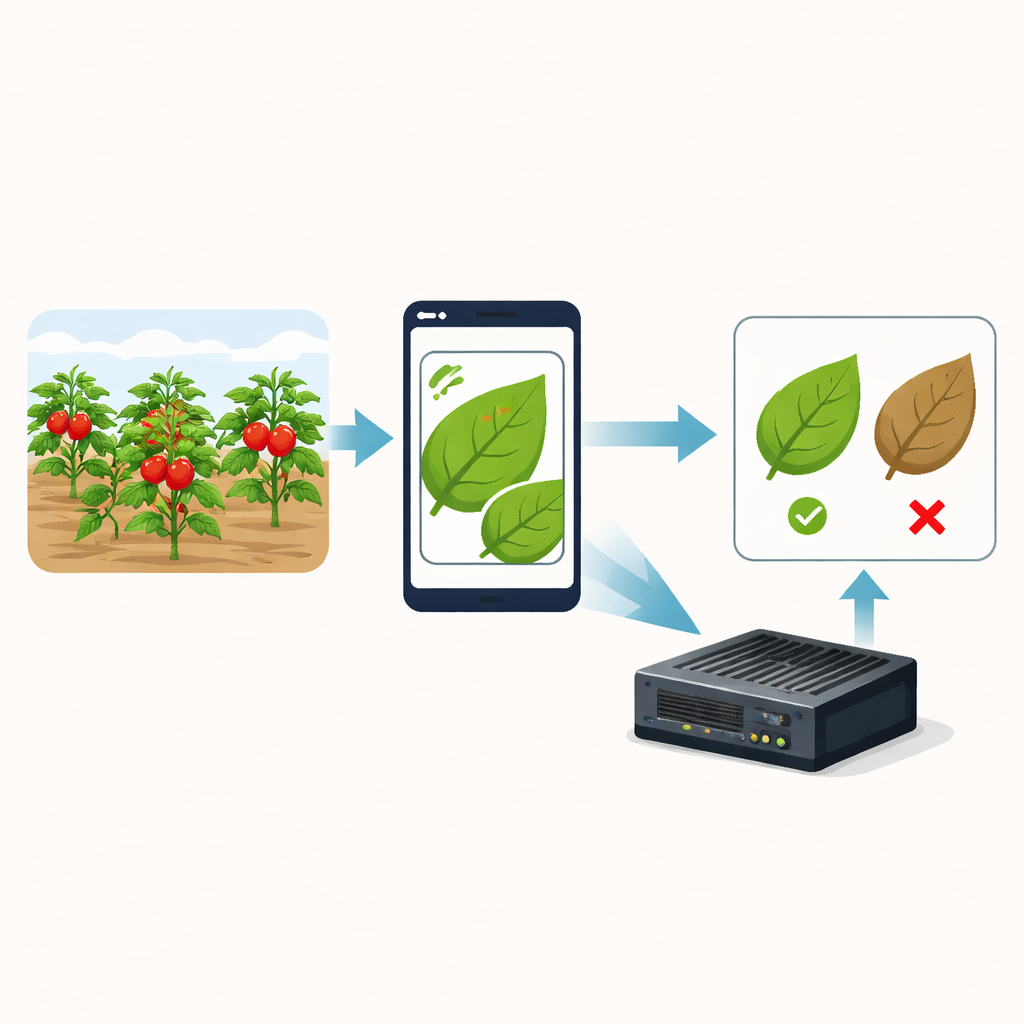

As plantações de tomate ao redor do mundo perdem grande parte de sua colheita potencial por doenças das folhas. Hoje, os agricultores podem tirar fotos das folhas com um celular ou câmera de campo, permitindo que a inteligência artificial (IA) identifique problemas precocemente. Mas há um porém: muitos dos modelos de IA mais precisos são pesados demais para rodar em dispositivos de baixo custo em campos e estufas. Este estudo faz uma pergunta prática: quais modelos compactos de IA conseguem tanto detectar doenças do tomate com precisão quanto rodar rápido em hardware pequeno e barato próximo às próprias plantas?

Por que fotos das folhas de tomate importam

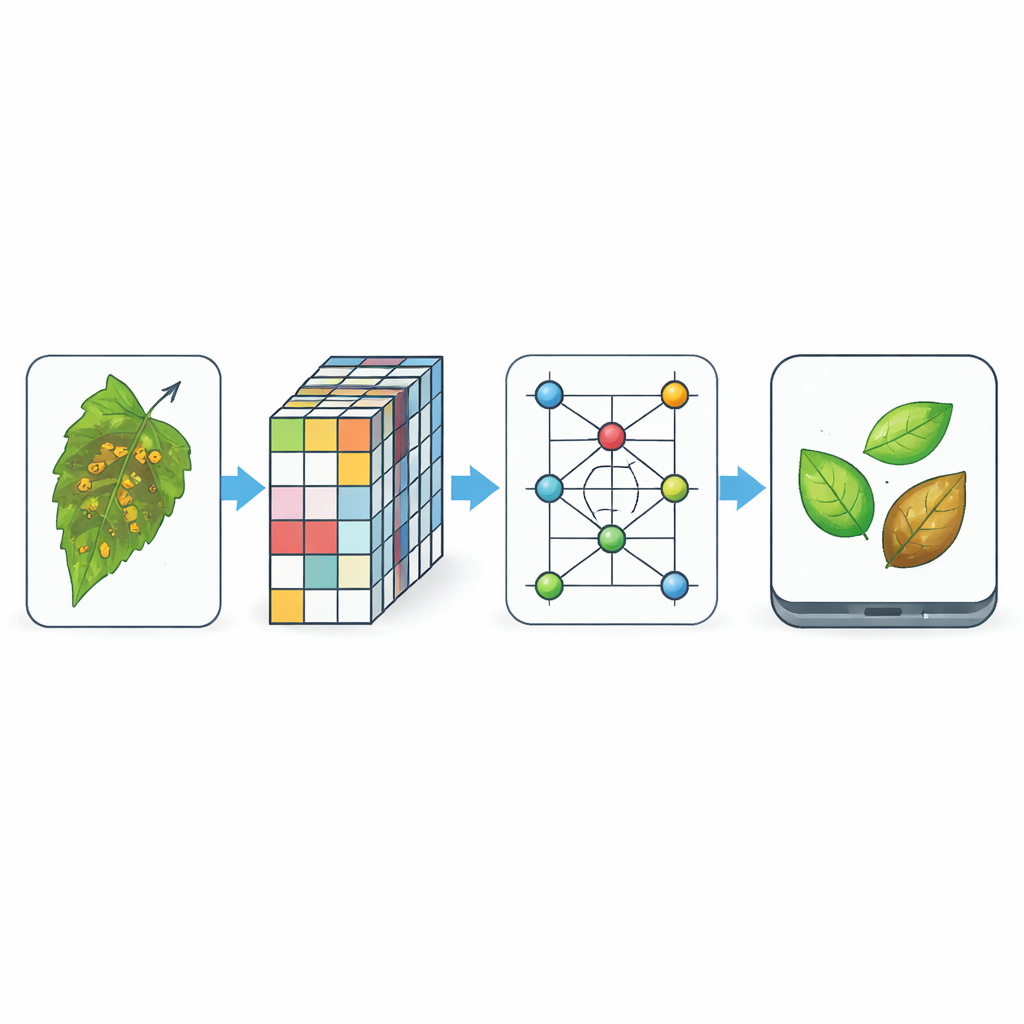

As doenças do tomate costumam aparecer primeiro como manchas, bolores ou descoloração nas folhas, e detectá-las cedo pode prevenir perdas sérias na produtividade. Os autores partem de um conjunto público de imagens bastante utilizado, chamado PlantVillage, focando em mais de 18.000 fotos de folhas de tomate cobrindo nove doenças além de plantas saudáveis. Todas as imagens são padronizadas e levemente alteradas durante o treinamento para imitar mudanças do mundo real, como iluminação, zoom e pequenos deslocamentos de posição. Isso permite aos pesquisadores testar o quanto diferentes modelos de IA aprendem a reconhecer padrões visuais que distinguem, por exemplo, early blight de late blight, ou uma folha saudável de uma infectada por um vírus.

Comparando muitos modelos pequenos inspirados no cérebro

Em vez de projetar mais um novo modelo isoladamente, a equipe organiza uma competição justa entre sete arquiteturas compactas de deep learning. Algumas são redes clássicas de reconhecimento de imagem que já tiveram sucesso em várias tarefas, como VGG16, ResNet50 e DenseNet121. Outras são projetos mais recentes criados especificamente para rodar bem em celulares e dispositivos embarcados, como MobileNetV3-Small, ShuffleNetV2 e SqueezeNet. A última concorrente, MobilePlantViT, é um híbrido que combina duas ideias: camadas convolucionais tradicionais que capturam detalhes finos em pequenas regiões de uma imagem, e atenção estilo transformer que conecta partes distantes de uma folha para entender o padrão geral da doença.

Vendo por dentro as decisões da IA

Para que agricultores e agrônomos confiem nesses modelos, não basta que sejam precisos — é preciso que também sejam compreensíveis. Por isso, os autores usam três técnicas populares de “IA explicável” que criam mapas de calor sobre cada imagem da folha, mostrando quais regiões mais influenciaram a decisão. São elas Grad-CAM, LIME e SHAP. Para ir além da simples avaliação visual desses mapas coloridos, a equipe introduz uma nova métrica chamada Perturbation Stability Score. Ao adicionar um pouco de ruído a uma imagem diversas vezes e comparar o quanto os mapas explicativos mudam, eles conseguem medir quão estável e confiável é cada método de explicação. Entre os modelos, o SHAP tende a fornecer as explicações mais estáveis, enquanto o Grad-CAM oferece destaques nítidos e de alta resolução das áreas doentes que se alinham bem com as expectativas humanas.

Velocidade e consumo em dispositivos reais

Como ferramentas agrícolas frequentemente dependem de processadores de baixo custo sem placas gráficas, os pesquisadores medem quão rapidamente cada modelo roda em CPUs de desktop padrão e em um Raspberry Pi 5, um computador pequeno e acessível comparável ao hardware usado em câmeras inteligentes. Eles acompanham o tamanho do modelo, o número de operações matemáticas básicas por imagem e o tempo para processar uma única foto sob diferentes configurações de threads. Redes padrão como VGG16 entregam excelente precisão mas são enormes e lentas, enquanto modelos minúsculos como SqueezeNet rodam rápido mas perdem alguma precisão, especialmente em imagens mais desafiadoras, com ruído e em condições de campo. O MobilePlantViT se destaca: alcança precisão acima de 99% em imagens limpas e permanece competitivo em testes mais realistas, usando uma fração da memória e do processamento, obtendo desempenho quase em tempo real mesmo em hardware limitado.

O que isso significa para fazendas inteligentes futuras

No geral, o estudo mostra que modelos leves projetados com cuidado podem levar reconhecimento de imagem de alto nível à borda do campo, onde conectividade e energia são limitadas. Entre todas as arquiteturas testadas, o MobilePlantViT oferece a melhor combinação de diagnóstico preciso, uso eficiente de recursos computacionais e explicações visuais claras do que o modelo “observa” ao predizer uma doença. Para produtores e desenvolvedores de tecnologia, isso aponta para um futuro em que dispositivos pequenos e baratos montados em celulares, drones ou trilhos de estufa podem escanear continuamente plantas de tomate, destacar folhas suspeitas e justificar seus avisos de maneiras que agrônomos possam verificar e confiar.

Citação: Hoang, TM., Bui, VH., Nguyen, VS. et al. A comprehensive evaluation of lightweight deep learning models for tomato disease classification on edge computing environments. Sci Rep 16, 12320 (2026). https://doi.org/10.1038/s41598-026-42439-6

Palavras-chave: detecção de doenças do tomate, edge AI, deep learning leve, vision transformer, IA explicável