Clear Sky Science · sv

SiaCon-DetNet med HySHO: ett banbrytande transformerbaserat djupinlärningsramverk för känslomedveten ansiktsigenkänning

Varför det spelar roll att lära datorer att läsa känslor

Från videosamtal till virtuella lärare och hälsoappar möter vi allt oftare maskiner genom skärmar. Ändå är de flesta av dessa system fortfarande känslomässigt ”döva”: de ser inte om vi är förvirrade, stressade eller glada. Denna artikel presenterar ett nytt artificiell intelligens-ramverk som läser mänskliga ansiktsuttryck mer exakt och effektivt än tidigare metoder, med målet att göra digitala verktyg mer förstående, rättvisa och hjälpsamma i vardagen.

Hur ansikten ger maskiner ett känslomässigt fönster

Våra ansikten sänder kontinuerligt information om hur vi mår, ofta ärligare än våra ord. Leenden, rynkade pannor, vidgade ögon och subtila muskelryck hjälper människor att navigera samtal, bygga förtroende och upptäcka svårigheter. Forskare inom psykologi, neurovetenskap och datavetenskap har länge försökt lära datorer att tolka dessa signaler, ett fält som kallas igenkänning av ansiktsuttryck. Denna teknik syns redan i utbildningsplattformar som följer elevengagemang, spelsystem som anpassar sig efter spelarens humör, medicinska verktyg som övervakar smärta eller depression och säkerhetssystem som letar efter tecken på upprördhet. Men verkliga förhållanden är stökiga: ljusförhållanden förändras, ansikten kan vara delvis täckta och uttryck varierar mellan individer och kulturer, vilket gör pålitlig känsloavläsning till en svår utmaning.

Varför äldre känslosystem brister

Tidiga datasystem byggde på handdesignade regler och mätte enkla egenskaper som rynkor, kanter eller formen på mun och ögon. Dessa hade svårt med förändringar i pose, ljus eller individuella skillnader. Djupinlärning gav framsteg genom att låta neurala nätverk automatiskt lära användbara mönster från ansiktsbilder, men vanliga arkitekturer hade fortfarande blinda fläckar. Konvolutionsnät är skickliga på att upptäcka lokala detaljer, men har problem att koppla ihop avlägsna delar av ansiktet, som hur ögon och mun rör sig tillsammans i komplexa uttryck. Nyare transformermodeller fångar dessa långräckande relationer, men de kan vara tunga, datahungriga och inte idealiska för att plocka upp mycket fina, lågnivådetaljer. Många befintliga system kräver också noggrann manuell justering av hundratals interna parametrar och generaliserar ofta dåligt utanför den data de tränats på.

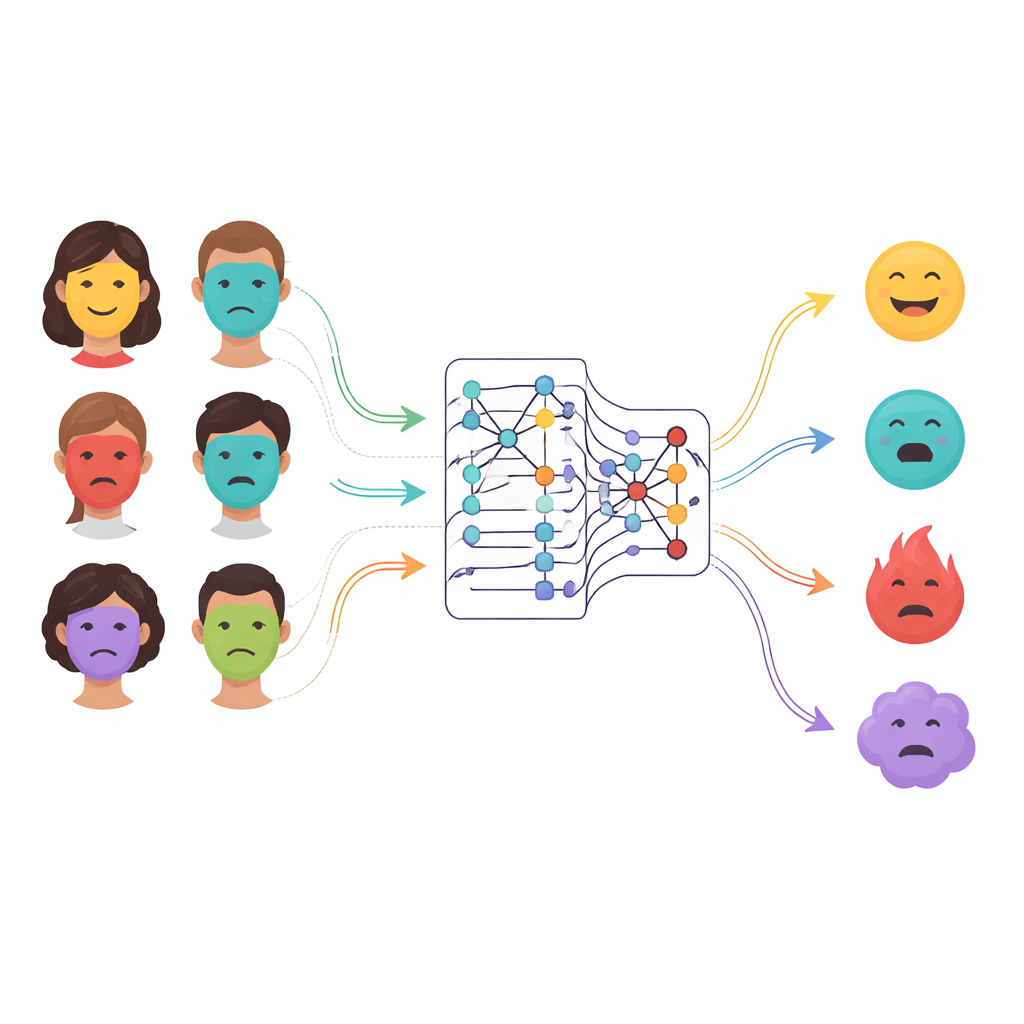

En ny tvillingögd och uppmärksamhetsfokuserad ansats

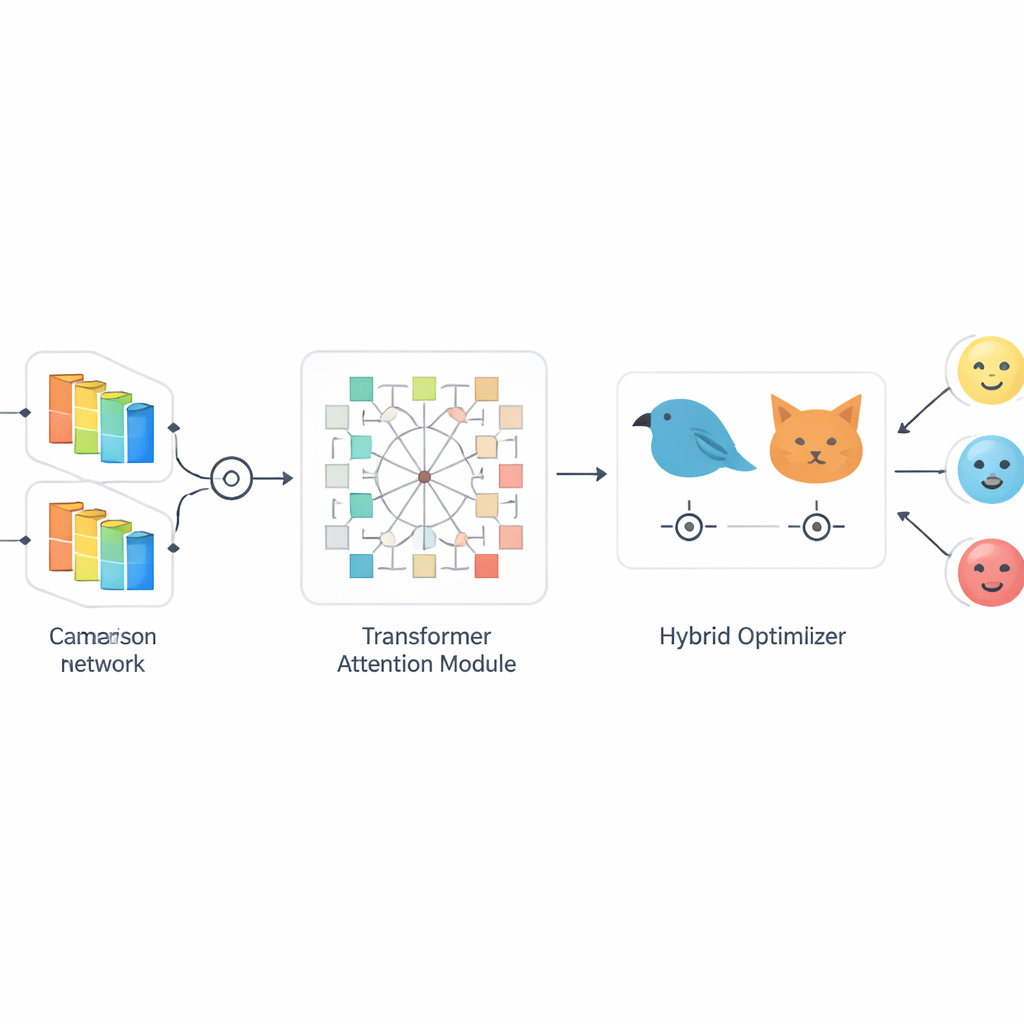

Författarna föreslår SiaCon-DetNet, ett hybridnät som kombinerar styrkorna hos flera idéer. Först använder det en siamesisk struktur—två identiska bearbetningsgrenar som ser matchande ansiktsbilder—för att lära vad som verkligen skiljer en känsla från en annan. Denna tvillingsdesign hjälper modellen att upptäcka små skillnader mellan till exempel rädsla och förvåning, som kan involvera liknande muskler. Inom varje gren fångar konvolutionslager detaljerade texturer och former, som ögonbrynens kurvor eller spänningar i munnen. Ovanpå detta fungerar en transformerbaserad modul som en uppmärksamhetsstrålkastare, som lär sig hur avlägsna regioner av ansiktet relaterar till varandra och fokuserar på de mest informativa områdena. Tillsammans låter dessa komponenter systemet bygga en rik, kontextmedveten bild av varje uttryck, även när ansikten är delvis dolda eller ojämnt belysta.

Naturinspirerad finjustering för skarpare och snabbare inlärning

Att designa en kraftfull modell är bara halva jobbet; den måste också justeras så att den lär sig snabbt utan överanpassning. För att hantera detta introducerar artikeln HySHO, ett ”bio-inspirerat” optimeringsschema som blandar strategier modellerade på en jaktfågel (duvhökssläkting) och en ökenkatt. En del utforskar ett brett spektrum av inställningar, såsom inlärningshastigheter och filterstorlekar, för att förhindra att systemet fastnar i dåliga lösningar. Den andra delen utför finjusteringar i lovande områden, vilket påskyndar konvergensen. Denna dynamiska fininställning är kopplad till hur mycket ansiktsuttryck varierar i en given datamängd, så att modellen kan anpassa sig när den stöter på subtila, blandade eller brusiga känslor. Som resultat blir träningen både snabbare och mer robust, vilket möjliggör realtids- eller nästintill realtidsapplikationer.

Sätta systemet på prov

För att utvärdera sitt ramverk testade forskarna det på tre välanvända känslogrupperingar som skiljer sig i storlek och svårighetsgrad. Dessa dataset inkluderar poserade och mer naturliga uttryck över flera grundläggande känslor som ilska, rädsla, glädje, sorg, äckel, förvåning och neutralitet. Det nya systemet nådde omkring 99 procent noggrannhet på den bäst kända benchmarken och bibehöll lika imponerande precision, recall och F1-poäng över nästan alla känslokategorier. Viktigt är att det gjorde detta samtidigt som det tränade snabbare än många populära djupinlärningsmodeller byggda på välkända bildarkitekturer. Analyser av hur olika känslor korrelerar i varje dataset visade att modellen hanterade svåra par—som ilska kontra äckel eller rädsla kontra sorg—utan stora prestandafall, vilket antyder att den fångar uttryckens fina struktur snarare än att memorera uppenbara fall.

Vad detta betyder för vardagsteknik

Enkelt uttryckt visar studien att en AI kan utformas för att ”betrakta” ansikten på ett mer människoliknande sätt—jämföra subtila skillnader, förstå kontext över hela ansiktet och justera sin egen inlärningsstrategi i realtid. Det föreslagna SiaCon-DetNet med HySHO-ramverket levererar extremt hög noggrannhet samtidigt som det förblir relativt lätt och snabbt att träna, vilket gör det till en stark kandidat för framtida verktyg inom mentalhälso-screening, interaktiv handledning, kundservice och hjälpteknik för personer med kommunikationssvårigheter. Även om viktiga frågor återstår kring integritet, samtycke och rättvisa förflyttar detta arbete känslo-medvetna system närmare att läsa våra känslor tillräckligt tillförlitligt för att svara med känslighet istället för gissningar.

Citering: M, S., M, U., K, T. et al. SiaCon-DetNet with HySHO: a cutting-edge transformer-based deep learning framework for emotion-aware facial recognition. Sci Rep 16, 14131 (2026). https://doi.org/10.1038/s41598-026-41890-9

Nyckelord: igenkänning av ansiktsuttryck, djupinlärning, transformermodeller, människa–dator-interaktion, affektiv databehandling