Clear Sky Science · pt

SiaCon-DetNet com HySHO: uma avançada estrutura de deep learning baseada em transformers para reconhecimento facial sensível às emoções

Por que ensinar computadores a ler sentimentos importa

De chamadas por vídeo a tutores virtuais e aplicativos de saúde, nos encontramos cada vez mais com máquinas por meio de telas. No entanto, a maioria desses sistemas continua emocionalmente “surda”: não percebe se estamos confusos, estressados ou encantados. Este artigo apresenta uma nova estrutura de inteligência artificial que lê expressões faciais humanas com mais precisão e eficiência do que métodos anteriores, com o objetivo de tornar as ferramentas digitais mais compreensivas, justas e úteis no dia a dia.

Como os rostos dão às máquinas uma janela emocional

Nossos rostos transmitem continuamente informações sobre o que sentimos, muitas vezes de forma mais honesta do que as palavras. Sorrisos, sobrancelhas franzidas, olhos arregalados e pequenas contrações musculares ajudam as pessoas a conduzir conversas, construir confiança e detectar aflição. Pesquisadores de psicologia, neurociência e ciência da computação há muito tentam ensinar computadores a ler esses sinais, um campo conhecido como reconhecimento de emoções faciais. Essa tecnologia já aparece em plataformas educacionais que monitoram o engajamento dos alunos, em jogos que se adaptam ao humor do jogador, em ferramentas médicas que rastreiam dor ou depressão e em sistemas de segurança que observam sinais de agitação. Mas as condições do mundo real são complicadas: a iluminação muda, rostos ficam parcialmente cobertos e expressões variam entre indivíduos e culturas, tornando a leitura confiável das emoções um problema difícil.

Por que sistemas antigos de emoção falham

Os primeiros sistemas de computador dependiam de regras desenhadas à mão, medindo características simples como rugas, contornos ou a forma da boca e dos olhos. Esses métodos tinham dificuldade com variações de pose, iluminação ou diferenças individuais. O deep learning trouxe progresso ao permitir que redes neurais aprendessem automaticamente padrões úteis a partir de imagens de rosto, mas arquiteturas comuns ainda apresentavam pontos cegos. Redes convolucionais se destacam em detectar detalhes locais, mas têm dificuldade em conectar partes distantes do rosto, como o movimento conjunto dos olhos e da boca em expressões complexas. Modelos transformer mais recentes capturam essas relações de longo alcance, porém podem ser pesados, exigentes em dados e não ideais para captar detalhes muito finos e de baixo nível. Muitos sistemas existentes também requerem ajuste manual cuidadoso de centenas de parâmetros internos e frequentemente generalizam mal além dos dados em que foram treinados.

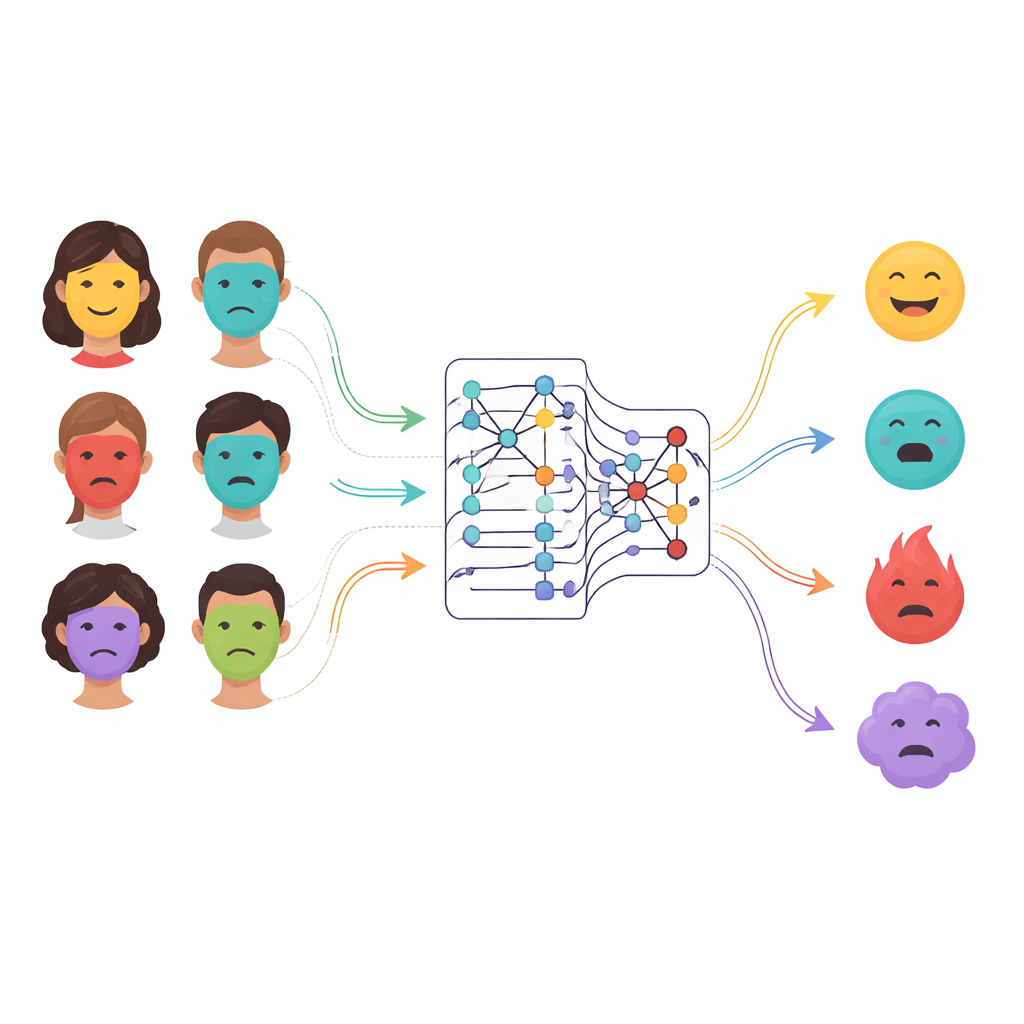

Uma nova abordagem de olhos gêmeos e foco por atenção

Os autores propõem o SiaCon-DetNet, uma rede híbrida que combina as forças de várias ideias. Primeiro, ela usa uma estrutura siamês—duas ramificações de processamento idênticas que veem imagens de rosto correspondentes—para aprender o que realmente distingue uma emoção de outra. Esse design em dupla ajuda o modelo a notar diferenças mínimas entre, por exemplo, medo e surpresa, que podem envolver músculos semelhantes. Dentro de cada ramificação, camadas convolucionais capturam texturas e formas de alta resolução, como curvas de sobrancelha ou tensão na boca. Sobre isso, um módulo baseado em transformer age como um holofote de atenção, aprendendo como regiões distantes do rosto se relacionam e focando nas zonas mais informativas. Juntos, esses componentes permitem que o sistema construa uma imagem rica e sensível ao contexto de cada expressão, mesmo quando rostos estão parcialmente ocultos ou iluminados de forma desigual.

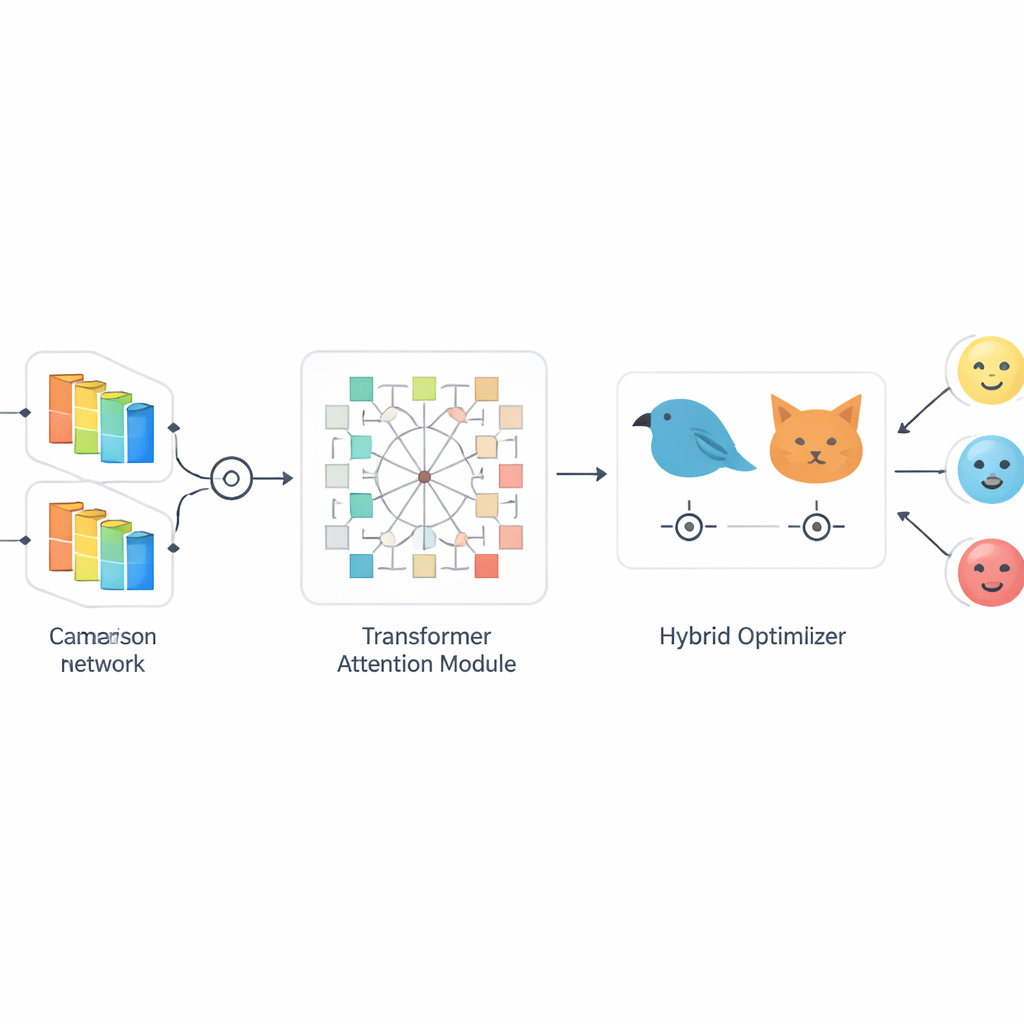

Ajuste inspirado na natureza para aprendizado mais nítido e rápido

Projetar um modelo poderoso é apenas metade da batalha; ele também precisa ser ajustado para aprender rapidamente sem sobreajustar. Para lidar com isso, o artigo introduz HySHO, um esquema de otimização “bioinspirado” que mistura estratégias modeladas em um falconiforme (goshawk) e um felino do deserto. Uma parte explora uma ampla gama de configurações, como taxas de aprendizado e tamanhos de filtro, evitando que o sistema fique preso em soluções ruins. A outra parte realiza ajustes finos em regiões promissoras, acelerando a convergência. Esse ajuste dinâmico está vinculado à variabilidade das expressões faciais em um conjunto de dados, permitindo que o modelo se adapte quando encontra emoções sutis, misturadas ou ruidosas. Como resultado, o treinamento se torna mais rápido e mais robusto, suportando aplicações em tempo real ou quase em tempo real.

Submetendo o sistema ao teste

Para avaliar sua estrutura, os pesquisadores testaram-na em três conjuntos de dados amplamente usados para emoções, que diferem em tamanho e dificuldade. Essas coleções incluem expressões posadas e mais naturais cobrindo várias emoções básicas, como raiva, medo, felicidade, tristeza, nojo, surpresa e neutralidade. O novo sistema alcançou cerca de 99 por cento de precisão no benchmark mais conhecido e manteve medidas igualmente impressionantes de precisão, recall e F1 em praticamente todas as categorias emocionais. Importante, isso ocorreu enquanto treinava mais rápido que muitos modelos populares de deep learning baseados em arquiteturas de imagem consagradas. Análises de como diferentes emoções se correlacionam em cada conjunto de dados mostraram que o modelo lidou com pares difíceis—como raiva versus nojo ou medo versus tristeza—sem grandes quedas de desempenho, sugerindo que captura a estrutura fina das expressões em vez de memorizar casos óbvios.

O que isso significa para a tecnologia do dia a dia

Em termos práticos, o estudo mostra que uma IA pode ser projetada para “olhar” rostos de maneira mais parecida com a humana—comparando diferenças sutis, entendendo o contexto em todo o rosto e ajustando sua própria estratégia de aprendizado em tempo real. A proposta SiaCon-DetNet com HySHO oferece precisão extremamente alta enquanto permanece relativamente leve e rápida de treinar, tornando-a um forte candidato para ferramentas futuras em triagem de saúde mental, tutorias interativas, atendimento ao cliente e tecnologias assistivas para pessoas com dificuldades de comunicação. Embora ainda existam questões importantes sobre privacidade, consentimento e equidade, este trabalho aproxima os sistemas sensíveis às emoções de ler nossos sentimentos de forma confiável o suficiente para responder com sensibilidade em vez de suposições.

Citação: M, S., M, U., K, T. et al. SiaCon-DetNet with HySHO: a cutting-edge transformer-based deep learning framework for emotion-aware facial recognition. Sci Rep 16, 14131 (2026). https://doi.org/10.1038/s41598-026-41890-9

Palavras-chave: reconhecimento de emoções faciais, deep learning, modelos transformer, interação humano–computador, computação afetiva