Clear Sky Science · nl

SiaCon-DetNet met HySHO: een geavanceerd transformer-gebaseerd deep learning-kader voor emotie-bewuste gezichtsherkenning

Waarom het belangrijk is computers gevoelens te leren lezen

Van videogesprekken tot virtuele docenten en gezondheidsapps: we spreken steeds vaker met machines via schermen. Toch zijn de meeste van deze systemen emotioneel nog “doof”: ze zien niet of we verward, gestrest of verrukt zijn. Dit artikel introduceert een nieuw kunstmatig-intelligentie-kader dat menselijke gezichtsuitdrukkingen nauwkeuriger en efficiënter leest dan eerdere methoden, met als doel digitale hulpmiddelen begripvoller, eerlijker en nuttiger te maken in het dagelijks leven.

Hoe gezichten een emotioneel venster voor machines bieden

Onze gezichten zenden voortdurend informatie uit over hoe we ons voelen, vaak eerlijker dan onze woorden. Glimlachen, fronsen, wijde ogen en subtiele spiertrekkingen helpen mensen gesprekken te sturen, vertrouwen op te bouwen en nood te signaleren. Onderzoekers in psychologie, neurowetenschappen en informatica proberen al lang computers deze signalen te leren lezen — een veld dat bekendstaat als gezichts-emotieherkenning. Zulke technologie verschijnt al in onderwijsplatforms die betrokkenheid van studenten volgen, spelsystemen die zich aanpassen aan de stemming van een speler, medische hulpmiddelen die pijn of depressie monitoren, en beveiligingssystemen die tekenen van agitatie in de gaten houden. Maar echte omstandigheden zijn rommelig: licht verandert, gezichten zijn deels bedekt, en uitdrukkingen verschillen tussen individuen en culturen, wat betrouwbare emotieherkenning een lastige opgave maakt.

Waarom oudere emotie-systemen tekortschieten

Vroege computersystemen vertrouwden op handmatig ontworpen regels en maten eenvoudige kenmerken zoals rimpels, randen of de vorm van mond en ogen. Die hadden moeite met veranderingen in houding, verlichting of individuele verschillen. Deep learning bracht vooruitgang door neurale netwerken patronen uit gezichtsfoto’s te laten leren, maar veelgebruikte architecturen hadden nog blinde vlekken. Convolutionele netwerken zijn goed in het herkennen van lokale details, maar hebben moeite om verbondenheid tussen ver verwijderde delen van het gezicht te leggen, bijvoorbeeld hoe ogen en mond samen bewegen in een gemengde uitdrukking. Nieuwere transformermodellen leggen deze langeafstandsrelaties vast, maar kunnen zwaar, data-intensief en minder geschikt zijn om zeer fijne, laag-niveau details op te pikken. Veel bestaande systemen vergen ook zorgvuldige handmatige afstemming van honderden interne instellingen en generaliseren vaak slecht buiten de data waarop ze getraind zijn.

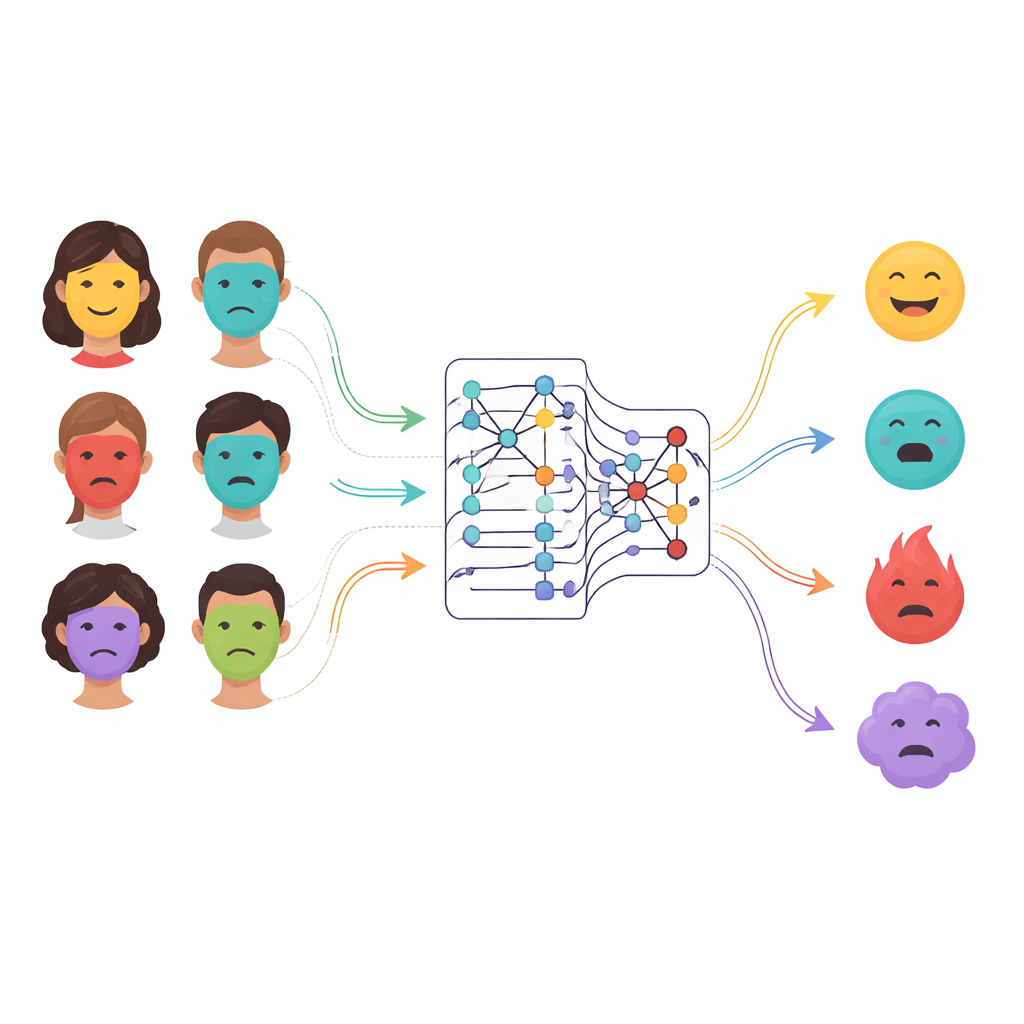

Een nieuw tweeling- en aandachtgerichte aanpak

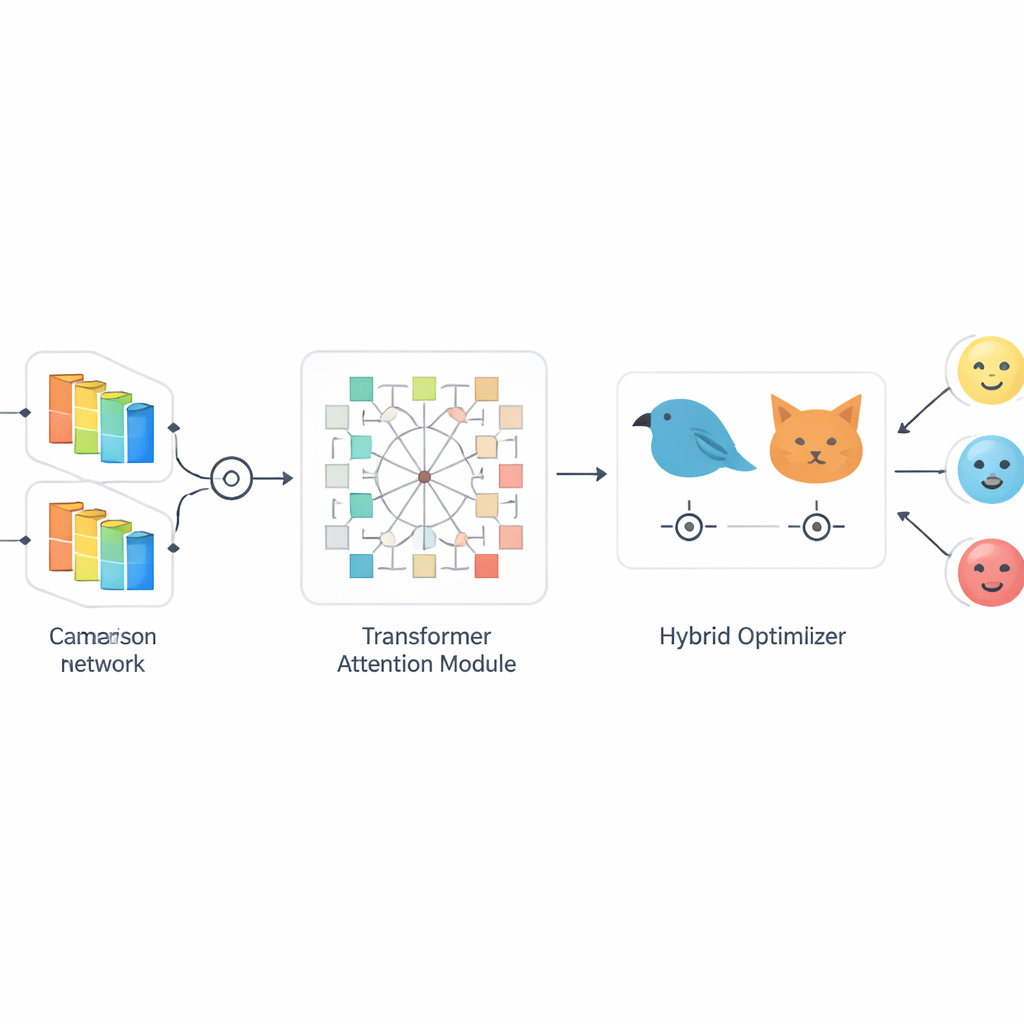

De auteurs stellen SiaCon-DetNet voor, een hybride netwerk dat de sterke punten van verschillende ideeën combineert. Ten eerste gebruikt het een Siamese structuur — twee identieke verwerkingsbranches die overeenkomende gezichtsfoto’s zien — om te leren wat werkelijk het verschil tussen emoties maakt. Dit tweelingontwerp helpt het model subtiele verschillen op te merken tussen bijvoorbeeld angst en verrassing, die vergelijkbare spieren kunnen gebruiken. Binnen elke branch leggen convolutionele lagen fijne texturen en vormen vast, zoals de kromming van wenkbrauwen of spanning in de mond. Daarbovenop werkt een transformer-gebaseerde module als een aandachtsspotlicht, die leert hoe ver verwijderde regio’s van het gezicht met elkaar samenhangen en zich richt op de meest informatieve zones. Samen stellen deze componenten het systeem in staat een rijk, contextbewust beeld van elke uitdrukking te bouwen, zelfs wanneer gezichten deels verborgen zijn of ongelijk verlicht.

Natuurgeïnspireerde afstemming voor scherper en sneller leren

Het ontwerpen van een krachtig model is slechts de helft van de strijd; het moet ook zo worden afgestemd dat het snel leert zonder te overfitten. Om hiermee om te gaan introduceert het artikel HySHO, een “bio-geïnspireerde” optimalisatieschema dat strategieën mengt die zijn gemodelleerd op een jachtvogel (sperwer/goshaak) en een woestijnkat. Het ene deel verkent een breed scala aan instellingen, zoals leersnelheden en filtergroottes, en voorkomt dat het systeem vastloopt in slechte oplossingen. Het andere deel voert fijnmazige aanpassingen uit in veelbelovende gebieden en versnelt zo de convergentie. Deze dynamische afstemming is gekoppeld aan hoeveel gezichtsuitdrukkingen variëren in een gegeven dataset, waardoor het model zichzelf kan bijstellen bij subtiele, gemengde of ruisachtige emoties. Als gevolg hiervan wordt trainen zowel sneller als robuuster, wat real-time of bijna real-time toepassingen ondersteunt.

Het systeem op de proef gesteld

Om hun kader te evalueren testten de onderzoekers het op drie veelgebruikte emotiendatasets die verschillen in grootte en moeilijkheid. Deze verzamelingen bevatten zowel aangeleerde als meer natuurlijke uitdrukkingen voor verschillende basale emoties zoals boosheid, angst, blijdschap, verdriet, afkeer, verrassing en neutraliteit. Het nieuwe systeem behaalde ongeveer 99 procent nauwkeurigheid op de bekendste benchmark en hield even indrukwekkende precisie-, recall- en F1-scores aan over vrijwel alle emotiecategorieën. Belangrijk is dat het dit deed terwijl het sneller trainde dan veel populaire deep learning-modellen die op bekende beeldarchitecturen zijn gebouwd. Analyses van hoe verschillende emoties correleren in elke dataset toonden aan dat het model lastige paren — zoals boosheid versus afkeer of angst versus verdriet — aankon zonder grote prestatieverlies, wat suggereert dat het de fijne structuur van uitdrukkingen vastlegt in plaats van alleen voor de hand liggende gevallen te memoriseren.

Wat dit betekent voor alledaagse technologie

In eenvoudige termen toont de studie aan dat je een AI kunt ontwerpen die gezichten op een menselijkere manier “bekijkt” — subtiele verschillen vergelijkt, context over het hele gezicht begrijpt en zijn eigen leerstrategie ter plekke aanpast. Het voorgestelde SiaCon-DetNet met HySHO-kader levert uiterst hoge nauwkeurigheid en blijft relatief licht en snel te trainen, waardoor het een sterke kandidaat is voor toekomstige hulpmiddelen in geestelijke gezondheidszorgscreening, interactieve tutoring, klantenservice en assistieve technologieën voor mensen met communicatiebeperkingen. Hoewel belangrijke vragen over privacy, toestemming en eerlijkheid blijven bestaan, brengt dit werk emotie-bewuste systemen dichter bij het betrouwbaar genoeg lezen van onze gevoelens om met gevoeligheid in plaats van giswerk te reageren.

Bronvermelding: M, S., M, U., K, T. et al. SiaCon-DetNet with HySHO: a cutting-edge transformer-based deep learning framework for emotion-aware facial recognition. Sci Rep 16, 14131 (2026). https://doi.org/10.1038/s41598-026-41890-9

Trefwoorden: herkenning van gezichts-emoties, deep learning, transformermodelen, mens–computerinteractie, affectieve computing