Clear Sky Science · pt

Ferramentas de grandes modelos de linguagem como catalisadores da cognição coletiva no desenvolvimento colaborativo de novos produtos: um estudo quase-experimental

Por que isso importa para o trabalho em equipe do dia a dia

Times modernos — de startups a grupos de trabalho escolares — vêm recorrendo cada vez mais a chatbots de IA para ajudar a pensar, planejar e criar. Ainda assim, sabemos surpreendentemente pouco sobre como essas ferramentas realmente alteram a forma como as pessoas trabalham juntas. Este estudo examina de perto como grandes modelos de linguagem (LLMs), como chatbots avançados, moldam o pensamento de grupo quando equipes projetam novos produtos em conjunto, e em que pontos o julgamento humano continua claramente superior à IA.

Como as equipes normalmente pensam juntas

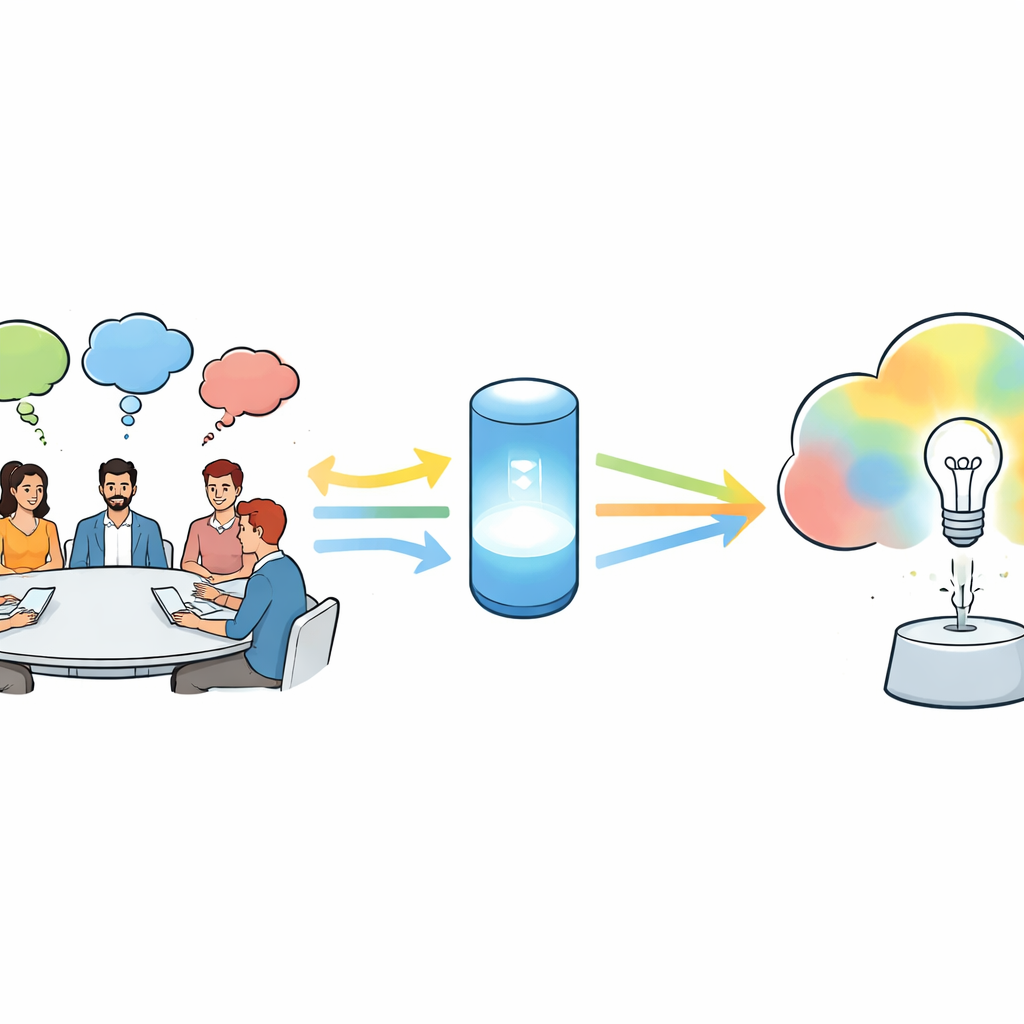

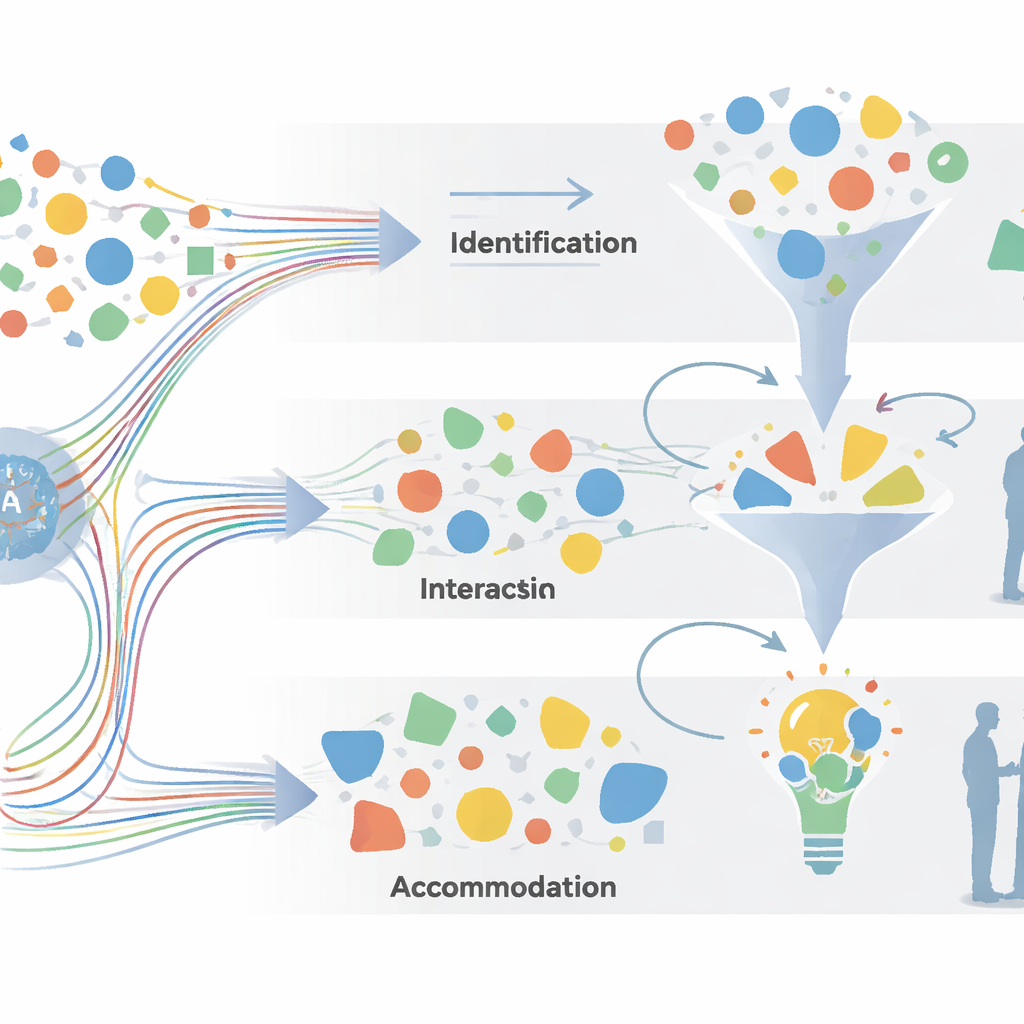

Quando pessoas colaboram no desenvolvimento de um novo produto, elas fazem mais do que apenas dividir tarefas; constroem gradualmente uma compreensão compartilhada do problema e das possíveis soluções. Os autores chamam isso de “cognição coletiva” — a forma como ideias e pontos de vista individuais se fundem em uma imagem mental comum. Pesquisas anteriores mostraram que esse pensamento compartilhado se desenvolve por ciclos de coleta de informações, discussão, ponderação de opções e definição de soluções, mas esses ciclos frequentemente eram descritos de forma ampla. Para estudar conversas reais em detalhe, os pesquisadores refinaram um modelo antigo no que chamam de estrutura 2I2A, que divide a colaboração em quatro espaços sobrepostos: identificar informações e sinais, interagir para organizar ideias, analisar opções e trade-offs, e acomodar, isto é, transformar insights em soluções viáveis.

Um olhar mais atento ao experimento

A equipe recrutou 44 estudantes avançados de design e engenharia e os agrupou em 22 duplas. Cada par teve 90 minutos para criar um produto inovador para crianças enquanto pensava em voz alta. Metade das equipes pôde usar livremente um LLM (ChatGPT-4 ou sistema similar) em um laptop; a outra metade contou apenas com papel e lápis. Todas as conversas faladas foram gravadas e depois codificadas cuidadosamente, linha a linha, usando o modelo 2I2A. Cada frase ou troca foi marcada como pertencente a um dos quatro espaços e a um dos oito tipos de comunicação mais finos, como absorver informação, estruturar perguntas, avaliar ideias ou combinar soluções. Além disso, os participantes que usaram LLM participaram de entrevistas semiestruturadas, que os pesquisadores analisaram com teoria fundamentada para descobrir temas comuns sobre a experiência de trabalhar com IA.

Onde a IA ajuda mais

Os dados mostram que os LLMs impulsionam fortemente as fases iniciais do pensamento em grupo. Em comparação com equipes sem IA, os grupos assistidos por LLM passaram mais tempo de colaboração nos espaços de Identificação e Interação. Eles pediam ao LLM fatos de contexto, exemplos e inspiração, e então usavam as respostas como matéria-prima para enquadrar e reenquadrar questões de design. Isso resultou em percepção de mais informações relevantes, seleção e acumulação de mais opções e reorganização mais ativa das ideias. As entrevistas confirmam isso: muitos participantes disseram que o LLM agilizou a pesquisa, sugeriu direções que não haviam considerado e funcionou como um “par conceitual” rápido que os ajudou a destravar bloqueios criativos. Em suma, a IA ampliou os limites cognitivos das equipes e ajudou-as a alcançar um ponto de partida compartilhado mais rapidamente.

Onde o julgamento humano ainda lidera

Em contraste, o LLM não alterou de forma significativa a frequência com que as equipes se engajaram em raciocínios mais profundos ou em sínteses finais. Nos espaços de Análise e Acomodação — onde as pessoas avaliam prós e contras, negociam diferenças e tecem ideias em um único projeto — os grupos com e sem LLM se comportaram de forma semelhante no geral, e em algumas subáreas as equipes sem IA foram mais ativas. Sem a IA, colaboradores gastaram mais tempo avaliando criticamente opções e discutindo trade-offs. Entrevistados frequentemente mencionaram que as sugestões do chatbot podiam ser superficiais, ocasionalmente imprecisas e excessivamente concordantes, raramente contrapondo como um colega crítico faria. Alguns sentiram que a IA às vezes “substituía” seu próprio pensamento ou os inclinava a seguir demais as ideias da ferramenta, o que poderia estreitar, em vez de ampliar, o leque de soluções. Isso ajuda a explicar por que, apesar de um brainstorming mais vivo no início, o resultado criativo final não foi claramente superior com IA.

Mudanças na dinâmica de equipe e riscos ocultos

Ao observar como as equipes transitavam entre os quatro espaços de pensamento ao longo do tempo, os pesquisadores descobriram que os grupos assistidos por LLM mostraram transições mais fluidas e de vai-e-vem, especialmente entre identificar informações e interagir para estruturá-las. A IA incentivou ciclos rápidos de perguntar, receber e reformular ideias, conferindo à colaboração um caráter mais ágil. Contudo, essa flexibilidade trouxe compensações. Alguns participantes relataram que as mudanças frequentes, alimentadas por respostas fáceis da IA, tornaram mais difícil desacelerar para uma reflexão mais profunda. Outros se preocuparam com a crescente dependência da ferramenta, a perda da discussão “natural” entre humanos e a necessidade de checar duas vezes o conteúdo da IA por erros ou falta de contexto. As entrevistas também apontaram efeitos sociais mais amplos: a IA pode automatizar tarefas rotineiras e liberar pessoas para atividades mais criativas, mas também pode alterar dinâmicas de poder ao dar mais influência a certos papéis — como gerentes de produto que orientam o uso da IA — dentro das equipes.

O que isso significa para usar IA em equipes reais

Para um público não especialista, a mensagem central é direta: LLMs são muito eficazes para ajudar equipes a começar e manter flexibilidade mental, mas não são um atalho para compreensão profunda ou decisões sábias. Essas ferramentas atuam como poderosos aceleradores para coletar informações, explorar ideias e construir uma imagem inicial compartilhada. No entanto, análises cuidadosas, escolhas difíceis e a integração de múltiplos pontos de vista em um projeto sólido e exequível ainda dependem fortemente da experiência humana, do pensamento crítico e da negociação. Os autores defendem que organizações tratem os LLMs como auxiliares de pensamento nas fases iniciais, dentro de uma visão 2I2A mais ampla da colaboração — não como substitutos das conversas e dos julgamentos humanos que, em última instância, fazem novos produtos terem sucesso.

Citação: Zhang, D., Luo, S., Liu, Y. et al. Large language model tools as catalysts for collective cognition in collaborative new-product development: a quasi-experimental study. Humanit Soc Sci Commun 13, 382 (2026). https://doi.org/10.1057/s41599-026-06738-7

Palavras-chave: grandes modelos de linguagem, design colaborativo, cognição coletiva, desenvolvimento de novos produtos, trabalho humano–IA