Clear Sky Science · de

Werkzeuge auf Basis großer Sprachmodelle als Katalysatoren kollektiver Kognition in kollaborativer Neuproduktentwicklung: eine quasiexperimentelle Studie

Warum das für die tägliche Teamarbeit wichtig ist

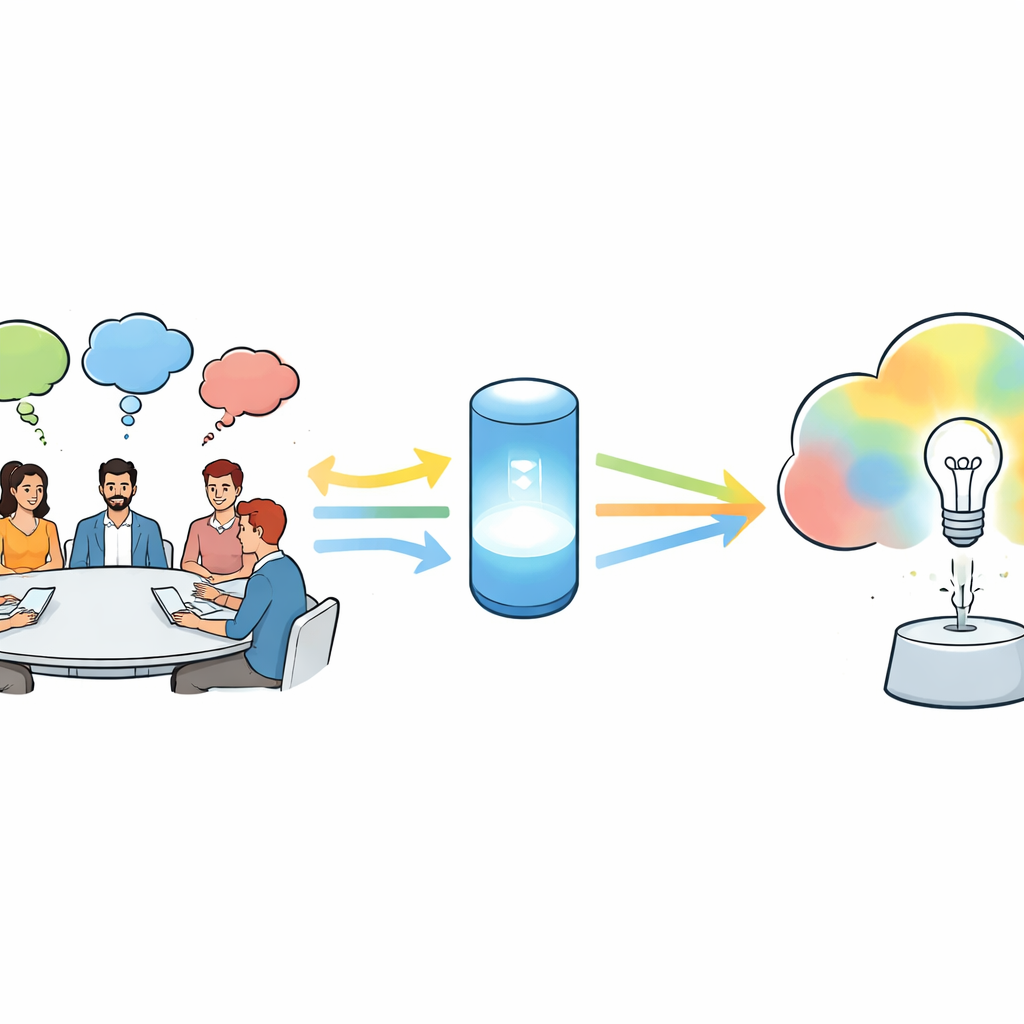

Moderne Teams – von Start-ups bis zu Schulprojektgruppen – greifen zunehmend zu KI-Chatbots, um beim Denken, Planen und Kreieren zu unterstützen. Überraschend wenig wissen wir jedoch darüber, wie diese Werkzeuge die Art und Weise, wie Menschen zusammenarbeiten, tatsächlich verändern. Diese Studie untersucht genau, wie große Sprachmodelle (LLMs), etwa fortgeschrittene Chatbots, das Denken in Gruppen beim gemeinsamen Entwerfen neuer Produkte prägen und wo menschliches Urteilsvermögen weiterhin klar überlegen ist.

Wie Teams normalerweise gemeinsam denken

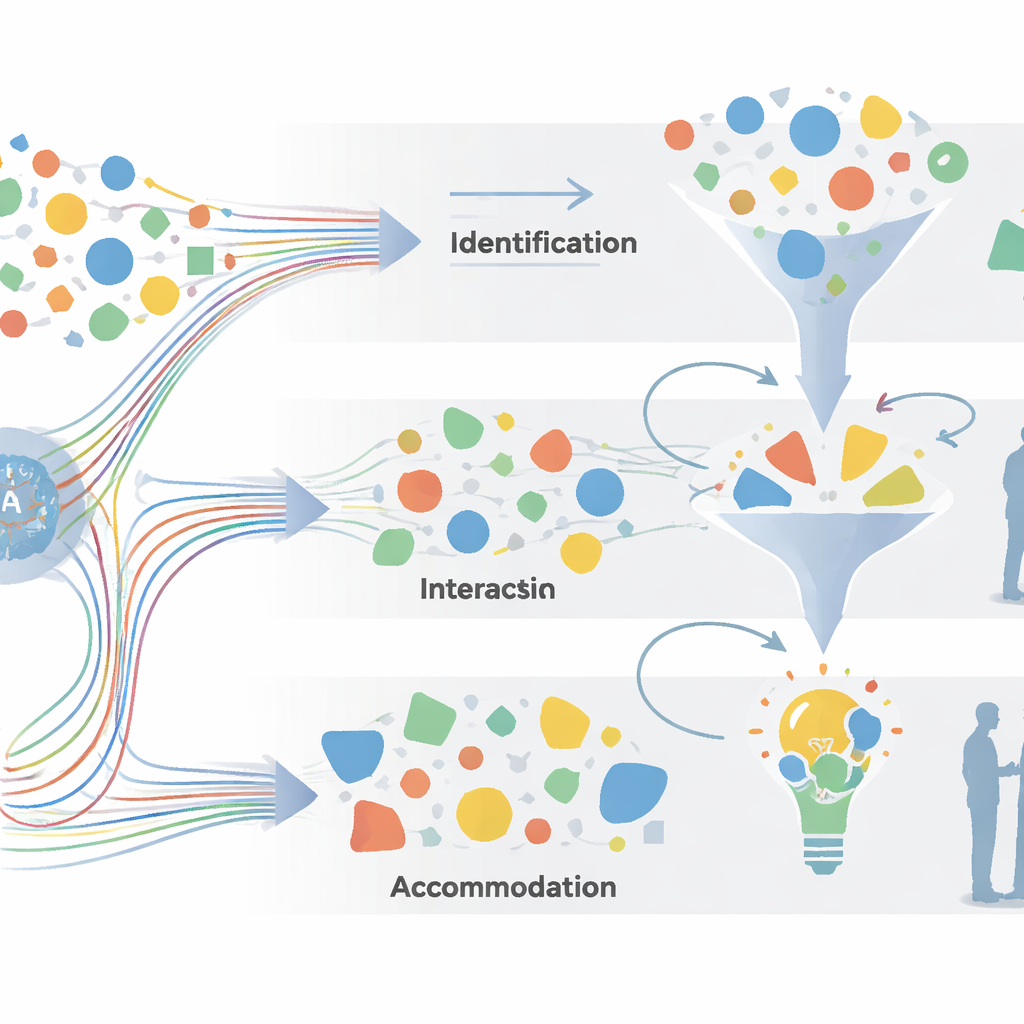

Wenn Menschen an einem neuen Produkt zusammenarbeiten, teilen sie mehr als nur Aufgaben; sie entwickeln allmählich ein gemeinsames Verständnis des Problems und möglicher Lösungen. Die Autorinnen und Autoren bezeichnen dies als „kollektive Kognition“ – die Art und Weise, wie individuelle Ideen und Perspektiven zu einem geteilten mentalen Bild verschmelzen. Frühere Forschung zeigte, dass dieses geteilte Denken durch Zyklen des Informationssammelns, Durchsprechens, Abwägens von Optionen und Festlegens auf Lösungen entsteht, doch diese Zyklen wurden oft nur grob beschrieben. Um reale Gespräche im Detail zu untersuchen, verfeinerten die Forschenden ein älteres Modell zu dem, was sie das 2I2A-Rahmenwerk nennen, das Zusammenarbeit in vier überlappende Bereiche gliedert: Identifikation von Informationen und Hinweisen, Interaktion zur Organisation von Ideen, Analyse von Optionen und Kompromissen sowie Akkommodation, also die Umsetzung von Einsichten in umsetzbare Lösungen.

Blick ins Experiment

Das Team rekrutierte 44 fortgeschrittene Design‑ und Ingenieurstudierende und bildete 22 Zweiergruppen. Jedes Paar hatte 90 Minuten Zeit, ein innovatives Produkt für Kinder zu entwickeln – dabei sollten sie laut denken. Die Hälfte der Teams konnte frei ein LLM (ChatGPT‑4 oder ein ähnliches System) auf einem Laptop nutzen; die andere Hälfte hatte nur Papier und Stifte. Alle gesprochenen Unterhaltungen wurden aufgezeichnet und anschließend Zeile für Zeile mithilfe des 2I2A‑Modells sorgfältig kodiert. Jeder Satz oder Austausch wurde einem der vier Bereiche und einer von acht feiner gegliederten Kommunikationsarten zugeordnet, zum Beispiel Informationsaufnahme, Strukturierung von Fragen, Bewertung von Ideen oder Kombinieren von Lösungen. Zusätzlich nahmen die LLM‑nutzenden Teilnehmenden an semi‑strukturierten Interviews teil, die die Forschenden mit Grounded Theory analysierten, um gängige Themen in den Einstellungen zur Arbeit mit KI zu identifizieren.

Wo KI am meisten hilft

Die Daten zeigen, dass LLMs die frühen Phasen des Gruppendenkens stark fördern. Im Vergleich zu Teams ohne KI verbrachten LLM‑gestützte Gruppen mehr Zeit ihrer Zusammenarbeit in den Bereichen Identifikation und Interaktion. Sie fragten das LLM nach Hintergrundwissen, Beispielen und Inspiration und nutzten seine Antworten als Rohmaterial, um Designfragen zu formulieren und neu zu rahmen. Das führte dazu, dass sie mehr relevante Informationen wahrnahmen, mehr Optionen auswählten und sammelten und Ideen aktiver umorganisierten. Die Interviews stützen diese Befunde: Viele Teilnehmende sagten, das LLM habe ihre Recherche beschleunigt, Richtungen vorgeschlagen, an die sie nicht gedacht hatten, und wie ein schneller „Konzeptpartner“ geholfen, kreative Blockaden zu überwinden. Kurz gesagt: KI erweiterte die kognitiven Grenzen der Teams und half ihnen, schneller zu einem gemeinsamen Ausgangspunkt zu gelangen.

Wo menschliches Urteil weiterhin führend ist

Im Gegensatz dazu veränderte das LLM nicht wesentlich, wie häufig Teams tiefergehendes Schlussfolgern oder die abschließende Synthese durchführten. In den Bereichen Analyse und Akkommodation – wo Menschen Vor‑ und Nachteile abwägen, Unterschiede verhandeln und Ideen zu einem einheitlichen Design verweben – verhielten sich LLM‑ und Nicht‑LLM‑Gruppen insgesamt ähnlich, und in einigen Teilbereichen waren die rein menschlichen Teams aktiver. Ohne KI verbrachten Mitarbeitende mehr Zeit damit, Optionen kritisch zu bewerten und Kompromisse zu diskutieren. Interviewte nannten oft, dass die Vorschläge des Chatbots oberflächlich, gelegentlich ungenau und zu zustimmend sein könnten, also selten so widersprachen wie ein kritischer Teamkollege. Einige hatten das Gefühl, die KI ersetze manchmal ihr eigenes Denken oder lenke sie zu stark in Richtung ihrer Vorschläge, was die Bandbreite der Lösungen eher einengen als erweitern könne. Das erklärt, warum trotz lebhafterem Brainstorming in der Frühphase die endgültige kreative Leistung mit KI nicht klar besser war.

Verschiebungen in Teamdynamik und versteckte Risiken

Betrachtet man, wie Teams im Zeitverlauf zwischen den vier Denkbereichen wechselten, stellten die Forschenden fest, dass LLM‑gestützte Gruppen flüssigere, hin‑und‑her‑gehende Übergänge zeigten, besonders zwischen der Identifikation von Informationen und der Interaktion zur Strukturierung derselben. Die KI förderte schnelle Zyklen aus Fragen, Antworten und Umformungen von Ideen und verlieh der Zusammenarbeit ein agileres Gefühl. Diese Flexibilität hatte jedoch Abwägungen zur Folge. Einige Teilnehmende berichteten, dass häufige Wechsel, angetrieben durch einfache KI‑Antworten, es erschwerten, für tiefere Reflexionen langsamer zu werden. Andere sorgten sich um zunehmende Abhängigkeit vom Werkzeug, den Verlust „natürlicher“ Mensch‑zu‑Mensch‑Diskussionen und die Notwendigkeit, KI‑Inhalte auf Fehler oder fehlenden Kontext zu prüfen. Die Interviews deuteten auch auf breitere soziale Effekte hin: KI könnte Routineaufgaben automatisieren und Menschen für kreativere Tätigkeiten freisetzen, zugleich aber Machtverhältnisse verändern, indem bestimmte Rollen – etwa Produktmanager, die den KI‑Einsatz steuern – mehr Einfluss im Team erhalten.

Was das für den Einsatz von KI in realen Teams bedeutet

Für Nicht‑Spezialisten ist die Kernbotschaft klar: LLMs sind sehr gut darin, Teams beim Einstieg zu helfen und mental flexibel zu halten, aber sie sind kein Ersatz für tiefes Verständnis oder kluge Entscheidungen. Diese Werkzeuge wirken als leistungsfähige Beschleuniger beim Sammeln von Informationen, beim Erkunden von Ideen und beim Aufbau eines ersten gemeinsamen Bildes. Sorgfältige Analyse, schwierige Entscheidungen und das Zusammenführen vieler Perspektiven zu einem soliden, umsetzbaren Design hängen jedoch weiterhin stark von menschlicher Expertise, kritischem Denken und Verhandlung ab. Die Autorinnen und Autoren plädieren dafür, dass Organisationen LLMs als Hilfsmittel für frühe Denkphasen innerhalb eines umfassenderen 2I2A‑Verständnisses von Zusammenarbeit behandeln – nicht als Ersatz für die menschlichen Gespräche und Urteile, die letztlich den Erfolg neuer Produkte ausmachen.

Zitation: Zhang, D., Luo, S., Liu, Y. et al. Large language model tools as catalysts for collective cognition in collaborative new-product development: a quasi-experimental study. Humanit Soc Sci Commun 13, 382 (2026). https://doi.org/10.1057/s41599-026-06738-7

Schlüsselwörter: große Sprachmodelle, kollaboratives Design, kollektive Kognition, Neuproduktentwicklung, Mensch–KI-Teamarbeit