Clear Sky Science · ja

新製品開発における集合的認知の触媒としての大規模言語モデルツール:準実験的研究

日常のチームワークにとってなぜ重要か

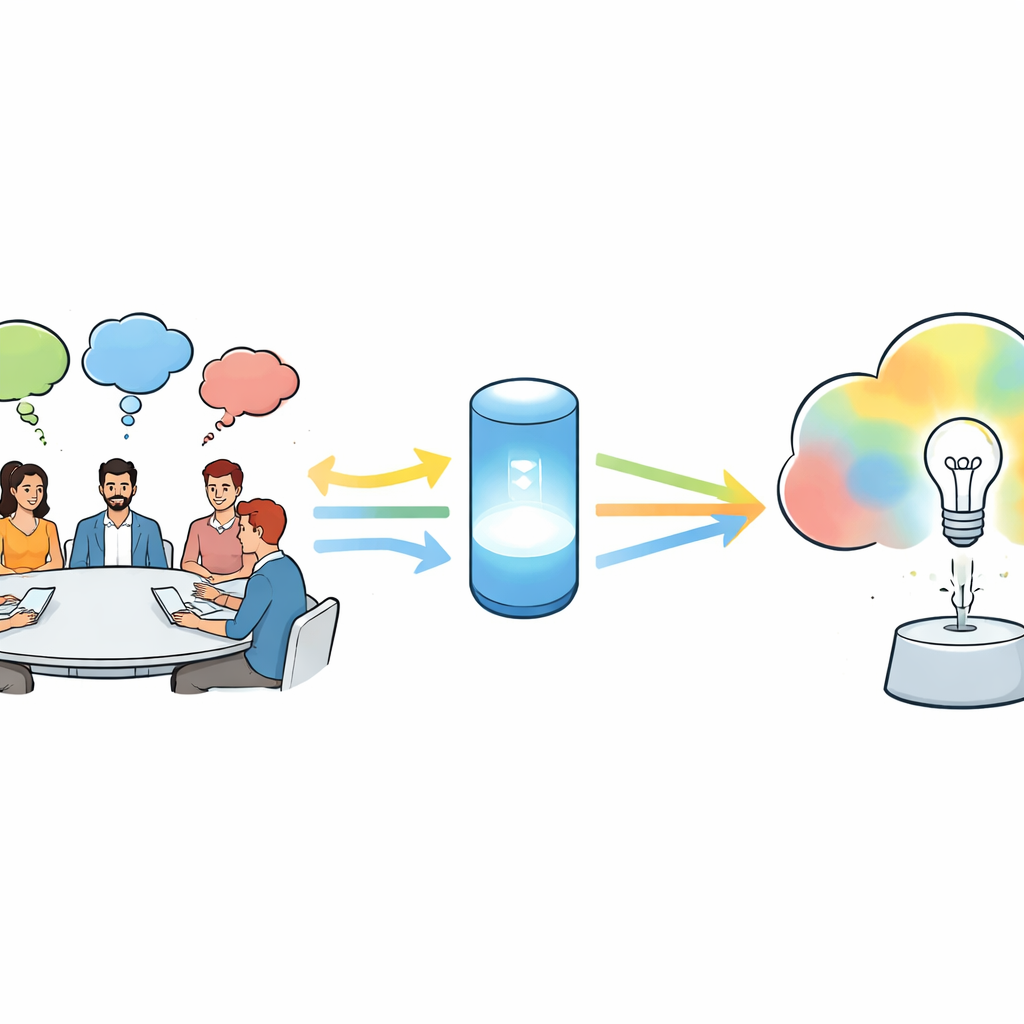

スタートアップから学校のプロジェクトグループまで、現代のチームは思考・計画・創造を補助するためにAIチャットボットをますます利用しています。しかし、これらのツールが実際に人々の協働の仕方をどのように変えるかについては、驚くほど不明な点が多い。本研究は、高度なチャットボットなどの大規模言語モデル(LLM)が、チームが新製品を共同設計する際のグループ思考にどのように影響し、人間の判断がどこでまだ明確に優れているかを詳しく検証します。

チームは通常どのように共に考えるか

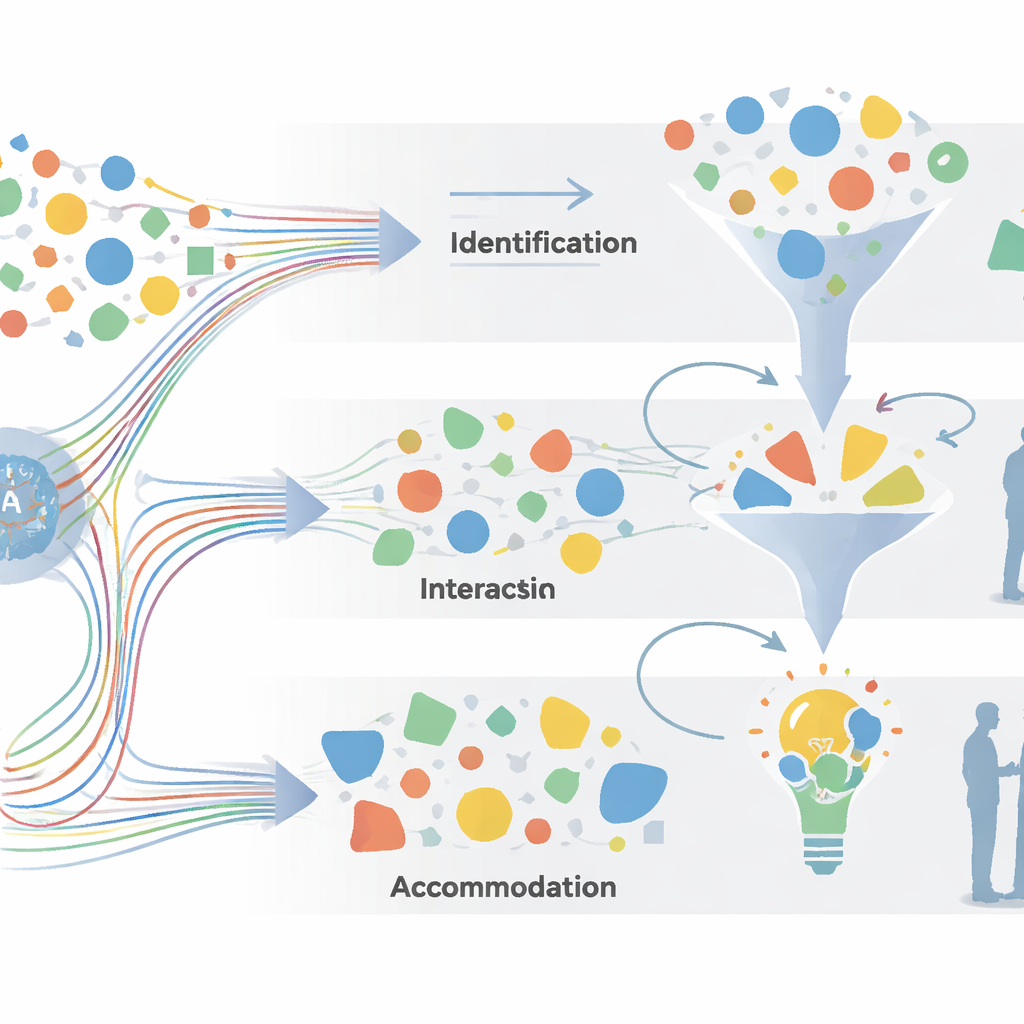

人々が新製品に協働する際、単に作業を分担するだけでなく、問題と可能な解決策に関する共有理解を徐々に構築します。著者らはこれを「集合的認知」と呼びます。これは個々のアイデアや視点がひとつの共通の心的イメージに溶け込む仕方を示します。先行研究は、この共有された思考が情報収集、議論、選択肢の検討、解決策の決定というサイクルを通じて発展すると示してきましたが、これらのサイクルはしばしば大まかに記述されていました。実際の会話を詳細に調べるために、研究者らは既存のモデルを洗練し、2I2Aフレームワークと呼ぶ枠組みにまとめました。これは協働を重なる四つの領域に分けます:情報と手がかりの特定(Identification)、アイデアを整理するための相互作用(Interaction)、選択肢とトレードオフの分析(Analysis)、および洞察を実用的な解へ変える受容・適応(Accommodation)です。

実験を詳しく見ると

研究チームは高度なデザインおよび工学を学ぶ学生44名を募集し、二人一組の22グループに分けました。各ペアは子ども向けの革新的な製品を考案するために90分間、思考を声に出しながら作業しました。半数のチームはノートパソコン上でLLM(ChatGPT‑4または同等のシステム)を自由に使え、残りは紙と鉛筆だけを使いました。すべての音声会話は記録され、2I2Aモデルに基づいて一行ずつ丁寧にコーディングされました。各文ややり取りは四つの領域のどれかと、情報の取り込み、問いの組立て、アイデアの評価、解の統合など八つのより細かなコミュニケーションタイプのいずれかに分類されました。加えて、LLMを使った参加者は半構造化インタビューにも参加し、研究者はグラウンデッド・セオリーで解析して、人々がAIと働くことについて抱く共通のテーマを抽出しました。

AIが最も助ける領域

データはLLMがグループ思考の初期段階を強く後押しすることを示しています。AIを使わないチームと比べて、LLM支援チームはIdentificationとInteractionの領域により多くの時間を費やしました。彼らはLLMに背景事実、例、着想を求め、その応答を素材として設計上の問いを構成・再構成しました。その結果、より多くの関連情報を知覚し、より多くの選択肢を選び・蓄積し、より積極的にアイデアを再編成しました。インタビューもこれを裏付けます:多くの参加者はLLMが調査を加速し、彼らが考えていなかった方向を示し、創造的な行き詰まりを破る「クイックなコンセプト・パートナー」のように働いたと述べています。要するに、AIはチームの認知的境界を広げ、共有された出発点により早く到達するのを助けました。

それでも人間の判断が優る領域

対照的に、LLMはチームがより深い推論や最終的な統合に従事する頻度を有意に変えませんでした。AnalysisとAccommodationの領域—利点と欠点を評価し、意見の違いを交渉し、アイデアを一つの設計に織り込む場面—では、LLM使用チームと非使用チームは全体的に類似した振る舞いを示し、いくつかのサブ領域では人間のみのチームの方がより活発でした。AIを使わない場合、協働者は選択肢を批判的に評価し、トレードオフを議論するのにより多くの時間を費やしました。インタビューではチャットボットの提案が浅く、時に不正確で、同意的すぎて批判的なチームメイトのように反論しないことが指摘されました。AIが時に彼ら自身の思考を“置き換える”か、その提案に従うよう促すことで、解の幅を狭めてしまうと感じた参加者もいました。これが、初期段階のブレインストーミングは活発になっても、最終的な創造成果がAIで明確に高まらなかった理由を説明します。

チームダイナミクスの変化と潜在的リスク

四つの思考領域間をチームがどのように行き来したかを観察すると、LLM支援グループは特に情報の特定とそれを構造化するための相互作用の間で、より流動的で往復的な移行を示しました。AIは問いかけ、応答、アイデアの再形成を素早く繰り返すことを促し、協働により機敏な感触を与えました。しかし、この柔軟性にはトレードオフが伴いました。簡単に得られるAI応答により頻繁に切り替えると、深い熟考のために立ち止まるのが難しくなると報告した参加者もいました。ほかにも、ツールへの依存の高まり、“自然な”人間同士の議論の喪失、AIの内容の誤りや文脈の欠落を二重チェックする必要性を懸念する声がありました。インタビューはより広い社会的影響も示唆しています:AIは定型作業を自動化して人々をより創造的な仕事に解放する一方で、AIの使用を指揮するプロダクトマネージャーのような特定の役割により大きな影響力を与え、チーム内の権力構造を変え得るという点です。

実務チームでAIを使う際の含意

専門外の人に向けた核心メッセージは明快です:LLMはチームの立ち上げと認知的柔軟性の維持に非常に有用ですが、深い理解や賢明な判断への近道ではありません。これらのツールは情報収集、アイデア探索、初期の共有像構築を強力に加速しますが、慎重な分析、困難な選択、そして多様な視点を一つの堅実で実行可能な設計に統合する作業は依然として人間の専門知識、批判的思考、交渉に大きく依存します。著者らは、組織はLLMを協働の2I2Aフレームワークにおける初期段階の思考支援として扱うべきであり、最終的に新製品を成功させる人間の対話や判断の代替とは見なすべきではないと主張しています。

引用: Zhang, D., Luo, S., Liu, Y. et al. Large language model tools as catalysts for collective cognition in collaborative new-product development: a quasi-experimental study. Humanit Soc Sci Commun 13, 382 (2026). https://doi.org/10.1057/s41599-026-06738-7

キーワード: 大規模言語モデル, 協働デザイン, 集合的認知, 新製品開発, 人間–AIのチームワーク