Clear Sky Science · nl

Grote taalmodelhulpmiddelen als katalysatoren voor collectieve cognitie bij gezamenlijk productontwikkelen: een quasi-experimentele studie

Waarom dit van belang is voor alledaagse teams

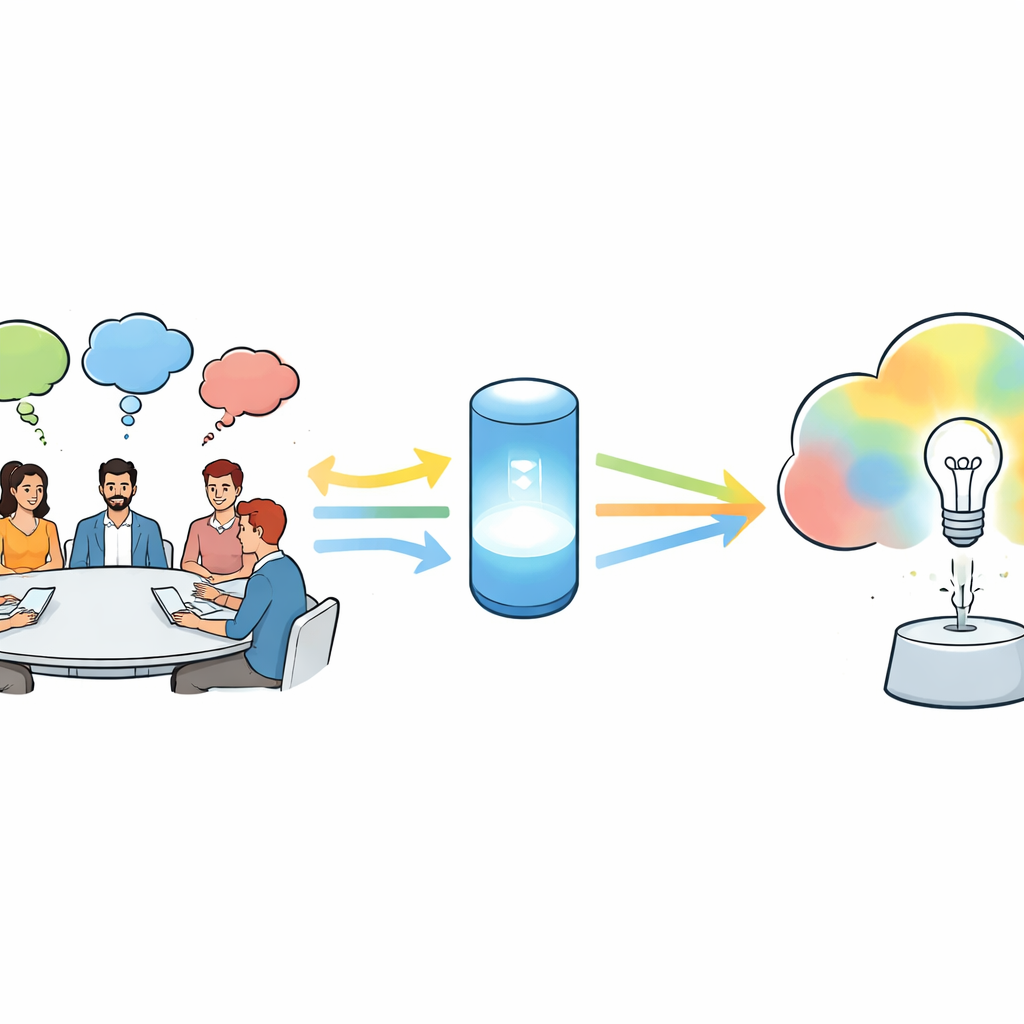

Moderne teams—van start-ups tot schoolprojectgroepen—wenden zich steeds vaker tot AI-chatbots om te helpen bij denken, plannen en creëren. Toch weten we verrassend weinig over hoe deze hulpmiddelen daadwerkelijk de manier veranderen waarop mensen samenwerken. Deze studie onderzoekt nauwkeurig hoe grote taalmodellen (LLM’s), zoals geavanceerde chatbots, de groepsgedachte beïnvloeden wanneer teams samen nieuwe producten ontwerpen, en waar menselijk oordeel nog duidelijk beter presteert dan AI.

Hoe teams normaal gesproken samen nadenken

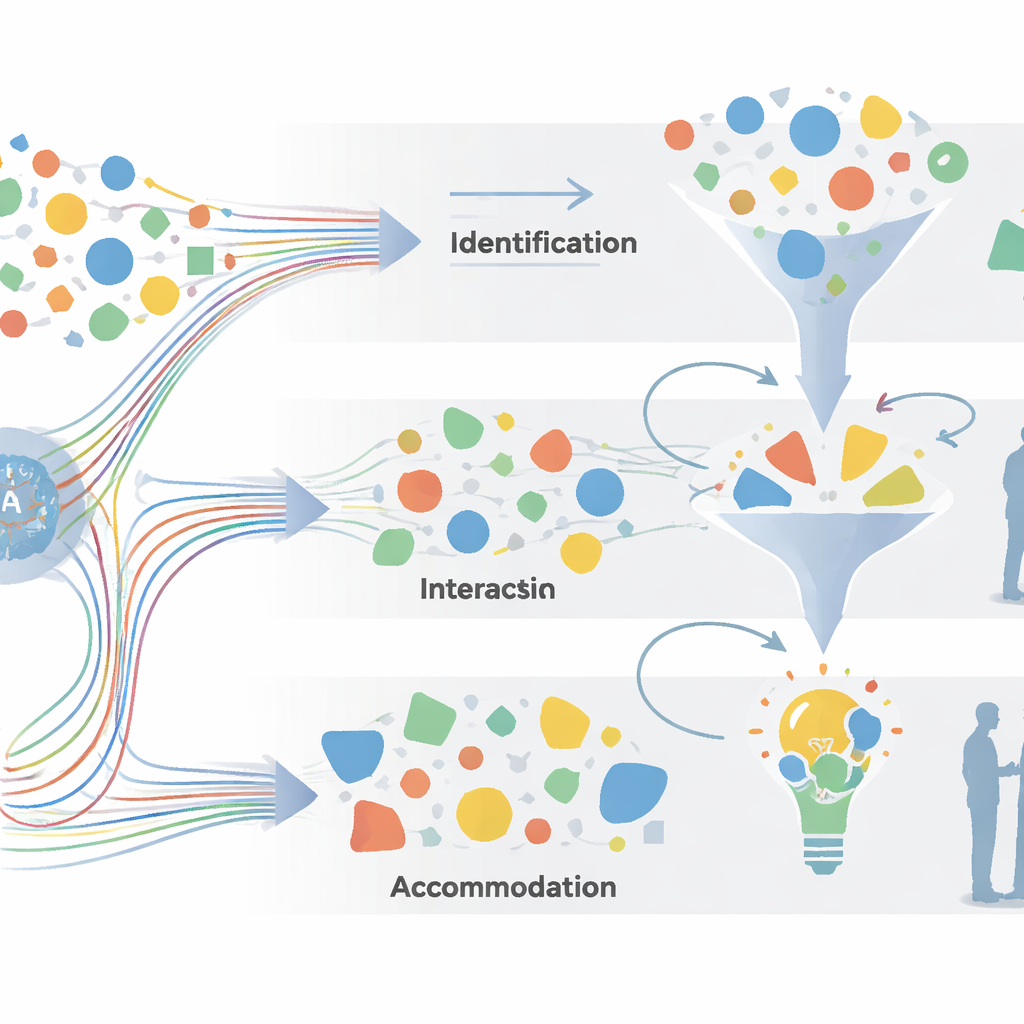

Wanneer mensen samenwerken aan een nieuw product, doen ze meer dan alleen taken verdelen; ze bouwen geleidelijk aan een gedeeld begrip van het probleem en mogelijke oplossingen. De auteurs noemen dit "collectieve cognitie"—de manier waarop individuele ideeën en gezichtspunten samensmelten tot een gemeenschappelijk mentaal beeld. Eerder onderzoek toonde aan dat dit gedeelde denken zich ontwikkelt via cycli van informatie verzamelen, erover praten, opties afwegen en oplossingen bepalen, maar die cycli werden vaak vaag beschreven. Om echte gesprekken in detail te bestuderen verfijnden de onderzoekers een ouder model tot wat zij het 2I2A-kader noemen, dat samenwerking opsplitst in vier overlappende ruimten: identificeren van informatie en aanwijzingen, interactie om ideeën te ordenen, analyseren van opties en afwegingen, en accommoderen—het omzetten van inzichten in werkbare oplossingen.

Een nadere blik op het experiment

Het team rekruteerde 44 gevorderde design- en ingenieursstudenten en deelde hen in 22 tweetallen. Elk paar had 90 minuten om een innovatief product voor kinderen te maken, terwijl ze hardop hun gedachten uitspraken. De helft van de teams mocht vrij een LLM (ChatGPT-4 of een vergelijkbaar systeem) op een laptop gebruiken; de andere helft had alleen papier en potloden. Alle gesproken gesprekken werden opgenomen en vervolgens regel voor regel zorgvuldig gecodeerd met behulp van het 2I2A-model. Elke zin of uitwisseling werd gemarkeerd als behorend tot één van de vier ruimten en tot één van acht fijnmazigere communicatietypen, zoals informatie opnemen, vragen structureren, ideeën evalueren of oplossingen combineren. Daarnaast namen de LLM-gebruikers deel aan semi-gestructureerde interviews, die de onderzoekers met grounded theory analyseerden om algemene thema’s te ontdekken in hoe mensen het werken met AI ervaarden.

Waar AI het meest helpt

De gegevens tonen aan dat LLM’s de vroege fasen van groepsdenken sterk versterken. Vergeleken met teams zonder AI besteedden LLM-ondersteunde groepen meer van hun samenwerkingstijd in de Identificatie- en Interactieruimten. Ze vroegen de LLM om achtergrondfeiten, voorbeelden en inspiratie, en gebruikten de antwoorden als grondstof om ontwerpvraagstukken te kaderen en opnieuw te kaderen. Dit betekende dat ze meer relevante informatie waarnamen, meer opties selecteerden en opstapelden en actiever ideeën herstructureerden. De interviews bevestigen dit: veel deelnemers zeiden dat de LLM hun onderzoek versnelde, richtingen suggereerde waaraan ze niet hadden gedacht en fungeerde als een snel "conceptpartner" die hielp creatieve blokkades te doorbreken. Kortom, AI vergrootte de cognitieve grenzen van de teams en hielp hen sneller tot een gedeelde uitgangspositie te komen.

Waar menselijk oordeel nog steeds voorop loopt

Daarentegen veranderde de LLM niet significant hoe vaak teams zich bezighielden met dieper redeneren of eind-synthese. In de Analyse- en Accommodatieruimten—waar mensen voor- en nadelen evalueren, verschillen bediscussiëren en ideeën samenvoegen tot één ontwerp—gedroegen LLM- en niet-LLM-groepen zich over het algemeen vergelijkbaar, en in sommige deelgebieden waren teams zonder AI juist actiever. Zonder AI besteedden samenwerkers meer tijd aan het kritisch beoordelen van opties en het bespreken van afwegingen. Interviewees noemden vaak dat de suggesties van de chatbot oppervlakkig konden zijn, soms onnauwkeurig en te meegaand, en zelden tegenwicht boden zoals een kritische teamgenoot dat zou doen. Sommigen voelden dat AI soms hun eigen denken "vervanging" gaf of hen aanspoorde om te veel de ideeën van de AI te volgen, wat de reikwijdte van oplossingen eerder kon vernauwen dan verruimen. Dit verklaart waarom, ondanks levendiger vroege brainstormsessies, de uiteindelijke creatieve output met AI niet duidelijk hoger was.

Verschuivingen in teamdynamiek en verborgen risico’s

Als je bekijkt hoe teams in de loop van de tijd tussen de vier denkkaders bewogen, ontdekten de onderzoekers dat LLM-ondersteunde groepen meer vloeiende, heen-en-weer overgangen vertoonden, vooral tussen informatie identificeren en interactie om die te structureren. De AI stimuleerde snelle cycli van vragen, antwoorden en het hervormen van ideeën, waardoor de samenwerking een meer agile karakter kreeg. Deze flexibiliteit ging echter gepaard met compromissen. Sommige deelnemers meldden dat frequente verschuivingen, aangedreven door gemakkelijke AI-reacties, het moeilijker maakten om te vertragen voor diepere reflectie. Anderen maakten zich zorgen over groeiende afhankelijkheid van het hulpmiddel, verlies van "natuurlijke" mens-tot-mens discussie en de noodzaak om AI-inhoud dubbel te controleren op fouten of ontbrekende context. De interviews wezen ook op bredere sociale effecten: AI kan routinetaken automatiseren en mensen vrijmaken voor creatievere taken, maar het kan ook machtsdynamiek veranderen door bepaalde rollen—zoals productmanagers die het gebruik van AI sturen—meer invloed binnen teams te geven.

Wat dit betekent voor het gebruik van AI in echte teams

Voor niet-specialisten is de kernboodschap helder: LLM’s zijn erg goed in het helpen van teams om van start te gaan en mentaal flexibel te blijven, maar ze zijn geen snelkoppeling naar diepgaand begrip of wijze beslissingen. Deze hulpmiddelen fungeren als krachtige versnellers voor het verzamelen van informatie, het verkennen van ideeën en het opbouwen van een initiëel gedeeld beeld. Zorgvuldige analyse, lastige keuzes en het samenvoegen van vele gezichtspunten tot een solide, werkbaar ontwerp blijven echter sterk afhankelijk van menselijke expertise, kritisch denken en onderhandeling. De auteurs betogen dat organisaties LLM’s moeten behandelen als hulpmiddelen voor vroege-fase denken binnen een breder 2I2A-perspectief op samenwerking—niet als vervanging van de menselijke gesprekken en oordelen die uiteindelijk bepalen of nieuwe producten slagen.

Bronvermelding: Zhang, D., Luo, S., Liu, Y. et al. Large language model tools as catalysts for collective cognition in collaborative new-product development: a quasi-experimental study. Humanit Soc Sci Commun 13, 382 (2026). https://doi.org/10.1057/s41599-026-06738-7

Trefwoorden: grote taalmodellen, collaboratief ontwerp, collectieve cognitie, ontwikkeling van nieuwe producten, mens–AI samenwerking