Clear Sky Science · he

כלים מבוססי מודלים לשוניים גדולים כמזרזים של קוגניציה קולקטיבית בפיתוח משותף של מוצר חדש: מחקר קוואזי-ניסויי

מדוע זה רלוונטי לעבודה צוותית יומיומית

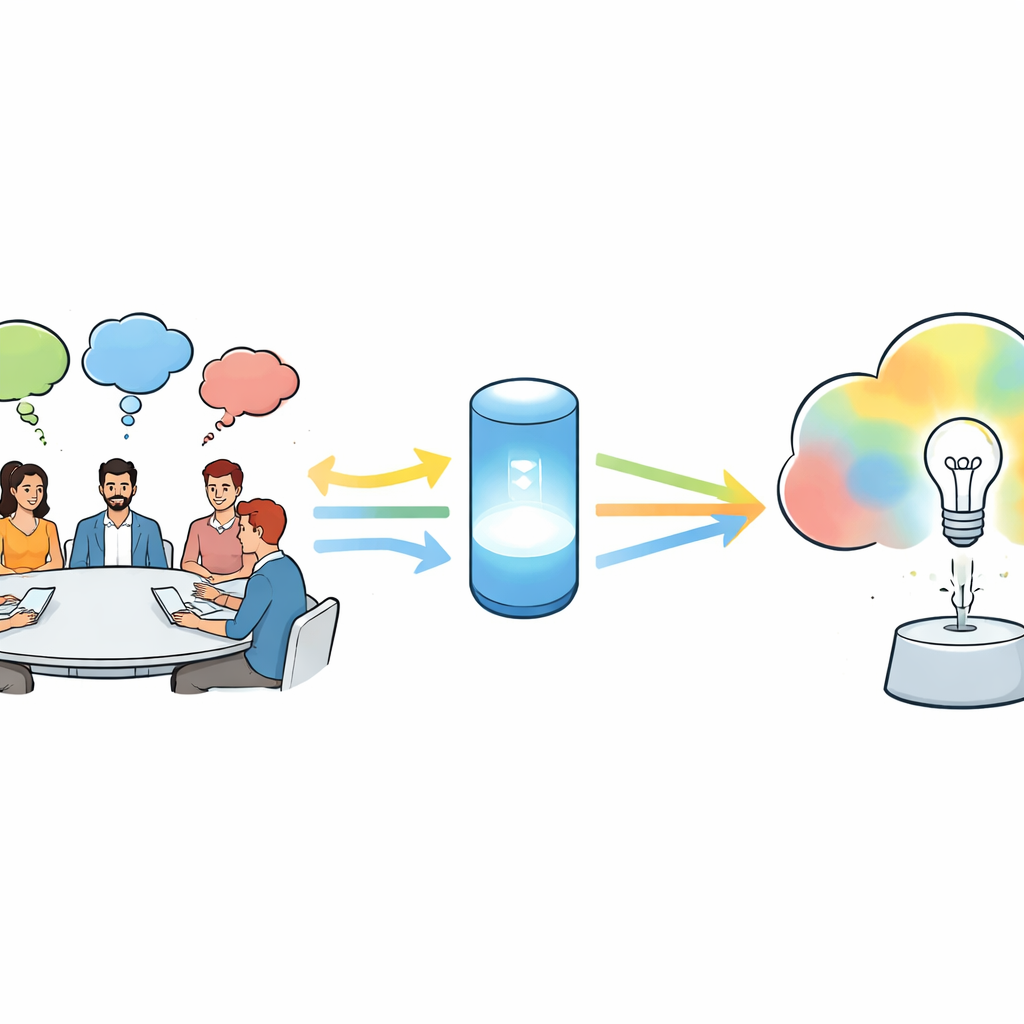

צוותים מודרניים — החל מהסטארט‑אפים ועד לקבוצות פרויקטים בבית הספר — פונים יותר ויותר לצ׳אבטים מבוססי בינה מלאכותית כדי לסייע להם לחשוב, לתכנן וליצור. אך ידוע לנו במפתיע מעט על האופן שבו כלים אלו באמת משנים את דרך עבודתם המשותפת של אנשים. מחקר זה בוחן מקרוב כיצד מודלים שפתיים גדולים (LLMs), כגון צ׳אבטים מתקדמים, מעצבים חשיבה קבוצתית כשהצוותים מעצבים יחד מוצר חדש, ואיפה עדיין השיפוט האנושי מצטיין על פני הבינה המלאכותית.

כיצד צוותים חושבים ביחד בדרך כלל

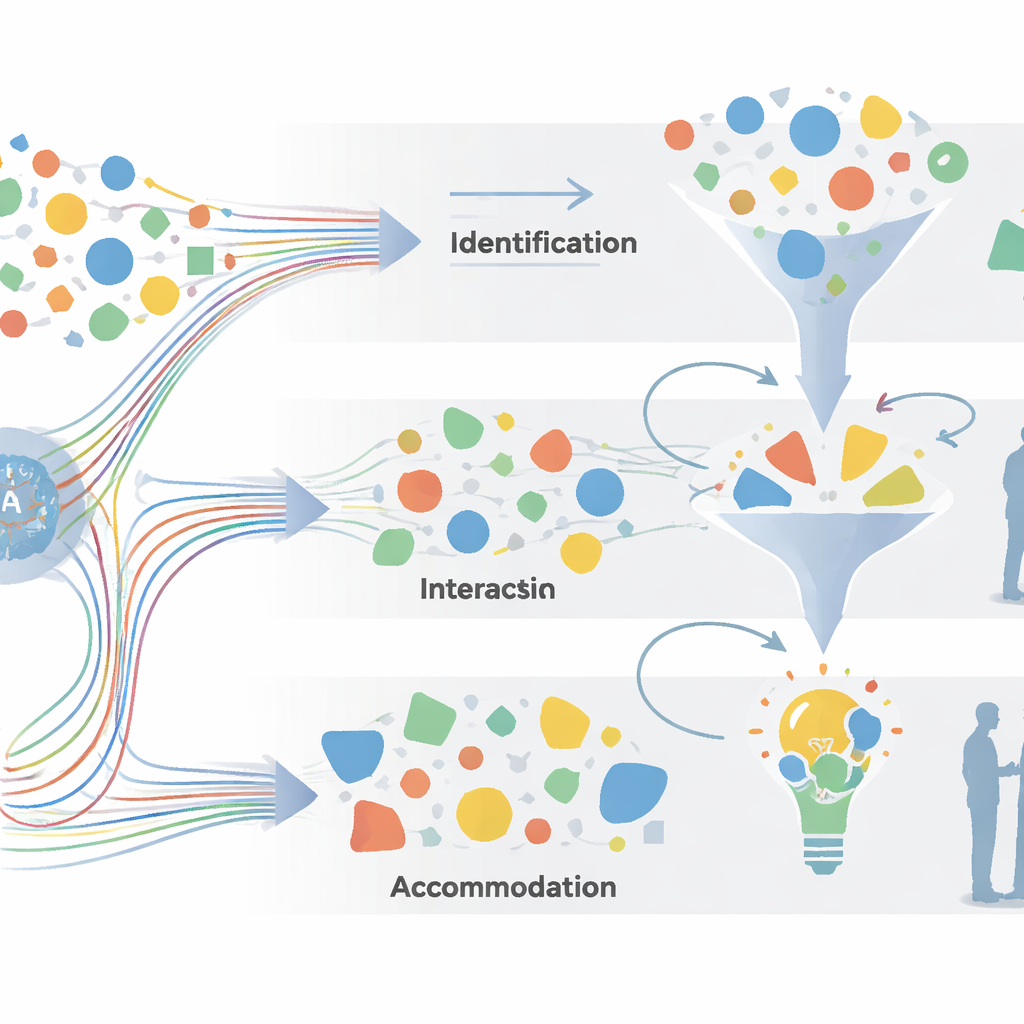

כאשר אנשים משתפים פעולה על מוצר חדש, הם עושים יותר משהחלוקה פשוטה של משימות; הם בונים בהדרגה הבנה משותפת של הבעיה והפתרונות האפשריים. המחברים מכנים זאת "קוגניציה קולקטיבית" — האופן שבו רעיונות ותפיסות אישיות מתמזגים לתמונה מנטלית משותפת. מחקרים קודמים הראו שהחשיבה המשותפת הזו מתפתחת דרך מחזורים של איסוף מידע, דיון, שקלול אפשרויות והגעה להחלטות, אך מחזורים אלו תוארו לעיתים באופן כללי. כדי לחקור שיחות אמיתיות בפירוט, החוקרים שידרגו מודל ישן למסגרת שהם קוראים לה 2I2A, שמפרקת שיתוף פעולה לארבעה מרחבים חופפים: זיהוי מידע ואותות, אינטראקציה לארגון רעיונות, ניתוח אופציות וטרייד‑אופים, והתאמה — המרת תובנות לפתרונות פרקטיים.

מבט קרוב על הניסוי

הקבוצה גייסה 44 סטודנטים מתקדמים לעיצוב והנדסה וזימנה אותם לזוגות של שניים — 22 קבוצות. לכל זוג הוקצו 90 דקות כדי ליצור מוצר חדשני לילדים תוך חשיבה בקול רם. חצי מהצוותים יכלו להשתמש חופשי ב‑LLM (ChatGPT‑4 או מערכת דומה) על מחשב נייד; החצי השני הסתפק בנייר ועפרונות. כל השיחה המדוברת הוקלטה ואז קודדה בקפידה שורה אחר שורה לפי מסגרת 2I2A. כל משפט או חילופי דברים סומנו כשייכים לאחד מארבעת המרחבים ולאחד משמונה סוגי תקשורת מפורטים יותר, כגון קליטת מידע, ניסוח שאלות, הערכת רעיונות או שילוב פתרונות. בנוסף, המשתמשים ב‑LLM השתתפו בראיונות חצי‑מובנים, אשר ניתוחם בעזרת תיאוריית הקרקע חשף נושאים משותפים לגבי תחושות עבודה עם הבינה המלאכותית.

איפה הבינה המלאכותית מסייעת ביותר

הנתונים מראים כי LLMs מחזקים באופן משמעותי את שלבי ההתחלה של החשיבה הקבוצתית. בהשוואה לקבוצות שעבדו ללא בינה מלאכותית, קבוצות בסיוע LLM השקיעו יותר מזמנן שיתופי במרחבי הזיהוי והאינטראקציה. הם שאלו את ה‑LLM עובדות רקע, דוגמאות והשראות, ואז השתמשו בתשובותיו כחומר גלם לעיצוב ולניסוח מחדש של שאלות עיצוב. משמעות הדבר היא שהם זיהו יותר מידע רלוונטי, בחרו וצברו יותר אופציות וארגנו רעיונות בצורה פעילה יותר. הראיונות תומכים בכך: משתתפים רבים אמרו שה‑LLM האיץ את המחקר שלהם, הציע כיוונים שלא שקלו ופעל כ'שותף רעיוני' מהיר שעזר לשבור חסמי יצירתיות. בקצרה, הבינה המלאכותית הרחיבה את הגבולות הקוגניטיביים של הקבוצות ועזרה להגיע במהירות לנקודת התחלה משותפת.

איפה השיפוט האנושי עדיין מוביל

לעומת זאת, ה‑LLM לא שינה באופן מהותי את תדירות המעורבות בהיסק עמוק או בסינתזה סופית. במרחבי הניתוח וההתאמה — שבהם אנשים מעריכים יתרונות וחסרונות, מנהלים משא ומתן על חילוקי דעות ומשלבים רעיונות לעיצוב אחד — קבוצות עם ובלי LLM התנהגו בדומה באופן כללי, ובכמה תחומים המשנה הקבוצות האנושיות היו פעילות יותר. בלא שימוש בבינה מלאכותית, המשתתפים הקדישו יותר זמן להערכת אופציות באופן ביקורתי ולדיון על טרייד‑אופים. משתתפים בראיונות ציינו לעיתים כי הצעות הצ׳אטבוט יכולות להיות שטחיות, לא מדויקות לעיתים ונעימות מדי, ולא נדירות לא להתנגד כמו חבר צוות ביקורתי היה עושה. חלקם הרגישו שהבינה המלאכותית לפעמים 'החליפה' את החשיבה שלהם או דחפה אותם להיצמד לרעיונותיה מדי, דבר שיכול לצמצם במקום להרחיב את מגוון הפתרונות. זה מסביר מדוע, על אף סיעור מוחות פעיל יותר בתחילת התהליך, התוצר היצירתי הסופי לא היה ברור יותר בביצועים כשהשתמשו בבינה מלאכותית.

שינויים בדינמיקות צוות וסיכונים נסתרים

במבט על האופן שבו הצוותים נדדו בין ארבעת מרחבי החשיבה לאורך זמן, החוקרים מצאו שקבוצות בסיוע LLM הפגינו מעברים חלקים ויותר הלוך‑ושוב, במיוחד בין זיהוי מידע לאינטראקציה לארגונו. ה‑AI עודד מחזורים מהירים של שאילת שאלות, קבלת תשובות ועיצוב מחדש של רעיונות, מה שהעניק לשיתוף הפעולה תחושת זריזות. יחד עם זאת גמישות זו באה עם פשרות. כמה משתתפים דיווחו שמעברים תכופים, שמחוזקים על ידי תגובות קלות של ה‑AI, הקשו על האטה לחשיבה מעמיקה יותר. אחרים הביעו דאגה מהסתמכות הולכת וגדלה על הכלי, אובדן שיחה "טבעית" בין בני אדם והצורך לבדוק בשנית תוכן ה‑AI לאיתור שגיאות או הקשר חסר. הראיונות גם הצביעו על אפקטים חברתיים רחבים יותר: ה‑AI עשוי לאוטומט מטלות שגרתיות ולשחרר אנשים למשימות יצירתיות יותר, אך הוא גם עלול לשנות דינמיקות כוח על ידי הענקת השפעה רבה יותר לתפקידים מסוימים — לדוגמה מנהלי מוצר שמנווטים את השימוש ב‑AI — בתוך הצוותים.

מה משמעות הממצאים לשימוש ב‑AI בצוותים אמתיים

לקורא שאינו מומחה, המסר המרכזי פשוט: LLMs טובים מאוד בסיוע לצוותים להתחיל ולהישאר גמישים מנטלית, אך הם אינם קיצור דרך להבנה עמוקה או להחלטות חכמות. כלים אלה פועלים כמאיצים רבי‑עוצמה לאיסוף מידע, חקר רעיונות ובניית תמונה ראשונית משותפת. עם זאת, ניתוח קפדני, בחירות קשות ושילוב מגוון נקודות מבט לתכנון מוצק ועבודה־שמישה עדיין נשענים במידה רבה על מומחיות אנושית, חשיבה ביקורתית ומשא ומתן. המחברים טוענים שעל ארגונים לראות ב‑LLMs כסייעים לשלב ההתחלה במסגרת רחבה יותר של 2I2A — לא כמחליפים לשיחות והשיפוט האנושיים שהופכים בסופו של דבר מוצרים חדשים להצלחה.

ציטוט: Zhang, D., Luo, S., Liu, Y. et al. Large language model tools as catalysts for collective cognition in collaborative new-product development: a quasi-experimental study. Humanit Soc Sci Commun 13, 382 (2026). https://doi.org/10.1057/s41599-026-06738-7

מילות מפתח: מודלים שפתיים גדולים, עיצוב שיתופי, קוגניציה קולקטיבית, פיתוח מוצר חדש, עבודת צוות אדם–בינה מלאכותית