Clear Sky Science · fr

Les outils de grands modèles de langage comme catalyseurs de la cognition collective dans le développement collaboratif de nouveaux produits : une étude quasi-expérimentale

Pourquoi cela compte pour le travail d’équipe quotidien

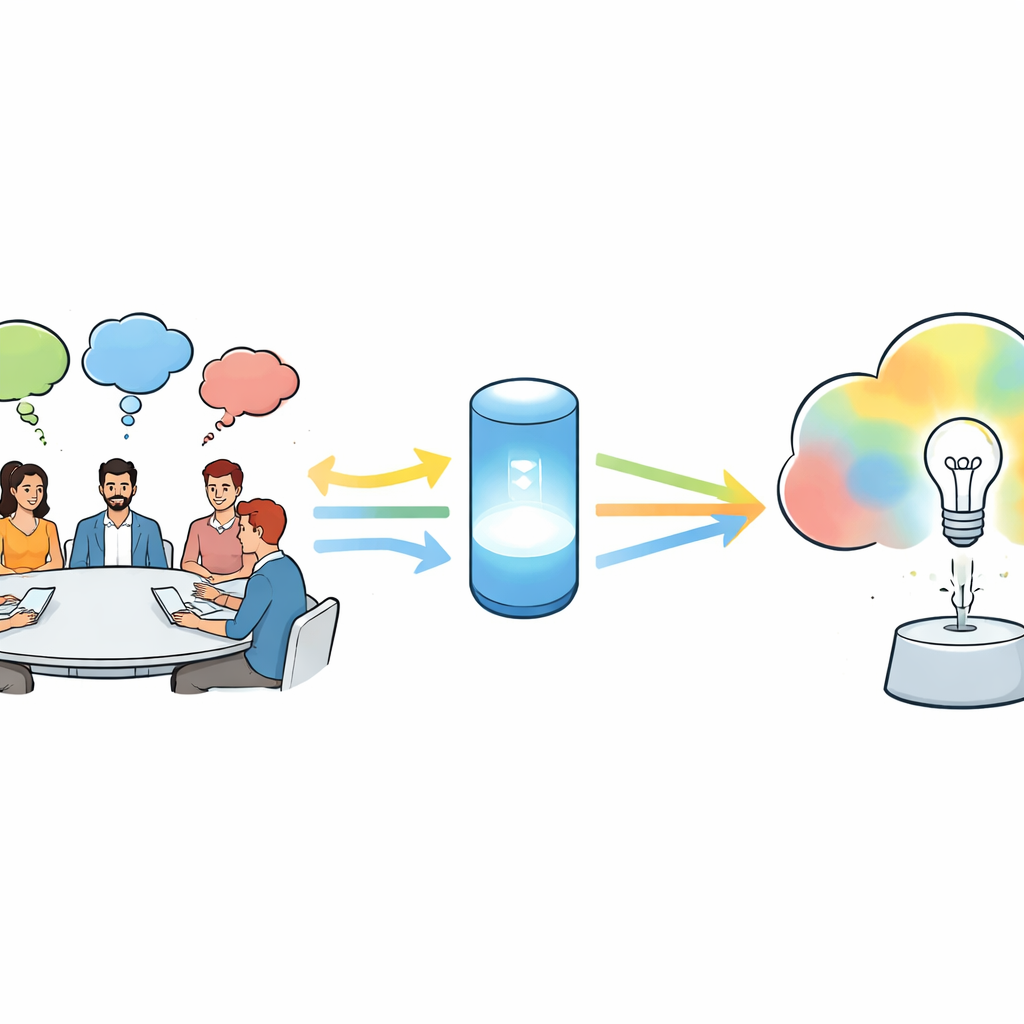

Les équipes modernes — des start-up aux groupes de projets scolaires — se tournent de plus en plus vers des chatbots IA pour les aider à réfléchir, planifier et créer. Pourtant, nous savons étonnamment peu de choses sur la façon dont ces outils modifient réellement la manière dont les personnes travaillent ensemble. Cette étude examine de près comment les grands modèles de langage (GML), comme les chatbots avancés, façonnent la pensée de groupe lorsque des équipes conçoivent de nouveaux produits, et quels domaines restent clairement dominés par le jugement humain.

Comment les équipes pensent normalement ensemble

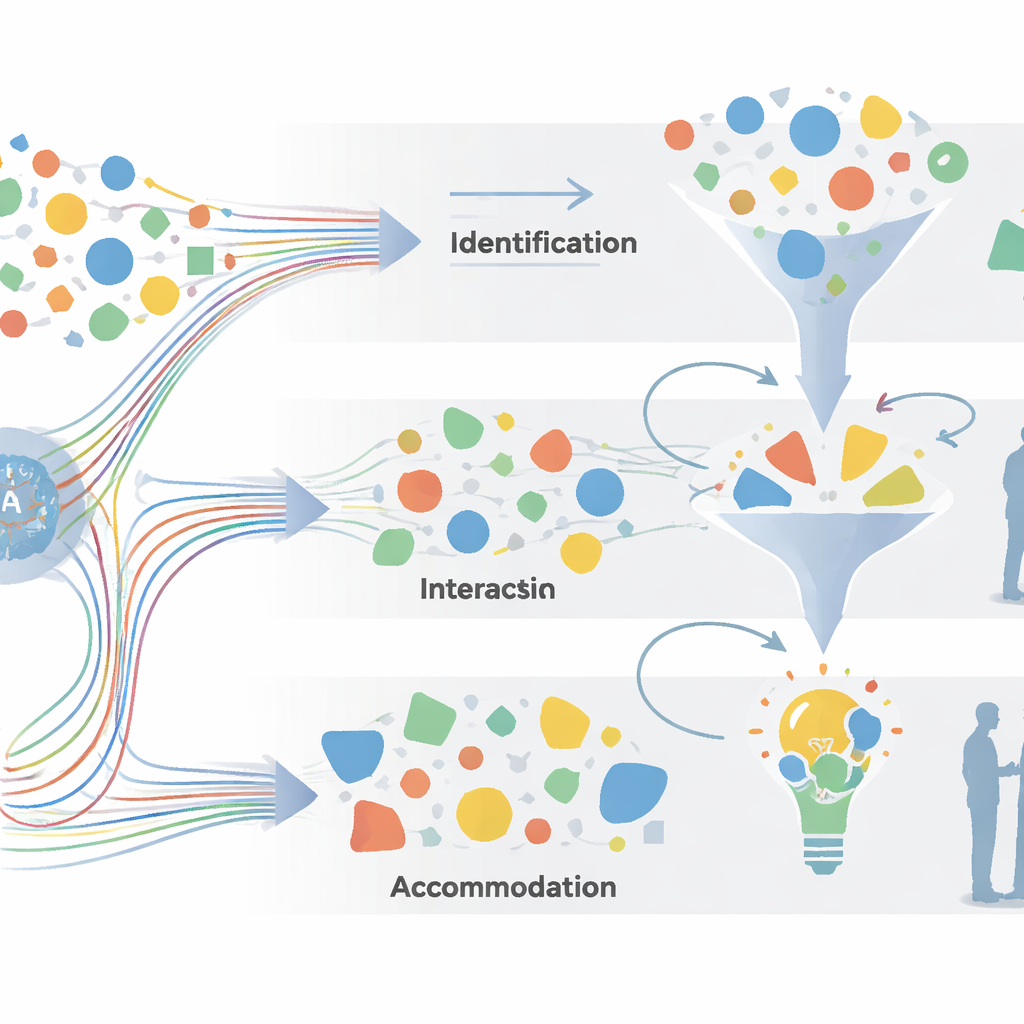

Quand des personnes collaborent sur un nouveau produit, elles font plus que se partager des tâches ; elles construisent progressivement une compréhension commune du problème et des solutions possibles. Les auteurs appellent cela la « cognition collective » — la façon dont les idées et points de vue individuels se fondent en une image mentale partagée. Des recherches antérieures ont montré que cette pensée partagée se développe par des cycles de collecte d’informations, de discussion, d’évaluation d’options et de décision, mais ces cycles étaient souvent décrits de manière générale. Pour étudier les conversations réelles en détail, les chercheurs ont affiné un ancien modèle en ce qu’ils nomment le cadre 2I2A, qui décompose la collaboration en quatre espaces qui se chevauchent : identifier les informations et indices, interagir pour organiser les idées, analyser les options et les compromis, et accommoder, c’est‑à‑dire transformer les idées en solutions opérationnelles.

Un examen plus précis de l’expérience

L’équipe a recruté 44 étudiants avancés en design et en ingénierie et les a formés en 22 binômes. Chaque paire disposait de 90 minutes pour créer un produit innovant destiné aux enfants en pensant à voix haute. La moitié des équipes pouvait utiliser librement un GML (ChatGPT‑4 ou un système similaire) sur un ordinateur portable ; l’autre moitié n’avait que papier et crayons. Toutes les conversations orales ont été enregistrées puis soigneusement codées ligne par ligne selon le modèle 2I2A. Chaque phrase ou échange a été annoté comme appartenant à l’un des quatre espaces et à l’un des huit types de communication plus fins, tels que la collecte d’information, la formulation de questions, l’évaluation d’idées ou la combinaison de solutions. De plus, les participants ayant utilisé le GML ont pris part à des entretiens semi‑structurés, que les chercheurs ont analysés par théorisation ancrée afin de dégager les thèmes récurrents sur la manière dont les personnes perçoivent le travail avec l’IA.

Où l’IA aide le plus

Les données montrent que les GML renforcent fortement les premières étapes de la pensée de groupe. Par rapport aux équipes sans IA, les groupes assistés par GML ont consacré une part plus importante de leur temps de collaboration aux espaces d’Identification et d’Interaction. Ils ont demandé au GML des faits de base, des exemples et des sources d’inspiration, puis utilisé ses réponses comme matière première pour cadrer et recadrer les questions de conception. Ils ont ainsi perçu davantage d’informations pertinentes, sélectionné et accumulé plus d’options et réorganisé les idées de manière plus active. Les entretiens confirment cela : de nombreux participants ont dit que le GML accélérabaient leur recherche, suggérait des directions auxquelles ils n’avaient pas pensé et jouait le rôle d’un « partenaire de concept » rapide aidant à lever les blocages créatifs. En bref, l’IA a élargi les frontières cognitives des équipes et les a aidées à atteindre plus vite un point de départ partagé.

Où le jugement humain reste prépondérant

En revanche, le GML n’a pas modifié de façon significative la fréquence des raisonnements approfondis ou des synthèses finales. Dans les espaces Analyse et Accommodation — où les personnes évaluent les pour et les contre, négocient des divergences et tissent les idées en un design unique — les groupes avec et sans GML se comportaient de façon globalement similaire, et dans certains sous‑domaines, les équipes sans IA étaient plus actives. Sans IA, les collaborateurs passaient plus de temps à évaluer de façon critique les options et à discuter des compromis. Les interviewés ont souvent mentionné que les suggestions du chatbot pouvaient sembler superficielles, parfois inexactes et trop accommodantes, et qu’il rendait rarement la pareille comme le ferait un coéquipier critique. Certains ont estimé que l’IA remplaçait parfois leur propre réflexion ou les incitait à suivre trop fidèlement ses idées, ce qui pouvait réduire, plutôt qu’élargir, l’éventail des solutions. Cela explique en partie pourquoi, malgré un brainstorming initial plus dynamique, le résultat créatif final n’était pas nettement supérieur avec l’IA.

Évolutions de la dynamique d’équipe et risques cachés

En examinant la manière dont les équipes passaient d’un des quatre espaces de pensée à l’autre au fil du temps, les chercheurs ont constaté que les groupes assistés par GML présentaient des transitions plus fluides et itératives, surtout entre l’identification des informations et l’interaction pour les structurer. L’IA a encouragé des cycles rapides de questionnement, de réception et de reformulation des idées, donnant à la collaboration une allure plus agile. Pourtant, cette souplesse impliquait des compromis. Certains participants ont rapporté que les changements fréquents, facilités par des réponses IA faciles d’accès, rendaient plus difficile la prise de recul nécessaire à une réflexion plus profonde. D’autres s’inquiétaient d’une dépendance croissante à l’outil, de la perte de discussions « naturelles » entre humains et de la nécessité de vérifier les contenus générés par l’IA pour repérer erreurs ou contextes manquants. Les entretiens ont aussi indiqué des effets sociaux plus larges : l’IA pourrait automatiser les tâches routinières et libérer du temps pour des tâches créatives, mais elle pourrait aussi modifier les rapports de pouvoir en donnant plus d’influence à certains rôles — par exemple les chefs de produit qui pilotent l’utilisation de l’IA — au sein des équipes.

Que signifie l’usage de l’IA pour des équipes réelles

Pour un non‑spécialiste, le message central est simple : les GML sont très efficaces pour aider les équipes à démarrer et à rester mentalement flexibles, mais ils ne sont pas un raccourci vers une compréhension profonde ou des décisions avisées. Ces outils agissent comme d puissants accélérateurs pour la collecte d’informations, l’exploration d’idées et la construction d’une image partagée initiale. Toutefois, l’analyse soigneuse, les choix difficiles et la fusion de multiples points de vue en un design solide et opérationnel reposent encore largement sur l’expertise humaine, la pensée critique et la négociation. Les auteurs soutiennent que les organisations devraient considérer les GML comme des aides de réflexion en phase initiale, intégrées dans une vision 2I2A plus large de la collaboration — et non comme des substituts aux conversations et aux jugements humains qui font finalement réussir les nouveaux produits.

Citation: Zhang, D., Luo, S., Liu, Y. et al. Large language model tools as catalysts for collective cognition in collaborative new-product development: a quasi-experimental study. Humanit Soc Sci Commun 13, 382 (2026). https://doi.org/10.1057/s41599-026-06738-7

Mots-clés: grands modèles de langage, conception collaborative, cognition collective, développement de nouveaux produits, travail d’équipe humain–IA