Clear Sky Science · es

Herramientas basadas en modelos de lenguaje grande como catalizadores de la cognición colectiva en el desarrollo colaborativo de nuevos productos: un estudio cuasi-experimental

Por qué esto importa para el trabajo en equipo cotidiano

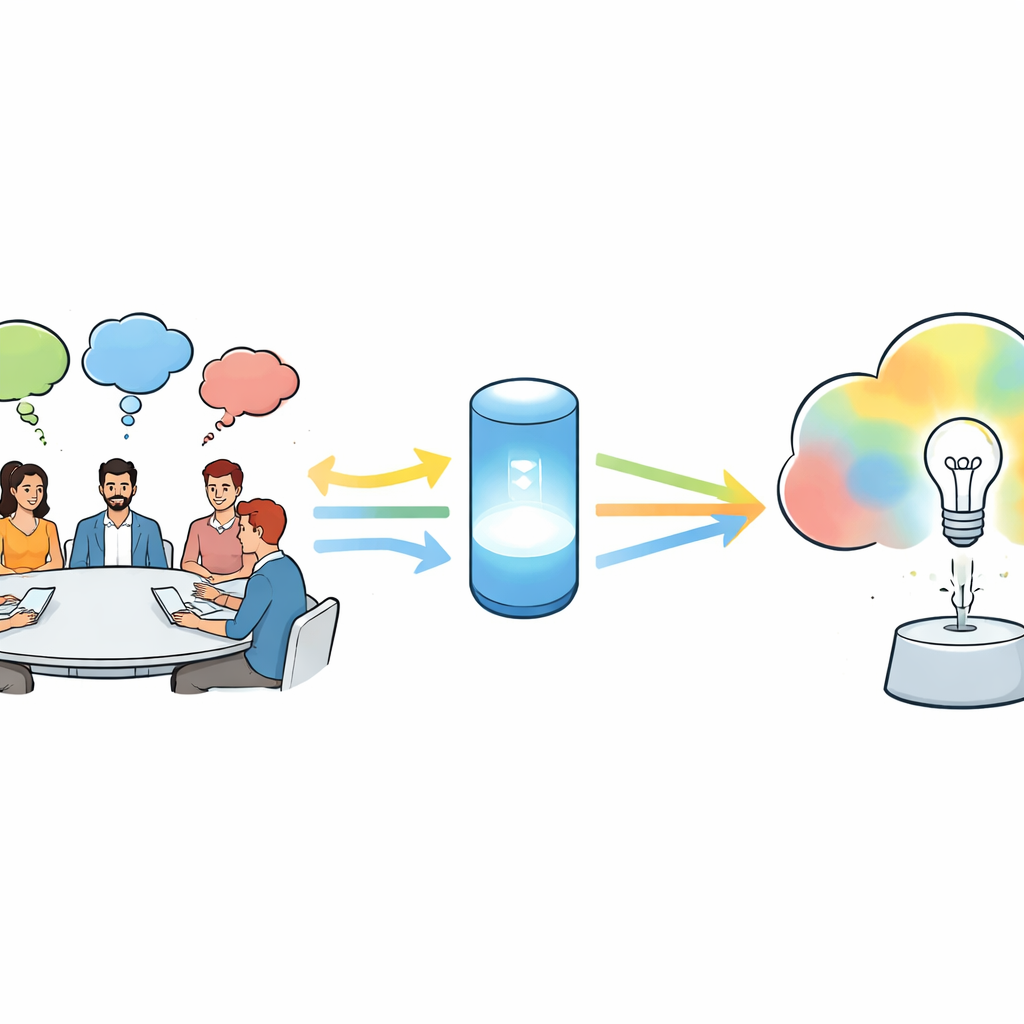

Los equipos modernos —desde startups hasta grupos de proyectos escolares— recurren cada vez más a chatbots de IA para ayudarles a pensar, planificar y crear. Pero sabemos sorprendentemente poco sobre cómo estas herramientas cambian realmente la forma en que las personas trabajan juntas. Este estudio examina de cerca cómo los grandes modelos de lenguaje (LLM), como chatbots avanzados, moldean el pensamiento grupal cuando los equipos diseñan nuevos productos, y en qué aspectos el juicio humano todavía supera claramente a la IA.

Cómo suelen pensar los equipos juntos

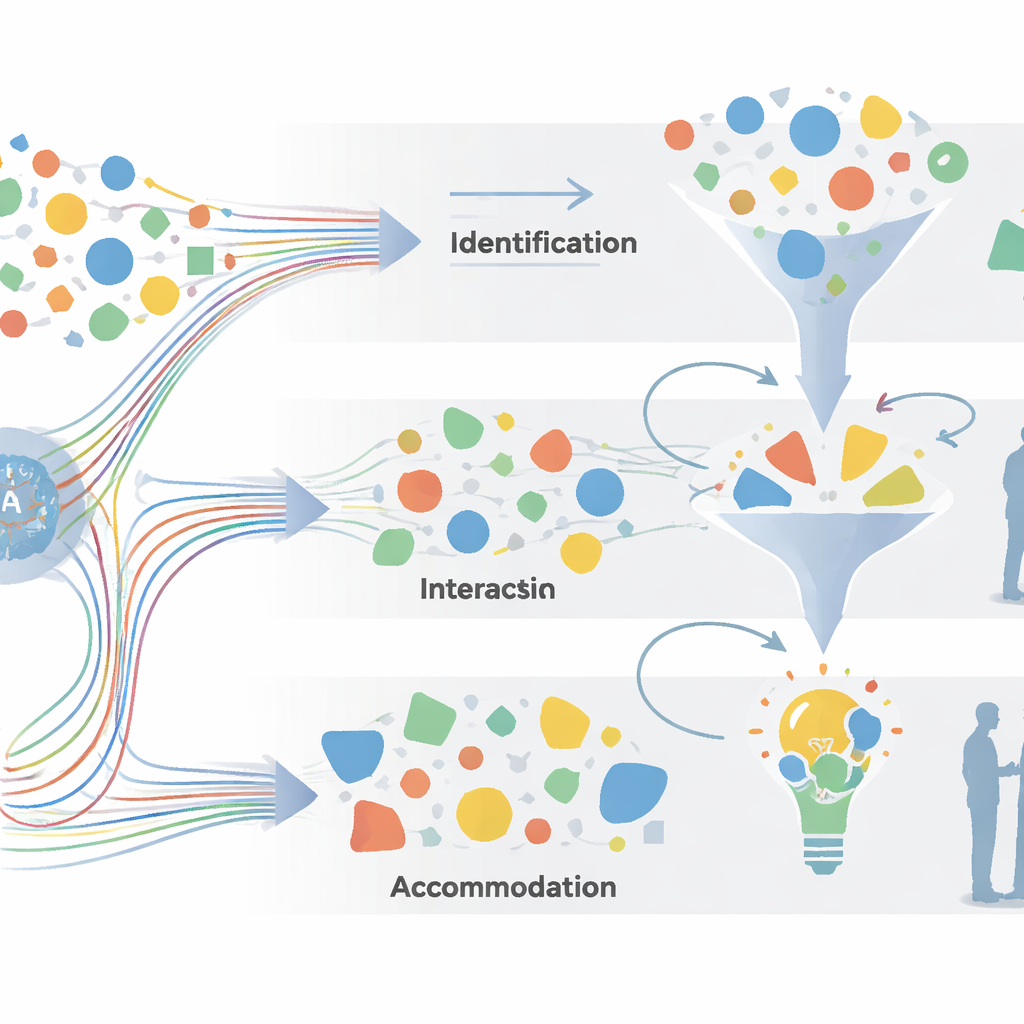

Cuando las personas colaboran en un nuevo producto, hacen más que repartir tareas; van construyendo lentamente una comprensión compartida del problema y de las posibles soluciones. Los autores llaman a esto «cognición colectiva»: la manera en que las ideas y puntos de vista individuales se integran en una imagen mental común. Investigaciones previas mostraron que este pensamiento compartido se desarrolla mediante ciclos de recopilación de información, discusión, ponderación de opciones y decisión sobre soluciones, pero esos ciclos a menudo se describían de forma general. Para estudiar conversaciones reales en detalle, los investigadores refinaron un modelo anterior en lo que denominan el marco 2I2A, que divide la colaboración en cuatro espacios superpuestos: identificar información y señales, interactuar para organizar ideas, analizar opciones y compensaciones, y acomodar, es decir, transformar los conocimientos en soluciones viables.

Un vistazo más cercano al experimento

El equipo reclutó a 44 estudiantes avanzados de diseño e ingeniería y los emparejó en 22 grupos de dos personas. Cada pareja tuvo 90 minutos para crear un producto innovador para niños mientras pensaba en voz alta. La mitad de los equipos pudo usar libremente un LLM (ChatGPT‑4 o un sistema similar) en un portátil; la otra mitad solo contó con papel y lápices. Todas las conversaciones habladas se grabaron y luego se codificaron cuidadosamente línea por línea según el modelo 2I2A. Cada frase o intercambio se etiquetó como perteneciente a uno de los cuatro espacios y a uno de ocho tipos de comunicación más detallados, como tomar información, estructurar preguntas, evaluar ideas o combinar soluciones. Además, los participantes que usaron el LLM participaron en entrevistas semiestructuradas que los investigadores analizaron con teoría fundamentada para descubrir temas comunes sobre cómo se sentían al trabajar con IA.

Dónde la IA ayuda más

Los datos muestran que los LLM impulsan con fuerza las primeras etapas del pensamiento grupal. En comparación con los equipos que trabajaron sin IA, los grupos asistidos por LLM pasaron más tiempo de colaboración en los espacios de Identificación e Interacción. Consultaron al LLM por hechos de contexto, ejemplos e inspiración, y luego usaron sus respuestas como materia prima para enmarcar y reencuadrar preguntas de diseño. Esto significó que percibieron más información relevante, seleccionaron y acumularon más opciones y reorganizaron ideas con mayor actividad. Las entrevistas confirman esto: muchos participantes dijeron que el LLM aceleró su investigación, sugirió direcciones que no habían considerado y actuó como un «socio conceptual» rápido que les ayudó a superar bloqueos creativos. En resumen, la IA amplió los límites cognitivos del equipo y les ayudó a alcanzar un punto de partida compartido más rápido.

Dónde el juicio humano sigue liderando

En contraste, el LLM no cambió de forma significativa la frecuencia con la que los equipos se involucraron en razonamientos más profundos o en la síntesis final. En los espacios de Análisis y Acomodación —donde las personas evalúan pros y contras, negocian diferencias y tejen ideas en un diseño único— los grupos con y sin LLM se comportaron de manera similar en general, y en algunas subáreas los equipos sin IA fueron más activos. Sin IA, los colaboradores dedicaron más tiempo a evaluar críticamente las opciones y a debatir compensaciones. En las entrevistas se mencionó a menudo que las sugerencias del chatbot podían ser superficiales, ocasionalmente inexactas y demasiado conformes, y raramente hacían de contrapeso crítico como lo haría un compañero humano. Algunos sintieron que la IA a veces «reemplazaba» su propio pensamiento o los empujaba a seguir demasiado sus ideas, lo que podía estrechar, en lugar de ampliar, el abanico de soluciones. Esto ayuda a explicar por qué, a pesar de sesiones de generación de ideas más dinámicas en etapas tempranas, el resultado creativo final no fue claramente superior con IA.

Desplazamientos en la dinámica de equipo y riesgos ocultos

Al observar cómo los equipos se movían entre los cuatro espacios de pensamiento a lo largo del tiempo, los investigadores encontraron que los grupos asistidos por LLM mostraron transiciones más fluidas y de ida y vuelta, especialmente entre la identificación de información y la interacción para estructurarla. La IA fomentó ciclos rápidos de preguntar, recibir y remodelar ideas, dando a la colaboración un carácter más ágil. Sin embargo, esta flexibilidad tuvo costes. Algunos participantes informaron que los cambios frecuentes, impulsados por respuestas fáciles de la IA, dificultaron la pausa para una reflexión más profunda. Otros temieron una creciente dependencia de la herramienta, la pérdida de la discusión «natural» entre personas y la necesidad de verificar la información de la IA por errores o falta de contexto. Las entrevistas también señalaron efectos sociales más amplios: la IA podría automatizar tareas rutinarias y liberar a las personas para labores más creativas, pero también podría alterar las dinámicas de poder al dar más influencia dentro del equipo a ciertos roles —por ejemplo, a los gestores de producto que dirigen el uso de la IA—.

Qué significa esto para usar IA en equipos reales

Para un público no especializado, el mensaje central es sencillo: los LLM son muy buenos ayudando a los equipos a empezar y a mantener flexibilidad mental, pero no son un atajo hacia una comprensión profunda o decisiones sabias. Estas herramientas actúan como aceleradores potentes para reunir información, explorar ideas y construir una imagen compartida inicial. Sin embargo, el análisis cuidadoso, las decisiones difíciles y la integración de múltiples puntos de vista en un diseño sólido y viable siguen dependiendo en gran medida de la experiencia humana, el pensamiento crítico y la negociación. Los autores sostienen que las organizaciones deberían tratar los LLM como ayudas para las etapas iniciales del pensamiento dentro de una perspectiva 2I2A de la colaboración —no como sustitutos de las conversaciones y los juicios humanos que, en última instancia, hacen que los nuevos productos tengan éxito.

Cita: Zhang, D., Luo, S., Liu, Y. et al. Large language model tools as catalysts for collective cognition in collaborative new-product development: a quasi-experimental study. Humanit Soc Sci Commun 13, 382 (2026). https://doi.org/10.1057/s41599-026-06738-7

Palabras clave: modelos de lenguaje grande, diseño colaborativo, cognición colectiva, desarrollo de nuevos productos, trabajo en equipo humano–IA