Clear Sky Science · pt

ClinicRealm: Reavaliando grandes modelos de linguagem com aprendizado de máquina convencional para tarefas clínicas preditivas não-gerativas

Por que previsões hospitalares mais inteligentes importam

Cada dia, hospitais colecionam enormes quantidades de informação digital sobre seus pacientes, desde notas rápidas de médicos até longas listas de resultados laboratoriais e sinais vitais. Ocultos nesses dados estão indícios sobre quem tem mais probabilidade de melhorar, quem pode voltar ao hospital em breve e quem está em risco sério. Escolher o tipo certo de inteligência artificial (IA) para ler esses indícios deixou de ser apenas uma questão técnica — pode influenciar a rapidez e a justiça com que os pacientes recebem ajuda. Este estudo coloca uma pergunta oportuna: os poderosos sistemas de IA no formato de chat de hoje, conhecidos como grandes modelos de linguagem, podem realmente rivalizar ou superar os algoritmos cuidadosamente ajustados que há muito são o esteio da predição médica?

Novos testes para novos tipos de IA médica

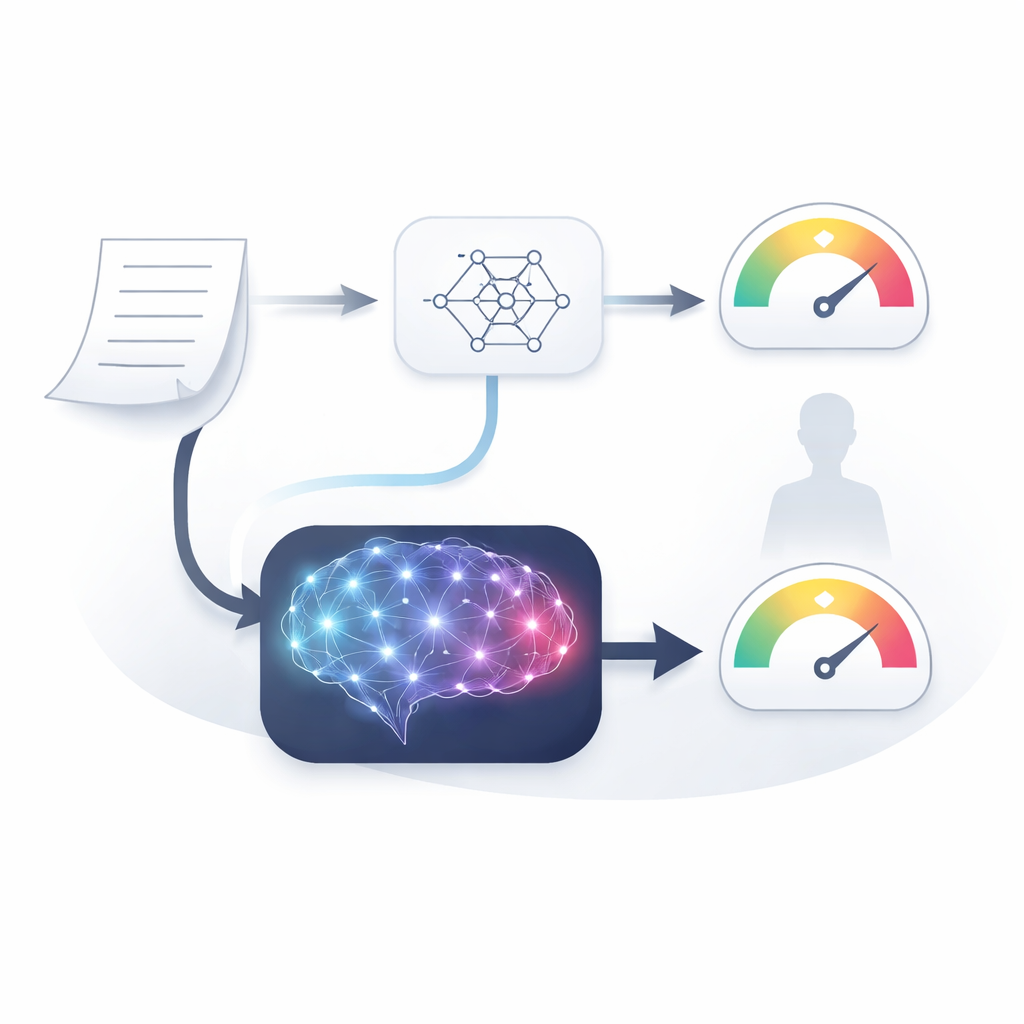

Os pesquisadores construíram um amplo benchmark que chamam ClinicRealm para comparar lado a lado três famílias de modelos: sistemas tradicionais de aprendizado de máquina e deep learning, modelos textuais anteriores e os modernos grandes modelos de linguagem. Eles avaliaram essas ferramentas em dois tipos principais de dados hospitalares. Um é texto não estruturado, como notas de admissão e alta escritas em linguagem clínica do dia a dia. O outro são tabelas estruturadas de prontuários eletrônicos, compostas por números como valores de exames e sinais vitais com carimbo de tempo. A equipe focou em questões práticas que interessam aos hospitais, incluindo se um paciente morreria durante a internação, seria readmitido em 30 dias ou quanto tempo poderia permanecer no hospital.

Quando palavras vencem números na predição

Surgiu um padrão marcante para tarefas baseadas nas notas de médicos e enfermeiros. Por anos, pensou-se que modelos de texto especializados, ajustados em registros médicos, eram a melhor escolha para predizer desfechos a partir dessas notas. Ainda assim, o ClinicRealm mostra que os mais recentes grandes modelos de linguagem, usados em “zero-shot” sem qualquer treinamento extra nos dados hospitalares, agora superam esses sistemas especializados por uma margem ampla. Tanto em previsões prospectivas de risco quanto em classificação de documentos a posteriori, modelos avançados como variantes do GPT-5 e DeepSeek alcançaram precisão muito alta. Isso significa que simplesmente fornecer-lhes texto clínico bruto e pedir uma predição pode funcionar melhor do que meses de ajuste minucioso de abordagens antigas. Notavelmente, vários modelos de código aberto equipararam-se ou até superaram o desempenho de modelos proprietários, tornando ferramentas robustas mais acessíveis a hospitais que precisam manter os dados internamente.

Números ainda favorecem ferramentas clássicas — mas nem sempre

A história é mais matizada para prontuários eletrônicos estruturados. Aqui, modelos tradicionais cuidadosamente treinados e sistemas especializados de deep learning ainda se destacam quando podem aprender a partir de grandes quantidades de dados. Eles são particularmente bons em identificar padrões em fluxos de valores laboratoriais e sinais vitais ao longo do tempo. Entretanto, quando há apenas um número pequeno de exemplos de pacientes — como frequentemente ocorre em doenças raras ou novos surtos — os modelos de linguagem modernos mostram força surpreendente. Em alguns testes, um grande modelo de linguagem, trabalhando a partir de um prompt bem projetado e de um punhado de exemplos, igualou ou superou modelos convencionais treinados nos mesmos dados limitados. Tentativas de simplesmente despejar ao mesmo tempo tabelas e texto dentro de modelos de linguagem não melhoraram automaticamente o desempenho, revelando que combinar múltiplas fontes de dados ainda é um problema de design delicado, e não um ganho garantido.

Espiando o raciocínio médico da IA

Como confiar cegamente em uma pontuação de risco é inseguro, a equipe também pediu a cinco clínicos que avaliassem as explicações que os modelos de linguagem produziram junto com suas previsões. No geral, os especialistas acharam essas narrativas razoavelmente precisas, completas e clinicamente úteis, especialmente quando os modelos trabalharam a partir de notas narrativas ricas. Ainda assim, fraquezas importantes apareceram. Em alguns falsos positivos, os modelos justificaram alto risco inventando ou interpretando mal detalhes no registro. Em casos de risco não detectado, frequentemente reconheciam achados relevantes mas falhavam em ponderá-los adequadamente, refletindo julgamento raso em vez de simples erros de extração de dados. Mesmo quando as previsões estavam corretas, traços de raciocínio falho permaneciam, ressaltando que a precisão por si só não garante suporte clínico confiável.

Equidade, limites e o que vem a seguir

Os pesquisadores também exploraram equidade por idade, sexo e raça. De modo encorajador, modelos de linguagem de ponta, cuidadosamente solicitados em modo zero-shot, frequentemente mostraram desempenho mais equilibrado entre grupos do que alguns sistemas tradicionais fortemente treinados, que podiam amplificar vieses existentes nos dados. Ainda assim, ajustar modelos para tarefas específicas às vezes reintroduzia disparidades, e nenhum método foi perfeitamente justo. Os autores enfatizam que qualquer implantação deve incluir checagens de viés rotineiras, desenho robusto de prompts e salvaguardas para confiabilidade, não apenas alta precisão em um único conjunto de teste.

O que isso significa para o cuidado hospitalar futuro

O ClinicRealm conclui que os modernos grandes modelos de linguagem não são mais apenas assistentes verborrágicos; amadureceram a ponto de serem concorrentes sérios para predizer desfechos de pacientes, especialmente a partir de notas escritas e em cenários com poucos dados. Sistemas clássicos de aprendizado de máquina ainda brilham quando há abundância de informação estruturada e tempo para treiná-los, mas a lacuna está diminuindo. Para hospitais e tecnólogos em saúde, isso significa migrar de escolhas únicas para um conjunto de ferramentas mais nuançado: usar modelos tradicionais onde ainda são os melhores, confiar em grandes modelos de linguagem para texto livre e arranque rápido, e combinar ambos com atenção cuidadosa à qualidade do raciocínio e à equidade. Feito com prudência, essa estratégia equilibrada pode tornar a análise preditiva mais poderosa, mais amplamente disponível e, em última instância, mais favorável a um cuidado mais seguro e personalizado.

Citação: Zhu, Y., Gao, J., Wang, Z. et al. ClinicRealm: Re-evaluating large language models with conventional machine learning for non-generative clinical prediction tasks. npj Digit. Med. 9, 319 (2026). https://doi.org/10.1038/s41746-026-02539-z

Palavras-chave: previsão clínica, prontuários eletrônicos, grandes modelos de linguagem, avaliação de IA médica, equidade na saúde