Clear Sky Science · pl

ClinicRealm: Ponowna ocena dużych modeli językowych przy użyciu konwencjonalnego uczenia maszynowego dla niegeneratywnych zadań predykcyjnych w klinice

Dlaczego lepsze prognozy szpitalne mają znaczenie

Codziennie szpitale gromadzą ogromne ilości cyfrowych informacji o pacjentach — od krótkich notatek lekarzy po długie zestawienia wyników badań i parametrów życiowych. Ukryte w tych danych są wskazówki o tym, kto prawdopodobnie wyzdrowieje, kto może wrócić do szpitala wkrótce i kto jest w poważnym ryzyku. Wybór odpowiedniego rodzaju sztucznej inteligencji (AI) do odczytywania tych wskazówek to już nie tylko pytanie techniczne — wpływa na to, jak szybko i sprawiedliwie pacjenci otrzymują pomoc. W badaniu zadano aktualne pytanie: czy dzisiejsze potężne systemy czatowe, znane jako duże modele językowe, faktycznie mogą konkurować z dopracowanymi algorytmami, które od dawna służą do medycznych predykcji?

Nowe testy dla nowych typów medycznej AI

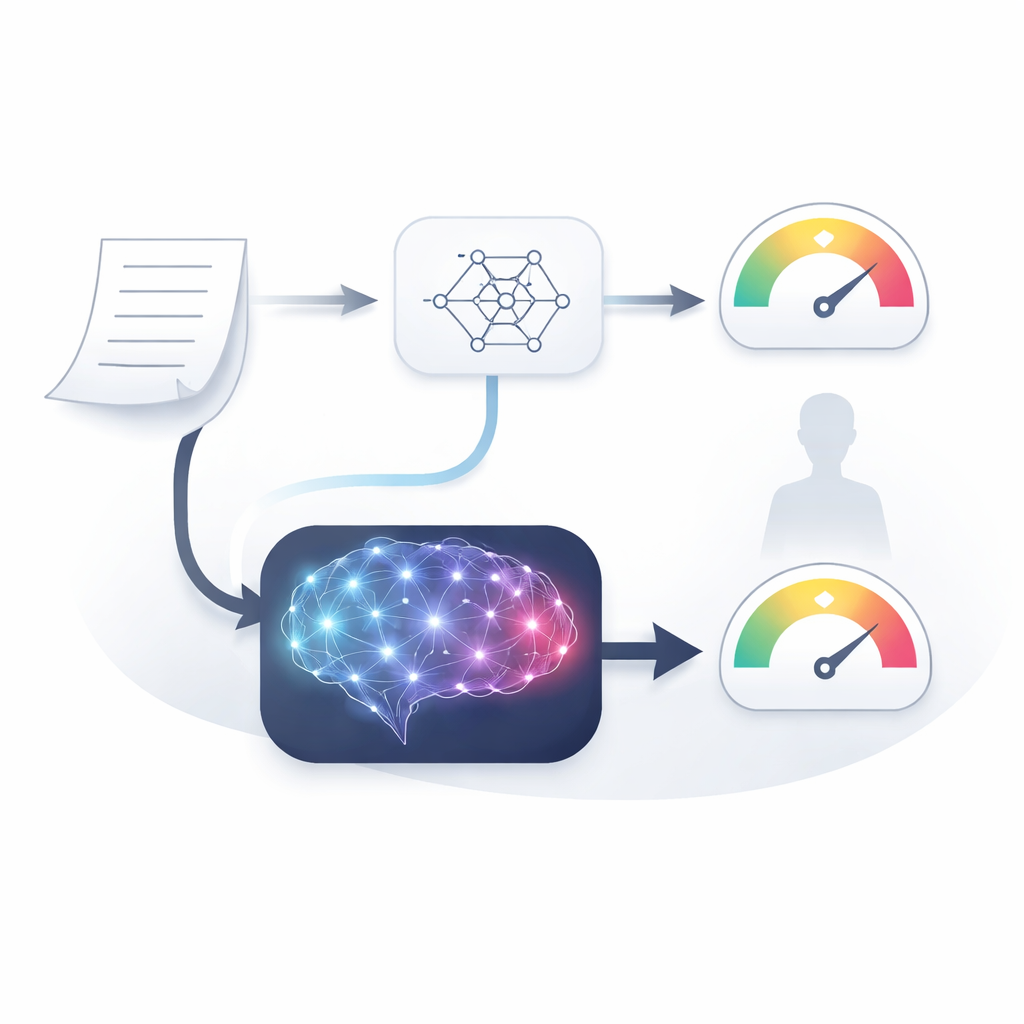

Naukowcy zbudowali szeroki benchmark, który nazwali ClinicRealm, aby porównać trzy rodziny modeli obok siebie: tradycyjne systemy uczenia maszynowego i głębokiego uczenia, wcześniejsze modele skoncentrowane na tekście oraz nowoczesne duże modele językowe. Oceniili te narzędzia na dwóch głównych typach danych szpitalnych. Pierwsze to nieustrukturyzowany tekst, taki jak notatki przy przyjęciu i wypisie pisane codziennym językiem klinicznym. Drugie to ustrukturyzowane tabele elektronicznych rekordów zdrowotnych, składające się z liczb, jak wyniki badań laboratoryjnych i sygnowane czasowo parametry życiowe. Zespół skupił się na praktycznych pytaniach istotnych dla szpitali, w tym czy pacjent umrze podczas pobytu, czy zostanie ponownie przyjęty w ciągu 30 dni oraz jak długo może pozostać w szpitalu.

Kiedy słowa przewyższają liczby w predykcji

Pojawił się uderzający wzorzec w zadaniach opartych na notatkach lekarzy i pielęgniarek. Przez lata uważano, że wyspecjalizowane modele tekstowe dostrojone na rekordach medycznych są najlepszym wyborem do przewidywania wyników na podstawie takich notatek. Jednak ClinicRealm pokazuje, że najnowsze duże modele językowe, używane „zero-shot” bez dodatkowego treningu na danych szpitalnych, teraz przewyższają te wyspecjalizowane systemy z dużą przewagą. Zarówno w prognozach perspektywicznych dotyczących ryzyka, jak i w klasyfikacji dokumentów po fakcie, zaawansowane modele, takie jak warianty GPT-5 i DeepSeek, osiągały bardzo wysoką dokładność. Oznacza to, że samo podanie im surowego tekstu klinicznego i poproszenie o prognozę może działać lepiej niż miesiące żmudnego dostrajania starszych metod. Co istotne, kilka modeli open-source dorównało lub nawet przewyższyło wyniki modeli komercyjnych, co sprawia, że silne narzędzia są bardziej dostępne dla szpitali, które muszą przechowywać dane wewnętrznie.

Liczby wciąż premiują klasyczne narzędzia — ale nie zawsze

Obraz jest bardziej zniuansowany w przypadku ustrukturyzowanych elektronicznych rekordów zdrowotnych. Tutaj starannie trenowane tradycyjne modele i wyspecjalizowane systemy głębokiego uczenia nadal wychodzą na prowadzenie, gdy mogą uczyć się z dużych ilości danych. Są szczególnie dobre w wykrywaniu wzorców w strumieniach wyników badań i parametrów życiowych w czasie. Jednak gdy dostępna jest tylko niewielka liczba przykładów pacjentów — jak często ma to miejsce przy rzadkich chorobach lub nowych ogniskach — nowoczesne modele językowe wykazują zaskakującą siłę. W niektórych testach duży model językowy działający na sprytnie zaprojektowanym promptcie i kilku przykładach dorównywał lub pokonywał konwencjonalne modele trenowane na tych samych ograniczonych danych. Próby jednoczesnego wlewania tabel i tekstu do modeli językowych nie poprawiały automatycznie wydajności, co ujawnia, że łączenie wielu źródeł danych wciąż jest delikatnym problemem projektowym, a nie darmowym przyrostem jakości.

Zajrzeć do medycznego rozumowania AI

Ponieważ ślepe zaufanie do wyniku ryzyka jest niebezpieczne, zespół poprosił też pięciu klinicystów o ocenę wyjaśnień, które modele językowe generowały obok swoich prognoz. Ogólnie rzecz biorąc, eksperci uznali te narracje za stosunkowo dokładne, kompletne i klinicznie użyteczne, zwłaszcza gdy modele pracowały na bogatych notatkach narracyjnych. Jednak pojawiły się istotne słabości. W niektórych fałszywych alarmach modele uzasadniały wysokie ryzyko przez zmyślanie lub błędne odczytanie szczegółów z dokumentacji. W przypadkach przegapionego ryzyka często rozpoznawały istotne ustalenia, ale nie potrafiły ich właściwie zważyć, co odzwierciedla płytkie rozumowanie, a nie proste błędy ekstrakcji danych. Nawet gdy prognozy były poprawne, ślady błędnego rozumowania pozostawały, podkreślając, że sama dokładność nie gwarantuje niezawodnego wsparcia klinicznego.

Sprawiedliwość, ograniczenia i co dalej

Naukowcy zbadali także sprawiedliwość względem wieku, płci i rasy. Co zachęcające, nowoczesne modele językowe w trybie zero-shot z dobrze zaprojektowanymi promptami często wykazywały bardziej zrównoważone wyniki między grupami niż niektóre mocno trenowane systemy tradycyjne, które mogły wzmacniać istniejące uprzedzenia w danych. Jednak strojenie modeli do konkretnych zadań czasami ponownie wprowadzało dysproporcje i żadna metoda nie była idealnie sprawiedliwa. Autorzy podkreślają, że każde wdrożenie powinno obejmować rutynowe kontrole uprzedzeń, solidne projektowanie promptów i zabezpieczenia dla niezawodności, a nie opierać się tylko na wysokiej dokładności na jednym zbiorze testowym.

Co to oznacza dla przyszłej opieki szpitalnej

ClinicRealm podsumowuje, że nowoczesne duże modele językowe przestały być jedynie rozmownymi asystentami; wyewoluowały w poważnych konkurentów do przewidywania wyników pacjentów, szczególnie na podstawie zapisanych notatek i w warunkach z ograniczoną ilością danych. Klasyczne systemy uczenia maszynowego wciąż błyszczą, gdy jest dużo ustrukturyzowanych informacji i czasu na ich trening, ale różnica się zmniejsza. Dla szpitali i specjalistów technologii zdrowotnej oznacza to odejście od rozwiązań uniwersalnych na rzecz bardziej zniuansowanego zestawu narzędzi: stosowania tradycyjnych modeli tam, gdzie są najlepsze, polegania na dużych modelach językowych dla tekstu swobodnego i szybkiego startu oraz łączenia obu podejść z dbałością o jakość rozumowania i sprawiedliwość. Zrobione rozważnie, takie zrównoważone podejście może uczynić analitykę predykcyjną potężniejszą, szerzej dostępną i ostatecznie bardziej wspierającą bezpieczniejszą, spersonalizowaną opiekę.

Cytowanie: Zhu, Y., Gao, J., Wang, Z. et al. ClinicRealm: Re-evaluating large language models with conventional machine learning for non-generative clinical prediction tasks. npj Digit. Med. 9, 319 (2026). https://doi.org/10.1038/s41746-026-02539-z

Słowa kluczowe: predykcja kliniczna, elektroniczne rekordy zdrowotne, duże modele językowe, benchmarking AI w medycynie, sprawiedliwość w opiece zdrowotnej