Clear Sky Science · nl

ClinicRealm: Het opnieuw evalueren van grote taalmodellen met conventionele machine learning voor niet-generatieve klinische voorspeltaakjes

Waarom slimmer voorspellen in ziekenhuizen ertoe doet

Elke dag verzamelen ziekenhuizen enorme hoeveelheden digitale informatie over hun patiënten, van korte doktersnotities tot lange lijsten met laboratoriumuitslagen en vitale functies. Verborgen in deze gegevens zitten aanwijzingen over wie waarschijnlijk zal herstellen, wie snel weer terug naar het ziekenhuis kan gaan en wie ernstig risico loopt. De keuze van de juiste vorm van kunstmatige intelligentie (AI) om deze aanwijzingen te lezen is niet langer alleen een technische kwestie — het kan bepalen hoe snel en eerlijk patiënten hulp krijgen. Deze studie stelt een actuele vraag: kunnen de huidige krachtige chat‑achtige AI‑systemen, bekend als grote taalmodellen, daadwerkelijk concurreren met of beter presteren dan de zorgvuldig afgestemde algoritmen die lang de ruggengraat van medische voorspellingen waren?

Nieuwe testen voor nieuwe typen medische AI

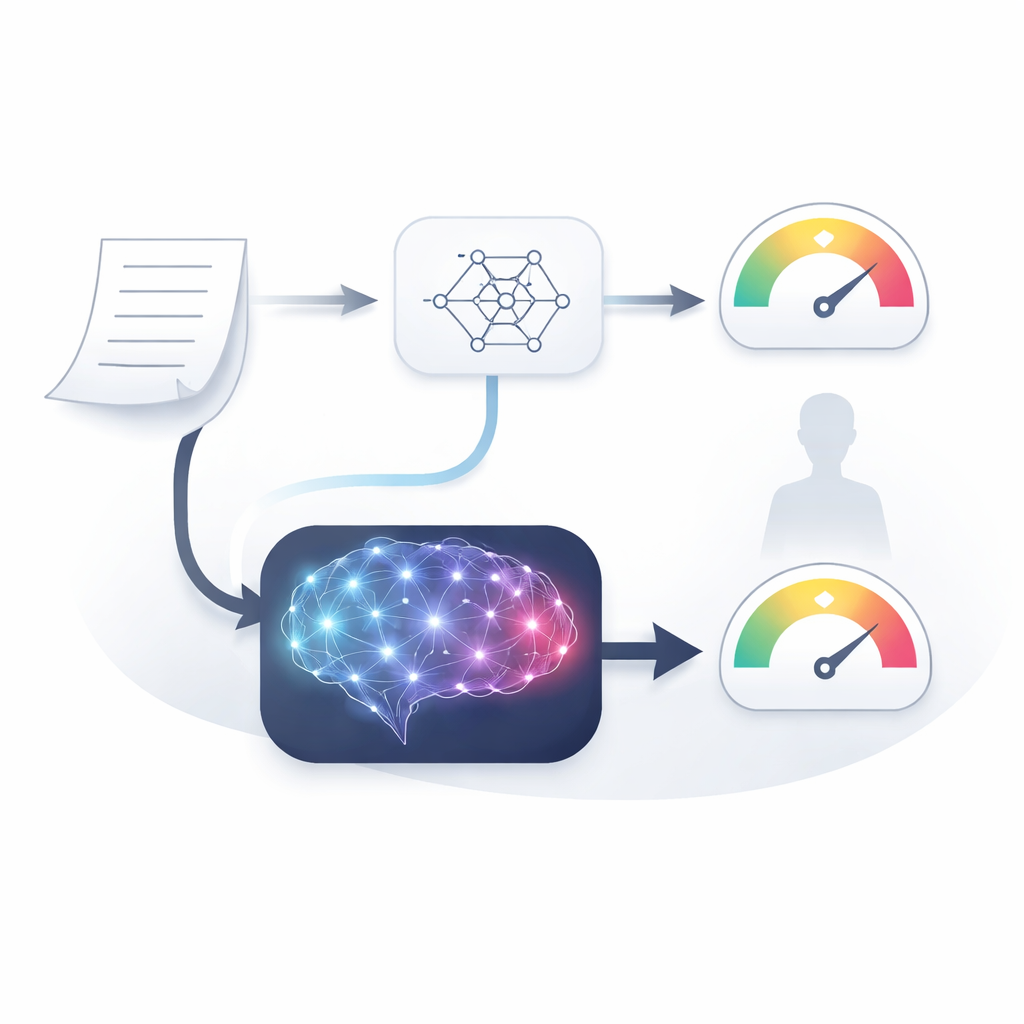

De onderzoekers bouwden een breed benchmark dat ze ClinicRealm noemen om drie families modellen naast elkaar te vergelijken: traditionele machine‑learning en deep‑learning systemen, eerdere op tekst gerichte modellen, en moderne grote taalmodellen. Ze evalueerden deze hulpmiddelen op twee hoofdtypen ziekenhuisgegevens. Het ene is ongestructureerde tekst, zoals opname‑ en ontslagnotities geschreven in alledaagse klinische taal. Het andere zijn gestructureerde elektronische patiëntendossier‑tabellen, bestaande uit cijfers zoals laboratoriumwaarden en tijdstempels van vitale functies. Het team richtte zich op praktische vragen die van belang zijn voor ziekenhuizen, waaronder of een patiënt tijdens het verblijf zal overlijden, binnen 30 dagen wordt heropgenomen, of hoe lang iemand in het ziekenhuis zou kunnen blijven.

Wanneer woorden beter voorspellen dan cijfers

Een opvallend patroon kwam naar voren bij taken die gebaseerd zijn op de notities van artsen en verpleegkundigen. Jarenlang werden gespecialiseerde tekstmodellen, getuned op medische dossiers, gezien als de beste keuze om uitkomsten uit zulke notities te voorspellen. ClinicRealm laat echter zien dat de nieuwste grote taalmodellen, gebruikt in “zero‑shot” modus zonder extra training op ziekenhuisdata, deze gespecialiseerde systemen nu met ruime voorsprong overtreffen. Zowel bij vooruitziende risicovoorspellingen als bij achteraf documentclassificatie bereikten geavanceerde modellen zoals varianten van GPT‑5 en DeepSeek zeer hoge nauwkeurigheid. Dat betekent dat het simpelweg voeden van ruwe klinische tekst en vragen om een voorspelling beter kan werken dan maandenlang nauwgezet finetunen van oudere benaderingen. Opmerkelijk genoeg evenaarden of overtroffen meerdere open‑source modellen de prestaties van propriëtaire modellen, waardoor krachtige hulpmiddelen toegankelijker worden voor ziekenhuizen die gegevens intern moeten houden.

Cijfers belonen nog steeds klassieke tools—maar niet altijd

Het verhaal is genuanceerder voor gestructureerde elektronische patiëntendossiers. Hier presteren zorgvuldig getrainde traditionele modellen en gespecialiseerde deep‑learning systemen nog steeds het beste wanneer ze kunnen leren van grote hoeveelheden data. Ze zijn bijzonder goed in het herkennen van patronen in reeksen laboratoriumwaarden en vitale functies in de tijd. Echter, wanneer slechts een klein aantal patiëntvoorbeelden beschikbaar is — zoals vaak het geval is bij zeldzame ziekten of nieuwe uitbraken — tonen moderne taalmodellen verrassende sterkte. In sommige tests wist een groot taalmodel, werkend met een slim ontworpen prompt en een handvol voorbeelden, gelijk te trekken met of beter te presteren dan conventionele modellen die op dezelfde beperkte data waren getraind. Pogingen om tabellen en tekst tegelijk in taalmodellen te stoppen, verbeterden de prestaties niet automatisch, wat laat zien dat het combineren van meerdere databronnen nog steeds een delicaat ontwerpvraagstuk is en geen gratis verbetering.

Een blik in het medische redeneren van de AI

Aangezien blinde vertrouwen in een risico‑score onveilig is, vroegen de onderzoekers ook vijf clinici om de verklaringen te beoordelen die taalmodellen naast hun voorspellingen produceerden. Over het geheel genomen vonden de experts deze verklarende teksten redelijk accuraat, volledig en klinisch nuttig, vooral wanneer modellen werkten met rijke narratieve notities. Toch kwamen er belangrijke zwaktes naar voren. Bij sommige valse alarmen rechtvaardigden modellen een hoog risico door details in het dossier te verzinnen of verkeerd te lezen. Bij gemiste risicoschattingen herkenten ze vaak relevante bevindingen maar wogen die niet goed, wat duidt op oppervlakkig oordeel in plaats van loutere data‑extractiefouten. Zelfs wanneer voorspellingen correct waren, bleven sporen van gebrekkig redeneren zichtbaar, wat benadrukt dat nauwkeurigheid alleen geen betrouwbare klinische ondersteuning garandeert.

Eerlijkheid, grenzen en wat volgt

De onderzoekers onderzochten ook eerlijkheid over leeftijd, geslacht en ras. Bemoedigend was dat state‑of‑the‑art taalmodellen, zorgvuldig geprompt in zero‑shot modus, vaak meer gebalanceerde prestaties over groepen lieten zien dan sommige zwaar getrainde traditionele systemen, die bestaande databiases kunnen versterken. Toch herintroduceerde het tunen van modellen voor specifieke taken soms weer ongelijkheden, en geen enkele methode bleek perfect eerlijk. De auteurs benadrukken dat elke inzet routinecontroles op bias, robuust promptontwerp en waarborgen voor betrouwbaarheid moet bevatten — niet alleen hoge nauwkeurigheid op één testset.

Wat dit betekent voor toekomstige ziekenhuiszorg

ClinicRealm concludeert dat moderne grote taalmodellen niet langer alleen praatzieke assistenten zijn; ze zijn volwassen geworden tot serieuze kanshebbers voor het voorspellen van patiëntuitkomsten, vooral uit geschreven notities en in situaties met weinig data. Klassieke machine‑learning systemen blijven uitblinken wanneer er veel gestructureerde informatie is en tijd om ze te trainen, maar het verschil wordt kleiner. Voor ziekenhuizen en gezondheidstechnologen betekent dit dat men moet afstappen van one‑size‑fits‑all keuzes en kiezen voor een genuanceerdere gereedschapskist: traditionele modellen gebruiken waar ze het beste blijven, vertrouwen op grote taalmodellen voor vrije tekst en snelle opstart, en beide combineren met zorg voor de kwaliteit van het redeneren en eerlijkheid. Doordacht toegepast kan deze gebalanceerde strategie voorspellende analytics krachtiger, breder beschikbaar en uiteindelijk meer ondersteunend maken voor veiligere, meer gepersonaliseerde zorg.

Bronvermelding: Zhu, Y., Gao, J., Wang, Z. et al. ClinicRealm: Re-evaluating large language models with conventional machine learning for non-generative clinical prediction tasks. npj Digit. Med. 9, 319 (2026). https://doi.org/10.1038/s41746-026-02539-z

Trefwoorden: klinische voorspelling, elektronische patiëntendossiers, grote taalmodellen, medische AI-benchmarking, eerlijkheid in de gezondheidszorg