Clear Sky Science · it

ClinicRealm: Rivalutare i grandi modelli linguistici con il machine learning convenzionale per compiti clinici predittivi non generativi

Perché contano previsioni ospedaliere più intelligenti

Ogni giorno gli ospedali raccolgono enormi quantità di informazioni digitali sui pazienti, da brevi note dei medici a lunghe liste di risultati di laboratorio e segnali vitali. In questi dati sono nascosti indizi su chi è probabile che migliori, chi potrebbe tornare presto in ospedale e chi è a rischio serio. Scegliere il giusto tipo di intelligenza artificiale (IA) per leggere questi indizi non è più una questione puramente tecnica: può influenzare la rapidità e l’equità con cui i pazienti ricevono assistenza. Questo studio pone una domanda attuale: i potenti sistemi di IA in stile chat di oggi, noti come grandi modelli linguistici, possono davvero rivaleggiare o superare gli algoritmi accuratamente ottimizzati che da tempo sono i cavalli di battaglia della predizione medica?

Nuovi test per nuovi tipi di IA medica

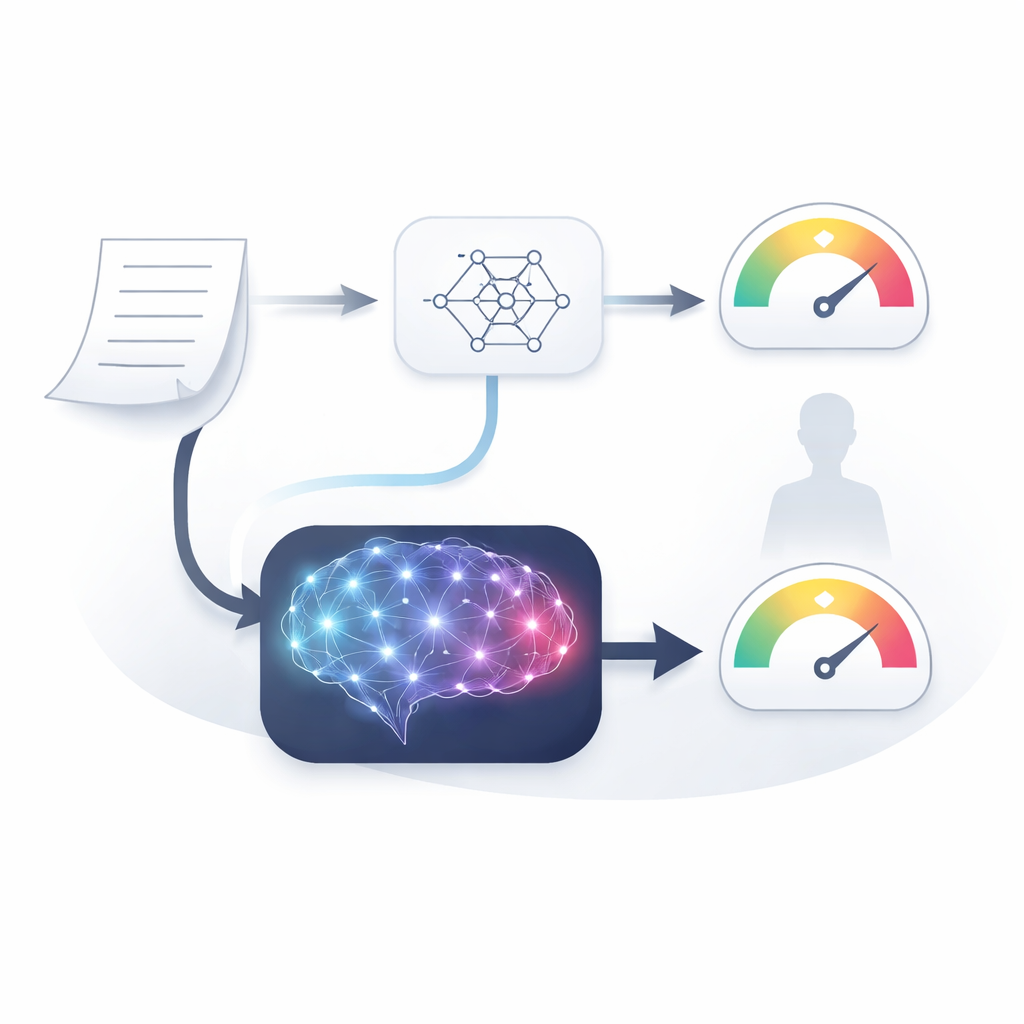

I ricercatori hanno costruito un ampio benchmark che chiamano ClinicRealm per confrontare fianco a fianco tre famiglie di modelli: sistemi tradizionali di machine learning e deep learning, modelli testuali più vecchi e i moderni grandi modelli linguistici. Hanno valutato questi strumenti su due principali tipi di dati ospedalieri. Uno è il testo non strutturato, come le note di ammissione e dimissione scritte in linguaggio clinico quotidiano. L’altro sono le tabelle strutturate della cartella clinica elettronica, composte da numeri come valori di laboratorio e segni vitali con marcature temporali. Il team si è concentrato su domande pratiche che contano per gli ospedali, tra cui se un paziente morirà durante il ricovero, se sarà riamesso entro 30 giorni o quanto potrà rimanere in ospedale.

Quando le parole battono i numeri nella predizione

È emerso un pattern sorprendente per i compiti basati sulle note di medici e infermieri. Per anni si è ritenuto che modelli testuali specializzati e adattati su cartelle cliniche fossero la scelta migliore per prevedere esiti da tali note. ClinicRealm mostra però che gli ultimi grandi modelli linguistici, usati in modalità “zero-shot” senza alcun addestramento aggiuntivo sui dati ospedalieri, ora superano questi sistemi specializzati di gran lunga. Sia nelle predizioni di rischio prospettiche sia nelle classificazioni documentali a posteriori, modelli avanzati come varianti di GPT-5 e DeepSeek hanno raggiunto un’accuratezza molto elevata. Ciò significa che fornire loro semplicemente testo clinico grezzo e chiedere una previsione può funzionare meglio di mesi di meticoloso fine-tuning dei metodi più vecchi. Notevolmente, diversi modelli open-source hanno eguagliato o addirittura superato le prestazioni di modelli proprietari, rendendo strumenti potenti più accessibili agli ospedali che devono mantenere i dati in locale.

I numeri premiano ancora gli strumenti classici—ma non sempre

La storia è più sfumata per le cartelle cliniche elettroniche strutturate. Qui, modelli tradizionali attentamente addestrati e sistemi di deep learning specializzati restano in vantaggio quando possono imparare da grandi quantità di dati. Sono particolarmente bravi a riconoscere pattern in flussi di valori di laboratorio e segni vitali nel tempo. Tuttavia, quando è disponibile solo un piccolo numero di esempi di pazienti—come spesso accade per malattie rare o nuovi focolai—i moderni modelli linguistici mostrano una forza sorprendente. In alcuni test, un grande modello linguistico che lavorava con un prompt ben progettato e una manciata di esempi ha eguagliato o battuto modelli convenzionali addestrati sugli stessi dati limitati. I tentativi di introdurre simultaneamente tabelle e testo nei modelli linguistici non hanno automaticamente migliorato le prestazioni, rivelando che combinare più fonti di dati resta un problema di progettazione delicato piuttosto che un guadagno garantito.

Uno sguardo dentro il ragionamento medico dell’IA

Poiché una fiducia cieca in un punteggio di rischio è pericolosa, il team ha anche chiesto a cinque clinici di valutare le spiegazioni che i modelli linguistici hanno prodotto insieme alle loro predizioni. Nel complesso, gli esperti hanno trovato queste narrazioni ragionevolmente accurate, complete e clinicamente utili, soprattutto quando i modelli lavoravano su note narrative ricche. Tuttavia sono emerse debolezze importanti. In alcuni falsi allarmi, i modelli hanno giustificato un alto rischio inventando o interpretando male dettagli nel documento. Nei casi di rischio non rilevato, spesso riconoscevano reperti rilevanti ma non li pesavano correttamente, riflettendo un giudizio superficiale più che semplici errori di estrazione dei dati. Anche quando le predizioni erano corrette, rimanevano tracce di ragionamento difettoso, sottolineando che l’accuratezza da sola non garantisce un supporto clinico affidabile.

Equità, limiti e cosa verrà dopo

I ricercatori hanno esplorato anche l’equità per età, sesso e razza. In modo incoraggiante, i modelli linguistici all’avanguardia, attentamente promptati in modalità zero-shot, spesso hanno mostrato prestazioni più bilanciate tra i gruppi rispetto ad alcuni sistemi tradizionali fortemente addestrati, che potevano amplificare bias presenti nei dati. Tuttavia l’ottimizzazione dei modelli per compiti specifici a volte reintroduceva disparità, e nessun metodo è risultato perfettamente equo. Gli autori sottolineano che qualsiasi implementazione dovrebbe includere controlli routinari dei bias, una progettazione robusta dei prompt e salvaguardie per l’affidabilità, non solo un’elevata accuratezza su un singolo set di test.

Cosa significa per la cura ospedaliera futura

ClinicRealm conclude che i moderni grandi modelli linguistici non sono più soltanto assistenti loquaci; si sono evoluti in contendenti seri per la predizione degli esiti dei pazienti, specialmente a partire da note scritte e in contesti con pochi dati. I sistemi classici di machine learning restano superiori quando sono disponibili ampie informazioni strutturate e tempo per addestrarli, ma il divario si sta riducendo. Per ospedali e tecnologi della salute, questo implica l’abbandono di scelte uniche per tutti a favore di un kit di strumenti più sfumato: usare modelli tradizionali dove sono ancora i migliori, affidarsi ai grandi modelli linguistici per testo libero e avviamenti rapidi, e combinare entrambi prestando attenzione alla qualità del ragionamento e all’equità. Fatto con cura, questa strategia bilanciata potrebbe rendere l’analisi predittiva più potente, più accessibile e in ultima istanza più di supporto a cure più sicure e personalizzate.

Citazione: Zhu, Y., Gao, J., Wang, Z. et al. ClinicRealm: Re-evaluating large language models with conventional machine learning for non-generative clinical prediction tasks. npj Digit. Med. 9, 319 (2026). https://doi.org/10.1038/s41746-026-02539-z

Parole chiave: predizione clinica, cartelle cliniche elettroniche, grandi modelli linguistici, benchmarking dell'IA medica, equità nelle cure sanitarie