Clear Sky Science · es

ClinicRealm: Re-evaluando los modelos de lenguaje grandes con aprendizaje automático convencional para tareas clínicas no generativas de predicción

Por qué importan predicciones hospitalarias más inteligentes

Cada día, los hospitales recopilan enormes cantidades de información digital sobre sus pacientes, desde breves notas médicas hasta largas listas de resultados de laboratorio y signos vitales. Ocultas en estos datos hay pistas sobre quién probablemente mejorará, quién podría volver al hospital pronto y quién corre un riesgo serio. Elegir el tipo correcto de inteligencia artificial (IA) para leer estas pistas ya no es solo una cuestión técnica: puede influir en la rapidez y la equidad con que los pacientes reciben ayuda. Este estudio plantea una pregunta oportuna: ¿pueden los potentes sistemas de IA estilo chat de hoy, conocidos como modelos de lenguaje grandes, rivalizar o incluso superar a los algoritmos cuidadosamente diseñados que durante mucho tiempo han sido los pilares de la predicción médica?

Nuevas pruebas para nuevos tipos de IA médica

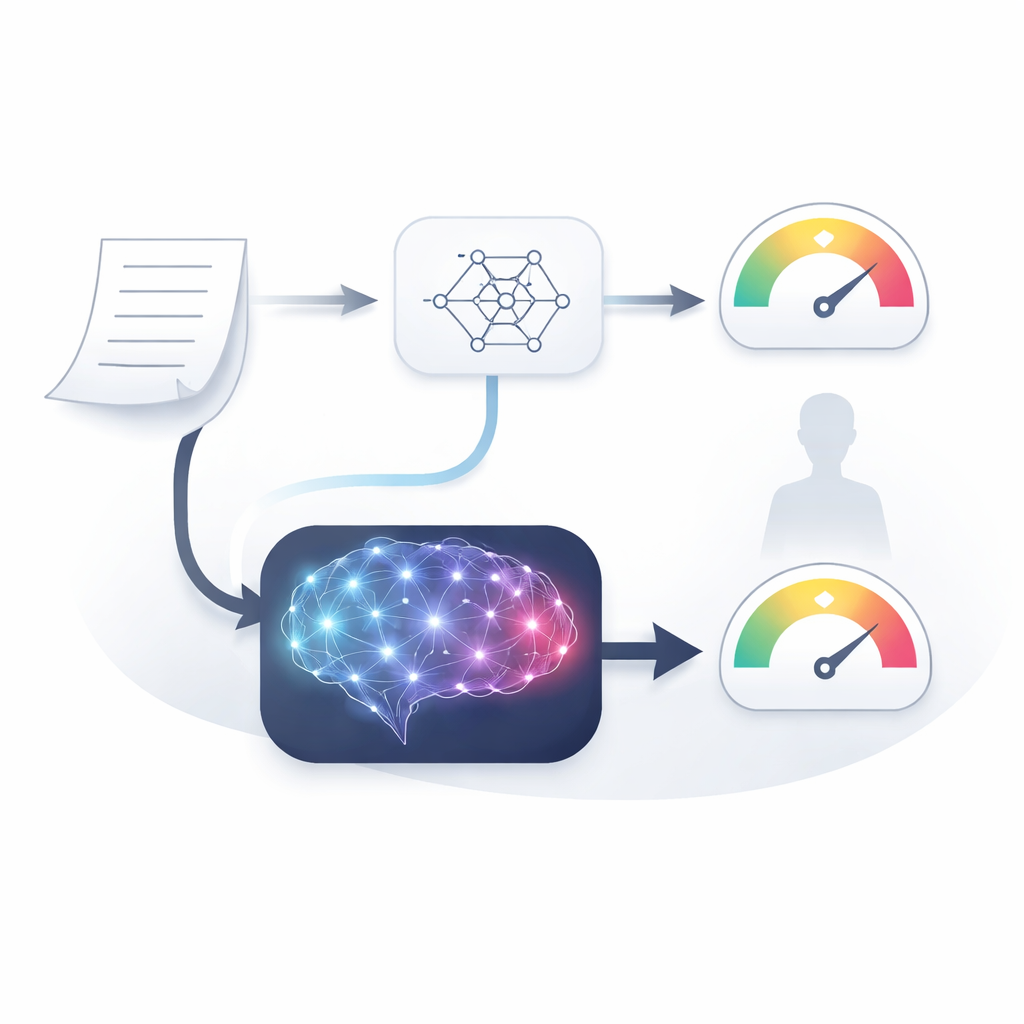

Los investigadores construyeron un amplio benchmark que llaman ClinicRealm para comparar lado a lado tres familias de modelos: sistemas tradicionales de aprendizaje automático y profundo, modelos textuales anteriores y los modernos modelos de lenguaje grandes. Evaluaron estas herramientas en dos tipos principales de datos hospitalarios. Uno es texto no estructurado, como notas de ingreso y alta escritas en lenguaje clínico cotidiano. El otro son tablas estructuradas de la historia clínica electrónica, compuestas por números como valores de laboratorio y signos vitales con marcas temporales. El equipo se centró en preguntas prácticas que importan a los hospitales, incluyendo si un paciente moriría durante su estancia, si sería reingresado en 30 días o cuánto tiempo podría permanecer en el hospital.

Cuando las palabras vencen a los números en la predicción

Surgió un patrón llamativo para las tareas basadas en notas de médicos y enfermeras. Durante años se pensó que los modelos textuales especializados ajustados con registros médicos eran la mejor opción para predecir resultados a partir de tales notas. Sin embargo, ClinicRealm muestra que los últimos modelos de lenguaje grandes, usados en “zero-shot” sin entrenamiento adicional con los datos del hospital, ahora superan ampliamente a esos sistemas especializados. Tanto en predicciones de riesgo prospectivas como en clasificación de documentos a posteriori, modelos avanzados como variantes de GPT-5 y DeepSeek alcanzaron una alta precisión. Esto significa que simplemente suministrarles texto clínico en bruto y pedir una predicción puede funcionar mejor que meses de ajuste fino de enfoques más antiguos. De forma notable, varios modelos de código abierto igualaron o incluso superaron el rendimiento de los propietarios, haciendo herramientas potentes más accesibles a hospitales que deben mantener los datos internamente.

Los números aún favorecen las herramientas clásicas—pero no siempre

La historia es más matizada para las historias clínicas electrónicas estructuradas. Aquí, los modelos tradicionales cuidadosamente entrenados y los sistemas especializados de aprendizaje profundo siguen siendo los mejores cuando pueden aprender de grandes cantidades de datos. Son particularmente buenos para detectar patrones en series temporales de valores de laboratorio y signos vitales. Sin embargo, cuando solo hay un pequeño número de ejemplos de pacientes—como suele ocurrir en enfermedades raras o en brotes nuevos—los modelos de lenguaje modernos muestran una fuerza sorprendente. En algunas pruebas, un modelo de lenguaje grande trabajando con un prompt bien diseñado y unos pocos ejemplos igualó o superó a los modelos convencionales entrenados con los mismos datos limitados. Los intentos de verter tablas y texto en los modelos de lenguaje simultáneamente no mejoraron automáticamente el rendimiento, lo que revela que combinar múltiples fuentes de datos sigue siendo un problema de diseño delicado en vez de una mejora automática.

Una mirada al razonamiento médico de la IA

Dado que la confianza ciega en una puntuación de riesgo es insegura, el equipo también pidió a cinco clínicos que valoraran las explicaciones que los modelos de lenguaje produjeron junto a sus predicciones. En general, los expertos consideraron que estas narrativas eran razonablemente precisas, completas y clínicamente útiles, especialmente cuando los modelos trabajaban a partir de notas narrativas ricas. Aun así, aparecieron debilidades importantes. En algunas falsas alarmas, los modelos justificaron un riesgo elevado inventando o interpretando mal detalles del registro. En los casos de riesgo no detectado, a menudo reconocían hallazgos relevantes pero no los ponderaban correctamente, reflejando un juicio superficial más que simples errores de extracción de datos. Incluso cuando las predicciones eran correctas, permanecían rastros de razonamiento defectuoso, lo que subraya que la precisión por sí sola no garantiza un apoyo clínico fiable.

Equidad, límites y lo que sigue

Los investigadores también exploraron la equidad según edad, sexo y raza. De manera alentadora, los modelos de lenguaje de última generación, cuidadosamente solicitados en modo zero-shot, a menudo mostraron un rendimiento más equilibrado entre grupos que algunos sistemas tradicionales fuertemente entrenados, que podían amplificar sesgos existentes en los datos. Sin embargo, ajustar modelos para tareas específicas a veces reintroducía disparidades, y ningún método resultó perfectamente justo. Los autores enfatizan que cualquier despliegue debería incluir controles rutinarios de sesgo, un diseño robusto de prompts y salvaguardias para la fiabilidad, no solo alta precisión en un único conjunto de prueba.

Qué significa esto para la atención hospitalaria futura

ClinicRealm concluye que los modelos de lenguaje grandes modernos ya no son solo asistentes charlatanes; se han convertido en contendientes serios para predecir resultados de pacientes, especialmente a partir de notas escritas y en entornos con pocos datos. Los sistemas clásicos de aprendizaje automático siguen destacando cuando hay abundante información estructurada y tiempo para entrenarlos, pero la brecha se está estrechando. Para hospitales y tecnólogos de la salud, esto significa alejarse de elecciones únicas para todos hacia una caja de herramientas más matizada: usar modelos tradicionales donde sigan siendo los mejores, confiar en modelos de lenguaje grandes para texto libre y arranque rápido, y combinar ambos con atención cuidadosa a la calidad del razonamiento y la equidad. Hecho con criterio, esta estrategia equilibrada podría hacer la analítica predictiva más poderosa, más accesible y, en última instancia, más favorable a una atención más segura y personalizada.

Cita: Zhu, Y., Gao, J., Wang, Z. et al. ClinicRealm: Re-evaluating large language models with conventional machine learning for non-generative clinical prediction tasks. npj Digit. Med. 9, 319 (2026). https://doi.org/10.1038/s41746-026-02539-z

Palabras clave: predicción clínica, historias clínicas electrónicas, modelos de lenguaje grandes, evaluación de IA médica, equidad en salud