Clear Sky Science · fr

ClinicRealm : réévaluer les grands modèles de langage avec l’apprentissage automatique conventionnel pour des tâches cliniques non génératives de prédiction

Pourquoi des prédictions hospitalières plus intelligentes comptent

Chaque jour, les hôpitaux recueillent d’immenses quantités d’informations numériques sur leurs patients, des notes brèves des médecins à de longues litanies de résultats de laboratoire et de constantes vitales. Cachés dans ces données se trouvent des indices sur qui est susceptible de s’améliorer, qui pourrait revenir à l’hôpital bientôt, et qui est en danger grave. Choisir le bon type d’intelligence artificielle (IA) pour lire ces indices n’est plus une question purement technique : cela peut influencer la rapidité et l’équité avec lesquelles les patients reçoivent de l’aide. Cette étude pose une question d’actualité : les puissants systèmes de type conversationnel d’aujourd’hui, appelés grands modèles de langage, peuvent-ils réellement rivaliser ou surpasser les algorithmes soigneusement adaptés qui ont longtemps été les chevaux de bataille de la prédiction médicale ?

Nouveaux tests pour de nouveaux types d’IA médicale

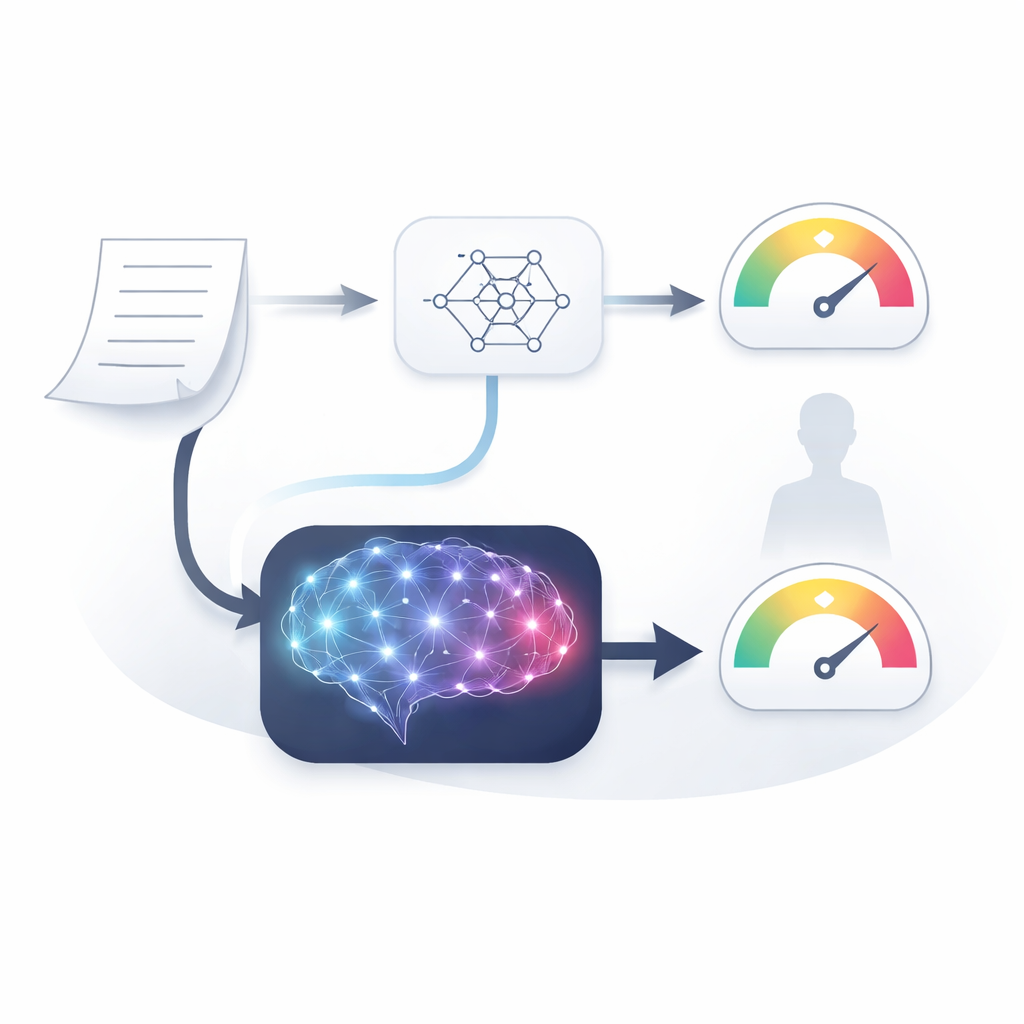

Les chercheurs ont construit une large référence qu’ils appellent ClinicRealm pour comparer côte à côte trois familles de modèles : les systèmes traditionnels d’apprentissage automatique et profond, les modèles textuels plus anciens, et les grands modèles de langage modernes. Ils ont évalué ces outils sur deux principaux types de données hospitalières. L’un est le texte non structuré, comme les notes d’admission et de sortie rédigées dans le langage clinique courant. L’autre est constitué de tableaux structurés des dossiers médicaux électroniques, composés de nombres tels que les valeurs de laboratoire et des constantes vitales horodatées. L’équipe s’est concentrée sur des questions pratiques qui comptent pour les hôpitaux, notamment : le patient décédera-t-il durant son séjour, sera-t-il réadmis dans les 30 jours, ou combien de temps pourrait-il rester à l’hôpital ?

Quand les mots battent les nombres en prédiction

Un constat frappant est apparu pour les tâches basées sur les notes des médecins et des infirmières. Pendant des années, on a supposé que des modèles textuels spécialisés, entraînés sur des dossiers médicaux, étaient le meilleur choix pour prédire des résultats à partir de ces textes. Pourtant, ClinicRealm montre que les derniers grands modèles de langage, utilisés en « zero-shot » sans entraînement supplémentaire sur les données hospitalières, surpassent désormais largement ces systèmes spécialisés. Tant pour les prédictions prospectives de risque que pour la classification a posteriori de documents, des modèles avancés comme des variantes de GPT-5 et DeepSeek ont atteint une très grande précision. Cela signifie que le simple fait de leur fournir du texte clinique brut et de demander une prédiction peut fonctionner mieux que des mois de réglages laborieux des approches plus anciennes. Remarquablement, plusieurs modèles open source ont égalé voire dépassé les performances de solutions propriétaires, rendant des outils puissants plus accessibles aux hôpitaux qui doivent conserver leurs données en interne.

Les nombres récompensent encore les outils classiques—mais pas toujours

L’histoire est plus nuancée pour les dossiers médicaux électroniques structurés. Ici, des modèles traditionnels soigneusement entraînés et des systèmes profonds spécialisés restent souvent en tête lorsqu’ils peuvent apprendre à partir de grandes quantités de données. Ils excellent particulièrement à repérer des motifs dans des séries de valeurs de laboratoire et des constantes vitales au fil du temps. Cependant, lorsque seulement un petit nombre d’exemples de patients est disponible—comme c’est souvent le cas pour des maladies rares ou de nouvelles épidémies—les modèles de langage modernes montrent une force surprenante. Dans certains tests, un grand modèle de langage, opérant à partir d’un prompt bien conçu et de quelques exemples, a égalé ou battu des modèles conventionnels entraînés sur les mêmes données limitées. Les tentatives consistant à injecter simultanément tableaux et texte dans les modèles de langage n’ont pas automatiquement amélioré les performances, révélant que la combinaison de sources de données reste un problème de conception délicat plutôt qu’un avantage gratuit.

Observer le raisonnement médical de l’IA

Parce qu’une confiance aveugle dans un score de risque est dangereuse, l’équipe a également demandé à cinq cliniciens d’évaluer les explications que les modèles de langage produisaient en accompagnement de leurs prédictions. Dans l’ensemble, les experts ont trouvé ces narrations raisonnablement précises, complètes et cliniquement utiles, surtout lorsque les modèles travaillaient à partir de notes narratives riches. Néanmoins, des faiblesses importantes sont apparues. Dans certains faux positifs, les modèles justifiaient un risque élevé en inventant ou en mal lisant des détails du dossier. Dans les cas de risques manqués, ils reconnaissaient souvent des éléments pertinents mais ne les ont pas correctement pondérés, reflétant un jugement superficiel plutôt que de simples erreurs d’extraction de données. Même lorsque les prédictions étaient correctes, des traces de raisonnement défectueux demeuraient, soulignant que la seule précision ne garantit pas un soutien clinique fiable.

Équité, limites et perspectives

Les chercheurs ont aussi examiné l’équité selon l’âge, le sexe et la race. De manière encourageante, les modèles de langage de pointe soigneusement sollicités en mode zero-shot montraient souvent des performances mieux équilibrées entre les groupes que certains systèmes traditionnels fortement entraînés, qui pouvaient amplifier des biais existants dans les données. Pourtant, l’ajustement des modèles pour des tâches spécifiques réintroduisait parfois des disparités, et aucune méthode n’était parfaitement équitable. Les auteurs insistent sur le fait que tout déploiement devrait inclure des contrôles de biais de routine, une conception robuste des prompts et des gardes-fous pour la fiabilité, pas seulement une haute précision sur un jeu de test unique.

Ce que cela signifie pour les soins hospitaliers futurs

ClinicRealm conclut que les grands modèles de langage modernes ne sont plus de simples assistants bavards : ils sont devenus des concurrents sérieux pour la prédiction des résultats des patients, en particulier à partir de notes écrites et dans des contextes avec peu de données. Les systèmes classiques d’apprentissage automatique brillent encore lorsqu’il existe beaucoup d’informations structurées et du temps pour les entraîner, mais l’écart se resserre. Pour les hôpitaux et les technologues en santé, cela signifie s’éloigner des choix uniformes vers une boîte à outils plus nuancée : utiliser les modèles traditionnels là où ils restent supérieurs, s’appuyer sur les grands modèles de langage pour le texte libre et le démarrage rapide, et combiner les deux avec une attention soignée à la qualité du raisonnement et à l’équité. Menée avec discernement, cette stratégie équilibrée pourrait rendre l’analytique prédictive plus performante, plus largement accessible et, en fin de compte, plus favorable à des soins plus sûrs et plus personnalisés.

Citation: Zhu, Y., Gao, J., Wang, Z. et al. ClinicRealm: Re-evaluating large language models with conventional machine learning for non-generative clinical prediction tasks. npj Digit. Med. 9, 319 (2026). https://doi.org/10.1038/s41746-026-02539-z

Mots-clés: prédiction clinique, dossiers médicaux électroniques, grands modèles de langage, évaluation des IA médicales, équité en santé