Clear Sky Science · de

ClinicRealm: Neubewertung großer Sprachmodelle mit konventionellem maschinellen Lernen für nicht-generative klinische Vorhersageaufgaben

Warum klügere Vorhersagen im Krankenhaus wichtig sind

Jeden Tag sammeln Krankenhäuser enorme Mengen digitaler Informationen über ihre Patienten, von kurzen Arztnotizen bis hin zu langen Listen von Laborwerten und Vitalzeichen. In diesen Daten verbergen sich Hinweise darauf, wer sich wahrscheinlich erholen wird, wer bald wieder ins Krankenhaus kommen könnte und wer ernsthaft gefährdet ist. Die Wahl der richtigen Art von künstlicher Intelligenz (KI), die diese Hinweise liest, ist längst keine rein technische Frage mehr – sie kann beeinflussen, wie schnell und gerecht Patienten Hilfe erhalten. Diese Studie stellt eine aktuelle Frage: Können die leistungsfähigen, chatartigen KI-Systeme der Gegenwart, bekannt als große Sprachmodelle, tatsächlich mit den seit langem eingesetzten, sorgfältig zugeschnittenen Algorithmen für medizinische Vorhersagen konkurrieren oder sie übertreffen?

Neue Tests für neue Arten medizinischer KI

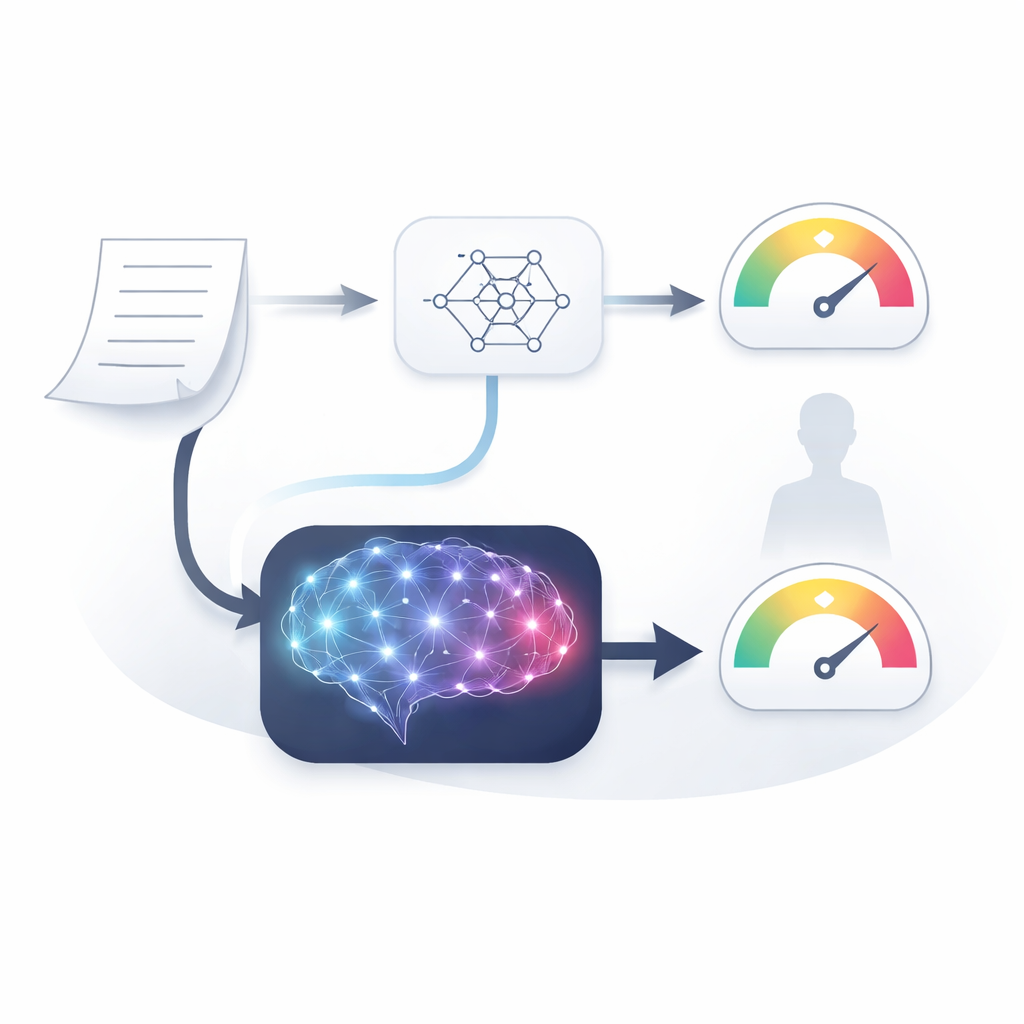

Die Forscher bauten ein breit angelegtes Benchmark auf, das sie ClinicRealm nennen, um drei Modellfamilien nebeneinander zu vergleichen: traditionelle Machine-Learning- und Deep-Learning-Systeme, frühere textfokussierte Modelle und moderne große Sprachmodelle. Sie bewerteten diese Werkzeuge anhand zweier Haupttypen von Krankenhausdaten. Der eine ist unstrukturierter Text, wie Aufnahme- und Entlassungsberichte in alltäglicher klinischer Sprache. Der andere sind strukturierte elektronischen Gesundheitsakten-Tabellen, bestehend aus Zahlen wie Laborwerten und zeitgestempelten Vitalzeichen. Das Team konzentrierte sich auf praktische Fragen, die für Krankenhäuser relevant sind, darunter, ob ein Patient während des Aufenthalts sterben würde, innerhalb von 30 Tagen wiederaufgenommen wird oder wie lange der Aufenthalt voraussichtlich dauern wird.

Wenn Worte Zahlen in der Vorhersage übertreffen

Ein auffälliges Muster zeigte sich bei Aufgaben, die auf den Notizen von Ärzten und Pflegekräften basieren. Jahrelang galten spezialisierte Textmodelle, die auf medizinischen Aufzeichnungen angepasst wurden, als die beste Wahl, um aus solchen Notizen Ergebnisse vorherzusagen. ClinicRealm zeigt jedoch, dass die neuesten großen Sprachmodelle, die „zero-shot“ ohne zusätzliches Training auf den Krankenhausdaten eingesetzt werden, diese spezialisierten Systeme inzwischen deutlich übertreffen. Sowohl bei vorausschauenden Risikoabschätzungen als auch bei nachträglichen Dokumentenklassifikationen erzielten fortschrittliche Modelle wie GPT-5 und Varianten von DeepSeek sehr hohe Genauigkeit. Das bedeutet, dass das einfache Einspeisen von rohem klinischem Text und das Anfordern einer Vorhersage besser funktionieren kann als monatelanges, mühsames Feintuning älterer Ansätze. Bemerkenswert ist, dass mehrere Open-Source-Modelle die Leistung proprietärer Modelle erreichten oder sogar übertrafen, was starke Werkzeuge für Krankenhäuser zugänglicher macht, die ihre Daten intern halten müssen.

Zahlen belohnen weiterhin klassische Werkzeuge – aber nicht immer

Die Lage ist nuancierter bei strukturierten elektronischen Gesundheitsakten. Hier liegen sorgfältig trainierte traditionelle Modelle und spezialisierte Deep-Learning-Systeme weiterhin vorn, sofern sie aus großen Datenmengen lernen können. Sie sind besonders gut darin, Muster in zeitlich aufeinanderfolgenden Laborwerten und Vitalzeichen zu erkennen. Wenn jedoch nur wenige Patientenbeispiele verfügbar sind – wie es häufig bei seltenen Erkrankungen oder neuen Ausbrüchen der Fall ist – zeigen moderne Sprachmodelle überraschende Stärken. In einigen Tests erreichte ein großes Sprachmodell, das mit einem geschickt gestalteten Prompt und wenigen Beispielen arbeitete, die Leistung oder übertraf konventionelle Modelle, die auf denselben begrenzten Daten trainiert wurden. Der Versuch, Tabellen und Text einfach gleichzeitig in Sprachmodelle zu füttern, verbesserte die Leistung nicht automatisch, was zeigt, dass die Kombination mehrerer Datenquellen weiterhin ein heikles Gestaltungsproblem ist und kein automatischer Vorteil.

Ein Blick in das medizinische Denken der KI

Da blindes Vertrauen in eine Risikobewertung unsicher ist, baten die Forscher zudem fünf Kliniker, die Erklärungen zu bewerten, die Sprachmodelle zusammen mit ihren Vorhersagen lieferten. Insgesamt fanden die Expertinnen und Experten diese Narrative bei der Arbeit mit reichhaltigen Erzählnoten als einigermaßen genau, vollständig und klinisch nützlich. Dennoch traten wichtige Schwächen zutage. Bei einigen Fehlalarmen rechtfertigten Modelle ein hohes Risiko, indem sie Details in der Akte erfanden oder falsch interpretierten. In Fällen mit übersehenem Risiko erkannten sie oft relevante Befunde, bewerteten diese aber nicht richtig, was eher auf oberflächliches Urteilsvermögen als auf einfache Extraktionsfehler hinweist. Selbst wenn Vorhersagen korrekt waren, blieben Spuren fehlerhafter Schlussfolgerungen sichtbar, was unterstreicht, dass Genauigkeit allein keine verlässliche klinische Unterstützung garantiert.

Gerechtigkeit, Grenzen und das, was als Nächstes kommt

Die Forscher untersuchten auch die Fairness in Bezug auf Alter, Geschlecht und ethnische Zugehörigkeit. Ermutigend zeigten moderne Sprachmodelle, die sorgfältig im Zero-Shot-Modus abgefragt wurden, oft eine ausgewogenere Leistung über Gruppen hinweg als einige stark trainierte traditionelle Systeme, die bestehende Datenverzerrungen verstärken konnten. Doch das Anpassen von Modellen an bestimmte Aufgaben führte mitunter wieder zu Ungleichheiten, und keine Methode war perfekt fair. Die Autoren betonen, dass jede Implementierung routinemäßige Bias-Checks, robustes Prompt-Design und Sicherheitsvorkehrungen für Zuverlässigkeit beinhalten sollte – nicht nur hohe Genauigkeit auf einem einzelnen Testdatensatz.

Was das für die zukünftige Krankenhausversorgung bedeutet

ClinicRealm kommt zu dem Schluss, dass moderne große Sprachmodelle nicht mehr nur geschwätzige Assistenten sind; sie haben sich zu ernstzunehmenden Anwärtern für die Vorhersage klinischer Ergebnisse entwickelt, insbesondere bei schriftlichen Notizen und in Umgebungen mit wenig Daten. Klassische Machine-Learning-Systeme bleiben überlegen, wenn reichlich strukturierte Informationen und Zeit für das Training vorhanden sind, doch die Lücke wird enger. Für Krankenhäuser und Gesundheitstechnologen bedeutet das, sich von Einheitslösungen zu entfernen und ein nuancierteres Werkzeugset zu verwenden: traditionelle Modelle dort einzusetzen, wo sie am besten sind, große Sprachmodelle für Freitext und schnellen Start zu nutzen und beide mit sorgfältigem Augenmerk auf die Qualität des Denkens und auf Fairness zu kombinieren. Sorgfältig angewendet könnte diese ausgewogene Strategie prädiktive Analytik leistungsfähiger, weiter verbreitet und letztlich unterstützender für eine sicherere, stärker personalisierte Versorgung machen.

Zitation: Zhu, Y., Gao, J., Wang, Z. et al. ClinicRealm: Re-evaluating large language models with conventional machine learning for non-generative clinical prediction tasks. npj Digit. Med. 9, 319 (2026). https://doi.org/10.1038/s41746-026-02539-z

Schlüsselwörter: klinische Vorhersage, elektronische Gesundheitsakten, große Sprachmodelle, medizinisches KI-Benchmarking, Gerechtigkeit im Gesundheitswesen