Clear Sky Science · pt

Avaliação multicêntrica multifuncional de modelos de linguagem grande na interpretação de audiogramas de tons puros para pacientes

Por que os laudos de exame auditivo são tão difíceis de entender

Muitas pessoas saem de um teste de audição segurando um gráfico cheio de pontos e linhas, com apenas uma breve observação do médico. Para quem não é especialista, esses relatórios de audiograma de tons puros são quase impossíveis de decifrar, embora orientem decisões que mudam a vida sobre aparelhos auditivos, tratamentos e comunicação diária. Este estudo pergunta se os chatbots de inteligência artificial modernos, movidos por grandes modelos de linguagem, podem transformar esses gráficos técnicos em explicações claras e tranquilizadoras para pacientes comuns.

Transformando gráficos complexos do ouvido em linguagem simples

Os audiogramas de tons puros são o padrão‑ouro para medir quão bem ouvimos diferentes tons, desde rumores graves até agudos. O relatório resultante parece mais um experimento de física do que um resumo de saúde. Ao mesmo tempo, especialistas treinados em audiologia são escassos no mundo todo, especialmente em regiões com recursos médicos limitados. Os pesquisadores viram uma oportunidade: se chatbots pudessem “ler” esses gráficos e explicar os resultados em linguagem cotidiana, eles poderiam ajudar os pacientes a entender melhor e mais cedo sua audição, apoiando a meta da Organização Mundial da Saúde de “saúde auditiva para todos”.

Testando vários chatbots

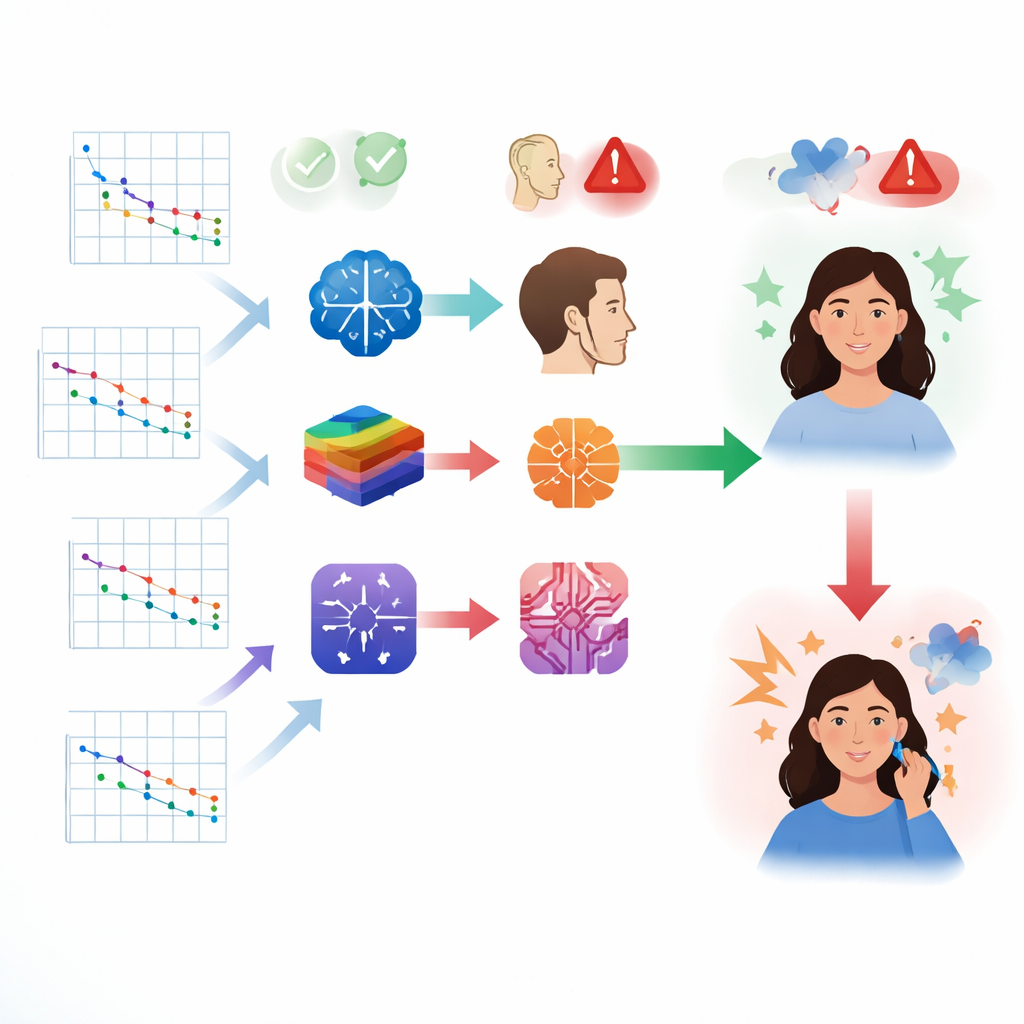

A equipe reuniu 140 laudos reais de testes de audição de dois centros na China, removeu dados pessoais e gerou versões padronizadas dos gráficos do audiograma. Em seguida, pediram a oito diferentes modelos de grande linguagem, de empresas na China e nos Estados Unidos, que realizassem três tarefas para cada relatório: indicar quão grave era a perda auditiva e que tipo era (por exemplo, relacionada ao ouvido interno ou externo), explicar os achados em linguagem acessível ao paciente e oferecer recomendações práticas, como quando procurar atendimento ou considerar aparelhos auditivos. Todas as saídas dos modelos foram coletadas em condições controladas e depois avaliadas por clínicos experientes e por voluntários leigos que não sabiam qual modelo gerou cada resposta.

Quão bem as máquinas diagnosticaram a perda auditiva

Quando se tratou de atuar como um especialista virtual em audição, o desempenho dos modelos foi misto. O sistema de melhor desempenho, DeepSeek‑V3, julgou corretamente a gravidade da perda auditiva em cerca de dois terços dos casos e identificou o tipo amplo de perda apenas pouco mais da metade das vezes. Outros modelos frequentemente foram piores, e a precisão geral ficou muito abaixo do esperado de clínicos treinados. Os pesquisadores também testaram formas alternativas de fornecer informações aos modelos, por exemplo adicionando números mais estruturados junto com as imagens dos gráficos. Essas mudanças melhoraram a precisão na maioria dos sistemas, sugerindo que a forma como a informação é apresentada pode ser tão importante quanto a potência do modelo.

Explicações úteis, mas com detalhes inventados preocupantes

Além da precisão bruta, o estudo investigou quão legíveis e confiáveis eram as explicações dos chatbots. Alguns modelos produziram respostas longas e prolixas, enquanto outros foram mais concisos. Apenas os modelos DeepSeek escreveram consistentemente em um nível de leitura aproximado ao de alguém com ensino fundamental/médio, alinhando‑se às diretrizes de literacia em saúde de grandes organizações médicas. No entanto, vários sistemas mostraram uma tendência preocupante a alucinar, inventando detalhes que não constavam nos relatórios originais. Em aproximadamente uma em cada quatro respostas de alguns modelos, o chatbot fabricou números, declarou de forma incorreta os limiares auditivos ou recomendou dispositivos inexistentes e caminhos de tratamento não realistas. Em contraste, um modelo Gemini teve muito menos alucinações, embora sua precisão médica não tenha sido a mais alta.

O que especialistas e usuários comuns acharam

Os clínicos avaliaram os modelos quanto à exatidão, abrangência e utilidade prática de suas respostas. Novamente, DeepSeek‑V3 e seu modelo irmão geralmente ficaram no topo em qualidade profissional, oferecendo interpretações estruturadas e recomendações focadas alinhadas à prática clínica. Ainda assim, quando membros do público avaliaram as mesmas respostas, as prioridades mudaram. Leigos favoreceram modelos mais fáceis de seguir, mais conversacionais e mais empáticos, mesmo que esses não fossem os mais precisos do ponto de vista médico. Os modelos Gemini se destacaram especialmente por clareza, empatia e satisfação geral, ressaltando uma tensão entre padrões profissionais estritos e necessidades de comunicação centrada no paciente.

Por que isso importa para pessoas com problemas auditivos

A perda auditiva é comum, e muitas pessoas nunca recebem uma explicação clara de seus resultados de exame. Este estudo mostra que os chatbots atuais não estão prontos para substituir audiologistas nem para fazer diagnósticos autônomos a partir de gráficos de audiograma. Suas taxas de erro e os detalhes eventualmente inventados podem enganar pacientes se usados sem supervisão. Ao mesmo tempo, os modelos já apresentam pontos fortes reais: transformar gráficos densos em linguagem simples, oferecer orientação inicial e reduzir a ansiedade de quem pode não ter a quem perguntar. Usadas com cuidado, com avisos claros e sob supervisão de profissionais de audiologia, essas ferramentas podem se tornar assistentes valiosos para ajudar a reduzir lacunas no acesso ao cuidado, melhorar a compreensão e favorecer ações mais precoces em saúde auditiva.

Citação: Liang, J., Xing, M., Xiang, P. et al. A multicenter multifunctional assessment of large language models in pure-tone audiogram interpretation for patients. npj Digit. Med. 9, 348 (2026). https://doi.org/10.1038/s41746-026-02537-1

Palavras-chave: perda auditiva, audiograma de tons puros, modelos de linguagem grande, comunicação com o paciente, saúde digital