Clear Sky Science · pl

Wieloośrodkowa wielofunkcyjna ocena dużych modeli językowych w interpretacji audiogramów tonów czystych dla pacjentów

Dlaczego raporty badań słuchu są tak trudne do zrozumienia

Wiele osób wychodzi z badania słuchu z wykresem pełnym kropek i linii oraz tylko krótką notatką od lekarza. Dla osób nierozumiejących specjalistycznej terminologii te raporty z audiogramów tonów czystych są niemal niemożliwe do rozszyfrowania, a mimo to wpływają na decyzje zmieniające życie dotyczące aparatów słuchowych, leczenia i codziennej komunikacji. Badanie to stawia pytanie, czy nowoczesne chatboty napędzane dużymi modelami językowymi potrafią przemienić te techniczne wykresy w jasne, uspokajające wyjaśnienia dla zwykłych pacjentów.

Przekształcanie złożonych wykresów uszu na prosty język

Audiogramy tonów czystych są złotym standardem do mierzenia, jak dobrze słyszymy różne tony — od niskich dudnień po wysokie tony. Powstały raport wygląda bardziej jak eksperyment z fizyki niż podsumowanie stanu zdrowia. Jednocześnie przeszkoleni specjaliści w zakresie słuchu są na całym świecie w niedoborze, szczególnie w regionach o ograniczonych zasobach medycznych. Badacze dostrzegli okazję: jeśli chatboty potrafiłyby „czytać” te wykresy i tłumaczyć wyniki w codziennym języku, mogłyby pomóc pacjentom zrozumieć ich słuch wcześniej i pełniej, wspierając cel Światowej Organizacji Zdrowia — „zdrowie słuchu dla wszystkich”.

Wystawienie kilku chatbotów na próbę

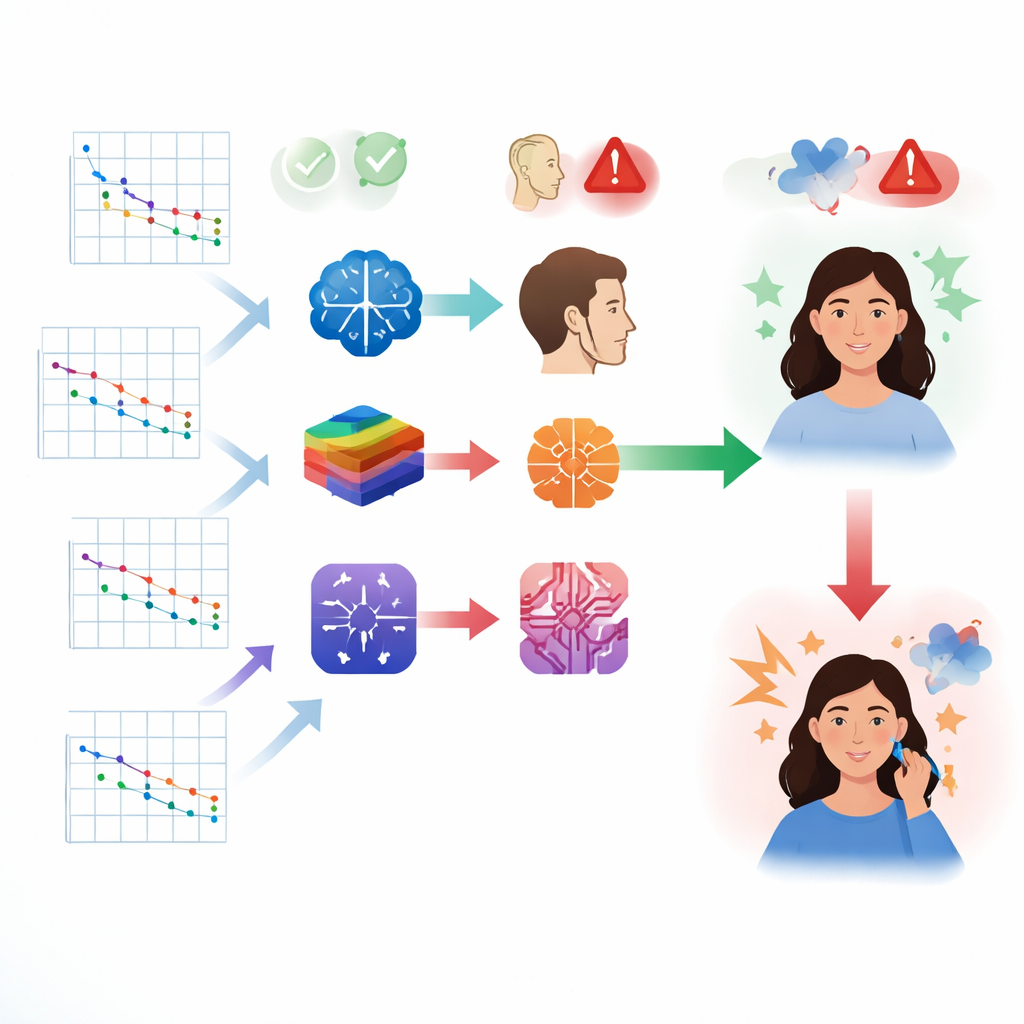

Zespół zebrał 140 rzeczywistych raportów z badań słuchu z dwóch ośrodków w Chinach, usunął dane osobowe i odtworzył ustandaryzowane wersje wykresów audiogramów. Następnie poprosili osiem różnych dużych modeli językowych, reprezentujących firmy z Chin i Stanów Zjednoczonych, o wykonanie trzech zadań dla każdego raportu: określenie, jak poważna jest utrata słuchu i jakiego jest rodzaju (na przykład dotycząca ucha wewnętrznego lub zewnętrznego), wyjaśnienie wyników w języku przyjaznym dla pacjenta oraz zaproponowanie praktycznych rekomendacji, takich jak kiedy szukać pomocy lub rozważyć aparat słuchowy. Wszystkie odpowiedzi modeli zebrano w kontrolowanych warunkach, a następnie ocenili je doświadczeni klinicyści oraz niezależni ochotnicy‑laicy, którzy nie wiedzieli, który model wygenerował którą odpowiedź.

Jak dobrze maszyny diagnozowały utratę słuchu

W roli wirtualnego specjalisty od słuchu wydajność modeli była mieszana. System osiągający najlepsze wyniki, DeepSeek‑V3, poprawnie ocenił nasilenie utraty słuchu w około dwóch trzecich przypadków i zidentyfikował ogólny typ ubytku nieco ponad połowę razy. Inne modele często wypadały gorzej, a dokładność wszystkich systemów pozostawała znacznie poniżej oczekiwań wobec wykwalifikowanych klinicystów. Badacze przetestowali też alternatywne sposoby przekazywania informacji modelom, na przykład dodając bardziej uporządkowane dane liczbowe wraz z obrazami wykresów. Te zmiany poprawiły dokładność w większości systemów, co sugeruje, że sposób prezentacji informacji może być równie ważny jak sama moc modelu.

Pomocne wyjaśnienia, ale niepokojące zmyślenia

Poza surową dokładnością badanie analizowało, jak czytelne i wiarygodne były wyjaśnienia chatbotów. Niektóre modele generowały długie, rozwlekłe odpowiedzi, inne były bardziej zwięzłe. Tylko modele DeepSeek konsekwentnie pisały na poziomie czytelniczym mniej więcej odpowiadającym osobie z wykształceniem na poziomie szkoły średniej niższej, zgodnym z wytycznymi dotyczącymi umiejętności korzystania z informacji zdrowotnych dużych organizacji medycznych. Jednak kilka systemów wykazało niepokojącą tendencję do halucynowania — wymyślania szczegółów, których nie było w oryginalnych raportach. W około jednej na cztery odpowiedzi niektórych modeli chatbot fabrykował liczby, błędnie podawał progi słyszenia lub polecał nieistniejące urządzenia i nierealistyczne ścieżki leczenia. Dla porównania, jeden model z rodziny Gemini miał znacznie mniej takich zmyśleń, choć jego dokładność medyczna nie była najwyższa.

Co myśleli eksperci i zwykli użytkownicy

Klinicyści oceniali modele pod kątem dokładności, drobiazgowości i praktycznej użyteczności ich odpowiedzi. Również tutaj DeepSeek‑V3 i pokrewny mu model zwykle plasowały się najwyżej pod względem jakości profesjonalnej, oferując uporządkowane interpretacje i skoncentrowane rekomendacje zgodne z praktyką kliniczną. Gdy jednak te same odpowiedzi oceniali przedstawiciele społeczeństwa, priorytety ulegały przesunięciu. Osoby niebędące ekspertami wolały modele łatwiejsze do śledzenia, bardziej konwersacyjne i bardziej wspierające emocjonalnie, nawet jeśli nie były one najdokładniejsze medycznie. Modele Gemini wyróżniały się zwłaszcza pod względem jasności, empatii i ogólnego zadowolenia, co podkreśla napięcie między rygorem standardów zawodowych a potrzebami komunikacji ukierunkowanej na pacjenta.

Dlaczego to ma znaczenie dla osób z problemami słuchu

Utrata słuchu jest powszechna i wiele osób nigdy nie otrzymuje jasnego wyjaśnienia wyników badań. Badanie pokazuje, że dzisiejsze chatboty nie są gotowe, by zastąpić audiologów ani stawiać samodzielnych diagnoz na podstawie wykresów słuchu. Ich wskaźniki błędów i sporadyczne wymyślanie szczegółów mogą wprowadzać pacjentów w błąd, jeśli byłyby używane bez nadzoru. Jednocześnie modele już mają realne zalety: potrafią przekształcać gęste wykresy na prosty język, oferować wstępne wskazówki i łagodzić lęk u osób, które inaczej nie miałyby do kogo się zwrócić. Stosowane ostrożnie, z wyraźnymi ostrzeżeniami i pod nadzorem specjalistów od słuchu, takie narzędzia mogą stać się wartościowymi asystentami pomagającymi zmniejszać luki w dostępie do opieki, poprawiać zrozumienie i wspierać wcześniejsze działania na rzecz zdrowia słuchu.

Cytowanie: Liang, J., Xing, M., Xiang, P. et al. A multicenter multifunctional assessment of large language models in pure-tone audiogram interpretation for patients. npj Digit. Med. 9, 348 (2026). https://doi.org/10.1038/s41746-026-02537-1

Słowa kluczowe: utrata słuchu, audiogram tonów czystych, duże modele językowe, komunikacja z pacjentem, zdrowie cyfrowe