Clear Sky Science · es

Evaluación multicéntrica y multifuncional de modelos de lenguaje grandes en la interpretación de audiogramas tonales puros para pacientes

Por qué los informes de las pruebas de audición son tan difíciles de entender

Mucha gente sale de una prueba de audición con una gráfica llena de puntos y líneas y solo una nota breve del médico. Para los no especialistas, estos informes de audiogramas tonales puros son casi imposibles de interpretar, y, sin embargo, orientan decisiones que pueden cambiar la vida sobre audífonos, tratamientos y la comunicación diaria. Este estudio pregunta si los chatbots de inteligencia artificial modernos, impulsados por modelos de lenguaje grandes, pueden convertir esas gráficas técnicas en explicaciones claras y tranquilizadoras para pacientes comunes.

Convertir gráficas auditivas complejas en lenguaje sencillo

Los audiogramas tonales puros son la prueba de referencia para medir cómo oímos diferentes tonos, desde graves profundos hasta agudos altos. El informe resultante se parece más a un experimento de física que a un resumen de salud. Al mismo tiempo, los especialistas auditivos capacitados escasean a nivel mundial, especialmente en regiones con recursos médicos limitados. Los investigadores vieron una oportunidad: si los chatbots pudieran “leer” estas gráficas y explicar los resultados en un lenguaje cotidiano, podrían ayudar a los pacientes a entender su audición de forma más temprana y completa, apoyando la meta de la Organización Mundial de la Salud de «salud auditiva para todos».

Poner a prueba a varios chatbots

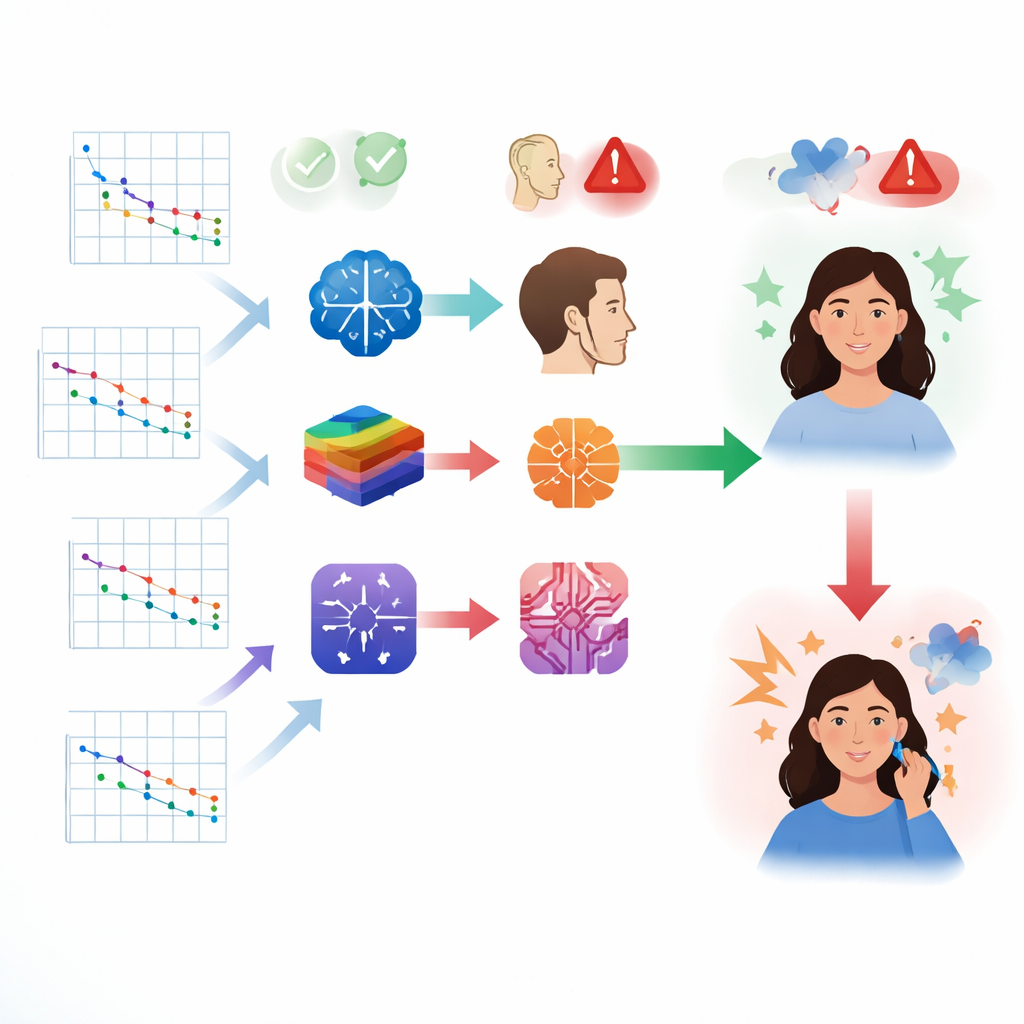

El equipo reunió 140 informes reales de pruebas de audición de dos centros en China, eliminó datos personales y regeneró versiones estandarizadas de las gráficas de audiograma. Luego pidieron a ocho modelos de lenguaje grandes distintos, de empresas tanto de China como de Estados Unidos, que realizaran tres tareas por cada informe: indicar la gravedad de la pérdida auditiva y su tipo (por ejemplo, relacionado con el oído interno o externo), explicar los hallazgos en lenguaje comprensible para el paciente y ofrecer recomendaciones prácticas como cuándo buscar atención o considerar audífonos. Todas las salidas de los modelos se recopilaron en condiciones controladas y posteriormente fueron evaluadas por clínicos experimentados y por voluntarios legos independientes que no supieron qué modelo produjo cada respuesta.

Qué tan bien diagnosticaron las máquinas la pérdida auditiva

En cuanto a funcionar como un especialista auditivo virtual, el rendimiento de los modelos fue variable. El sistema con mejor desempeño, DeepSeek‑V3, juzgó correctamente la severidad de la pérdida auditiva en alrededor de dos tercios de los casos e identificó el tipo general de pérdida poco más de la mitad de las veces. Otros modelos con frecuencia obtuvieron peores resultados, y la precisión en general quedó muy por debajo de lo que se espera de clínicos capacitados. Los investigadores también probaron formas alternativas de presentar la información a los modelos, por ejemplo añadiendo números más estructurados junto con las imágenes de las gráficas. Estos cambios mejoraron la precisión en la mayoría de los sistemas, lo que sugiere que la forma en que se presenta la información puede ser tan importante como la potencia del modelo.

Explicaciones útiles, pero preocupantes detalles inventados

Más allá de la precisión bruta, el estudio exploró cuán legibles y confiables eran las explicaciones de los chatbots. Algunos modelos produjeron respuestas largas y verbosas, mientras que otros fueron más concisos. Solo los modelos DeepSeek escribieron de forma consistente a un nivel de lectura aproximadamente adecuado para alguien con educación de secundaria, en línea con las guías de alfabetización en salud de grandes organizaciones médicas. Sin embargo, varios sistemas mostraron una tendencia inquietante a alucinar, inventando detalles que no estaban en los informes originales. En aproximadamente una de cada cuatro respuestas de algunos modelos, el chatbot fabricó cifras, declaró incorrectamente umbrales auditivos o recomendó dispositivos inexistentes y vías de tratamiento poco realistas. En contraste, un modelo Gemini tuvo muchas menos alucinaciones, aunque su precisión médica no fue la más alta.

Qué pensaron los expertos y los usuarios comunes

Los clínicos evaluaron a los modelos según la exactitud, la exhaustividad y la utilidad práctica de sus respuestas. Aquí de nuevo, DeepSeek‑V3 y su modelo homólogo generalmente ocuparon los primeros puestos por calidad profesional, ofreciendo interpretaciones estructuradas y recomendaciones centradas alineadas con la práctica clínica. Sin embargo, cuando miembros del público valoraron las mismas respuestas, las prioridades cambiaron. Los no expertos prefirieron modelos que fueran más fáciles de seguir, más conversacionales y más emotivamente solidarios, aunque no fuesen los más precisos desde el punto de vista médico. Los modelos Gemini obtuvieron especialmente buenas puntuaciones en claridad, empatía y satisfacción general, poniendo de manifiesto una tensión entre los estándares profesionales estrictos y las necesidades de comunicación centrada en el paciente.

Por qué esto importa para las personas con problemas auditivos

La pérdida auditiva es común y muchas personas nunca reciben una explicación clara de sus resultados. Este estudio muestra que los chatbots actuales no están listos para reemplazar a los audiólogos ni para emitir diagnósticos independientes a partir de las gráficas de audición. Sus tasas de error y los ocasionales detalles inventados podrían inducir a error a los pacientes si se emplean sin supervisión. Al mismo tiempo, los modelos ya presentan fortalezas reales: convertir gráficas densas en lenguaje sencillo, ofrecer orientación inicial y reducir la ansiedad de personas que de otro modo no tendrían a quién preguntar. Usados con cautela, con advertencias claras y bajo la supervisión de profesionales auditivos, tales herramientas podrían convertirse en asistentes valiosos que ayuden a reducir las brechas en el acceso a la atención, mejorar la comprensión y favorecer acciones más tempranas en materia de salud auditiva.

Cita: Liang, J., Xing, M., Xiang, P. et al. A multicenter multifunctional assessment of large language models in pure-tone audiogram interpretation for patients. npj Digit. Med. 9, 348 (2026). https://doi.org/10.1038/s41746-026-02537-1

Palabras clave: pérdida auditiva, audiograma tonal puro, modelos de lenguaje grandes, comunicación con el paciente, salud digital