Clear Sky Science · de

Eine multizentrische, multifunktionale Bewertung großer Sprachmodelle zur Interpretation von Reinton-Audiogrammen für Patientinnen und Patienten

Warum Hörtestberichte so schwer verständlich sind

Viele Menschen verlassen einen Hörtest mit einem Diagramm voller Punkte und Linien und nur einer kurzen Notiz des Arztes. Für Nicht‑Fachleute sind diese Reinton‑Audiogramm‑Berichte kaum zu entschlüsseln, zugleich treffen sie lebensverändernde Entscheidungen über Hörgeräte, Behandlungsoptionen und die alltägliche Kommunikation. Diese Studie untersucht, ob moderne KI‑Chatbots, die von großen Sprachmodellen angetrieben werden, diese technischen Diagramme in klare, beruhigende Erklärungen für normale Patientinnen und Patienten verwandeln können.

Komplexe Ohrdiagramme in einfache Sprache übersetzen

Reinton‑Audiogramme sind der Goldstandard, um zu messen, wie gut wir verschiedene Töne hören — von tiefen Brummtönen bis zu hohen Tonhöhen. Der daraus resultierende Bericht sieht eher nach einem Physikexperiment als nach einer Gesundheitszusammenfassung aus. Gleichzeitig mangelt es weltweit an ausgebildeten Hörspezialisten, besonders in Regionen mit begrenzten medizinischen Ressourcen. Die Forschenden sahen eine Chance: Wenn Chatbots diese Diagramme „lesen“ und die Ergebnisse in alltäglicher Sprache erklären könnten, könnten sie Patientinnen und Patienten helfen, ihr Hören früher und besser zu verstehen und damit das WHO‑Ziel „Hörgesundheit für alle“ zu unterstützen.

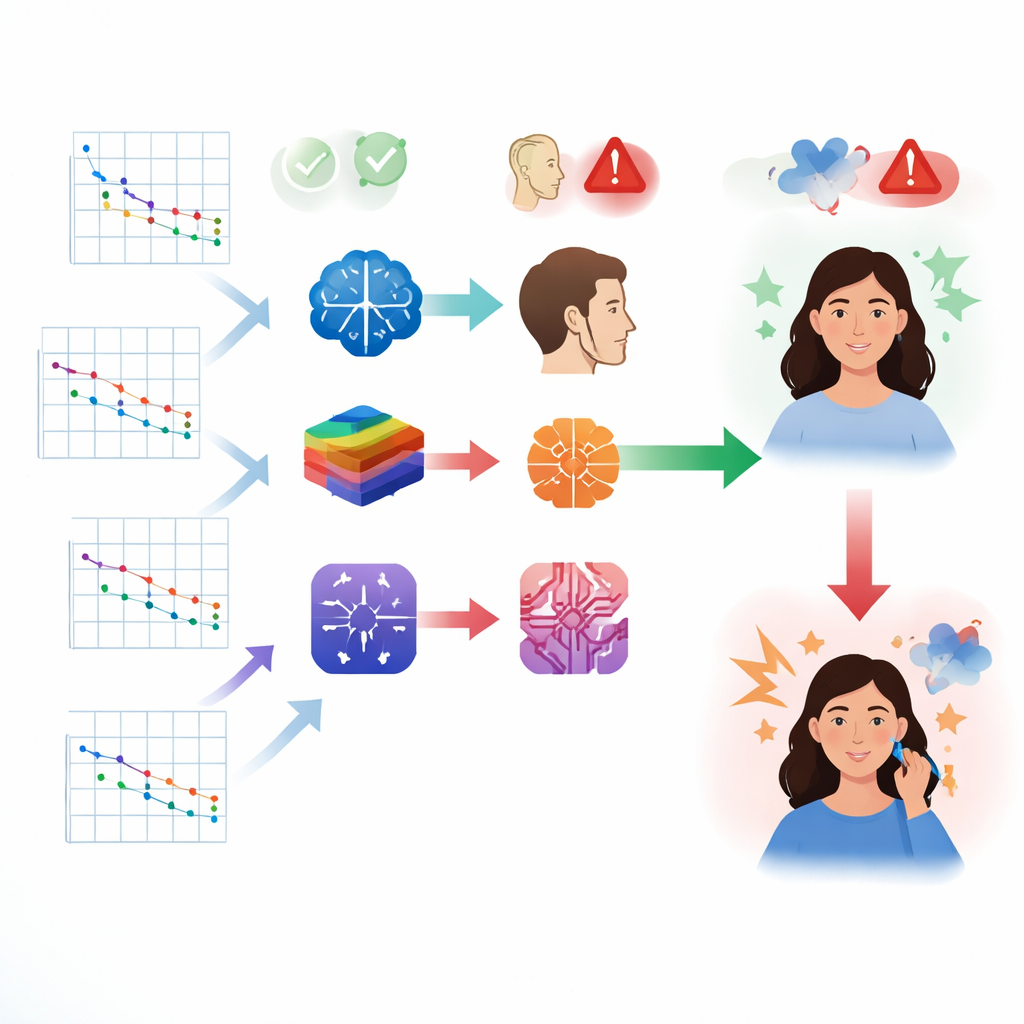

Mehrere Chatbots im Vergleich

Das Team sammelte 140 reale Hörtestberichte aus zwei Zentren in China, entfernte persönliche Daten und erzeugte standardisierte Versionen der Audiogramm‑Diagramme. Anschließend baten sie acht verschiedene große Sprachmodelle, von Firmen in China und den USA, drei Aufgaben für jeden Bericht zu erfüllen: die Schwere des Hörverlusts und dessen Art zu benennen (beispielsweise Innenohr‑ versus Außenohr‑Ursache), die Befunde in patientenfreundlicher Sprache zu erklären und praktische Empfehlungen zu geben, etwa wann ärztliche Hilfe sinnvoll wäre oder Hörgeräte in Betracht gezogen werden sollten. Alle Modellantworten wurden unter kontrollierten Bedingungen gesammelt und später von erfahrenen Klinikerinnen und Klinikern sowie unabhängigen Laien bewertet, die nicht wussten, welches Modell welche Antwort erzeugt hatte.

Wie gut die Maschinen Hörverlust diagnostizierten

Als virtuelle Hörspezialisten agierend, war die Leistung der Modelle gemischt. Das beste System, DeepSeek‑V3, schätzte die Schwere des Hörverlusts in etwa zwei Dritteln der Fälle korrekt ein und identifizierte die grobe Art des Hörverlusts knapp über der Hälfte der Zeit. Andere Modelle lagen oft schlechter, und die Genauigkeit blieb insgesamt weit unter dem, was von ausgebildeten Fachkräften erwartet wird. Die Forschenden testeten außerdem alternative Wege, Informationen an die Modelle zu übermitteln, etwa durch Hinzufügen strukturierter Zahlen neben den Diagrammbildern. Diese Änderungen verbesserten die Genauigkeit bei den meisten Systemen, was darauf hindeutet, dass die Präsentation der Informationen genauso wichtig sein kann wie die Leistungsfähigkeit des Modells.

Hilfreiche Erklärungen, aber beunruhigende Erfindungen

Über die reine Genauigkeit hinaus untersuchte die Studie, wie lesbar und vertrauenswürdig die Erklärungen der Chatbots waren. Einige Modelle lieferten lange, wortreiche Antworten, andere waren knapper. Nur die DeepSeek‑Modelle schrieben durchweg auf einem Leseverständnisniveau, das ungefähr für Personen mit mittlerer Schulbildung geeignet ist und den Gesundheits‑Literacy‑Richtlinien großer medizinischer Organisationen entspricht. Mehrere Systeme zeigten jedoch eine beunruhigende Tendenz zu Halluzinationen und erfanden Details, die nicht im Originalbericht standen. Bei einigen Modellen fälschte der Chatbot in etwa einer von vier Antworten Zahlen, gab falsche Hörschwellen an oder empfahl nicht existierende Geräte und unrealistische Behandlungswege. Im Gegensatz dazu hatte ein Gemini‑Modell deutlich weniger Halluzinationen, obwohl dessen medizinische Genauigkeit nicht die höchste war.

Was Expertinnen, Experten und Alltagspersonen dachten

Klinikerinnen und Kliniker bewerteten die Modelle hinsichtlich Genauigkeit, Vollständigkeit und praktischer Nützlichkeit ihrer Antworten. Auch hier rangierten DeepSeek‑V3 und sein Schwester‑Modell meist am höchsten in professioneller Qualität, mit strukturierten Interpretationen und gezielten Empfehlungen im Einklang mit der klinischen Praxis. Wenn jedoch die Allgemeinheit dieselben Antworten bewertete, verschoben sich die Prioritäten. Laien bevorzugten Modelle, die leichter zu folgen, gesprächsfriendlyer und emotional unterstützender waren, selbst wenn diese nicht die medizinisch präzisesten Antworten lieferten. Die Gemini‑Modelle schnitten besonders gut in punkto Klarheit, Empathie und allgemeiner Zufriedenheit ab und zeigten damit die Spannung zwischen strengen professionellen Standards und patientenorientierten Kommunikationsbedürfnissen.

Warum das für Menschen mit Hörproblemen wichtig ist

Hörverlust ist weit verbreitet, und viele Menschen erhalten niemals eine klare Erklärung ihrer Testergebnisse. Diese Studie zeigt, dass heutige Chatbots noch nicht bereit sind, Audiologinnen und Audiologen zu ersetzen oder alleinstehende Diagnosen aus Hördiagrammen zu stellen. Ihre Fehlerraten und gelegentlichen erfundenen Details könnten Patientinnen und Patienten irreführen, wenn sie ohne Aufsicht eingesetzt werden. Zugleich besitzen die Modelle bereits echte Stärken: dichte Diagramme in einfache Sprache zu übersetzen, erste Orientierung zu bieten und Ängste von Menschen zu lindern, die sonst niemanden hätten, den sie fragen könnten. Sorgfältig eingesetzt, mit deutlichen Warnhinweisen und unter Aufsicht von Hörfachkräften, könnten solche Werkzeuge wertvolle Assistenten werden, die Versorgungslücken überbrücken, das Verständnis verbessern und frühere Maßnahmen für die Hörgesundheit unterstützen.

Zitation: Liang, J., Xing, M., Xiang, P. et al. A multicenter multifunctional assessment of large language models in pure-tone audiogram interpretation for patients. npj Digit. Med. 9, 348 (2026). https://doi.org/10.1038/s41746-026-02537-1

Schlüsselwörter: Hörverlust, Reinton-Audiogramm, große Sprachmodelle, Patientenkommunikation, digitale Gesundheit