Clear Sky Science · fr

Évaluation multicentrique multifonctionnelle des grands modèles de langage pour l’interprétation des audiogrammes tonals purs chez les patients

Pourquoi les comptes rendus d’examen auditif sont si difficiles à comprendre

Beaucoup de personnes quittent un examen auditif en tenant un graphique rempli de points et de lignes, avec seulement une courte note du médecin. Pour les non‑spécialistes, ces comptes rendus d’audiogramme tonal pur sont presque impossibles à déchiffrer, pourtant ils guident des décisions qui changent la vie concernant les prothèses auditives, le traitement et la communication quotidienne. Cette étude se demande si les chatbots d’intelligence artificielle modernes, alimentés par de grands modèles de langage, peuvent transformer ces graphiques techniques en explications claires et rassurantes pour les patients ordinaires.

Transformer des graphiques d’oreille complexes en langage simple

Les audiogrammes tonals purs sont le test de référence pour mesurer notre audition à différentes fréquences, des graves profonds aux aigus élevés. Le rapport qui en résulte ressemble davantage à une expérience de physique qu’à un résumé de santé. Parallèlement, les spécialistes de l’audition formés font défaut dans le monde, surtout dans les régions où les ressources médicales sont limitées. Les chercheurs ont vu une opportunité : si les chatbots pouvaient « lire » ces graphiques et expliquer les résultats en langage courant, ils pourraient aider les patients à comprendre leur audition plus tôt et de manière plus complète, soutenant l’objectif de l’Organisation mondiale de la Santé de « santé auditive pour tous ».

Soumettre plusieurs chatbots à l’épreuve

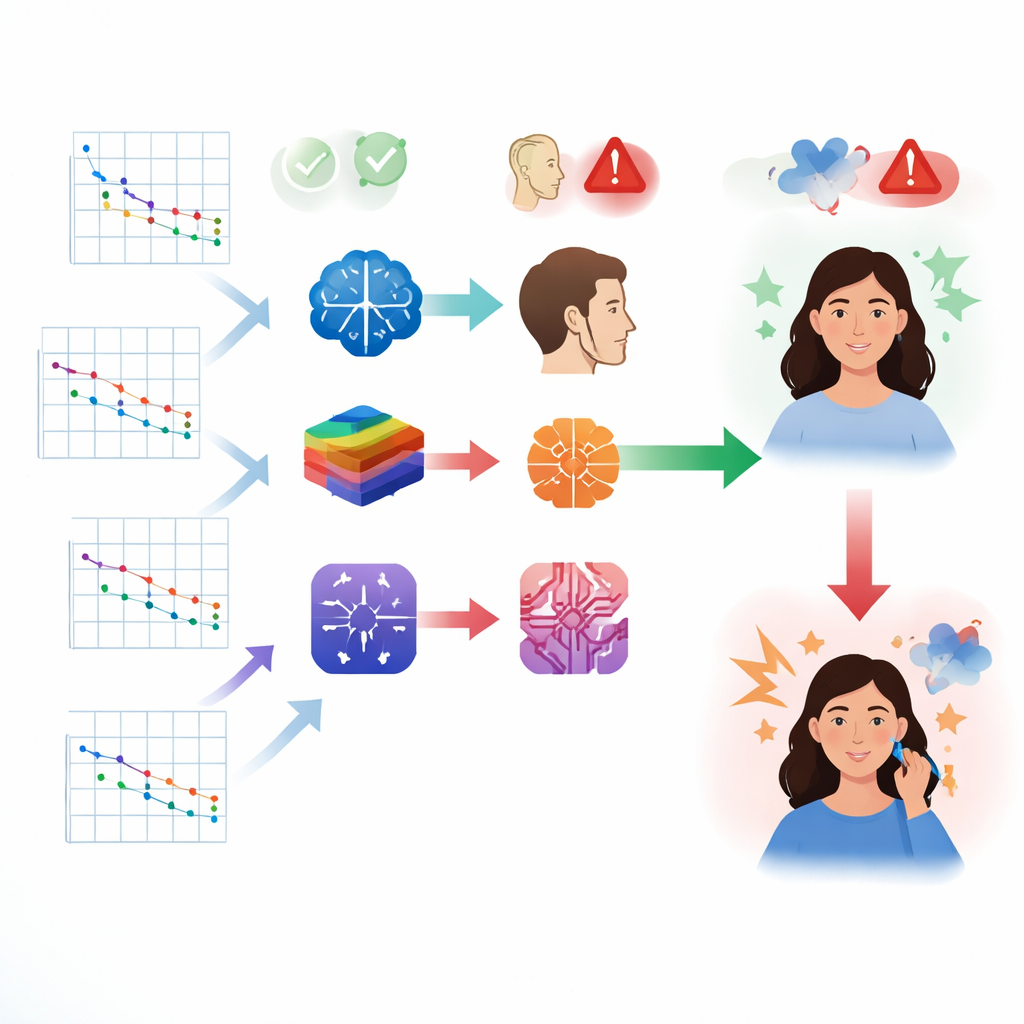

L’équipe a rassemblé 140 comptes rendus d’examen auditif réels provenant de deux centres en Chine, a supprimé les informations personnelles et a régénéré des versions standardisées des graphiques d’audiogramme. Elle a ensuite demandé à huit grands modèles de langage différents, issus d’entreprises chinoises et américaines, d’exécuter trois tâches pour chaque rapport : indiquer la sévérité de la perte auditive et son type (par exemple liée à l’oreille interne ou externe), expliquer les résultats dans un langage accessible au patient, et proposer des recommandations pratiques comme quand consulter ou envisager une aide auditive. Toutes les sorties des modèles ont été collectées dans des conditions contrôlées et évaluées a posteriori par des cliniciens expérimentés et par des volontaires non spécialistes qui ignoraient quel modèle avait produit quelle réponse.

Quelle précision des machines pour diagnostiquer la perte auditive

Lorsqu’il s’agissait de se comporter comme un spécialiste auditif virtuel, les performances des modèles étaient mitigées. Le système le plus performant, DeepSeek‑V3, a correctement évalué la sévérité de la perte auditive dans environ deux tiers des cas et identifié le type large de perte un peu plus d’une fois sur deux. D’autres modèles faisaient souvent moins bien, et la précision globale restait bien inférieure à celle attendue d’un clinicien formé. Les chercheurs ont aussi testé d’autres façons de présenter l’information aux modèles, par exemple en ajoutant des données numériques plus structurées en complément des images. Ces modifications ont amélioré la précision pour la plupart des systèmes, ce qui suggère que la manière dont l’information est présentée peut être tout aussi importante que la puissance du modèle.

Explications utiles, mais détails inventés préoccupants

Au‑delà de la précision brute, l’étude a examiné la lisibilité et la fiabilité des explications fournies par les chatbots. Certains modèles produisaient des réponses longues et verbeuses, tandis que d’autres étaient plus concis. Seuls les modèles DeepSeek ont systématiquement rédigé à un niveau de lecture adapté à une personne de niveau collège, conforme aux recommandations de littératie en santé des principales organisations médicales. Cependant, plusieurs systèmes manifestaient une tendance inquiétante à « halluciner », inventant des détails absents des rapports originaux. Dans environ une réponse sur quatre pour certains modèles, le chatbot fabriquait des chiffres, déformait les seuils auditifs ou recommandait des appareils inexistants et des parcours de traitement irréalistes. En revanche, un modèle Gemini présentait beaucoup moins d’hallucinations, bien que sa précision médicale ne fût pas la plus élevée.

Ce que pensaient les experts et les utilisateurs ordinaires

Les cliniciens ont évalué les modèles sur la précision, l’exhaustivité et l’utilité pratique de leurs réponses. Là encore, DeepSeek‑V3 et son modèle compagnon se sont généralement classés en tête pour la qualité professionnelle, offrant des interprétations structurées et des recommandations ciblées conformes à la pratique clinique. Pourtant, lorsque le grand public a évalué ces mêmes réponses, les priorités ont évolué. Les non‑experts ont préféré les modèles plus faciles à suivre, plus conversationnels et plus soutenants sur le plan émotionnel, même s’ils n’étaient pas les plus précis sur le plan médical. Les modèles Gemini ont particulièrement bien été notés pour la clarté, l’empathie et la satisfaction globale, mettant en lumière une tension entre les normes professionnelles strictes et les besoins de communication centrée sur le patient.

Pourquoi cela compte pour les personnes ayant des problèmes d’audition

La perte auditive est répandue, et beaucoup de personnes ne reçoivent jamais une explication claire de leurs résultats d’examen. Cette étude montre que les chatbots actuels ne sont pas prêts à remplacer les audiologistes ni à poser des diagnostics autonomes à partir des graphiques auditifs. Leurs taux d’erreur et leurs détails parfois inventés pourraient induire les patients en erreur s’ils sont utilisés sans supervision. En même temps, ces modèles présentent déjà des forces réelles : transformer des graphiques denses en langage clair, offrir des conseils initiaux et réduire l’anxiété pour des personnes qui n’auraient autrement personne à qui poser des questions. Utilisés avec précaution, assortis d’avertissements clairs et sous la supervision de professionnels de l’audition, ces outils pourraient devenir des assistants précieux pour combler les lacunes d’accès aux soins, améliorer la compréhension et encourager une prise en charge plus précoce de la santé auditive.

Citation: Liang, J., Xing, M., Xiang, P. et al. A multicenter multifunctional assessment of large language models in pure-tone audiogram interpretation for patients. npj Digit. Med. 9, 348 (2026). https://doi.org/10.1038/s41746-026-02537-1

Mots-clés: perte auditive, audiogramme tonal pur, grands modèles de langage, communication avec le patient, santé numérique