Clear Sky Science · pt

Aprendizado de máquina interpretável para projeto de materiais termoelétricos com redes Kolmogorov–Arnold

Convertendo Calor em Energia Útil

Todos os dias, enormes quantidades de energia são perdidas como calor residual em motores de automóveis, fábricas e até em nossos eletrônicos. Materiais termoelétricos oferecem uma forma de converter parte desse calor desperdiçado diretamente em eletricidade, sem peças móveis e sem combustível. Mas encontrar novos materiais que façam isso de forma eficiente é difícil, pois seu desempenho depende de várias propriedades eletrônicas fortemente interligadas. Este estudo explora um novo tipo de inteligência artificial que não apenas prevê quão bom um material será, mas também explica por quê—abrindo um caminho mais claro para projetar compostos termoelétricos melhores.

Por que é Difícil Encontrar Materiais Melhores para Converter Calor em Energia

Dispositivos termoelétricos dependem de materiais que geram uma tensão quando um lado está quente e o outro frio. Sua eficiência é resumida por uma grandeza chamada zT, que depende de três ingredientes principais: quão fortemente os portadores de carga respondem à temperatura (o coeficiente de Seebeck), quão facilmente eles se movem (condutividade elétrica) e quão bem o material conduz calor (condutividade térmica). Melhorar um desses aspectos frequentemente prejudica outro—por exemplo, tornar um material mais condutor eletricamente pode também torná-lo conduzir calor demais, reduzindo a eficiência. Simulações tradicionais de mecânica quântica, como a teoria do funcional da densidade, podem prever essas propriedades a partir da estrutura atômica, mas são tão custosas computacionalmente que não podem ser aplicadas a milhões de candidatos.

Modelos Caixa‑Preta e a Necessidade de Entendimento

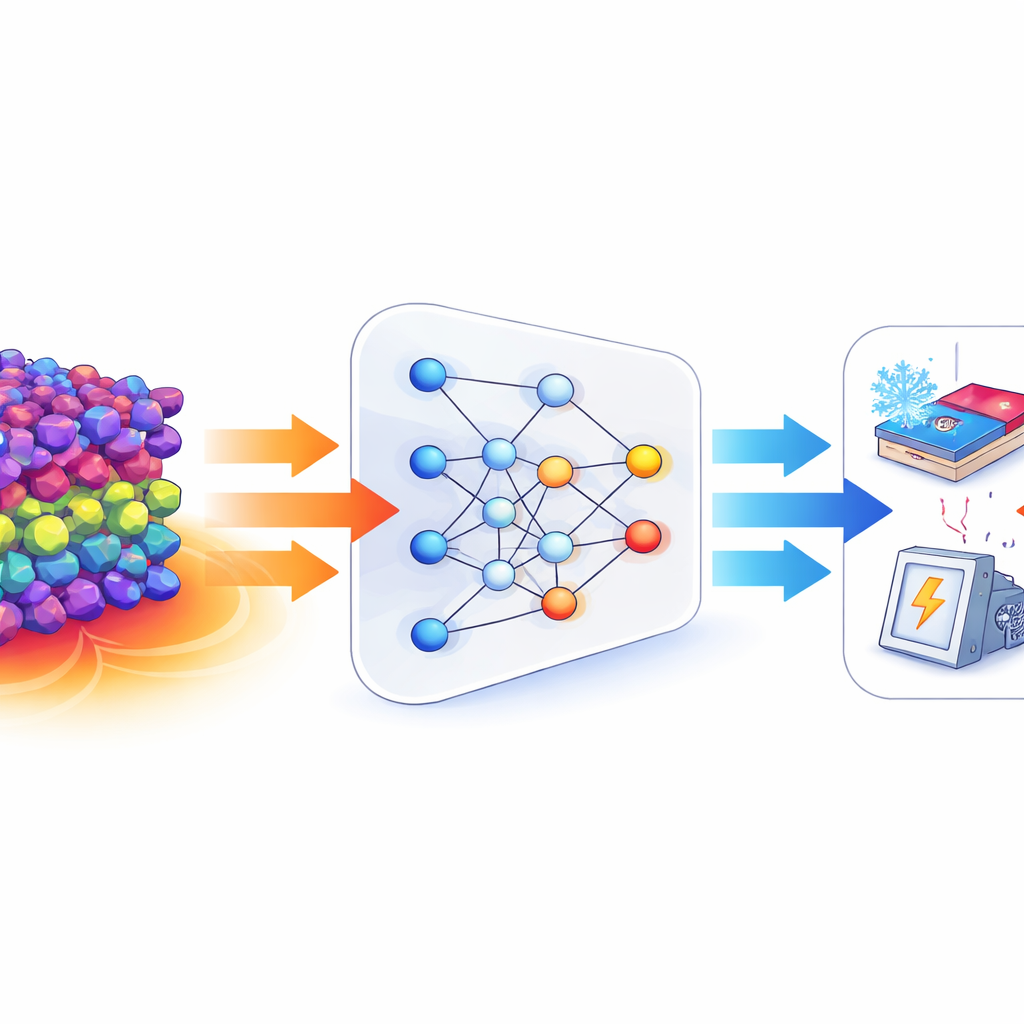

Modelos de aprendizado de máquina tornaram-se recentemente ferramentas poderosas para estimar rapidamente propriedades de materiais com base em simulações e experimentos anteriores. Neste trabalho, os autores partem de descrições numéricas ricas de estruturas cristalinas produzidas por um codificador especializado chamado "Crystalformer", que captura como os átomos estão arranjados e interagem em um cristal. Eles primeiro treinam um perceptron multicamada padrão—um modelo comum de aprendizado profundo—para prever duas quantidades-chave: o coeficiente de Seebeck e a banda proibida eletrônica, que influencia quão facilmente um material pode abrigar portadores de carga móveis. Esse modelo alcança alta precisão em ambas as tarefas ao longo de um grande conjunto de dados de cerca de 15.000 compostos. No entanto, como a maioria das redes profundas, ele se comporta como uma caixa‑preta, oferecendo pouca orientação sobre quais características estruturais realmente importam ou como elas se combinam para controlar a resposta termoelétrica.

Um Tipo Diferente de Rede Neural

A ideia central do artigo é substituir redes neurais opacas por Redes Kolmogorov–Arnold, ou KANs. Em vez de ocultar toda a complexidade nas ativações dos neurônios, as KANs acoplam funções flexíveis, unidimensionais e semelhantes a curvas às conexões entre camadas. Matematicamente, essas curvas são splines suaves que se adaptam aos dados, e o modelo geral pode ser escrito como uma soma de funções simples dos descritores de entrada. Após o treinamento, os autores ajustam expressões matemáticas concisas—construídas a partir de funções familiares como senos, cossenos e curvas de saturação suaves—a esses splines aprendidos. Dessa forma, o modelo torna‑se uma fórmula simbólica explícita que vincula descritores estruturais à banda proibida e ao coeficiente de Seebeck, em vez de um emaranhado de parâmetros opacos. Embora as KANs sejam mais custosas de treinar, elas alcançam precisão comparável a, e em alguns regimes melhor do que, o perceptron multicamada e vários outros modelos de aprendizado de máquina da literatura.

O que o Modelo Aprende sobre Materiais

Ao examinar a estrutura interna da KAN, os autores mostram que apenas um subconjunto dos 128 descritores estruturais influencia fortemente cada propriedade. Eles computam escores de atribuição para identificar os descritores mais importantes e então podam conexões fracas, deixando uma rede esparsa e mais fácil de interpretar que ainda prevê bem. Usando pares de descritores mais bem classificados, constroem mapas bidimensionais que mostram como a banda proibida prevista ou o coeficiente de Seebeck variam no espaço dos descritores. Esses mapas revelam efeitos cooperativos e suaves, onde tendências oscilatórias e de saturação se combinam, em vez de regras simples um‑para‑um. Quimicamente, o modelo tem mais dificuldade em sistemas complexos com ligação altamente direcionada ou elétrons d e f fortemente interagentes, mas mesmo nesses casos as KANs produzem previsões mais estáveis e fisicamente sensatas do que o modelo caixa‑preta. Por exemplo, geram menos gaps de banda negativos não físicos e menos valores de Seebeck com sinal errado.

Da Previsão ao Projeto Guiado

Porque as KANs produzem fórmulas explícitas e suaves em vez de apenas previsões numéricas, elas podem ser usadas para explorar como mudanças nos descritores subjacentes alterariam o desempenho termoelétrico. Embora esses descritores ainda sejam quantidades abstratas derivadas de um codificador estrutural profundo, eles se correlacionam com características reais de arranjos atômicos e ligações. Isso significa que pesquisadores podem usar o modelo analítico KAN como uma espécie de mapa: ao escaneá‑lo em busca de regiões associadas a alto coeficiente de Seebeck e banda proibida adequada, podem restringir materiais promissores e então vincular esses padrões de descritor de volta a estruturas cristalinas candidatas em grandes bancos de dados ou em ferramentas de design generativo.

O que Isso Significa para Materiais Futuros

Para um leitor leigo, a mensagem-chave é que este trabalho nos aproxima de uma inteligência artificial "caixa de vidro" para descoberta de materiais. Redes Kolmogorov–Arnold apresentam desempenho quase tão bom quanto os melhores preditores caixa‑preta, mas também expõem, em forma matemática, como características estruturais de um cristal estão ligadas à sua capacidade de converter calor em eletricidade. Essa combinação de velocidade, precisão e interpretabilidade pode ajudar cientistas a tomar decisões informadas sobre quais novos compostos sintetizar e testar, potencialmente encurtando o caminho de dados brutos até dispositivos termoelétricos reais que aproveitem o calor residual e melhorem a eficiência energética.

Citação: Fronzi, M., Ford, M.J., Nayal, K.S. et al. Interpretable machine learning for thermoelectric materials design with Kolmogorov–Arnold networks. Sci Rep 16, 14146 (2026). https://doi.org/10.1038/s41598-026-44723-x

Palavras-chave: materiais termoelétricos, aprendizado de máquina interpretável, redes Kolmogorov–Arnold, projeto de materiais, coeficiente de Seebeck