Clear Sky Science · pl

Interpretowalne uczenie maszynowe do projektowania materiałów termoelektrycznych z użyciem sieci Kolmogorova–Arnolda

Przekształcanie ciepła w użyteczną energię

Każdego dnia ogromne ilości energii tracone są jako odpadowe ciepło z silników samochodowych, fabryk, a nawet naszych urządzeń elektronicznych. Materiały termoelektryczne pozwalają zamienić część tego odpadowego ciepła bezpośrednio w elektryczność, bez ruchomych części i paliwa. Jednak znalezienie nowych materiałów o wysokiej sprawności jest trudne, ponieważ ich wydajność zależy od kilku ściśle powiązanych właściwości elektronowych. W tym badaniu analizuje się nowy rodzaj sztucznej inteligencji, która nie tylko potrafi przewidzieć, jak dobry będzie materiał, lecz także wyjaśnić dlaczego — otwierając jaśniejszą drogę do projektowania lepszych związków termoelektrycznych.

Dlaczego trudno znaleźć lepsze materiały przetwarzające ciepło na energię

Urządzenia termoelektryczne opierają się na materiałach, które generują napięcie, gdy jedna strona jest gorąca, a druga zimna. Ich sprawność opisuje wielkość oznaczana jako zT, która zależy od trzech głównych składników: jak silnie nośniki ładunku reagują na temperaturę (współczynnik Seebecka), jak łatwo się poruszają (przewodność elektryczna) oraz jak dobrze materiał przewodzi ciepło (przewodność cieplna). Poprawa jednego z tych parametrów często szkodzi pozostałym — na przykład zwiększenie przewodności elektrycznej może jednocześnie poprawić przewodność cieplną, obniżając efektywność. Tradycyjne symulacje mechaniki kwantowej, takie jak teoria funkcjonału gęstości, potrafią przewidzieć te własności na podstawie struktury atomowej, lecz są tak kosztowne obliczeniowo, że nie da się ich zastosować do milionów kandydatów materiałowych.

Modele czarnych skrzynek i potrzeba wglądu

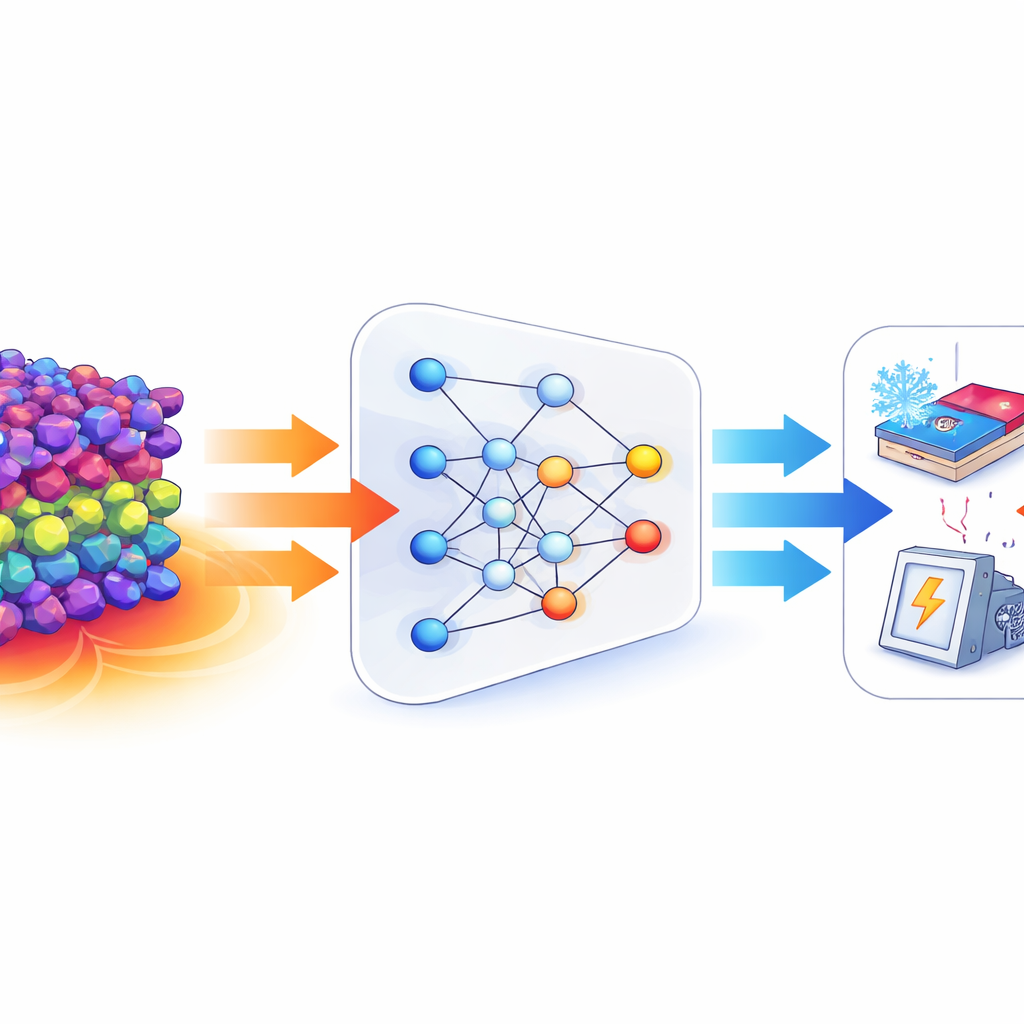

Modele uczenia maszynowego stały się ostatnio potężnym narzędziem do szybkiego oszacowania właściwości materiałów na podstawie wcześniejszych symulacji i eksperymentów. W tej pracy autorzy rozpoczynają od bogatych opisów numerycznych struktur krystalicznych wygenerowanych przez wyspecjalizowany enkoder „Crystalformer”, który uchwyca rozmieszczenie i wzajemne oddziaływania atomów w krysztale. Najpierw trenują standardowy perceptron wielowarstwowy — powszechny model głębokiego uczenia — do przewidywania dwóch kluczowych wielkości: współczynnika Seebecka i przerwy energetycznej (band gap), która wpływa na to, jak łatwo materiał może gościć ruchome nośniki ładunku. Model osiąga wysoką dokładność w obu zadaniach na dużym zbiorze danych obejmującym około 15 000 związków. Jednak, jak większość głębokich sieci, zachowuje się jak czarna skrzynka, nie dostarczając wskazówek, które cechy strukturalne naprawdę mają znaczenie ani jak się łączą, by kontrolować odpowiedź termoelektryczną.

Inny rodzaj sieci neuronowej

Główny pomysł artykułu polega na zastąpieniu nieprzejrzystych sieci neuronowych sieciami Kolmogorova–Arnolda, zwanymi KAN. Zamiast ukrywać całą złożoność wewnątrz aktywacji neuronów, KAN-y przyłączają elastyczne, jednowymiarowe funkcje przypominające krzywe do połączeń między warstwami. Matematycznie są to gładkie sklejane funkcje (splajny), które dopasowują się do danych, a cały model można zapisać jako sumę prostych funkcji deskryptorów wejściowych. Po trenowaniu autorzy dopasowują zwięzłe wyrażenia matematyczne — zbudowane z dobrze znanych funkcji, takich jak sinusy, cosinusy i gładkie funkcje nasycenia — do tych nauczonych splajnów. W ten sposób model staje się jawnie symboliczną formułą łączącą deskryptory strukturalne z przerwą energetyczną i współczynnikiem Seebecka, zamiast plątaniny nieprzejrzystych parametrów. Choć trenowanie KAN-ów jest bardziej kosztowne obliczeniowo, osiągają one dokładność porównywalną, a w niektórych przypadkach lepszą niż perceptron wielowarstwowy i kilka innych bazowych metod uczenia maszynowego z literatury.

Czego model uczy się o materiałach

Analizując wewnętrzną strukturę KAN-a, autorzy pokazują, że tylko podzbiór z 128 deskryptorów strukturalnych silnie wpływa na każdą z właściwości. Obliczają miary atrybucji, aby zidentyfikować najważniejsze deskryptory, a następnie przycinają słabe połączenia, pozostawiając rzadką, łatwiejszą do interpretacji sieć, która wciąż dobrze przewiduje wyniki. Używając par najwyżej ocenionych deskryptorów, budują mapy dwuwymiarowe pokazujące, jak przewidywana przerwa energetyczna lub współczynnik Seebecka zmieniają się w przestrzeni deskryptorów. Mapy te ujawniają gładkie, kooperatywne efekty, gdzie oscylacyjne i nasycające trendy łączą się, zamiast prostych reguł jeden-do-jednego. Chemicznie model ma największe trudności w złożonych systemach o wyraźnie kierunkowym wiązaniu lub silnie oddziałujących elektronach d i f, ale nawet tam KAN-y dają stabilniejsze i bardziej fizycznie sensowne przewidywania niż model czarnej skrzynki. Na przykład generują mniej niefizycznych ujemnych przerw energetycznych i mniej błędnych znaków współczynnika Seebecka.

Od przewidywania do ukierunkowanego projektowania

Ponieważ KAN-y zwracają jawne, gładkie wzory zamiast jedynie wartości liczbowych, można ich użyć do badania, jak zmiana podstawowych deskryptorów wpłynęłaby na wydajność termoelektryczną. Choć deskryptory te pozostają abstrakcyjnymi wielkościami wyprowadzonymi z głębokiego enkodera strukturalnego, korelują one z rzeczywistymi cechami rozmieszczenia atomów i wiązań. Oznacza to, że naukowcy mogą używać analitycznego modelu KAN jako pewnego rodzaju mapy: skanując obszary powiązane z wysokim współczynnikiem Seebecka i odpowiednią przerwą energetyczną, można zawęzić kandydatów materiałowych, a następnie odnieść wzory deskryptorów do konkretnych struktur krystalicznych w dużych bazach danych lub narzędziach generatywnych do projektowania.

Co to oznacza dla przyszłości materiałów

Dla czytelnika niebędącego specjalistą kluczowym przesłaniem jest to, że praca ta przybliża nas do „szklanej skrzynki” sztucznej inteligencji w odkrywaniu materiałów. Sieci Kolmogorova–Arnolda działają niemal tak dobrze jak najlepsze predyktory-czarne skrzynki, ale dodatkowo przedstawiają w formie matematycznej, jak cechy strukturalne kryształu wiążą się z jego zdolnością do zamiany ciepła w elektryczność. To połączenie szybkości, dokładności i interpretowalności może pomóc naukowcom podejmować świadome decyzje, które nowe związki syntezować i badać, skracając potencjalnie drogę od surowych danych do rzeczywistych urządzeń termoelektrycznych, które odzyskują odpadowe ciepło i poprawiają efektywność energetyczną.

Cytowanie: Fronzi, M., Ford, M.J., Nayal, K.S. et al. Interpretable machine learning for thermoelectric materials design with Kolmogorov–Arnold networks. Sci Rep 16, 14146 (2026). https://doi.org/10.1038/s41598-026-44723-x

Słowa kluczowe: materiały termoelektryczne, interpretowalne uczenie maszynowe, sieci Kolmogorova–Arnolda, projektowanie materiałów, współczynnik Seebecka