Clear Sky Science · nl

Interpreteerbare machine learning voor het ontwerpen van thermische materialen met Kolmogorov–Arnold-netwerken

Warmte omzetten in bruikbare energie

Elke dag gaat enorme hoeveelheden energie verloren als restwarmte van automotoren, fabrieken en zelfs onze eigen elektronica. Thermo-elektrische materialen bieden een manier om een deel van die restwarmte rechtstreeks in elektriciteit om te zetten, zonder bewegende delen en zonder brandstof. Nieuwe materialen vinden die dit efficiënt doen is echter moeilijk, omdat hun prestatie afhangt van meerdere nauw verbonden elektronische eigenschappen. Deze studie onderzoekt een nieuw soort kunstmatige intelligentie die niet alleen kan voorspellen hoe goed een materiaal zal presteren, maar ook kan uitleggen waarom—waardoor het ontwerpen van betere thermo-elektrische verbindingen helderder wordt.

Waarom betere warmte-naar-stroom-materialen moeilijk te vinden zijn

Thermo-elektrische apparaten vertrouwen op materialen die een spanning genereren wanneer de ene zijde warm en de andere koud is. Hun efficiëntie wordt vastgelegd door een grootheid die zT heet, die afhangt van drie hoofdingrediënten: hoe sterk ladingsdragers reageren op temperatuur (de Seebeck-coëfficiënt), hoe gemakkelijk ze bewegen (elektrische geleidbaarheid) en hoe goed het materiaal warmte transporteert (thermische geleidbaarheid). Verbetering van het één schaadt vaak het ander—bijvoorbeeld, een materiaal beter elektrisch geleidend maken kan er ook voor zorgen dat het warmte te goed geleidt, waardoor de efficiëntie daalt. Traditionele kwantummechanische simulaties, zoals dichtheidsfunctionaaltheorie, kunnen deze eigenschappen uit de atomaire structuur voorspellen, maar ze zijn zo rekenkundig kostbaar dat ze niet op miljoenen kandidaatmaterialen toepasbaar zijn.

Black-boxmodellen en de behoefte aan inzicht

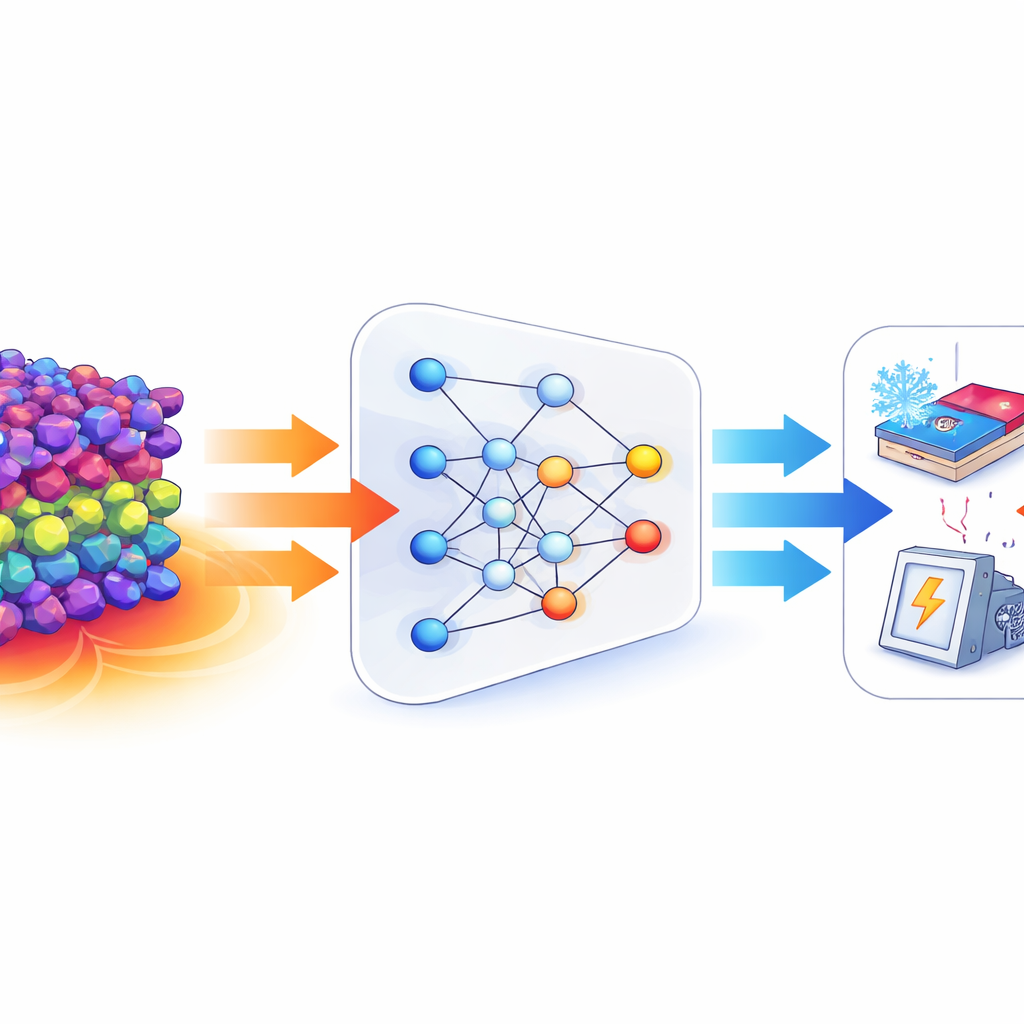

Machine-learningmodellen zijn recent krachtige middelen geworden om materiaaleigenschappen snel te schatten op basis van eerdere simulaties en experimenten. In dit werk vertrekken de auteurs van rijke numerieke beschrijvingen van kristalstructuren geproduceerd door een gespecialiseerde "Crystalformer"-encoder, die vastlegt hoe atomen zijn gerangschikt en met elkaar interageren in een kristal. Ze trainen eerst een standaard multilayer perceptron—een veelgebruikt deep-learningmodel—om twee belangrijke grootheden te voorspellen: de Seebeck-coëfficiënt en de elektronische bandopening (band gap), die beïnvloedt hoe gemakkelijk een materiaal mobiele ladingsdragers kan herbergen. Dit model bereikt hoge nauwkeurigheid voor beide taken over een grote dataset van ongeveer 15.000 verbindingen. Zoals de meeste diepe netwerken gedraagt het zich echter als een black box en biedt het weinig aanwijzingen welke structurele kenmerken echt belangrijk zijn of hoe ze samenwerken om de thermo-elektrische respons te beheersen.

Een ander soort neuraal netwerk

Het centrale idee van het artikel is om ondoorzichtige neurale netwerken te vervangen door Kolmogorov–Arnold-netwerken, of KANs. In plaats van alle complexiteit verborgen te houden in neuronactivaties, koppelen KANs flexibele, eendimensionale curveachtige functies aan de verbindingen tussen lagen. Wiskundig zijn deze curves gladde splines die zich aanpassen aan de data, en het totale model kan worden geschreven als een som van eenvoudige functies van de invoerbeschrijvingen. Na training passen de auteurs beknopte wiskundige uitdrukkingen—gebouwd uit vertrouwde functies zoals sinussen, cosinussen en gladde saturatiecurven—op deze geleerde splines. Op die manier wordt het model een expliciete symbolische formule die structurele descriptoren koppelt aan de bandopening en Seebeck-coëfficiënt, in plaats van een kluwen van ondoorzichtige parameters. Hoewel KANs rekenkundig duurder zijn om te trainen, bereiken ze een nauwkeurigheid die vergelijkbaar is met, en in sommige regimes beter dan, het multilayer perceptron en verschillende andere machine-learning-baselines uit de literatuur.

Wat het model over materialen leert

Door de interne structuur van de KAN te analyseren, laten de auteurs zien dat slechts een subset van de 128 structurele descriptoren sterk van invloed is op elke eigenschap. Ze berekenen attributiescores om de belangrijkste descriptoren te identificeren en snoeien vervolgens zwakke verbindingen weg, waardoor een sparsere, makkelijker te interpreteren netwerkstructuur overblijft die nog steeds goed voorspelt. Met paren van hoog gerangschikte descriptoren bouwen ze tweedimensionale kaarten die laten zien hoe de voorspelde bandopening of Seebeck-coëfficiënt varieert door descriptorruimte. Deze kaarten onthullen vloeiende, cooperatieve effecten, waarbij oscillerende en verzadigende trends samengaan, in plaats van eenvoudige één-op-één regels. Chemisch worstelt het model het meest met complexe systemen met sterk directionele binding of sterk interactieve d- en f-elektronen, maar zelfs daar leveren KANs stabielere en fysisch zinvollere voorspellingen dan het black-boxmodel. Zo produceren ze bijvoorbeeld minder onfysische negatieve bandopeningen en minder Seebeck-waarden met de verkeerde teken.

Van voorspelling naar gericht ontwerp

Aangezien KANs expliciete, gladde formules opleveren in plaats van alleen numerieke voorspellingen, kunnen ze worden gebruikt om te verkennen hoe het wijzigen van onderliggende descriptoren de thermo-elektrische prestaties zou verschuiven. Hoewel deze descriptoren nog steeds abstracte grootheden zijn afgeleid van een diepe structurele encoder, correleren ze met reële kenmerken van atomaire ordening en binding. Dit betekent dat onderzoekers het analytische KAN-model als een soort kaart kunnen gebruiken: door het te doorzoeken op regio's die samenhangen met hoge Seebeck-coëfficiënt en geschikte bandopening, kunnen ze veelbelovende materialen verfijnen en die descriptorpatronen vervolgens terugkoppelen naar kandidaatkristalstructuren in grote databanken of generatieve ontwerptools.

Wat dit betekent voor toekomstige materialen

Voor een niet-specialistische lezer is de kernboodschap dat dit werk ons dichter bij "glasbox"-kunstmatige intelligentie voor materiaalontdekking brengt. Kolmogorov–Arnold-netwerken presteren bijna net zo goed als de beste black-box-voorspellers, maar leggen ook wiskundig vast hoe structurele kenmerken van een kristal samenhangen met zijn vermogen om warmte in elektriciteit om te zetten. Die combinatie van snelheid, nauwkeurigheid en interpreteerbaarheid kan wetenschappers helpen weloverwogen keuzes te maken over welke nieuwe verbindingen te synthetiseren en te testen, en zo mogelijk het pad te verkorten van ruwe data naar praktische thermo-elektrische apparaten die restwarmte oogsten en de energie-efficiëntie verbeteren.

Bronvermelding: Fronzi, M., Ford, M.J., Nayal, K.S. et al. Interpretable machine learning for thermoelectric materials design with Kolmogorov–Arnold networks. Sci Rep 16, 14146 (2026). https://doi.org/10.1038/s41598-026-44723-x

Trefwoorden: thermo-elektrische materialen, interpreteerbare machine learning, Kolmogorov–Arnold-netwerken, materiaalontwerp, Seebeck-coëfficiënt