Clear Sky Science · de

Interpretierbares maschinelles Lernen für das Design thermoelektrischer Materialien mit Kolmogorov–Arnold-Netzwerken

Wärme in nützliche Energie verwandeln

Tagtäglich gehen enorme Energiemengen als Abwärme bei Fahrzeugmotoren, in Fabriken und sogar in unserer Elektronik verloren. Thermoelektrische Materialien bieten eine Möglichkeit, einen Teil dieser Abwärme direkt in Elektrizität umzuwandeln — ohne bewegliche Teile und ohne Brennstoff. Neue Materialien zu finden, die dies effizient tun, ist jedoch schwierig, weil ihre Leistung von mehreren eng verknüpften elektronischen Eigenschaften abhängt. Diese Studie untersucht eine neue Art künstlicher Intelligenz, die nicht nur vorhersagen kann, wie gut ein Material ist, sondern auch erklären kann, warum — und so einen klareren Weg zum Entwurf besserer thermoelektrischer Verbindungen eröffnet.

Warum es schwer ist, bessere Wärme-zu-Strom-Materialien zu finden

Thermoelektrische Bauteile beruhen auf Materialien, die eine Spannung erzeugen, wenn eine Seite warm und die andere kalt ist. Ihre Effizienz wird durch eine Kennzahl namens zT erfasst, die von drei Hauptelementen abhängt: wie stark Ladungsträger auf Temperatur reagieren (der Seebeck-Koeffizient), wie leicht sie sich bewegen (elektrische Leitfähigkeit) und wie gut das Material Wärme leitet (thermische Leitfähigkeit). Eine Verbesserung einer Eigenschaft schadet oft einer anderen — zum Beispiel kann eine bessere elektrische Leitfähigkeit auch zu einer besseren Wärmeleitung führen und so die Effizienz verringern. Traditionelle quantenmechanische Simulationen wie die Dichtfunktionaltheorie können diese Eigenschaften aus der atomaren Struktur vorhersagen, sind aber so rechenaufwendig, dass sie nicht auf Millionen von Kandidaten anwendbar sind.

Black-Box-Modelle und der Bedarf an Einsicht

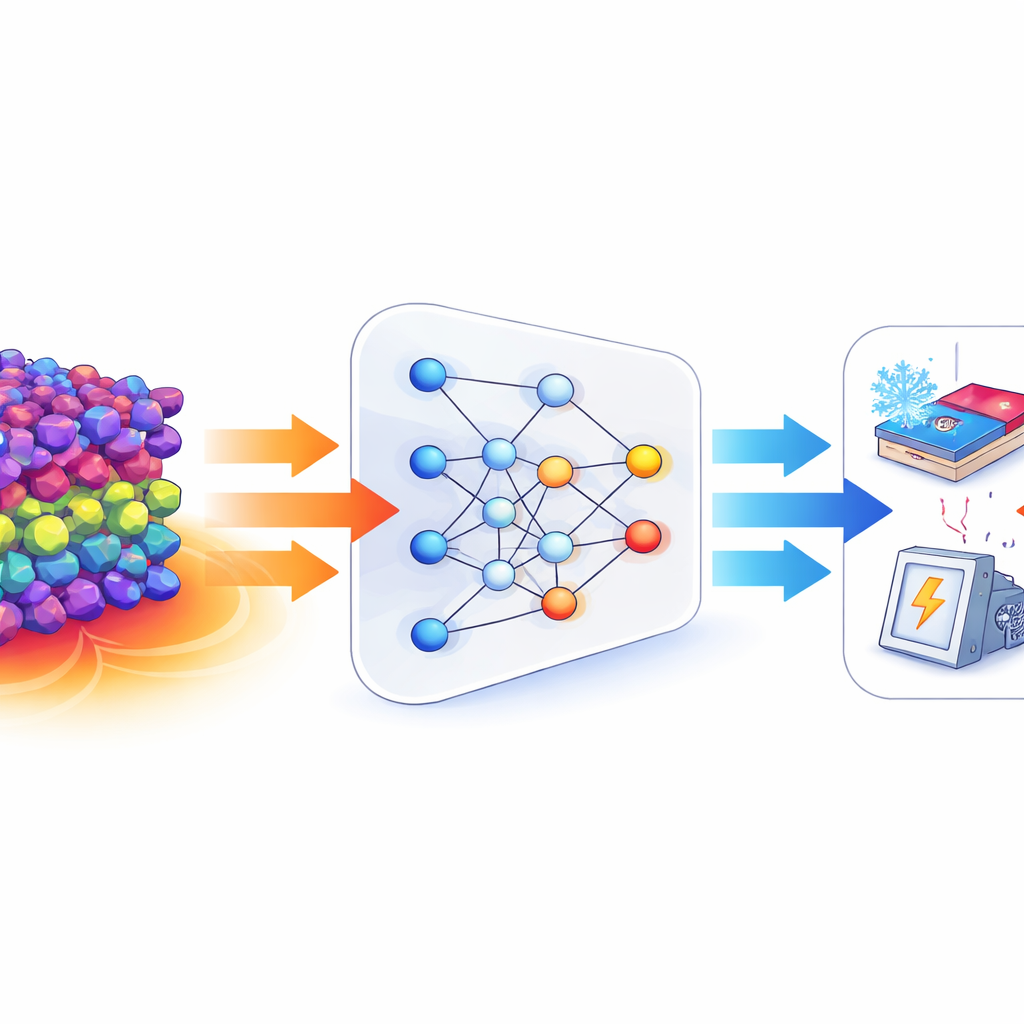

Maschinelle Lernmodelle sind in letzter Zeit zu mächtigen Werkzeugen geworden, um Materialeigenschaften schnell anhand früherer Simulationen und Experimente abzuschätzen. In dieser Arbeit starten die Autoren mit reichhaltigen numerischen Beschreibungen von Kristallstrukturen, die von einem spezialisierten "Crystalformer"-Encoder erzeugt werden und einfangen, wie Atome in einem Kristall angeordnet sind und miteinander wechselwirken. Zunächst trainieren sie ein Standard-Multilayer-Perzeptron — ein gängiges Deep-Learning-Modell — um zwei Schlüsselgrößen vorherzusagen: den Seebeck-Koeffizienten und die elektronische Bandlücke, welche beeinflusst, wie leicht ein Material bewegliche Ladungsträger aufnehmen kann. Dieses Modell erzielt hohe Genauigkeit in beiden Aufgaben über einen großen Datensatz von etwa 15.000 Verbindungen. Wie die meisten tiefen Netze bleibt es jedoch eine Black Box und gibt kaum Auskunft darüber, welche Strukturmerkmale wirklich wichtig sind oder wie sie zusammenwirken, um die thermoelektrische Antwort zu steuern.

Eine andere Art von neuronaler Netzwerkarchitektur

Die zentrale Idee der Arbeit ist, undurchsichtige neuronale Netze durch Kolmogorov–Arnold-Netzwerke (KANs) zu ersetzen. Anstatt die gesamte Komplexität in Neuronenaktivierungen zu verbergen, hängen KANs flexible, eindimensionale kurvenartige Funktionen an die Verbindungen zwischen Schichten. Mathematisch sind diese Kurven glatte Splines, die sich an die Daten anpassen, und das Gesamtmodell lässt sich als Summe einfacher Funktionen der Eingangsdeskriptoren schreiben. Nach dem Training passen die Autoren prägnante mathematische Ausdrücke — aufgebaut aus vertrauten Funktionen wie Sinus, Kosinus und glatten Sättigungskurven — an diese gelernten Splines an. Auf diese Weise wird das Modell zu einer expliziten symbolischen Formel, die Strukturdeskriptoren mit Bandlücke und Seebeck-Koeffizienten verbindet, statt zu einem Gewirr undurchsichtiger Parameter. Obwohl KANs rechenaufwändiger zu trainieren sind, erreichen sie eine vergleichbare Genauigkeit wie das Multilayer-Perzeptron und in einigen Bereichen sogar bessere Ergebnisse als mehrere andere Machine-Learning-Baselines aus der Literatur.

Was das Modell über Materialien lernt

Bei Analyse der internen Struktur des KAN zeigen die Autoren, dass nur eine Untermenge der 128 Strukturdeskriptoren jede Eigenschaft stark beeinflusst. Sie berechnen Attribution Scores, um die wichtigsten Deskriptoren zu identifizieren, und beschneiden dann schwache Verbindungen, wodurch ein sparsames, leichter interpretierbares Netzwerk übrig bleibt, das dennoch gut vorhersagt. Mit Paaren der höchstbewerteten Deskriptoren erstellen sie zweidimensionale Karten, die zeigen, wie die vorhergesagte Bandlücke oder der Seebeck-Koeffizient über den Deskriptorraum variiert. Diese Karten offenbaren glatte, kooperative Effekte, bei denen oszillierende und sättigende Trends kombiniert werden, statt einfacher Eins-zu-eins-Regeln. Chemisch hat das Modell am meisten Probleme in komplexen Systemen mit stark richtungsgebundenen Bindungen oder stark wechselwirkenden d- und f-Elektronen, doch selbst dort liefern KANs stabilere und physikalisch plausiblere Vorhersagen als das Black-Box-Modell. Zum Beispiel erzeugen sie weniger unphysikalische negative Bandlücken und weniger Seebeck-Werte mit falschem Vorzeichen.

Von der Vorhersage zur zielgerichteten Gestaltung

Weil KANs explizite, glatte Formeln anstelle rein numerischer Vorhersagen ausgeben, lassen sie sich nutzen, um zu erkunden, wie Veränderungen der zugrundeliegenden Deskriptoren die thermoelektrische Leistung verschieben würden. Zwar sind diese Deskriptoren weiterhin abstrakte Größen, die aus einem tiefen Strukturecoder abgeleitet sind, doch sie korrelieren mit realen Merkmalen der Atomanordnung und Bindung. Das bedeutet, dass Forschende das analytische KAN-Modell als eine Art Karte verwenden können: Indem sie Bereiche identifizieren, die mit hohem Seebeck-Koeffizienten und geeigneter Bandlücke assoziiert sind, können sie vielversprechende Materialien eingrenzen und diese Deskriptormuster dann auf Kandidatenkristallstrukturen in großen Datenbanken oder in generativen Designwerkzeugen zurückführen.

Was das für zukünftige Materialien bedeutet

Für eine allgemeine Leserschaft lautet die zentrale Botschaft, dass diese Arbeit uns näher an eine "Glas-Box"-Künstliche Intelligenz für die Materialentdeckung bringt. Kolmogorov–Arnold-Netzwerke erreichen nahezu die Leistung der besten Black-Box-Prädiktoren, legen aber zugleich in mathematischer Form dar, wie Strukturmerkmale eines Kristalls mit seiner Fähigkeit verknüpft sind, Wärme in Elektrizität zu verwandeln. Diese Kombination aus Geschwindigkeit, Genauigkeit und Interpretierbarkeit kann Wissenschaftlern helfen, fundierte Entscheidungen darüber zu treffen, welche neuen Verbindungen synthetisiert und getestet werden sollten, und so den Weg von Rohdaten zu realen thermoelektrischen Geräten, die Abwärme nutzbar machen und die Energieeffizienz verbessern, potenziell verkürzen.

Zitation: Fronzi, M., Ford, M.J., Nayal, K.S. et al. Interpretable machine learning for thermoelectric materials design with Kolmogorov–Arnold networks. Sci Rep 16, 14146 (2026). https://doi.org/10.1038/s41598-026-44723-x

Schlüsselwörter: thermoelektrische Materialien, interpretierbares maschinelles Lernen, Kolmogorov–Arnold-Netzwerke, Materialdesign, Seebeck-Koeffizient