Clear Sky Science · it

Apprendimento automatico interpretabile per la progettazione di materiali termoelettrici con reti di Kolmogorov–Arnold

Trasformare il calore in energia utile

Ogni giorno grandi quantità di energia vanno perdute come calore residuo dai motori delle auto, dalle fabbriche e persino dai nostri dispositivi elettronici. I materiali termoelettrici offrono un modo per convertire direttamente parte di quel calore di scarto in elettricità, senza parti in movimento e senza combustibile. Ma individuare nuovi materiali efficienti è difficile, perché le loro prestazioni dipendono da diverse proprietà elettroniche fortemente correlate. Questo studio esplora un nuovo tipo di intelligenza artificiale che non solo può prevedere quanto è efficace un materiale, ma spiega anche il perché — aprendo una via più chiara alla progettazione di composti termoelettrici migliori.

Perché è difficile trovare materiali migliori per convertire il calore in energia

I dispositivi termoelettrici si basano su materiali che generano una tensione quando un lato è caldo e l'altro è freddo. La loro efficienza è descritta da un parametro chiamato zT, che dipende da tre ingredienti principali: quanto fortemente i portatori di carica rispondono alla temperatura (il coefficiente di Seebeck), quanto facilmente si muovono (conduttività elettrica) e quanto bene il materiale conduce il calore (conduttività termica). Migliorare uno di questi aspetti spesso peggiora un altro — per esempio, rendere un materiale più conduttivo elettricamente può aumentarne anche la conduzione del calore, riducendo l'efficienza. Le simulazioni quantistiche tradizionali, come la teoria del funzionale della densità, possono prevedere queste proprietà a partire dalla struttura atomica, ma sono così costose dal punto di vista computazionale da non poter essere applicate a milioni di materiali candidati.

Modelli a scatola nera e bisogno di comprensione

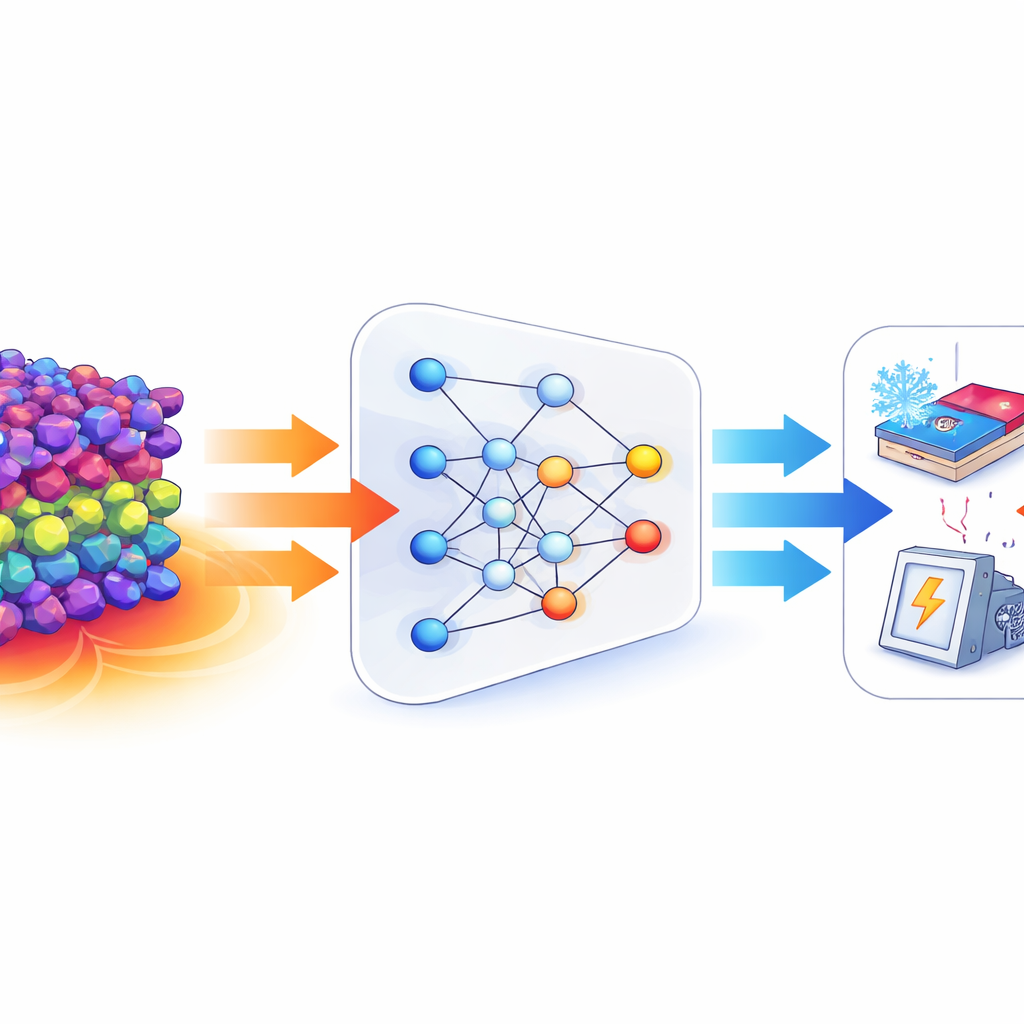

I modelli di machine learning sono recentemente diventati strumenti potenti per stimare rapidamente le proprietà dei materiali basandosi su simulazioni ed esperimenti passati. In questo lavoro, gli autori partono da descrizioni numeriche ricche delle strutture cristalline prodotte da un codificatore specializzato chiamato "Crystalformer", che cattura come gli atomi sono disposti e interagiscono in un cristallo. Addestrano prima un perceptron multistrato standard — un modello di deep learning comune — per prevedere due quantità chiave: il coefficiente di Seebeck e il gap elettronico, che influenza quanto facilmente un materiale può ospitare portatori di carica mobili. Questo modello raggiunge elevata accuratezza in entrambi i compiti su un ampio set di dati di circa 15.000 composti. Tuttavia, come la maggior parte delle reti profonde, si comporta come una scatola nera, offrendo scarsa indicazione su quali caratteristiche strutturali contino davvero o su come si combinino per controllare la risposta termoelettrica.

Un tipo diverso di rete neurale

L'idea centrale dell'articolo è sostituire le reti neurali opache con le Reti di Kolmogorov–Arnold, o KAN. Invece di nascondere tutta la complessità nelle attivazioni dei neuroni, le KAN collegano funzioni flessibili monodimensionali simili a curve alle connessioni tra i livelli. Matematicamente, queste curve sono spline lisce che si adattano ai dati, e il modello complessivo può essere scritto come somma di funzioni semplici dei descrittori di input. Dopo l'addestramento, gli autori adattano espressioni matematiche sintetiche — costruite con funzioni familiari come seni, coseni e curve di saturazione lisce — a queste spline apprese. In questo modo il modello diventa una formula simbolica esplicita che collega i descrittori strutturali al gap di banda e al coefficiente di Seebeck, anziché un groviglio di parametri opachi. Sebbene le KAN richiedano più risorse computazionali per l'addestramento, ottengono un'accuratezza paragonabile, e in alcuni regimi superiore, al perceptron multistrato e a diversi altri modelli di machine learning presenti in letteratura.

Cosa impara il modello sui materiali

Esaminando la struttura interna delle KAN, gli autori mostrano che solo un sottoinsieme dei 128 descrittori strutturali influenza fortemente ogni proprietà. Calcolano punteggi di attribuzione per identificare i descrittori più importanti e quindi potano le connessioni deboli, lasciando una rete sparsa e più facile da interpretare che tuttavia predice ancora bene. Usando coppie di descrittori ai primi posti, costruiscono mappe bidimensionali che mostrano come il gap di banda previsto o il coefficiente di Seebeck varino nello spazio dei descrittori. Queste mappe rivelano effetti cooperativi e continui, dove tendenze oscillatorie e di saturazione si combinano, invece di regole semplici uno-a-uno. Dal punto di vista chimico, il modello presenta più difficoltà nei sistemi complessi con legami altamente direzionali o con forti interazioni di elettroni d e f, ma anche in quei casi le KAN producono previsioni più stabili e fisicamente sensate rispetto al modello a scatola nera. Per esempio, generano meno gap di banda negativi non fisici e meno valori del Seebeck con segno scorretto.

Dalla previsione alla progettazione guidata

Poiché le KAN restituiscono formule esplicite e lisce anziché sole previsioni numeriche, possono essere usate per esplorare come la variazione dei descrittori influenzi le prestazioni termoelettriche. Pur essendo descrittori ancora astratti derivati da un codificatore strutturale profondo, essi correlano con caratteristiche reali degli ordinamenti atomici e del legame. Ciò significa che i ricercatori possono usare il modello analitico KAN come una sorta di mappa: scandagliandolo per regioni associate a elevato coefficiente di Seebeck e a gap di banda adeguati, possono restringere i materiali promettenti e quindi ricondurre quei modelli di descrittori a strutture cristalline candidate in grandi banche dati o in strumenti di progettazione generativa.

Cosa significa per i materiali del futuro

Per il lettore non specialistico, il messaggio chiave è che questo lavoro ci avvicina all'intelligenza artificiale “a scatola di vetro” per la scoperta di materiali. Le Reti di Kolmogorov–Arnold offrono prestazioni quasi pari ai migliori predittori a scatola nera, ma espongono anche, in forma matematica, come le caratteristiche strutturali di un cristallo siano legate alla sua capacità di trasformare il calore in elettricità. Questa combinazione di velocità, accuratezza e interpretabilità può aiutare gli scienziati a fare scelte informate su quali nuovi composti sintetizzare e testare, accorciando potenzialmente il percorso dai dati grezzi a dispositivi termoelettrici reali che recuperano il calore di scarto e migliorano l'efficienza energetica.

Citazione: Fronzi, M., Ford, M.J., Nayal, K.S. et al. Interpretable machine learning for thermoelectric materials design with Kolmogorov–Arnold networks. Sci Rep 16, 14146 (2026). https://doi.org/10.1038/s41598-026-44723-x

Parole chiave: materiali termoelettrici, apprendimento automatico interpretabile, reti di Kolmogorov–Arnold, progettazione dei materiali, coefficiente di Seebeck