Clear Sky Science · es

Aprendizaje automático interpretable para el diseño de materiales termoeléctricos con redes de Kolmogorov–Arnold

Convertir el calor en energía útil

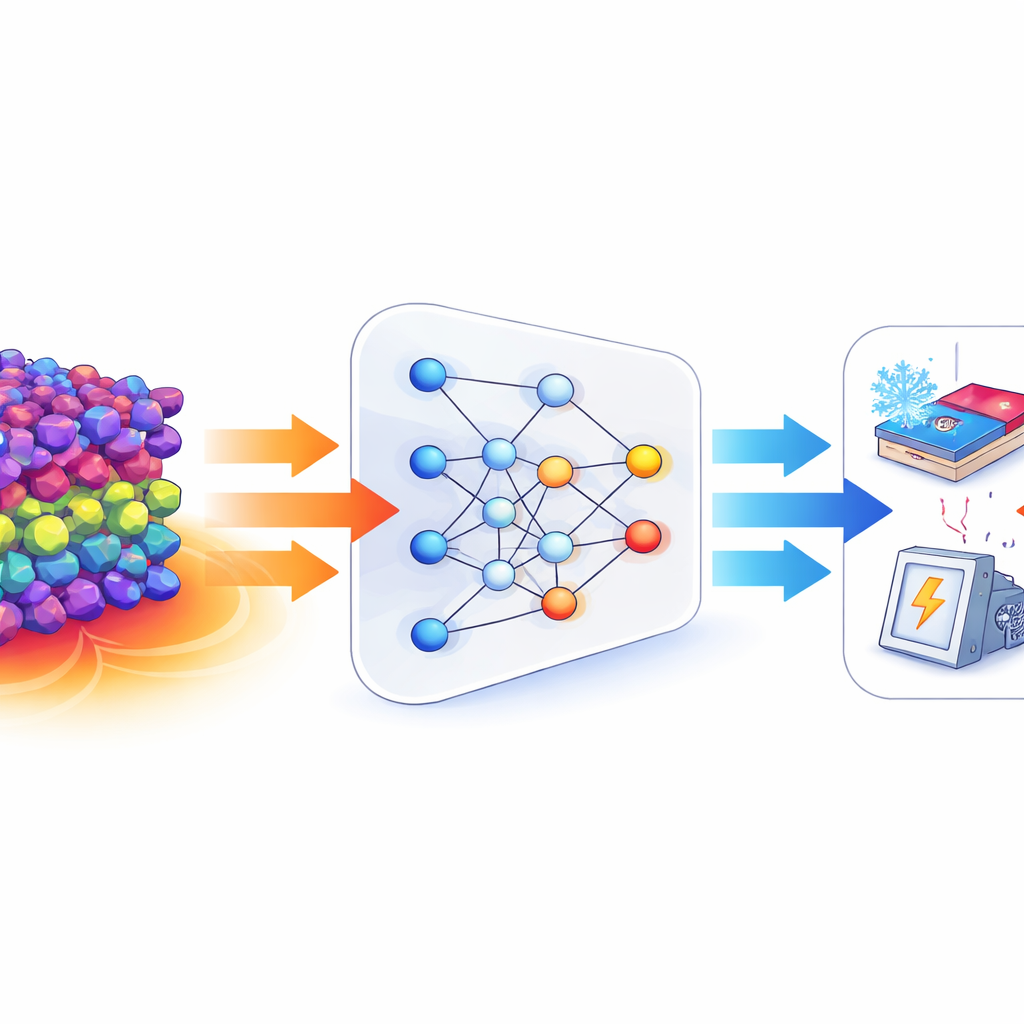

Cada día se pierde una enorme cantidad de energía en forma de calor residual procedente de motores de coches, fábricas e incluso de nuestros propios dispositivos electrónicos. Los materiales termoeléctricos ofrecen una forma de transformar parte de ese calor desperdiciado directamente en electricidad, sin piezas móviles y sin combustible. Pero encontrar nuevos materiales que lo hagan de forma eficiente es difícil, porque su rendimiento depende de varias propiedades electrónicas estrechamente interconectadas. Este estudio explora un tipo de inteligencia artificial que no solo puede predecir qué tan bueno será un material, sino también explicar por qué—abriendo una vía más clara para diseñar compuestos termoeléctricos mejores.

Por qué es difícil encontrar mejores materiales que conviertan calor en electricidad

Los dispositivos termoeléctricos dependen de materiales que generan un voltaje cuando un lado está caliente y el otro frío. Su eficiencia se resume en una magnitud llamada zT, que depende de tres ingredientes principales: con qué intensidad los portadores de carga responden a la temperatura (el coeficiente de Seebeck), con qué facilidad se mueven (conductividad eléctrica) y con qué eficiencia el material transporta el calor (conductividad térmica). Mejorar una de estas propiedades a menudo deteriora otra—por ejemplo, hacer que un material conduzca mejor la electricidad puede también aumentar su transporte de calor, reduciendo la eficiencia. Las simulaciones cuánticas tradicionales, como la teoría del funcional de la densidad, pueden predecir estas propiedades a partir de la estructura atómica, pero son tan costosas computacionalmente que no pueden aplicarse a millones de materiales candidatos.

Modelos de caja negra y la necesidad de comprensión

Los modelos de aprendizaje automático se han convertido recientemente en herramientas potentes para estimar rápidamente propiedades materiales basándose en simulaciones y experimentos previos. En este trabajo, los autores parten de descripciones numéricas ricas de estructuras cristalinas generadas por un codificador especializado llamado "Crystalformer", que captura cómo se disponen e interactúan los átomos en un cristal. Primero entrenan un perceptrón multicapa estándar—un modelo de aprendizaje profundo común—para predecir dos cantidades clave: el coeficiente de Seebeck y la brecha electrónica (band gap), que influye en la facilidad con que un material puede alojar portadores de carga móviles. Este modelo alcanza alta precisión en ambas tareas en un gran conjunto de datos de unas 15.000 compuestos. Sin embargo, como la mayoría de las redes profundas, se comporta como una caja negra, ofreciendo poca orientación sobre qué rasgos estructurales importan realmente o cómo se combinan para controlar la respuesta termoeléctrica.

Un tipo diferente de red neuronal

La idea central del artículo es sustituir las redes neuronales opacas por redes de Kolmogorov–Arnold, o KAN. En lugar de ocultar toda la complejidad dentro de las activaciones de las neuronas, las KANs acoplan funciones flexibles y unidimensionales semejantes a curvas a las conexiones entre capas. Matemáticamente, esas curvas son splines suaves que se adaptan a los datos, y el modelo global puede escribirse como una suma de funciones simples de los descriptores de entrada. Tras el entrenamiento, los autores ajustan expresiones matemáticas concisas—construidas a partir de funciones familiares como senos, cosenos y curvas de saturación suaves—a estos splines aprendidos. De este modo, el modelo se convierte en una fórmula simbólica explícita que enlaza descriptores estructurales con la brecha electrónica y el coeficiente de Seebeck, en lugar de un enredo de parámetros opacos. Aunque las KANs son más costosas de entrenar, alcanzan una precisión comparable, y en algunos regímenes superior, a la del perceptrón multicapa y a varios otros métodos de aprendizaje automático usados en la literatura.

Qué aprende el modelo sobre los materiales

Al examinar la estructura interna de la KAN, los autores muestran que solo un subconjunto de los 128 descriptores estructurales influye de forma destacada en cada propiedad. Calculan puntuaciones de atribución para identificar los descriptores más importantes y luego podan conexiones débiles, dejando una red escasa y más fácil de interpretar que sigue prediciendo bien. Usando pares de descriptores mejor clasificados, construyen mapas bidimensionales que muestran cómo varía la brecha electrónica o el coeficiente de Seebeck previsto en el espacio de descriptores. Estos mapas revelan efectos suaves y cooperativos, donde tendencias oscilatorias y de saturación se combinan, en lugar de reglas simples uno a uno. Desde el punto de vista químico, el modelo tiene más dificultades en sistemas complejos con enlaces altamente direccionales o con electrones d y f fuertemente interactuantes, pero incluso en esos casos las KANs producen predicciones más estables y físicamente coherentes que el modelo de caja negra. Por ejemplo, generan menos brechas de banda negativas no físicas y menos valores del Seebeck con signo incorrecto.

De la predicción al diseño guiado

Como las KANs generan fórmulas explícitas y suaves en lugar de solo predicciones numéricas, pueden usarse para explorar cómo cambiarían las prestaciones termoeléctricas al modificar los descriptores subyacentes. Aunque estos descriptores siguen siendo cantidades abstractas derivadas de un codificador estructural profundo, se correlacionan con rasgos reales de la disposición atómica y el enlace. Esto significa que los investigadores pueden usar el modelo analítico KAN como una especie de mapa: explorándolo en busca de regiones asociadas con un alto coeficiente de Seebeck y una brecha de banda adecuada, pueden reducir la lista de materiales prometedores y luego vincular esos patrones de descriptores a estructuras cristalinas candidatas en grandes bases de datos o en herramientas de diseño generativo.

Qué significa esto para los materiales del futuro

Para el lector no especializado, el mensaje clave es que este trabajo nos acerca a una inteligencia artificial de "caja de cristal" para el descubrimiento de materiales. Las redes de Kolmogorov–Arnold rinden casi tan bien como los mejores predictores de caja negra, pero además exponen, en forma matemática, cómo los rasgos estructurales de un cristal se vinculan a su capacidad para convertir calor en electricidad. Esa combinación de rapidez, precisión e interpretabilidad puede ayudar a los científicos a tomar decisiones informadas sobre qué nuevos compuestos sintetizar y probar, acortando potencialmente el camino desde los datos crudos hasta dispositivos termoeléctricos reales que aprovechen el calor residual y mejoren la eficiencia energética.

Cita: Fronzi, M., Ford, M.J., Nayal, K.S. et al. Interpretable machine learning for thermoelectric materials design with Kolmogorov–Arnold networks. Sci Rep 16, 14146 (2026). https://doi.org/10.1038/s41598-026-44723-x

Palabras clave: materiales termoeléctricos, aprendizaje automático interpretable, redes de Kolmogorov–Arnold, diseño de materiales, coeficiente de Seebeck