Clear Sky Science · pt

SCB-YOLO: uma rede leve adaptativa com atenção aprimorada para detecção de comportamento estudantil em ambientes de sala de aula complexos

Observando a sala de aula de uma nova maneira

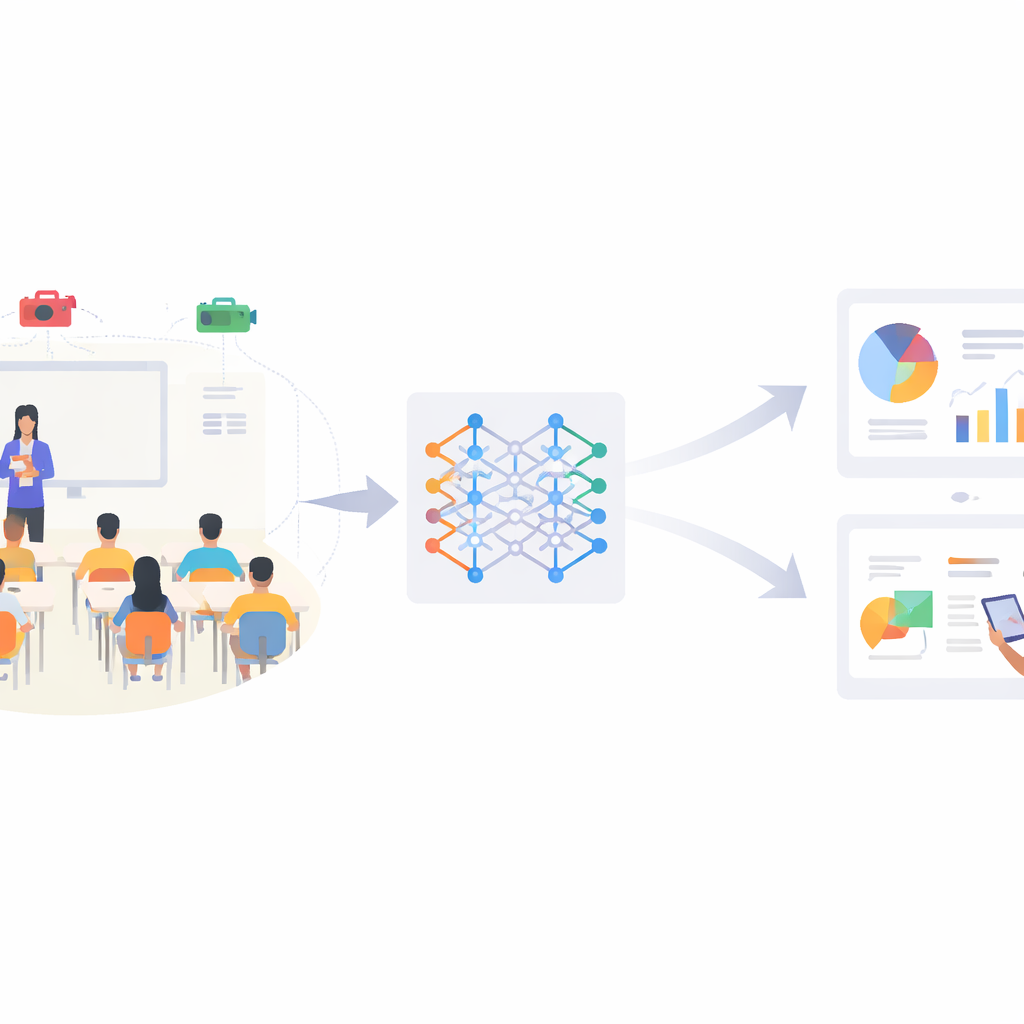

Professores sempre dependeram dos olhos e da intuição para avaliar se os alunos estão ouvindo, lendo ou distraídos. Mas, nas salas cheias e nas escolas guiadas por dados de hoje, é quase impossível para uma única pessoa monitorar o comportamento de cada criança em tempo real. Este artigo apresenta o SCB-YOLO, um sistema compacto de inteligência artificial capaz de detectar automaticamente comportamentos-chave dos alunos—como levantar a mão, ler ou escrever—a partir de vídeo comum de sala de aula, mesmo sob iluminação ruim, aglomeração e ruído visual. O objetivo não é substituir os professores, mas fornecer a eles um fluxo constante e objetivo de informação sobre como os alunos estão engajados, abrindo caminho para um ensino mais personalizado e responsivo.

Por que as ações dos alunos importam

Gestos simples na sala de aula carregam uma quantidade surpreendente de informação. Levantar a mão com frequência, leitura consistente e escrita concentrada estão fortemente ligados ao aprendizado e ao nível de engajamento dos alunos. Tradicionalmente, professores ou observadores registravam esses comportamentos manualmente, um processo lento, subjetivo e difícil de escalar além de algumas aulas. Tentativas iniciais de automatizar isso usaram sensores vestíveis ou hardware especial na sala, mas esses dispositivos eram intrusivos, caros e levantavam questões de privacidade. Em contraste, a visão computacional moderna pode operar a partir de fluxos de vídeo comuns já presentes em muitas escolas, transformando pixels brutos em um registro de como os alunos se comportam sem interromper a aula.

Do vídeo bruto ao comportamento reconhecido

O SCB-YOLO se baseia em uma família popular de modelos de visão conhecida como YOLO, que pode detectar e localizar objetos em uma imagem em uma única passada rápida. Os autores adaptam a variante leve YOLOv11n e a redesenham especificamente para salas de aula do ensino fundamental, onde a iluminação é desigual, carteiras e paredes são desordenadas e os alunos frequentemente se bloqueiam uns aos outros. O conjunto de dados deles, SCB-Dataset3-S, contém mais de 5.000 imagens reais de sala de aula rotuladas com três comportamentos principais: levantar a mão, ler e escrever. Essas categorias foram escolhidas por serem tanto educacionalmente relevantes quanto visualmente desafiadoras—especialmente distinguir escrever de ler, que pode diferir apenas por mudanças sutis na posição da mão e da cabeça.

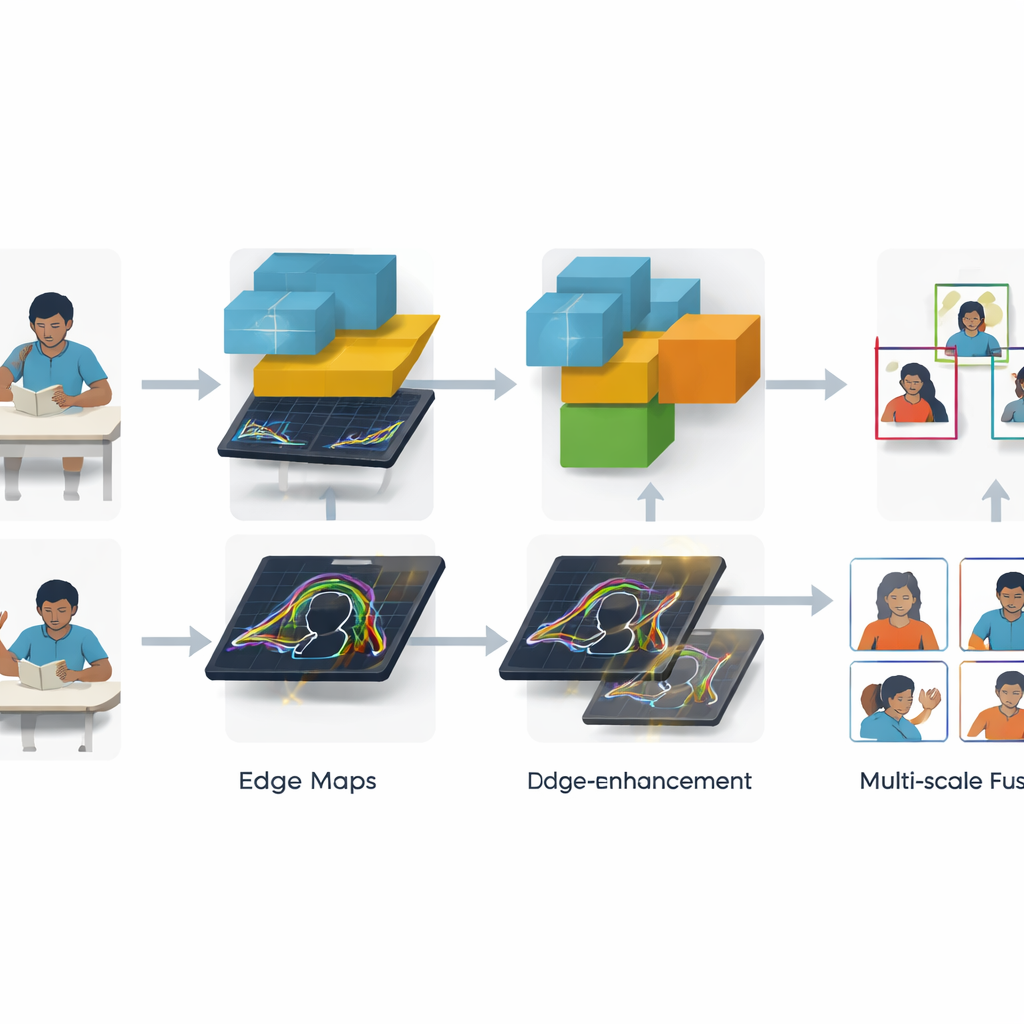

Afiando bordas e mesclando escalas

Duas inovações chave ajudam o SCB-YOLO a lidar com cenas do mundo real bagunçadas. Primeiro, um módulo de Transferência de Informação de Borda Global concentra-se em contornos e traços—como a borda de um braço levantado no ar ou a separação entre uma mão e um caderno. Aplicando filtros de borda clássicos não diretamente à imagem bruta, mas a características iniciais da rede, e então alimentando essas bordas refinadas em camadas mais profundas, o sistema melhora a capacidade de traçar caixas precisas em torno de comportamentos como levantar a mão e escrever, mesmo quando os alunos são pequenos ou parcialmente ocultos. Segundo, um novo módulo de fusão MANet_Star combina informações de diferentes escalas de imagem de forma mais inteligente. Ele envia características por vários ramos leves que mimetizam atenção, reforçando os padrões mais informativos enquanto mantém o modelo compacto o suficiente para uso em tempo real.

Quão bem o sistema funciona

No benchmark SCB-Dataset3-S, o SCB-YOLO supera uma ampla gama de outros modelos YOLO enxutos. Ele melhora uma medida padrão de acurácia (mAP@0.5) em 2,6 pontos percentuais sobre seu ponto de partida YOLOv11n, alcançando 71,8% enquanto ainda opera em velocidades de vídeo. Os ganhos são especialmente grandes para o caso mais difícil—escrever—onde a acurácia aumenta mais do que em qualquer outra categoria e a confusão com leitura é reduzida de forma acentuada. Análises visuais dos mapas de calor internos da rede mostram que, em comparação com a linha de base, o SCB-YOLO foca com mais precisão em livros, mãos e cabeças, particularmente em alunos pequenos ou distantes. Testes em dispositivos que vão desde uma poderosa placa gráfica de desktop até um compacto módulo Jetson em borda mostram que o sistema pode funcionar confortavelmente acima das taxas de tempo real em implantações realistas.

O que isso significa para as salas de aula futuras

Para não especialistas, a principal conclusão é que agora é viável construir câmeras de sala de aula que fazem mais do que gravar—elas podem compreender, de maneira básica, o que os alunos estão fazendo e quão engajados parecem. O SCB-YOLO demonstra que, com módulos cuidadosamente projetados para afiar bordas e mesclar informações entre escalas, um modelo de IA relativamente pequeno pode identificar de forma confiável comportamentos-chave de aprendizagem em condições lotadas e imperfeitas. Em um futuro próximo, tais sistemas poderiam alimentar análises de aprendizagem e plataformas de tutoria, alertando professores quando a atenção diminui, destacando quais aulas perdem os alunos e apoiando instrução mais personalizada. Usada de forma responsável e com fortes salvaguardas de privacidade, essa tecnologia pode se tornar uma aliada discreta, porém poderosa, para ajudar cada criança a receber a atenção de que precisa.

Citação: Guo, C., Yuan, B., Xie, J. et al. SCB-YOLO: a lightweight adaptive attention-enhanced network for student behavior detection in complex classroom settings. Sci Rep 16, 13309 (2026). https://doi.org/10.1038/s41598-026-43753-9

Palavras-chave: sala de aula inteligente, engajamento estudantil, visão computacional, detecção de comportamento, aprendizado profundo leve