Clear Sky Science · de

SCB-YOLO: ein leichtgewichtiges, adaptives, auf Aufmerksamkeit erweitertes Netzwerk zur Erkennung von Schülerverhalten in komplexen Klassenzimmerumgebungen

Das Klassenzimmer neu beobachten

Lehrkräfte haben sich schon immer auf Augen und Instinkt verlassen, um einzuschätzen, ob Schüler zuhören, lesen oder gedanklich abschweifen. In heutigen vollbesetzten Klassen und datengetriebenen Schulen ist es jedoch nahezu unmöglich für eine einzelne Person, das Verhalten aller Kinder in Echtzeit zu verfolgen. Dieses Papier stellt SCB-YOLO vor, ein kompaktes KI-System, das automatisch zentrale Schülerverhalten—wie Handheben, Lesen oder Schreiben—aus gewöhnlichem Klassenzimmervideo erkennen kann, selbst bei schlechter Beleuchtung, Gedränge und visueller Unordnung. Ziel ist es nicht, Lehrkräfte zu ersetzen, sondern ihnen einen kontinuierlichen, objektiven Informationsstrom darüber zu liefern, wie sich Schüler engagieren, und so personalisierteres und reaktionsschnelleres Unterrichten zu ermöglichen.

Warum Schülerhandlungen wichtig sind

Einfache Handlungen im Klassenzimmer tragen überraschend viel Information. Häufiges Handheben, kontinuierliches Lesen und konzentriertes Schreiben stehen in engem Zusammenhang damit, wie gut Schüler lernen und wie engagiert sie sind. Traditionell versuchten Lehrkräfte oder Beobachter, diese Verhaltensweisen manuell zu protokollieren — ein langsamer, subjektiver Prozess, der sich kaum über wenige Unterrichtsstunden hinaus skalieren lässt. Frühe Automatisierungsversuche verwendeten tragbare Sensoren oder spezielle Hardware im Raum, doch diese Geräte waren aufdringlich, teuer und weckten Datenschutzbedenken. Im Gegensatz dazu kann moderne Computer Vision mit gewöhnlichen Videoströmen arbeiten, wie sie bereits in vielen Schulen vorhanden sind, und rohe Pixel in ein Protokoll des Schülerverhaltens verwandeln, ohne den Unterricht zu stören.

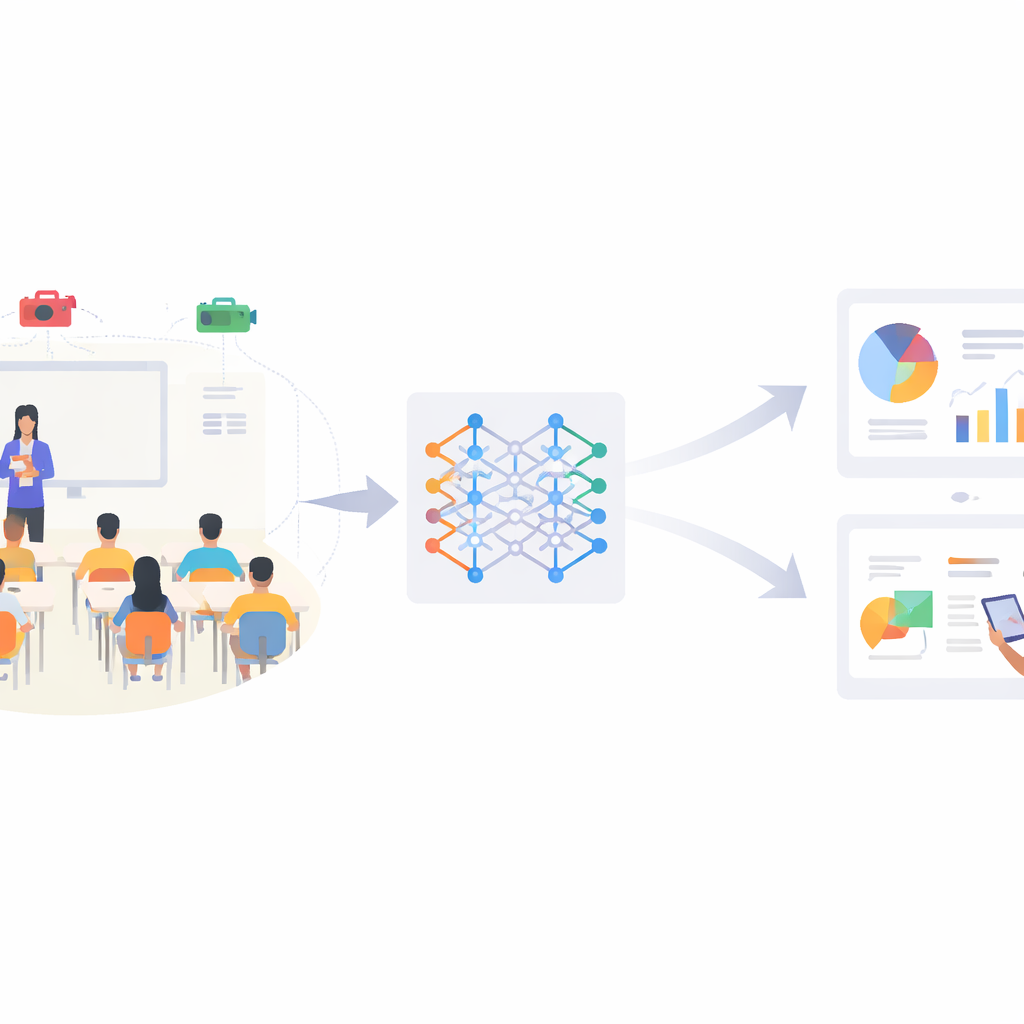

Vom Rohvideo zum erkannten Verhalten

SCB-YOLO baut auf einer beliebten Modellfamilie der Bildverarbeitung namens YOLO auf, die Objekte in einem Bild in einem schnellen Durchlauf erkennen und lokalisieren kann. Die Autor:innen passen die leichtgewichtige Variante YOLOv11n an und formen sie speziell für Grundschulklassen um, in denen die Beleuchtung ungleichmäßig ist, Tische und Wände unordentlich sind und Schüler sich oft gegenseitig verdecken. Ihr Datensatz SCB-Dataset3-S enthält mehr als 5.000 echte Klassenzimmerbilder, die mit drei Kernverhalten beschriftet sind: Handheben, Lesen und Schreiben. Diese Kategorien wurden gewählt, weil sie sowohl pädagogisch wichtig als auch visuell herausfordernd sind — besonders die Unterscheidung von Schreiben und Lesen, die sich oft nur durch subtile Änderungen in Hand- und Kopfposition unterscheidet.

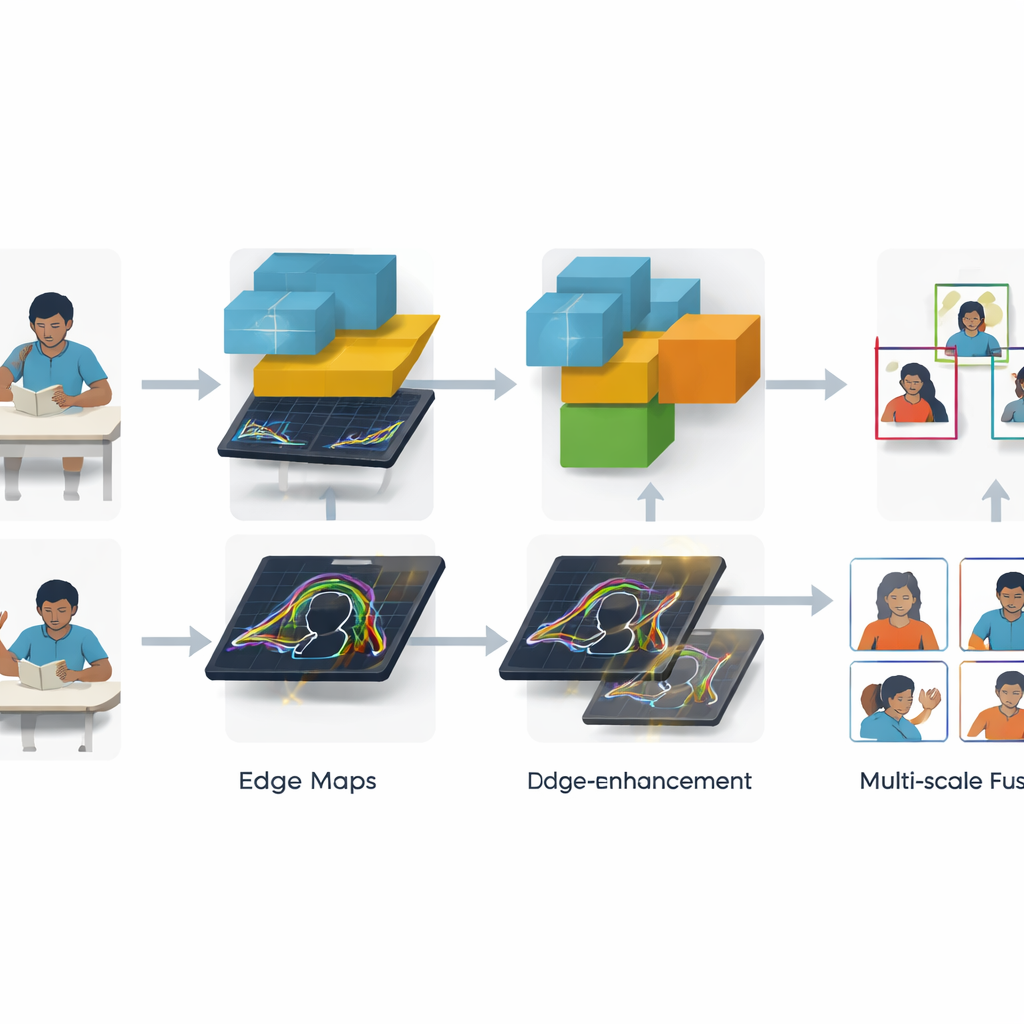

Kanten schärfen und Skalen verschmelzen

Zwei zentrale Innovationen helfen SCB-YOLO, mit unordentlichen Realweltszenen zurechtzukommen. Erstens konzentriert sich ein Global Edge Information Transfer-Modul auf Umrisse und Konturen — etwa die Begrenzung eines erhobenen Arms oder die Kante zwischen Hand und Heft. Indem klassische Kantendfilter nicht direkt auf das Rohbild, sondern auf frühe Netzwerk-Features angewandt und diese verfeinerten Kanten dann in tiefere Schichten eingespeist werden, wird das System besser darin, enge Begrenzungsfelder um Verhaltensweisen wie Handheben und Schreiben zu ziehen, selbst wenn Schüler klein oder teilweise verdeckt sind. Zweitens kombiniert ein neues MANet_Star-Fusionsmodul Informationen aus verschiedenen Bildskalen intelligenter. Es leitet Features durch mehrere leichtgewichtige Zweige, die Aufmerksamkeit nachahmen, verstärkt die informationsreichsten Muster und hält das Gesamtmodell gleichzeitig kompakt genug für den Echtzeitbetrieb.

Wie gut das System arbeitet

Auf dem SCB-Dataset3-S-Benchmark übertrifft SCB-YOLO eine breite Palette anderer schlanker YOLO-Modelle. Es verbessert eine Standardgenauigkeitsmetrik (mAP@0.5) gegenüber dem YOLOv11n-Ausgangspunkt um 2,6 Prozentpunkte und erreicht 71,8 Prozent, während es weiterhin in Videogeschwindigkeit arbeitet. Die Zuwächse sind besonders groß beim schwierigsten Fall — Schreiben — wo die Genauigkeit stärker ansteigt als in jeder anderen Kategorie und Verwechslungen mit Lesen deutlich reduziert werden. Visuelle Analysen der internen Heatmaps des Netzwerks zeigen, dass SCB-YOLO im Vergleich zur Basislinie präziser auf Bücher, Hände und Köpfe fokussiert, insbesondere bei kleinen oder entfernten Schülern. Tests auf Geräten von einer leistungsfähigen Desktop-Grafikkarte bis zu einem kompakten Jetson-Edge-Modul zeigen, dass das System in realistischen Einsatzszenarien komfortabel über Echtzeitraten läuft.

Was das für zukünftige Klassenzimmer bedeutet

Für Nicht-Spezialisten lautet die wichtigste Erkenntnis, dass es nun möglich ist, Klassenzimmerkameras zu bauen, die mehr tun als aufzuzeichnen — sie können in grundlegender Weise verstehen, was Schüler tun und wie engagiert sie scheinen. SCB-YOLO zeigt, dass mit sorgfältig gestalteten Modulen, die Kanten schärfen und Informationen über Skalen hinweg verschmelzen, ein relativ kleines KI-Modell zuverlässige Schlüsselverhaltensweisen im Gedränge und bei unvollkommenen Bedingungen erkennen kann. In naher Zukunft könnten solche Systeme in Learning-Analytics- und Tutoring-Plattformen einfließen, Lehrkräfte alarmieren, wenn die Aufmerksamkeit nachlässt, aufzeigen, welche Lektionen Schüler verlieren, und eine individuellere Unterrichtsgestaltung unterstützen. Verantwortungsbewusst eingesetzt und mit starken Datenschutzgarantien versehen, könnte diese Technologie ein leiser, aber wirkungsvoller Verbündeter werden, damit jedes Kind die Aufmerksamkeit erhält, die es braucht.

Zitation: Guo, C., Yuan, B., Xie, J. et al. SCB-YOLO: a lightweight adaptive attention-enhanced network for student behavior detection in complex classroom settings. Sci Rep 16, 13309 (2026). https://doi.org/10.1038/s41598-026-43753-9

Schlüsselwörter: intelligentes Klassenzimmer, Schülerengagement, Computer Vision, Verhaltensdetektion, leichtgewichtiges Deep Learning