Clear Sky Science · pl

SCB-YOLO: lekka adaptacyjna sieć z wzmocnioną uwagą do wykrywania zachowań uczniów w złożonych warunkach klasowych

Obserwacja klasy w nowy sposób

Nauczyciele od zawsze polegali na wzroku i instynkcie, by ocenić, czy uczniowie słuchają, czytają, czy spokojnie odpływają myślami. W dzisiejszych przepełnionych salach i w szkołach opartych na danych trudno jednak jednej osobie śledzić zachowanie każdego dziecka w czasie rzeczywistym. W artykule przedstawiono SCB-YOLO — kompaktowy system sztucznej inteligencji, który automatycznie rozpoznaje kluczowe zachowania uczniów — takie jak podniesienie ręki, czytanie czy pisanie — z zwykłego nagrania klasowego, nawet przy słabym oświetleniu, tłoku i wizualnym zagraceniu. Celem nie jest zastąpienie nauczycieli, lecz dostarczenie im stałego, obiektywnego strumienia informacji o zaangażowaniu uczniów, co otwiera drogę do bardziej spersonalizowanej i responsywnej nauki.

Dlaczego zachowania uczniów mają znaczenie

Proste akcje w klasie niosą ze sobą zaskakująco dużo informacji. Częste podnoszenie ręki, regularne czytanie i skupione pisanie silnie korelują z poziomem przyswajania wiedzy i odczuwanym zaangażowaniem. Tradycyjnie nauczyciele lub obserwatorzy zapisywali te zachowania ręcznie — proces powolny, subiektywny i trudny do skalowania poza kilka lekcji. Wczesne próby automatyzacji wykorzystywały czujniki noszone na ciele lub specjalny sprzęt w sali, które były inwazyjne, kosztowne i budziły obawy o prywatność. W przeciwieństwie do tego nowoczesne systemy widzenia komputerowego działają na zwykłych strumieniach wideo dostępnych w wielu szkołach, przekształcając piksele w zapis zachowań uczniów bez zakłócania zajęć.

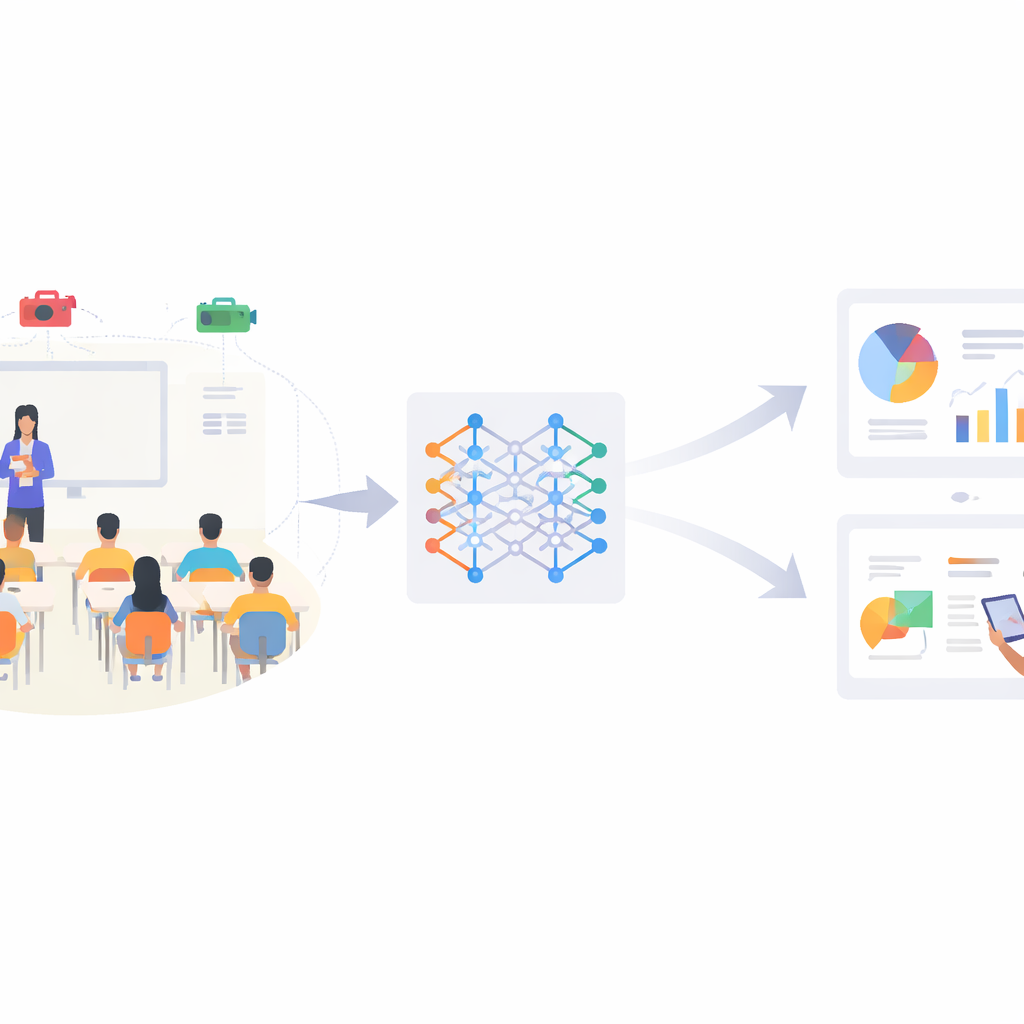

Od surowego wideo do rozpoznanych zachowań

SCB-YOLO opiera się na popularnej rodzinie modeli widzenia znanej jako YOLO, które potrafią wykrywać i lokalizować obiekty na obrazie w jednym szybkim przebiegu. Autorzy zaadaptowali lekką odmianę YOLOv11n i przekształcili ją specjalnie pod potrzeby szkół podstawowych, gdzie oświetlenie jest nierównomierne, biurka i ściany zagracone, a uczniowie często zasłaniają się nawzajem. Ich zbiór danych, SCB-Dataset3-S, zawiera ponad 5000 rzeczywistych zdjęć klasowych oznaczonych trzema podstawowymi zachowaniami: podnoszeniem ręki, czytaniem i pisaniem. Kategorie te wybrano, ponieważ są ważne edukacyjnie i jednocześnie wizualnie wymagające — szczególnie rozróżnienie pisania od czytania, które może różnić się jedynie subtelnymi zmianami pozycji ręki i głowy.

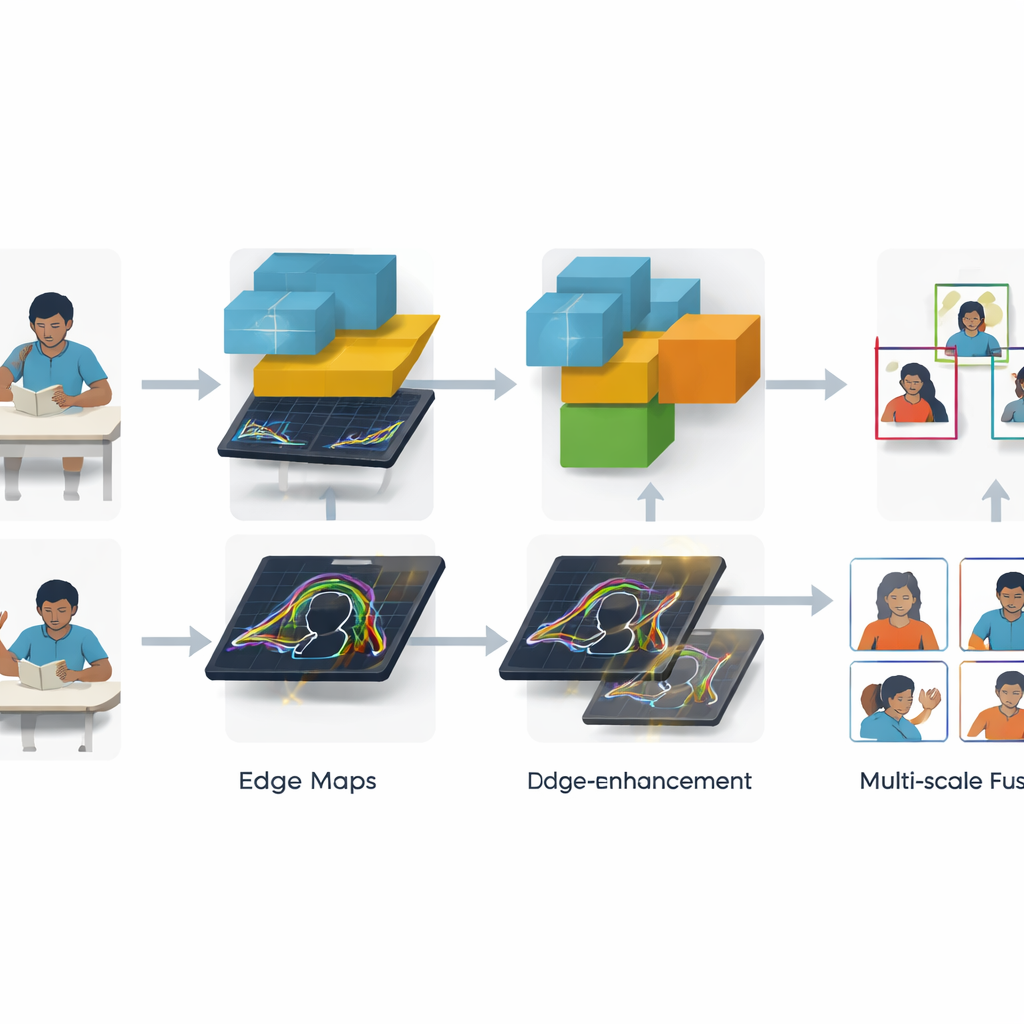

Wyostrzenie krawędzi i łączenie skali

Dwie kluczowe innowacje pomagają SCB-YOLO radzić sobie w chaotycznych, rzeczywistych scenach. Po pierwsze, moduł Global Edge Information Transfer koncentruje się na konturach i zarysach — na przykład granicy ramienia wzniesionego w powietrzu lub krawędzi między dłonią a zeszytem. Zamiast stosować klasyczne filtry krawędzi bezpośrednio do surowego obrazu, filtruje się wczesne cechy sieci, a następnie wzbogacone krawędzie przekazuje do głębszych warstw, dzięki czemu system lepiej rysuje precyzyjne ramki wokół zachowań takich jak podnoszenie ręki czy pisanie, nawet gdy uczniowie są mali lub częściowo zasłonięci. Po drugie, nowy moduł fuzji MANet_Star łączy informacje z różnych skal obrazu w bardziej inteligentny sposób. Przesyła cechy przez kilka lekkich gałęzi przypominających mechanizm uwagi, wzmacniając najbardziej informacyjne wzorce, przy jednoczesnym utrzymaniu kompaktowości modelu wystarczającej do pracy w czasie rzeczywistym.

Jak dobrze działa system

Na benchmarku SCB-Dataset3-S SCB-YOLO przewyższa wiele innych odchudzonych modeli z rodziny YOLO. Poprawia standardową miarę dokładności (mAP@0.5) o 2,6 punktu procentowego w porównaniu z punktem wyjścia YOLOv11n, osiągając 71,8 proc., przy jednoczesnym zachowaniu prędkości wideo. Zyski są szczególnie duże w najtrudniejszej kategorii — pisaniu — gdzie dokładność wzrasta bardziej niż w innych klasach, a pomyłki z czytaniem są wyraźnie zmniejszone. Analizy wizualne map cieplnych wewnątrz sieci pokazują, że w porównaniu z bazą SCB-YOLO skupia się dokładniej na książkach, dłoniach i głowach, zwłaszcza w przypadku małych lub odległych uczniów. Testy na urządzeniach od potężnej karty graficznej desktopa po kompaktowy moduł Jetson pokazały, że system może działać wygodnie powyżej prędkości rzeczywistej w realistycznych wdrożeniach.

Co to oznacza dla przyszłych klas

Dla osób niebędących specjalistami główne przesłanie jest takie, że teraz możliwe jest zbudowanie kamer klasowych, które robią coś więcej niż tylko nagrywają — potrafią w podstawowy sposób rozumieć, co robią uczniowie i jak są zaangażowani. SCB-YOLO pokazuje, że z dobrze zaprojektowanymi modułami wyostrzającymi krawędzie i integrującymi informacje między skalami, stosunkowo mały model AI może niezawodnie wykrywać kluczowe zachowania edukacyjne w zatłoczonych, niedoskonałych warunkach. W niedalekiej przyszłości takie systemy mogą zasilać analitykę nauczania i platformy tutoringowe, alarmując nauczycieli, gdy uwaga spada, wskazując lekcje, które tracą uczniów, i wspierając bardziej dopasowane nauczanie. Używane odpowiedzialnie i z silnymi zabezpieczeniami prywatności, technologie te mogą stać się cichym, lecz potężnym sprzymierzeńcem w zapewnianiu każdemu dziecku uwagi, której potrzebuje.

Cytowanie: Guo, C., Yuan, B., Xie, J. et al. SCB-YOLO: a lightweight adaptive attention-enhanced network for student behavior detection in complex classroom settings. Sci Rep 16, 13309 (2026). https://doi.org/10.1038/s41598-026-43753-9

Słowa kluczowe: inteligentna klasa, zaangażowanie uczniów, widzenie komputerowe, wykrywanie zachowań, lekka głęboka nauka