Clear Sky Science · es

SCB-YOLO: una red ligera y adaptable mejorada con atención para la detección del comportamiento estudiantil en aulas complejas

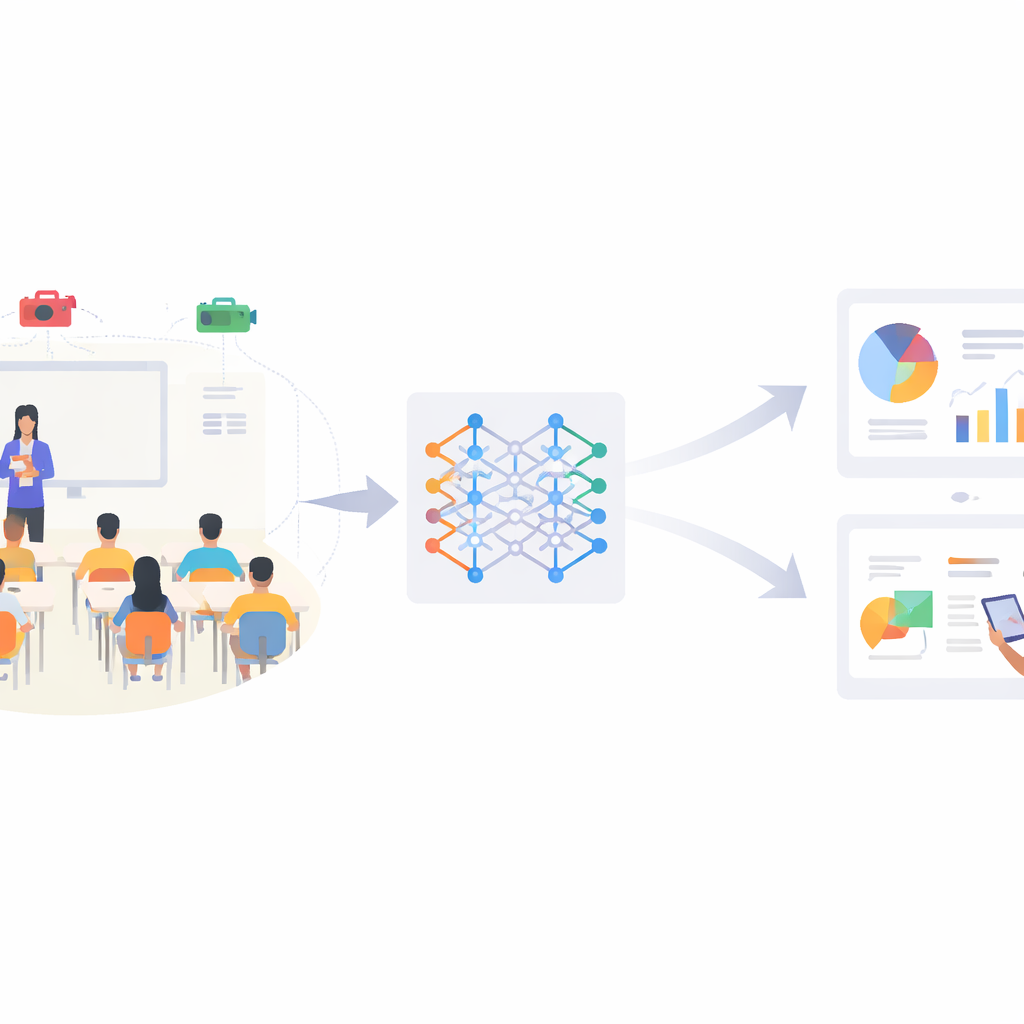

Observar el aula de una manera nueva

Los profesores siempre han confiado en sus ojos e instintos para juzgar si los alumnos están escuchando, leyendo o distraídos en silencio. Pero en las aulas llenas de hoy y en centros educativos orientados por datos, es casi imposible que una sola persona supervise el comportamiento de cada niño en tiempo real. Este artículo presenta SCB-YOLO, un sistema de inteligencia artificial compacto que puede detectar automáticamente comportamientos clave de los estudiantes —como levantar la mano, leer o escribir— a partir de vídeo de aula ordinario, incluso con poca luz, aglomeraciones y desorden visual. El objetivo no es sustituir a los docentes, sino proporcionarles un flujo constante y objetivo de información sobre cómo se involucran los estudiantes, abriendo la puerta a una enseñanza más personalizada y reactiva.

Por qué importan las acciones estudiantiles

Las acciones simples en el aula contienen una cantidad sorprendente de información. Levantar la mano con frecuencia, leer de forma sostenida y escribir concentrado se asocian estrechamente con el aprendizaje y el grado de implicación de los estudiantes. Tradicionalmente, los docentes u observadores intentaban registrar estos comportamientos manualmente, un proceso lento, subjetivo y difícil de escalar más allá de unas pocas clases. Los primeros intentos de automatización emplearon sensores ponibles o hardware especial en la sala, pero estos dispositivos resultaban intrusivos, caros y planteaban problemas de privacidad. En contraste, la visión por computador moderna puede trabajar con flujos de vídeo ordinarios ya presentes en muchas escuelas, convirtiendo píxeles en bruto en un registro del comportamiento estudiantil sin interrumpir la clase.

Del vídeo crudo al comportamiento reconocido

SCB-YOLO se basa en una familia popular de modelos de visión conocida como YOLO, que puede detectar y localizar objetos en una imagen en una sola pasada rápida. Los autores adaptan la variante ligera YOLOv11n y la reconfiguran específicamente para aulas de primaria, donde la iluminación es desigual, los pupitres y las paredes están desordenados y los estudiantes a menudo se tapan entre sí. Su conjunto de datos, SCB-Dataset3-S, contiene más de 5.000 imágenes reales de aula etiquetadas con tres comportamientos principales: levantar la mano, leer y escribir. Estas categorías se eligieron porque son tanto educativas como visualmente desafiantes —especialmente distinguir escribir de leer, que puede diferir solo por sutiles cambios en la posición de la mano y la cabeza.

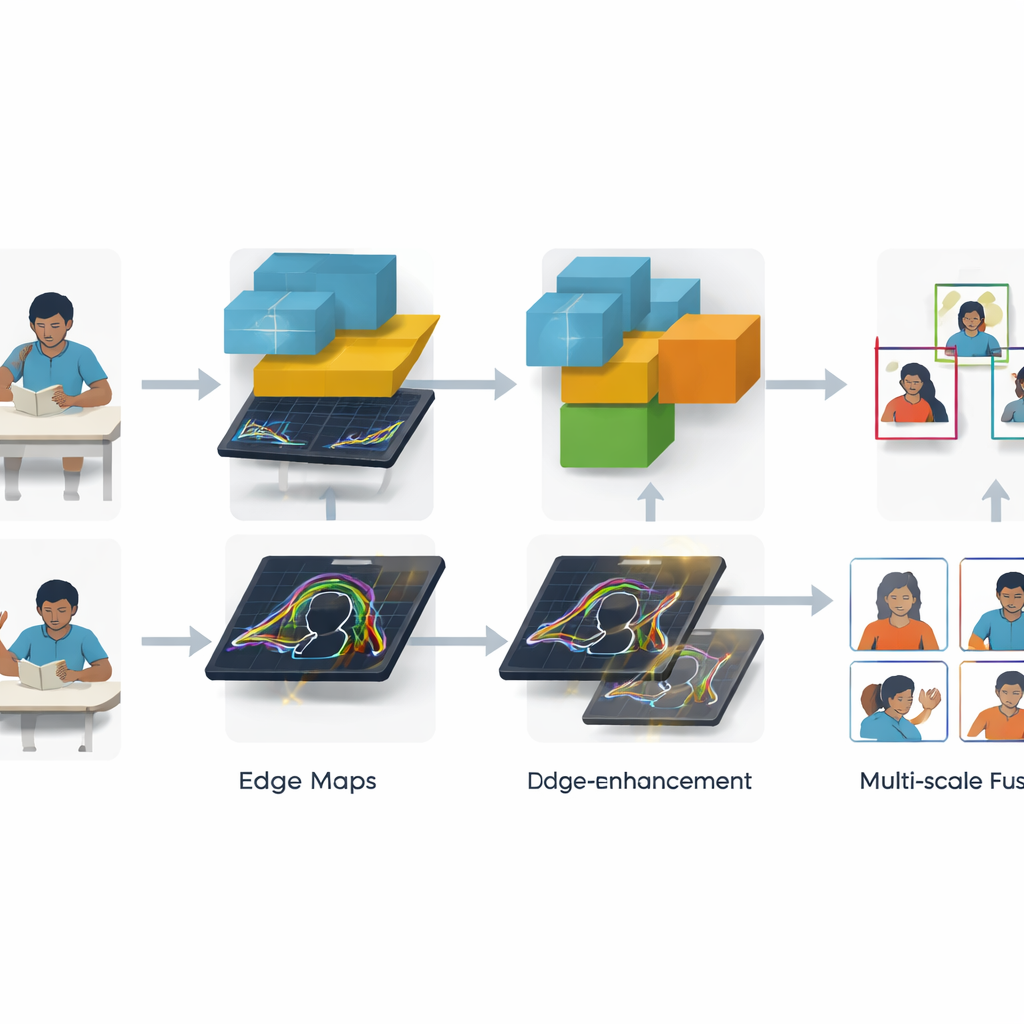

Agudizar contornos y combinar escalas

Dos innovaciones clave ayudan a SCB-YOLO a lidiar con escenas del mundo real desordenadas. Primero, un módulo de Transferencia Global de Información de Bordes se concentra en contornos y siluetas —como el borde de un brazo levantado o la separación entre una mano y un cuaderno. Al aplicar filtros clásicos de borde no directamente a la imagen cruda sino a características tempranas de la red, y luego alimentar esos bordes refinados a capas más profundas, el sistema mejora en trazar cajas ajustadas alrededor de comportamientos como levantar la mano y escribir, incluso cuando los estudiantes son pequeños o están parcialmente ocultos. Segundo, un nuevo módulo de fusión MANet_Star combina información de diferentes escalas de imagen de forma más inteligente. Envía características a través de varias ramas ligeras que imitan la atención, potenciando los patrones más informativos mientras mantiene el modelo lo suficientemente compacto para un uso en tiempo real.

Rendimiento del sistema

En el benchmark SCB-Dataset3-S, SCB-YOLO supera a una amplia gama de otros modelos YOLO optimizados. Mejora una medida estándar de precisión (mAP@0.5) en 2,6 puntos porcentuales sobre su punto de partida YOLOv11n, alcanzando el 71,8 por ciento y manteniéndose a velocidades de vídeo. Las ganancias son especialmente grandes en el caso más difícil —escribir—, donde la precisión aumenta más que en cualquier otra categoría y la confusión con leer se reduce notablemente. Los análisis visuales de los mapas de calor internos de la red muestran que, en comparación con la línea base, SCB-YOLO se centra con mayor precisión en libros, manos y cabezas, particularmente en alumnos pequeños o distantes. Las pruebas en dispositivos que van desde una potente tarjeta gráfica de sobremesa hasta un compacto módulo Jetson en el borde muestran que el sistema puede ejecutarse cómodamente por encima de tasas en tiempo real en despliegues realistas.

Qué significa esto para las aulas del futuro

Para no especialistas, la principal conclusión es que ahora es posible construir cámaras de aula que hacen más que grabar: pueden entender, de forma básica, qué hacen los estudiantes y cuán implicados parecen estar. SCB-YOLO demuestra que con módulos cuidadosamente diseñados que agudizan bordes y combinan información a distintas escalas, un modelo de IA relativamente pequeño puede detectar de forma fiable comportamientos clave de aprendizaje en condiciones concurridas e imperfectas. En un futuro próximo, dichos sistemas podrían alimentar análisis de aprendizaje y plataformas de tutoría, alertando a los profesores cuando la atención decae, señalando qué lecciones pierden al alumnado y apoyando una instrucción más personalizada. Usada de forma responsable y con fuertes salvaguardias de privacidad, esta tecnología podría convertirse en un aliado silencioso pero poderoso para ayudar a que cada niño reciba la atención que necesita.

Cita: Guo, C., Yuan, B., Xie, J. et al. SCB-YOLO: a lightweight adaptive attention-enhanced network for student behavior detection in complex classroom settings. Sci Rep 16, 13309 (2026). https://doi.org/10.1038/s41598-026-43753-9

Palabras clave: aula inteligente, participación estudiantil, visión por computador, detección de comportamientos, aprendizaje profundo ligero