Clear Sky Science · nl

Lichtgewicht superresolutiemethode gebaseerd op scattering-processing en feature-interactie

Scherpere beelden uit wazige afbeeldingen

Wie ooit in een smartphonefoto heeft ingezoomd kent de teleurstelling van blokkerige, vage details. Van beveiligingscamera’s tot medische scans en satellietbeelden, veel belangrijke beelden lijden aan hetzelfde probleem. Dit artikel presenteert een nieuwe methode om lage-resolutiebeelden om te zetten naar helderdere versies, met als doel scherpe randen en texturen te herstellen terwijl de rekenkost laag blijft zodat het op echte apparaten gebruikt kan worden.

Waarom het verhogen van detail zo moeilijk is

Beeldsuperresolutie is de taak om een hoge-resolutiebeeld te reconstrueren uit een lage-resolutie-input. Het is van belang voor alledaagse fotografie, maar ook voor videobewaking, medische beeldvorming en remote sensing. Klassieke deep-learningsystemen gebaseerd op convolutionele neurale netwerken kunnen beelden verbeteren, maar kijken vooral naar kleine pixelbuurten en missen vaak hoe verre delen van een afbeelding zich tot elkaar verhouden. Nieuwere transformer-gebaseerde modellen vangen deze langafstandsrelaties wel op, maar zijn zwaar in gebruik en hebben nog steeds moeite met het reconstrueren van de fijnste details, zoals kleine texturen en haarfijne randen, vooral op apparaten met beperkte rekencapaciteit.

Beelden opdelen in langzame en snelle veranderingen

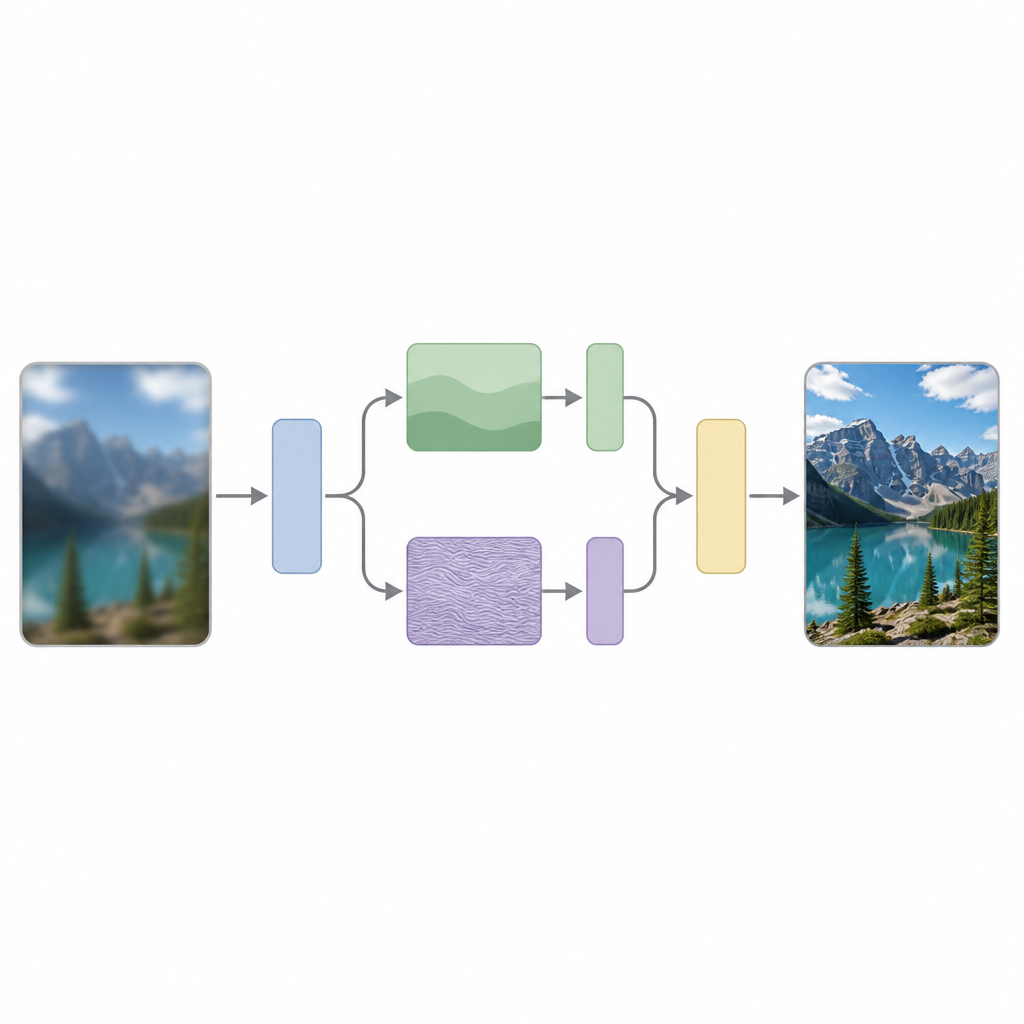

De auteurs beargumenteren dat een belangrijke reden voor deze moeite is dat de meeste modellen alle delen van een afbeelding hetzelfde behandelen, terwijl afbeeldingen van nature een mix bevatten van langzame veranderingen, zoals vlakke luchten, en snelle veranderingen, zoals scherpe randen of herhalende patronen. Hun methode, Scattering Processing and Feature Interaction (SPFI), pakt dit aan door invoerkenmerken expliciet op te splitsen in laagfrequente componenten die brede structuren beschrijven en hoogfrequente componenten die fijne details coderen. Ze gebruiken een wiskundig hulpmiddel, de Dual-Tree Complex Wavelet Transform, om deze scheiding uit te voeren op een manier die minder gevoelig is voor kleine verschuivingen in de afbeelding en beter richtingen, zoals lijnen en randen, kan onderscheiden.

Speciale behandeling voor fijne details zonder hoge kosten

Zodra de beeldinformatie is opgesplitst, verwerkt SPFI de soepele en gedetailleerde onderdelen verschillend. Laagfrequente informatie, die compact is, wordt behandeld met een eenvoudige mixmethode om globale structuur vast te leggen. Voor het hoogfrequente deel zou een directe aanpak een enorme hoeveelheid berekeningen vergen omdat het probeert elk pixel met elk ander te relateren. Om dit te vermijden ontwerpen de auteurs een Einstein Mixing Method die de data op slimme wijze herschikt en kanalen mengt zodat de belangrijke detailinteracties behouden blijven terwijl het aantal bewerkingen sterk wordt verminderd. In feite besteedt het model extra aandacht aan randen en texturen zonder te groot of traag te worden.

Schalen efficiënt samenbrengen

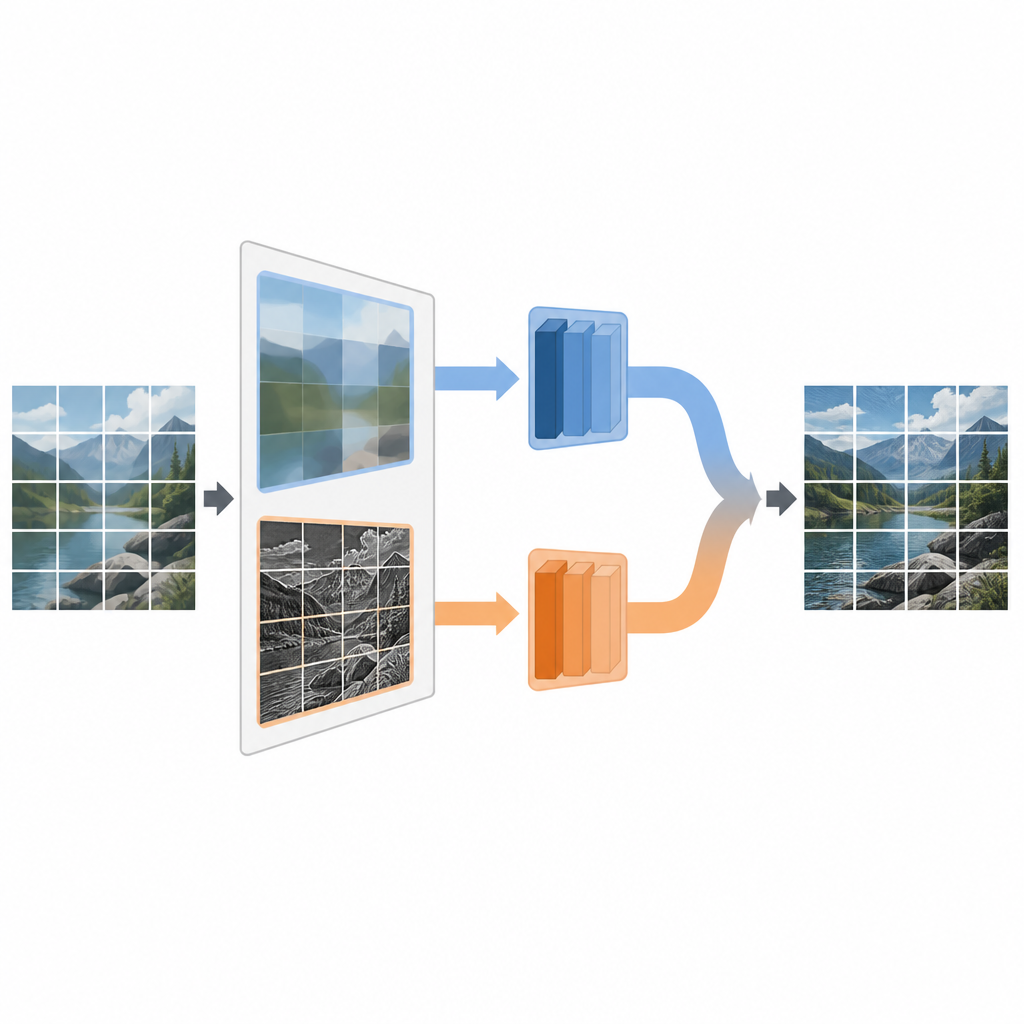

Een andere uitdaging voor scherpe reconstructie is dat nuttige informatie op meerdere schalen voorkomt, van kleine patronen tot brede vormen. Standaard transformer-attentie behandelt alle tokens op één schaal, wat zowel kostbaar als beperkend is. SPFI introduceert een Cross-token Integration-blok dat meerdere versies van de kenmerken op verschillende schalen creëert met behulp van depth-wise separable convoluties, een lichte vorm van filtering. Deze multiscale-stromen interageren en worden opnieuw gecombineerd vóór de attentiefase, zodat het model zowel lokale details als globale context kan gebruiken terwijl het werk dat de attentie moet doen, wordt verminderd. Dit ontwerp helpt het netwerk zich te concentreren op de meest relevante interacties zonder onnodige berekeningen.

Betere kwaliteit, snellere resultaten, met enkele kanttekeningen

In tests op standaard beeldbenchmarks leverde SPFI hogere kwaliteitsreconstructies dan een reeks recente superresolutiemethoden, inclusief meerdere op Transformers gebaseerde, terwijl het minder floating point operations gebruikte. Het behaalde iets hogere peak signal-to-noise ratios en betere structurele gelijkenheidsscores, en draaide sneller tijdens inferentie, waardoor het geschikter is voor bijna realtime gebruik. Visuele vergelijkingen tonen dat SPFI gevels van gebouwen en andere texturen herstelt met minder vage artefacten, en het blijkt relatief robuust wanneer de invoerbeelden ruis bevatten of op licht afwijkende manieren zijn aangetast. De auteurs merken echter op dat zeer kleine, onregelmatige details zoals piepkleine tekst een uitdaging blijven, wat erop wijst dat een vaste manier van frequentie-scheiding niet voor alle patroonsoorten perfect past.

Wat dit betekent voor toekomstige beeldhulpmiddelen

Voor niet-specialisten is de hoofdboodschap dat de auteurs een manier vonden om beelden te verscherpen door eerst gladde gebieden te scheiden van fijne details en deze delen vervolgens efficiënt over schalen te laten interactieren. Hun SPFI-methode laat zien dat het combineren van frequentiebewuste verwerking met zorgvuldige feature-mixing kan leiden tot duidelijkere beelden tegen lagere rekenkosten. Hoewel het niet elk soort detail perfect herstelt, vooral niet ingewikkelde tekst, wijst het de weg naar meer praktische superresolutiesystemen die op alledaagse hardware kunnen draaien en de helderheid van beelden in wetenschap, geneeskunde, veiligheid en daarbuiten kunnen verbeteren.

Bronvermelding: Zheng, X., Chen, Z. & Huang, D. Lightweight super-resolution method based on scattering processing and feature interaction. Sci Rep 16, 15018 (2026). https://doi.org/10.1038/s41598-026-44351-5

Trefwoorden: beeldsuperresolutie, deep learning, transformer-modellen, frequentiedecompositie, efficiënte visiemodellen