Clear Sky Science · es

Método ligero de súper-resolución basado en procesamiento de dispersión e interacción de características

Imágenes más nítidas a partir de fotos borrosas

Cualquiera que haya hecho zoom en una foto de smartphone conoce la decepción de los detalles pixelados y difuminados. Desde cámaras de seguridad hasta escáneres médicos y vistas satelitales, muchas imágenes importantes sufren el mismo problema. Este artículo presenta una nueva forma de convertir imágenes de baja resolución en otras más claras, con el objetivo de recuperar bordes y texturas nítidos manteniendo el coste computacional lo bastante bajo para dispositivos reales.

Por qué es tan difícil aumentar el detalle

La súper-resolución de imágenes es la tarea de reconstruir una imagen de alta resolución a partir de una entrada de baja resolución. Importa en la fotografía cotidiana, pero también en la vigilancia por vídeo, la imagen médica y la teledetección. Los sistemas clásicos de aprendizaje profundo basados en redes neuronales convolucionales pueden mejorar imágenes, pero se centran principalmente en pequeños vecindarios de píxeles y a menudo pasan por alto cómo se relacionan partes distantes de una imagen. Los modelos más recientes basados en Transformers capturan estas relaciones a largo alcance pero son costosos de ejecutar y siguen teniendo dificultades para reconstruir los detalles más finos, como texturas diminutas y bordes finos, especialmente en dispositivos con potencia de cálculo limitada.

Separar la imagen en cambios lentos y rápidos

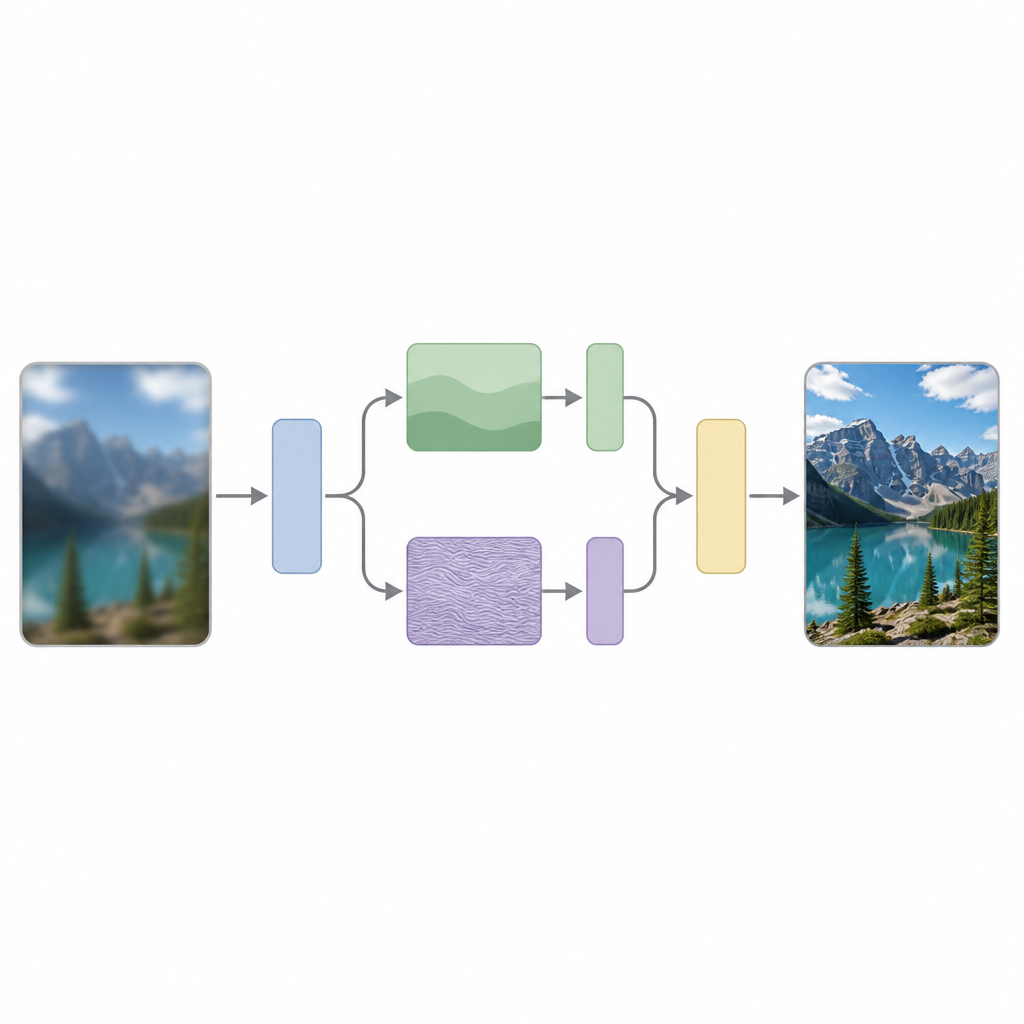

Los autores sostienen que una razón clave de esta dificultad es que la mayoría de los modelos tratan todas las partes de una imagen por igual, aunque las imágenes contienen de forma natural una mezcla de cambios lentos, como cielos suaves, y cambios rápidos, como bordes afilados o patrones repetitivos. Su método, llamado Scattering Processing and Feature Interaction (SPFI), aborda esto separando explícitamente las características de entrada en componentes de baja frecuencia que describen la estructura amplia y componentes de alta frecuencia que codifican los detalles finos. Utilizan una herramienta matemática conocida como Transformada Wavelet Compleja de Doble Árbol para realizar esta separación de una manera menos sensible a pequeños desplazamientos en la imagen y mejor en detectar direcciones, como líneas y bordes.

Tratamiento especial para los detalles finos sin alto coste

Una vez separada la información de la imagen, SPFI procesa las partes suaves y detalladas de forma distinta. La información de baja frecuencia, que es compacta, se maneja con un método de mezcla sencillo para capturar la estructura global. Para la parte de alta frecuencia, un enfoque directo requeriría un número enorme de operaciones porque intentaría relacionar cada píxel con todos los demás. Para evitar esto, los autores diseñan un Método de Mezcla Einstein que reconfigura inteligentemente los datos y mezcla canales de manera que conserva las interacciones de detalle importantes mientras reduce drásticamente el número de operaciones. En efecto, el modelo presta atención adicional a bordes y texturas sin volverse demasiado grande o lento.

Reunir escalas de forma eficiente

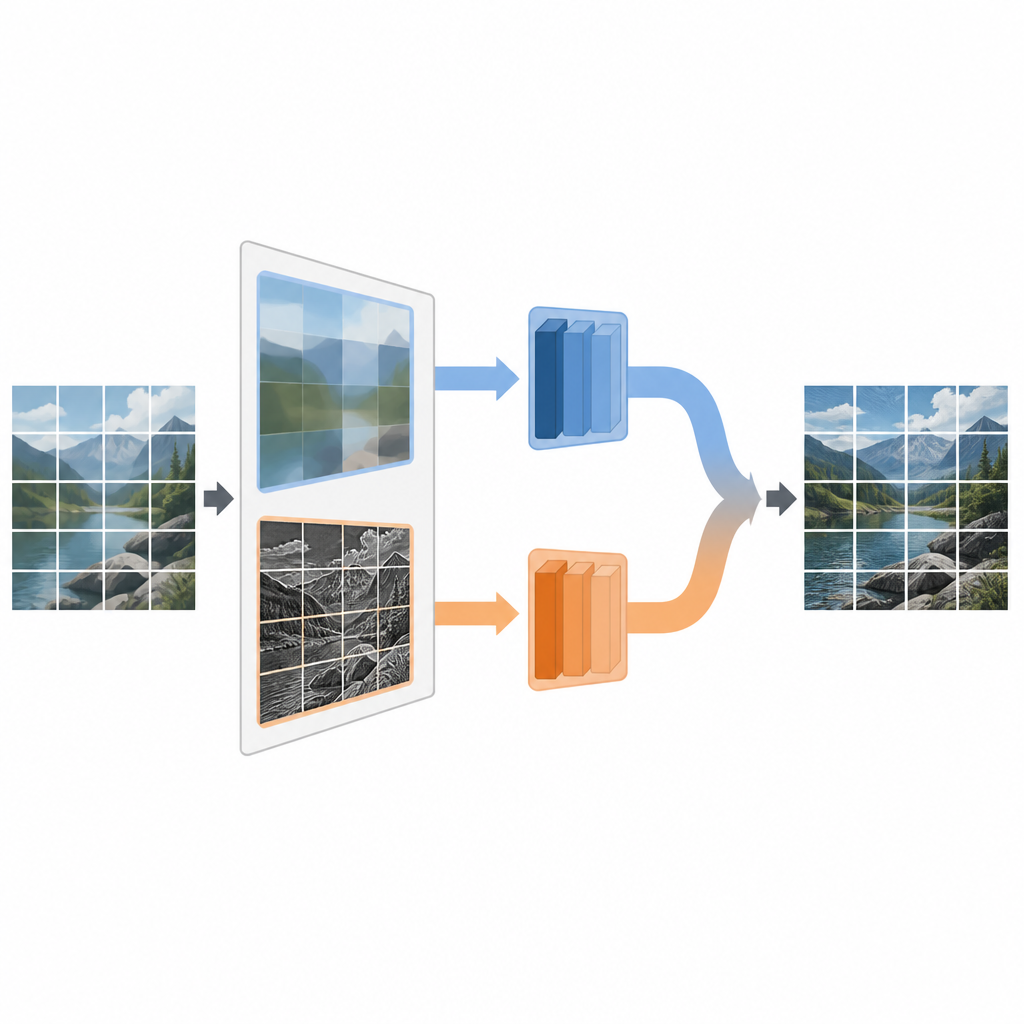

Otro desafío para una reconstrucción nítida es que la información útil aparece en múltiples escalas, desde patrones diminutos hasta formas amplias. La atención estándar de los Transformers trata todos los tokens a una sola escala, lo que resulta costoso y limitado. SPFI introduce un bloque de Integración entre tokens que crea varias versiones de las características a diferentes escalas usando convoluciones separables en profundidad, una forma ligera de filtrado. Estos flujos multiescala interactúan y se recombinan antes del paso de atención, de modo que el modelo puede usar tanto el detalle local como el contexto global mientras reduce la carga computacional de la atención. Este diseño ayuda a la red a centrarse en las interacciones más relevantes sin malgastar cálculo.

Mejor calidad, resultados más rápidos, con algunas salvedades

En pruebas sobre bancos de imágenes estándar, SPFI produjo reconstrucciones de mayor calidad que una serie de métodos recientes de súper-resolución, incluidos varios basados en Transformers, mientras usaba menos operaciones en coma flotante. Alcanzó ratios señal-ruido pico ligeramente superiores y mejores puntuaciones de similitud estructural, y se ejecutó más rápido durante la inferencia, lo que lo hace más adecuado para uso casi en tiempo real. Las comparaciones visuales muestran que SPFI recupera fachadas y otras texturas con menos artefactos borrosos, y también resulta relativamente robusto cuando las imágenes de entrada contienen ruido o están degradadas de formas algo distintas a las esperadas. Sin embargo, los autores señalan que detalles muy pequeños e irregulares, como textos diminutos, siguen siendo un reto, lo que sugiere que una forma fija de separar frecuencias puede no encajar con todo tipo de patrones.

Qué implica esto para futuras herramientas de imagen

Para un público no especializado, el mensaje principal es que los autores han encontrado una forma de agudizar imágenes separando primero las regiones suaves de los detalles finos y luego dejando que estas partes interactúen de forma eficiente entre escalas. Su método SPFI muestra que combinar un procesamiento sensible a la frecuencia con una mezcla cuidadosa de características puede producir imágenes más claras con un coste computacional menor. Aunque no recupera perfectamente todo tipo de detalle, especialmente textos intrincados, apunta hacia sistemas de súper-resolución más prácticos que podrían ejecutarse en hardware cotidiano y mejorar la claridad de imágenes usadas en ciencia, medicina, seguridad y más allá.

Cita: Zheng, X., Chen, Z. & Huang, D. Lightweight super-resolution method based on scattering processing and feature interaction. Sci Rep 16, 15018 (2026). https://doi.org/10.1038/s41598-026-44351-5

Palabras clave: súper-resolución de imágenes, aprendizaje profundo, modelos transformer, decomposición de frecuencias, modelos de visión eficientes