Clear Sky Science · fr

Données de distillation par lots pour développer des méthodes d’apprentissage automatique de détection d’anomalies

Pourquoi il est important de surveiller les incidents dans les usines chimiques

Les usines chimiques soutiennent discrètement la vie moderne, produisant carburants, médicaments, plastiques et une infinité de produits du quotidien. Mais lorsque quelque chose tourne mal dans ces systèmes complexes — qu’une pompe s’encrasse, qu’une vanne bloque ou qu’un capteur dérive — les conséquences peuvent aller du gaspillage de matière à des accidents dangereux. Les ingénieurs espèrent de plus en plus utiliser l’intelligence artificielle moderne pour repérer automatiquement les signes avant-coureurs. Pourtant, il existe un obstacle fondamental : les algorithmes avancés ont besoin de grandes quantités de données réelles et de haute qualité pour apprendre, et ces données sont rarement partagées en dehors de l’industrie. Cet article s’attaque directement à cet obstacle en construisant une petite mais sophistiquée unité de distillation en laboratoire et en l’utilisant pour créer et publier ouvertement un jeu de données riche comprenant à la fois des comportements normaux et des défauts soigneusement induits.

Un équivalent de table de travail d’une usine chimique complète

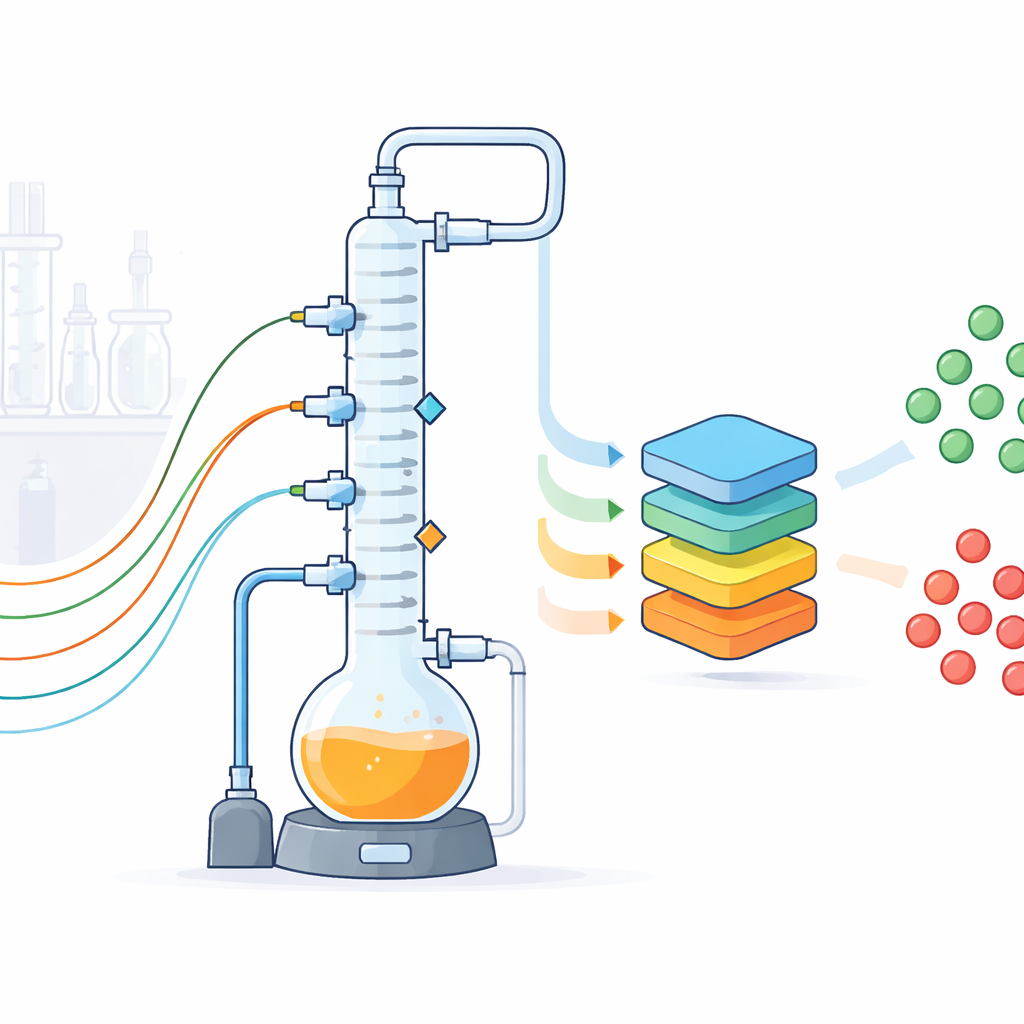

Les chercheurs ont conçu un montage de distillation par lots à parois de verre qui reproduit une étape de séparation industrielle courante, où un mélange chauffé est porté à ébullition et ses vapeurs sont séparées dans une colonne haute entre composants plus légers et plus lourds. Leur installation de laboratoire comprend une cuve d’ébullition de deux litres, une colonne en trois sections garnie pour améliorer la séparation, des condenseurs, des pompes et un système de vide qui permet de fonctionner en dessous de la pression atmosphérique. Bien que l’équipement tienne sur une paillasse, il est construit pour se comporter comme une unité industrielle réduite, avec tuyauterie réaliste, isolation et matériel de contrôle. Parce que l’installation est transparente, flexible et accessible, l’équipe peut expérimenter librement de manières qui seraient risquées ou impraticables en usine.

Surveiller chaque mouvement avec de nombreux types de capteurs

Pour transformer cette installation en une usine à données, les auteurs l’ont équipée d’un ensemble de capteurs classiques et non conventionnels. Des instruments standards mesurent les températures à plusieurs points de la colonne, les pressions, les niveaux de liquide et les débits des produits, du reflux et de l’eau de refroidissement. La précision et l’incertitude de chaque capteur ont été étalonnées et documentées. En plus de ceux-ci, trois caméras enregistrent des images des récipients clés et des condenseurs toutes les deux secondes, un microphone écoute les sons des pompes et de l’ébullition, et un spectromètre par résonance magnétique nucléaire (RMN) compact suit en continu l’évolution de la composition du mélange au cours du temps. Des échantillons supplémentaires sont analysés par chromatographie en phase gazeuse. Tous les appareils sont reliés par un système de contrôle basé sur Python qui exécute des recettes, consigne chaque événement et changement de réglage, et enregistre des relevés chaque seconde dans des fichiers structurés, avec les valeurs manquantes clairement signalées.

Créer et étiqueter des défauts de manière volontaire

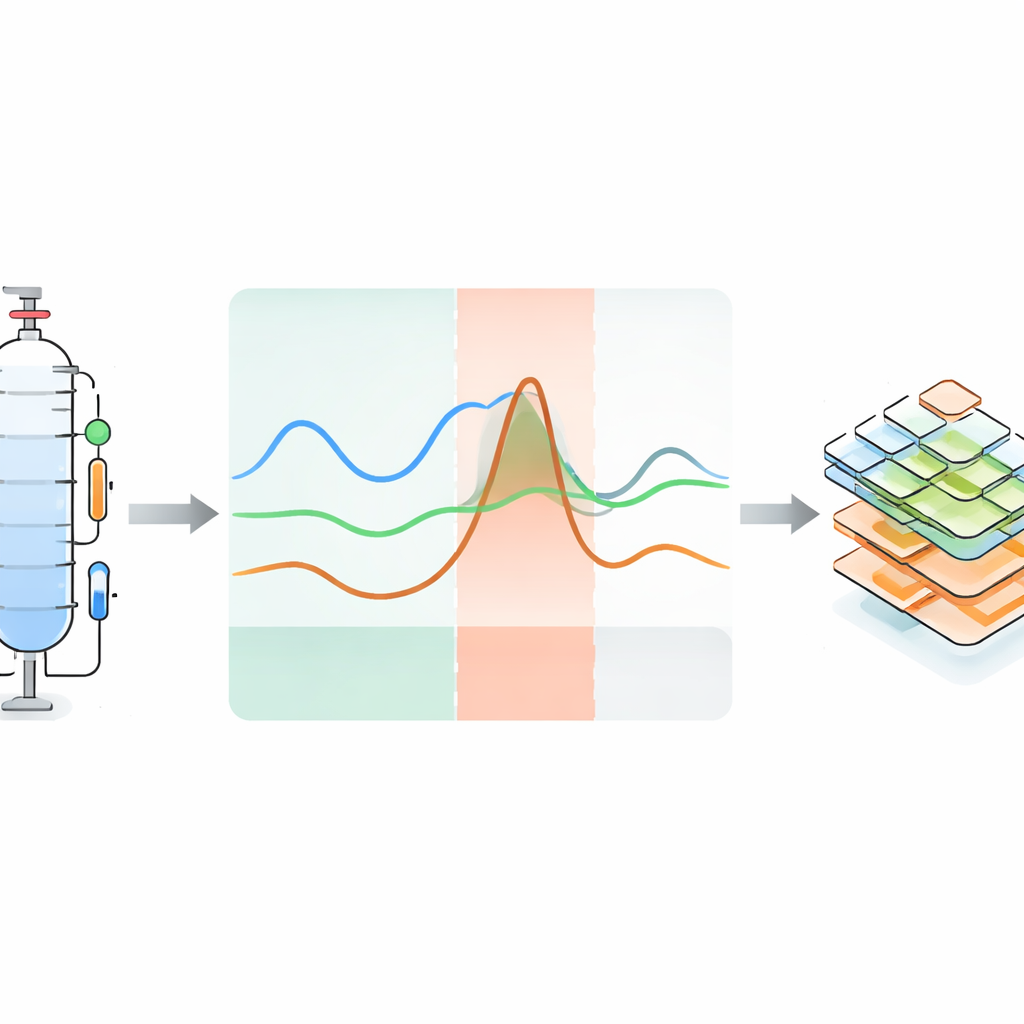

Le cœur du projet ne consiste pas seulement à collecter des données de lots routiniers, mais à faire volontairement dysfonctionner l’installation de manière contrôlée. Au cours de 119 expériences, l’équipe a réalisé des séries sans défauts et avec défauts pour plusieurs mélanges liquides. Pendant l’exploitation, ils ont introduit des perturbations telles que des changements temporaires de la puissance du chauffe‑cuve ou de la pression de colonne, une modification du refroidissement, une perturbation du partage de reflux, l’injection de substances supplémentaires ou la corruption des signaux des capteurs. Chaque perturbation entraîne une « anomalie » — une déviation visible dans une ou plusieurs séries temporelles de capteurs. La réponse se divise naturellement en trois phases : une phase initiale aveugle où le changement ne s’est pas encore manifesté dans les relevés, une phase anormale où la déviation est claire, et une phase de récupération où le système revient progressivement vers la normale une fois le défaut supprimé. Certaines expériences ne récupèrent jamais complètement, imitant des défaillances industrielles graves. Pour de nombreuses séries anormales, une expérience normale correspondante sous les mêmes conditions est également fournie.

Transformer les incidents de procédé en connaissances lisibles par machine

Conscients que les chiffres seuls ne suffisent pas, les auteurs joignent des métadonnées détaillées expliquant ce qui s’est passé dans chaque série anormale et pourquoi. Ils s’appuient sur des cadres ontologiques existants — des vocabulaires formels pour décrire capteurs, systèmes et défaillances — afin d’encoder, de façon structurée, le type de perturbation, le composant affecté, l’effet observable et le calendrier de chaque phase. Ces descriptions sont stockées dans des fichiers YAML lisibles par des humains mais également interprétables par des machines, liant des anomalies spécifiques à des capteurs et parties précises de l’installation. Le jeu de données est organisé de manière hiérarchique : les utilisateurs peuvent naviguer depuis des informations générales sur l’installation, vers des configurations matérielles particulières et des points de fonctionnement, jusqu’aux expériences individuelles avec les séries temporelles associées, images, pistes audio, données RMN, informations d’incertitude et annotations d’anomalies.

Mettre les méthodes d’IA modernes à l’épreuve du monde réel

Pour démontrer la valeur et la difficulté du jeu de données, les auteurs ont appliqué une gamme de méthodes de détection d’anomalies sur séries temporelles à la pointe — modèles de prévision, approches basées sur la reconstruction, modèles génératifs et hybrides qui avaient auparavant montré d’excellents résultats sur une référence synthétique bien connue appelée Tennessee‑Eastman Process. Sur ces données simulées, ces méthodes obtenaient à nouveau de très bons scores. Mais lorsqu’elles ont été entraînées sur un sous‑jeu des nouvelles données expérimentales de distillation par lots et évaluées à l’aide d’une métrique standard précision‑rappel, leurs performances ont chuté nettement dans tous les cas. Ce contraste souligne à quel point les signaux de procédés réels sont plus désordonnés et difficiles que les simulations idéalisées, avec un bruit plus riche, des dérives subtiles et des couplages complexes entre variables.

Ce que cela signifie pour des usines plus sûres et plus intelligentes

Pour un non‑spécialiste, la conclusion clé est que ce travail fournit le « terrain d’entraînement » manquant dont l’IA moderne a besoin pour devenir réellement utile à la surveillance des opérations chimiques. En publiant ouvertement un enregistrement multisensoriel soigneusement documenté d’un procédé de distillation réaliste — complet avec défauts connus et explications d’experts sur leurs causes — les auteurs offrent aux chercheurs une plateforme de test commune et exigeante. Les études futures pourront utiliser ces données pour comparer des algorithmes, développer des modèles plus transparents et explicables, et explorer des stratégies non seulement pour détecter les anomalies mais aussi pour les comprendre et les atténuer. À long terme, les avancées fondées sur des jeux de données comme celui‑ci pourraient aider les usines réelles à détecter les problèmes plus tôt, réduire les déchets et fonctionner de manière plus sûre.

Citation: Arweiler, J., Jungjohann, I., Muraleedharan, A. et al. Batch Distillation Data for Developing Machine Learning Anomaly Detection Methods. Sci Data 13, 513 (2026). https://doi.org/10.1038/s41597-026-07124-3

Mots-clés: détection d’anomalies, distillation par lots, données de procédés chimiques, apprentissage automatique, jeu de données temporelles