Clear Sky Science · de

Batchdestillationsdaten zur Entwicklung maschineller Lernverfahren zur Anomalieerkennung

Warum das Beobachten von Störungen in Chemieanlagen wichtig ist

Chemieanlagen sind stille Stützen des modernen Lebens: Sie erzeugen Treibstoffe, Arzneimittel, Kunststoffe und zahllose Alltagsprodukte. Wenn in diesen komplexen Systemen etwas schiefläuft — eine Pumpe verstopft, ein Ventil klemmt oder ein Sensor driftet — können die Folgen von Materialverlust bis hin zu gefährlichen Unfällen reichen. Ingenieure hoffen zunehmend, moderne künstliche Intelligenz einzusetzen, um Frühwarnzeichen automatisch zu erkennen. Es gibt jedoch ein grundlegendes Hindernis: Fortschrittliche Algorithmen benötigen große Mengen hochwertiger, realer Daten zum Lernen, und solche Daten werden selten außerhalb der Industrie geteilt. Dieses Papier geht genau dieses Problem an, indem es eine kleine, aber anspruchsvolle Destillationsanlage im Labor aufbaut und damit einen reichhaltigen Datensatz sowohl normalen Verhaltens als auch gezielt erzeugter Störungen erstellt und offen freigibt.

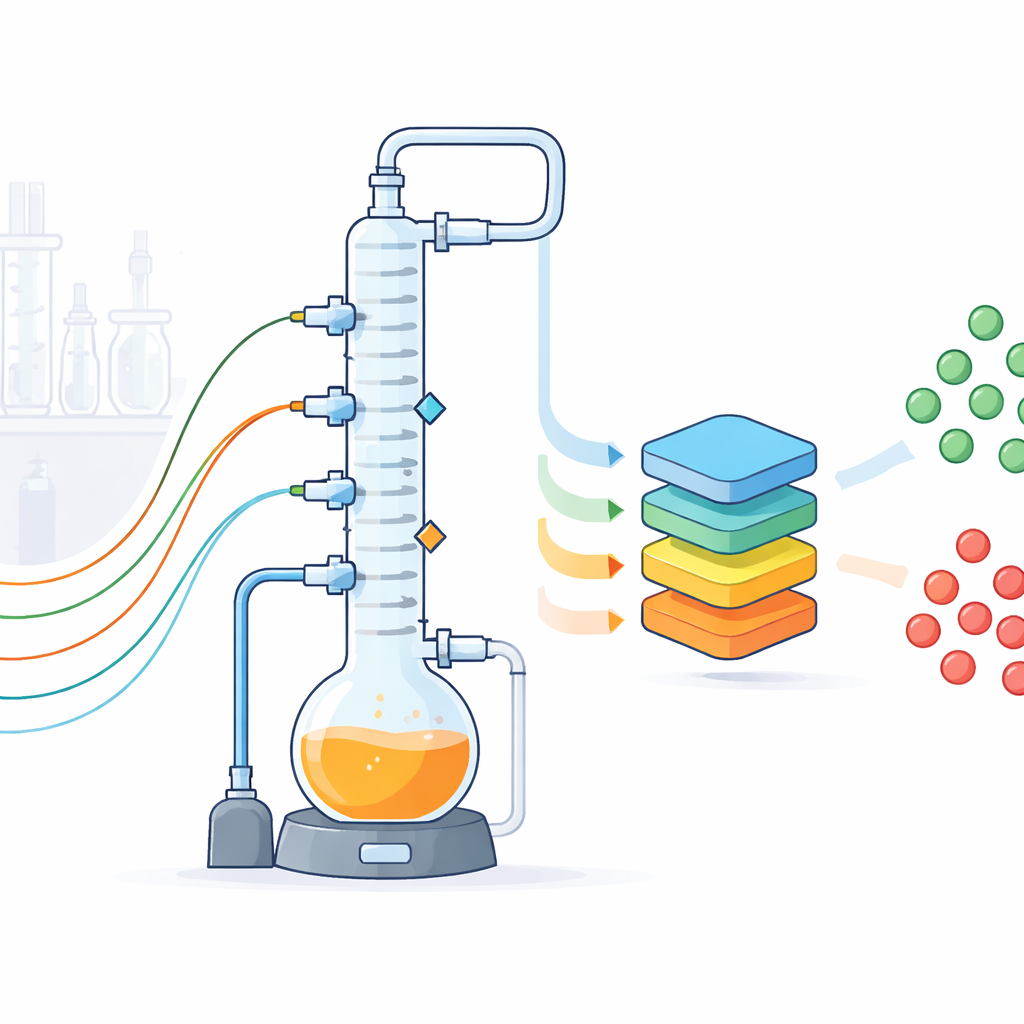

Ein Tischmodell als Stellvertreter für eine komplette Chemieanlage

Die Forschenden entwarfen einen batchdestillationsaufbau mit Glaswänden, der einen gängigen industriellen Trennschritt nachahmt: Eine erhitzte Mischung wird verdampft und in einer hohen Kolonne in leichtere und schwerere Komponenten separiert. Die Laboranlage umfasst ein zwei Liter fassendes Siedegefäß, eine dreiteilige, mit Packungsmaterial versehene Kolonne zur Verbesserung der Trennung, Kondensatoren, Pumpen und ein Vakuumsystem, das Betrieb unter atmosphärischem Druck erlaubt. Obwohl die Ausrüstung auf eine Laborbank passt, ist sie so konstruiert, dass sie sich wie eine verkleinerte Industrieeinheit verhält, mit realistischen Rohrleitungen, Isolierung und Steuerhardware. Weil die Anlage transparent, flexibel und zugänglich ist, kann das Team frei experimentieren — auf Weisen, die in einer Fabrik riskant oder unpraktisch wären.

Jede Bewegung beobachten mit vielen Sensortypen

Um die Anlage in eine Datenfabrik zu verwandeln, statteten die Autorinnen und Autoren sie mit einer Reihe konventioneller und unkonventioneller Sensoren aus. Standardinstrumente messen Temperaturen an mehreren Punkten entlang der Kolonne, Drücke, Flüssigkeitsstände sowie Durchflussraten von Produkt, Rücklauf und Kühlwasser. Die Genauigkeit und Unsicherheit jedes Sensors wurden kalibriert und dokumentiert. Darüber hinaus zeichnen drei Kameras alle zwei Sekunden Bilder wichtiger Gefäße und der Kondensatoren auf, ein Mikrofon nimmt Geräusche von Pumpen und Sieden auf und ein kompakter Kernspinresonanz(NMR)-Spektrometer verfolgt kontinuierlich, wie sich die Zusammensetzung der Mischung mit der Zeit verändert. Zusätzliche Proben werden mittels Gaschromatographie analysiert. Alle Geräte sind durch ein Python-basiertes Steuersystem verbunden, das Rezepte ausführt, jedes Ereignis und jede Einstellung protokolliert und Messwerte sekündlich in strukturierte Dateien streamt, wobei fehlende Werte deutlich gekennzeichnet sind.

Störungen absichtlich erzeugen und kennzeichnen

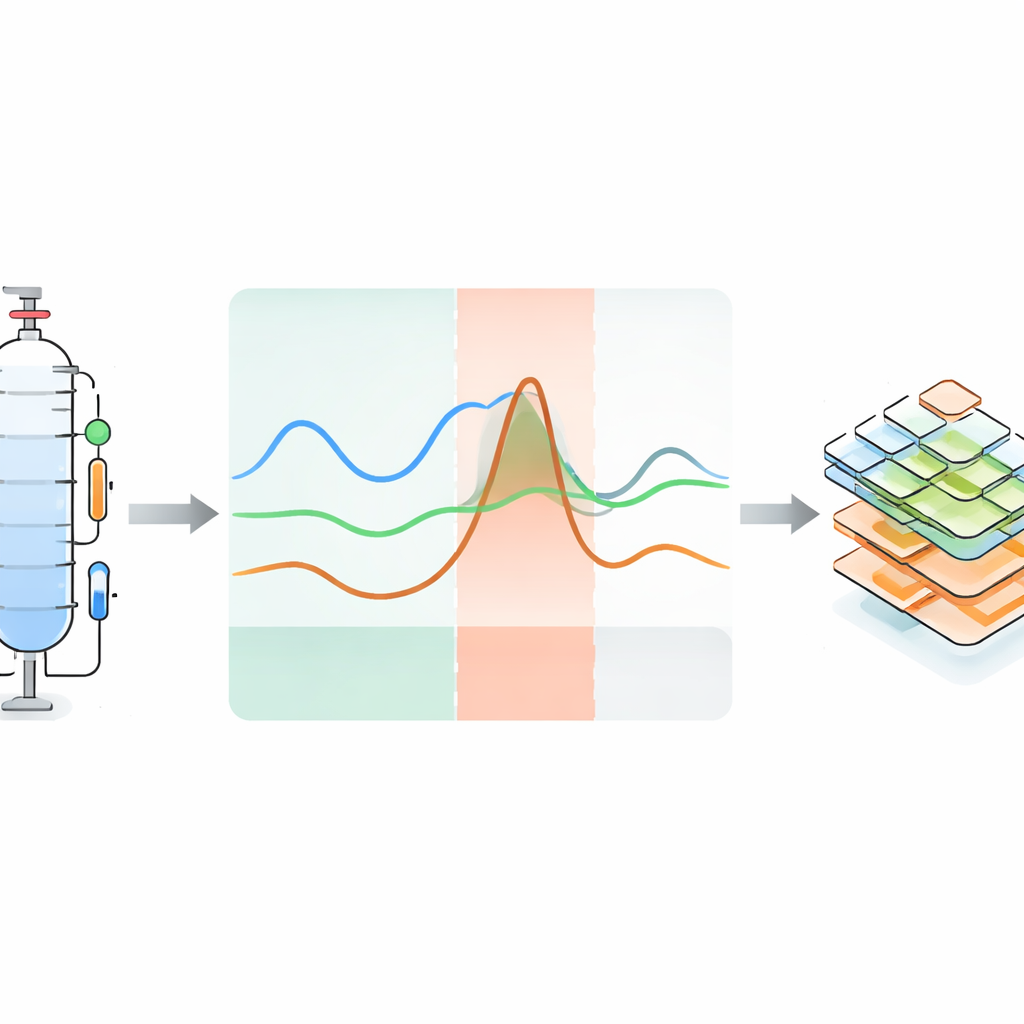

Kern des Projekts ist nicht nur das Sammeln von Daten aus Routineläufen, sondern das absichtliche Fehlverhalten der Anlage in kontrollierter Form. In 119 Experimenten führten die Forschenden sowohl störungsfreie als auch fehlerbehaftete Läufe mit mehreren Flüssigkeitsgemischen durch. Während des Betriebs wurden Störungen eingeführt, etwa temporäre Änderungen der Heizleistung oder des Kolonnendrucks, veränderte Kühlung, Störungen der Rücklaufaufteilung, Einspritzung zusätzlicher Substanzen oder Manipulation von Sensorsignalen. Jede Störung führt zu einer „Anomalie“ — einer sichtbaren Abweichung in einer oder mehreren Sensorzeitreihen. Die Reaktion lässt sich natürlicherweise in drei Phasen gliedern: eine anfängliche blinde Phase, in der die Änderung noch nicht in den Messwerten sichtbar ist, eine anomale Phase, in der die Abweichung klar erkennbar ist, und eine Erholungsphase, in der das System nach Entfernung der Störung wieder Richtung Normalverhalten driftet. Manche Experimente erholen sich nie vollständig und bilden damit ernsthafte industrielle Ausfälle nach. Für viele anomale Läufe liegt zudem ein eng passender Normal-Lauf unter denselben Bedingungen vor.

Prozessstörungen in maschinenlesbares Wissen überführen

Die Autorinnen und Autoren erkannten, dass Zahlen allein nicht ausreichen, und fügten detaillierte Metadaten an, die erklären, was in jedem anomalen Lauf geschehen ist und warum. Sie bauen auf bestehenden Ontologie-Frameworks — formalen Vokabularen zur Beschreibung von Sensoren, Systemen und Ausfällen — auf, um strukturiert den Typ der Störung, die betroffene Komponente, die beobachtbaren Effekte und das Timing jeder Phase zu kodieren. Diese Beschreibungen werden in menschenlesbaren YAML-Dateien gespeichert, sind aber auch maschineninterpretierbar und verknüpfen spezifische Anomalien mit bestimmten Sensoren und Anlagenteilen. Der Datensatz ist hierarchisch organisiert: Anwender können von allgemeinen Informationen über die Anlage zu konkreten Hardwarekonfigurationen und Betriebspunkten navigieren bis hin zu einzelnen Experimenten mit zugehörigen Zeitreihen, Bildern, Audio-, NMR-Daten, Unsicherheitsinformationen und Anomalieannotationen.

Moderne KI-Methoden einem realen Test unterziehen

Um den Wert und die Schwierigkeit des Datensatzes zu demonstrieren, wendeten die Autorinnen und Autoren eine Reihe moderner Zeitreihen-Anomalieerkennungsverfahren an, darunter Vorhersagemodelle, rekonstruktionsbasierte Ansätze, generative Modelle und Hybride, die zuvor auf einem bekannten synthetischen Benchmark, dem Tennessee-Eastman-Prozess, sehr gute Ergebnisse erzielt hatten. Auf diesen simulierten Daten erreichten die Methoden erneut hohe Werte. Wurden sie jedoch auf einem Teilmenge der neuen experimentellen Batchdestillationsdaten trainiert und mit einer standardisierten Precision–Recall-Metrik bewertet, brach ihre Leistung durchgängig stark ein. Dieser Kontrast unterstreicht, wie viel unordentlicher und herausfordernder reale Prozesssignale im Vergleich zu idealisierten Simulationen sind — mit reichhaltigerem Rauschen, subtilen Driften und komplexen Kopplungen zwischen Variablen.

Was das für sicherere und intelligentere Anlagen bedeutet

Für Nichtfachleute ist die wichtigste Erkenntnis: Diese Arbeit liefert das fehlende „Trainingsgelände“, das moderne KI braucht, um wirklich nützlich für die Überwachung chemischer Prozesse zu werden. Indem die Autorinnen und Autoren einen sorgfältig dokumentierten, multisensorischen Datensatz eines realistischen Destillationsprozesses offen freigeben — komplett mit bekannten Fehlern und fachlichen Erklärungen ihrer Ursachen — stellen sie Forschenden eine gemeinsame, anspruchsvolle Testumgebung zur Verfügung. Zukünftige Studien können diese Daten nutzen, um Algorithmen zu benchmarken, transparentere und erklärbare Modelle zu entwickeln und Strategien zu erforschen, die nicht nur Anomalien erkennen, sondern auch verstehen und abmildern. Langfristig könnten auf solchen Datensätzen aufgebaute Fortschritte realen Anlagen helfen, Probleme früher zu erkennen, Abfall zu reduzieren und sicherer zu arbeiten.

Zitation: Arweiler, J., Jungjohann, I., Muraleedharan, A. et al. Batch Distillation Data for Developing Machine Learning Anomaly Detection Methods. Sci Data 13, 513 (2026). https://doi.org/10.1038/s41597-026-07124-3

Schlüsselwörter: Anomalieerkennung, Batchdestillation, Daten chemischer Prozesse, maschinelles Lernen, Zeitreihendatensatz