Clear Sky Science · fr

La vérification collaborative réduit la diffusion de publications trompeuses sur X (anciennement Twitter)

Pourquoi cela compte pour les utilisateurs quotidiens

Chaque jour, des millions de personnes font défiler des fils d’actualité remplis d’urgences, d’opinions tranchées et de rumeurs. Une partie de ces informations est trompeuse ou carrément fausse, et elle peut influencer les opinions sur les élections, la santé et la sécurité publique. Cette étude pose une question pratique qui concerne tous les utilisateurs de X (anciennement Twitter) : lorsque des utilisateurs ordinaires ajoutent des notes de vérification à des publications suspectes, cela ralentit-il réellement la propagation d’informations trompeuses ?

Des experts à la foule

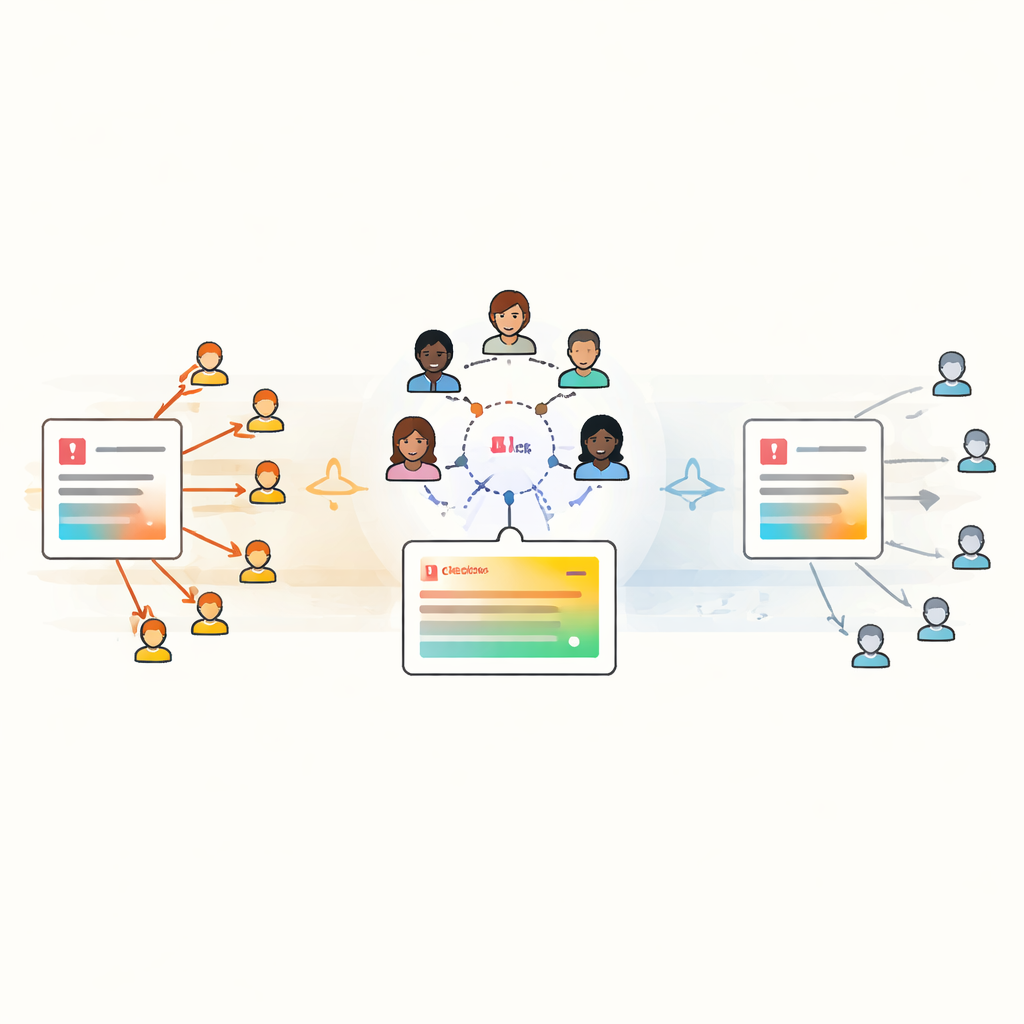

La vérification traditionnelle s’appuie sur des professionnels formés qui enquêtent minutieusement sur les affirmations et publient des corrections. Bien que puissante, cette approche bute sur trois problèmes majeurs : il y a beaucoup plus de contenu que ce que les experts peuvent vérifier, beaucoup de personnes ne voient jamais les vérifications professionnelles, et une large part du public ne leur fait pas entièrement confiance. En réponse, X a lancé les « community notes », un système qui permet aux utilisateurs ordinaires de signaler des publications douteuses, d’ajouter de courtes explications et d’évaluer l’utilité des notes des autres. Une fois qu’un nombre suffisant d’utilisateurs s’accorde sur l’utilité d’une note, celle-ci apparaît directement sous la publication originale, offrant aux lecteurs un contrepoint instantané pendant qu’ils naviguent.

Mesurer l’impact à grande échelle

Les chercheurs ont analysé plus de 237 000 publications sur X qui avaient été ciblées par des community notes sur une période d’environ 20 mois, couvrant plus de 431 millions de repartages. Ils se sont concentrés sur les publications que la communauté avait identifiées comme trompeuses et les ont comparées à des publications très similaires qui n’avaient jamais reçu de note affichée. Pour rendre la comparaison équitable, ils ont apparié les publications en fonction des caractéristiques des auteurs (comme le nombre d’abonnés) et des caractéristiques du contenu (comme les sujets et le ton). En utilisant une méthode statistique appelée différence-en-différences, ils ont suivi l’activité de repartage avant et après l’apparition d’une note, et ils ont contrasté l’évolution des publications « traitées » avec celle de leurs publications « témoins » appariées.

Que se passe-t-il lorsqu’une note apparaît

La conclusion centrale est frappante : une fois qu’une community note est affichée, la diffusion ultérieure de la publication trompeuse chute fortement. En moyenne, les repartages diminuent d’environ 61 % par rapport à ce qu’on aurait attendu sans la note. Cet effet se renforce au cours des douze premières heures après l’apparition de la note. Le schéma se vérifie pour de nombreux types d’utilisateurs et de sujets, y compris pour les personnes qui interagissent fréquemment avec des contenus douteux et pour des utilisateurs de différents bords politiques. Toutefois, les notes fonctionnent un peu moins bien pour les publications provenant de comptes très importants ou vérifiés et pour les contenus politiques ou liés à la santé, ce qui suggère que des audiences fidèles et des sujets sensibles peuvent atténuer l’impact des corrections communautaires.

Le timing est crucial

Malgré leur fort effet local, les community notes arrivent souvent tard dans la vie d’une publication. La plupart des repartages sur X se produisent rapidement, la moitié du total sur 36 heures étant généralement atteinte en quelques heures. En revanche, les notes utiles sont généralement affichées beaucoup plus tard, souvent après que l’essentiel de la vague virale soit passée. Lorsque les chercheurs ont estimé le nombre de repartages évités au total, ils ont constaté que les community notes réduisaient l’engagement global avec les publications trompeuses d’environ 15 %. Des simulations suggèrent que si les notes apparaissaient beaucoup plus tôt — par exemple dans les deux heures suivant la publication — la réduction totale des repartages pourrait dépasser 50 %. L’étude montre également que les publications avec des notes affichées sont presque deux fois plus susceptibles d’être supprimées par leurs auteurs, tandis qu’il n’y a aucune indication que l’application des règles de la plateforme (comme la suspension de comptes) soit déclenchée par les notes elles‑mêmes.

Ce que cela signifie pour la lutte contre les fausses informations

Pour les utilisateurs quotidiens, le message est double. D’abord, la vérification communautaire peut fonctionner : lorsque des corrections clairement visibles de la part d’autres utilisateurs apparaissent sur des publications trompeuses, ces publications sont beaucoup moins partagées, et certains auteurs les retirent même. Ensuite, la rapidité est essentielle. Parce que la désinformation circule vite, même une correction efficace a une portée limitée si elle arrive trop tard. L’étude suggère qu’améliorer la rapidité et l’étendue de l’affichage des community notes pourrait transformer un impact modeste au niveau du système en un frein beaucoup plus puissant sur les fausses informations virales — une considération importante à mesure que les réseaux sociaux et l’IA facilitent davantage la propagation de contenus trompeurs.

Citation: Chuai, Y., Pilarski, M., Renault, T. et al. Community-based fact-checking reduces the spread of misleading posts on X (formerly Twitter). Nat Commun 17, 4070 (2026). https://doi.org/10.1038/s41467-026-72597-0

Mots-clés: désinformation, réseaux sociaux, vérification des faits, community notes, confiance en ligne