Clear Sky Science · de

Community-basierte Faktenprüfung reduziert die Verbreitung irreführender Beiträge auf X (ehemals Twitter)

Warum das für Alltagnutzer wichtig ist

Jeden Tag scrollen Millionen Menschen durch soziale Feeds voller Eilmeldungen, Meinungsäußerungen und Gerüchte. Ein Teil dieser Informationen ist irreführend oder schlicht falsch und kann Einstellungen zu Wahlen, Gesundheit und öffentlicher Sicherheit prägen. Diese Studie stellt eine praktische Frage, die alle X-Nutzer (ehemals Twitter) betrifft: Wenn gewöhnliche Nutzer Faktenprüfungsnotizen zu verdächtigen Beiträgen hinzufügen, verlangsamt das tatsächlich die Verbreitung irreführender Informationen?

Von Expert:innen zur Crowd

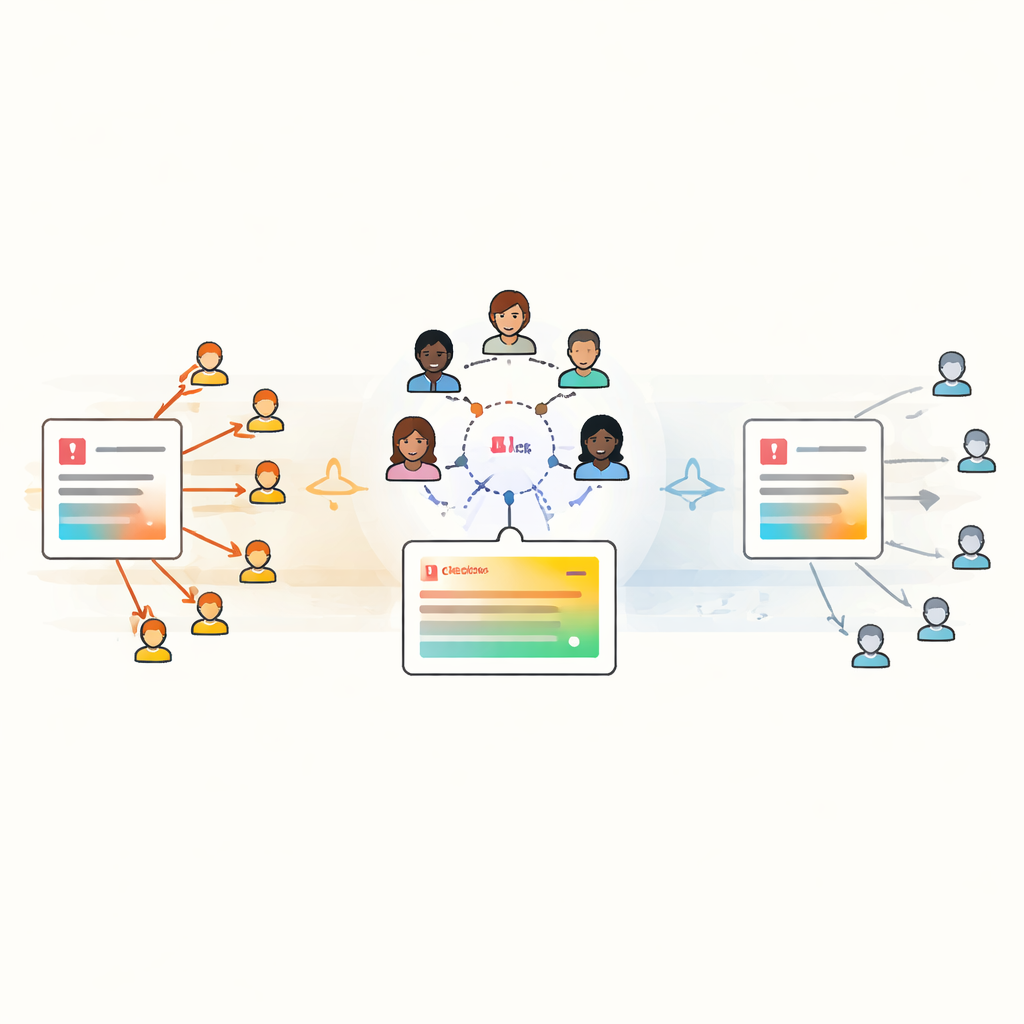

Traditionelle Faktenprüfung beruht auf geschulten Fachleuten, die Behauptungen sorgfältig untersuchen und Korrekturen veröffentlichen. Diese Vorgehensweise ist zwar wirksam, stößt aber an drei große Probleme: Es gibt viel mehr Inhalte, als Expert:innen prüfen können; viele Menschen sehen professionelle Faktenchecks nie; und große Teile der Öffentlichkeit vertrauen ihnen nicht vollständig. Als Antwort darauf führte X „Community Notes“ ein — ein System, das normalen Nutzer:innen erlaubt, fragwürdige Beiträge zu markieren, kurze Erklärungen hinzuzufügen und die Nützlichkeit anderer Notizen zu bewerten. Sobald genügend Nutzer:innen eine Notiz als hilfreich einstufen, erscheint sie direkt unter dem Originalbeitrag und liefert Leser:innen beim Durchscrollen einen sofortigen Gegenpunkt.

Wirkung in großem Maßstab messen

Die Forschenden analysierten mehr als 237.000 Beiträge auf X, die über einen Zeitraum von etwa 20 Monaten Ziel von Community Notes waren, und bezogen dabei über 431 Millionen Reposts mit ein. Sie konzentrierten sich auf Beiträge, die die Community als irreführend markiert hatte, und verglichen diese mit sehr ähnlichen Beiträgen, die niemals eine angezeigte Notiz erhielten. Um den Vergleich fair zu gestalten, paarten sie Beiträge anhand von Autor:innenmerkmalen (etwa Follower-Zahlen) und Inhaltsmerkmalen (etwa Themen und Tonfall). Mittels eines statistischen Verfahrens namens Difference-in-Differences verfolgten sie die Repost-Aktivität vor und nach dem Erscheinen einer Notiz und verglichen die Veränderung der „behandelten“ Beiträge mit der Veränderung ihrer passenden „Kontroll“-Beiträge.

Was passiert, sobald eine Notiz erscheint

Das zentrale Ergebnis ist eindrücklich: Sobald eine Community-Note angezeigt wird, fällt die weitere Verbreitung des irreführenden Beitrags stark ab. Im Durchschnitt sinkt das Reposting um etwa 61 Prozent verglichen mit dem, was ohne die Notiz zu erwarten gewesen wäre. Dieser Effekt verstärkt sich in den ersten zwölf Stunden nach dem Erscheinen der Notiz. Das Muster zeigt sich bei vielen Nutzer:innentypen und Themen, einschließlich Personen, die häufig mit fragwürdigen Inhalten interagieren, sowie Nutzer:innen verschiedener politischer Ausrichtungen. Allerdings wirken die Notizen etwas weniger stark bei Beiträgen von sehr großen oder verifizierten Accounts sowie bei politischen oder gesundheitsbezogenen Inhalten, was darauf hindeutet, dass treue Anhängerschaften und sensible Themen die Wirkung gemeinschaftlicher Korrekturen abschwächen können.

Timing ist alles

Trotz ihrer starken lokalen Wirkung erscheinen Community Notes oft spät im Lebenszyklus eines Beitrags. Die meisten Weiterverbreitungen auf X erfolgen schnell: Die Hälfte der Reposts innerhalb von 36 Stunden ist typischerweise in wenigen Stunden erreicht. Im Gegensatz dazu werden hilfreiche Notizen meist deutlich später angezeigt, oft nachdem die virale Welle schon größtenteils abgeklungen ist. Als die Forschenden schätzten, wie viele Reposts insgesamt verhindert wurden, stellten sie fest, dass Community Notes das Gesamtengagement mit irreführenden Beiträgen um etwa 15 Prozent reduzierten. Simulationen legen nahe, dass bei deutlich früherem Erscheinen der Notizen — etwa innerhalb von zwei Stunden nach Veröffentlichung — die Gesamtreduktion der Reposts mehr als 50 Prozent betragen könnte. Die Studie zeigt außerdem, dass Beiträge mit angezeigten Notizen fast doppelt so häufig von ihren Autor:innen gelöscht werden, während es keine Anzeichen dafür gibt, dass die Plattform-typischen Durchsetzungsmaßnahmen (wie Kontosuspendierungen) durch die Notizen selbst ausgelöst werden.

Was das im Kampf gegen Falschinformationen bedeutet

Für Alltagnutzer:innen lautet die Botschaft doppelt. Erstens: Community-basierte Faktenprüfung kann wirken — wenn sichtbar Korrekturen von Mitnutzenden bei irreführenden Beiträgen erscheinen, werden diese viel seltener geteilt, und einige Autor:innen entfernen ihre Beiträge. Zweitens: Geschwindigkeit ist entscheidend. Weil sich Fehlinformationen schnell verbreiten, hat selbst eine effektive Korrektur nur begrenzte Reichweite, wenn sie zu spät kommt. Die Studie legt nahe, dass eine schnellere und breitere Sichtbarmachung von Community Notes einen bescheidenen systemweiten Effekt in eine deutlich stärkere Bremse gegen virale Falschinformationen verwandeln könnte — ein wichtiger Aspekt, da soziale Medien und KI es leichter denn je machen, irreführende Inhalte zu verbreiten.

Zitation: Chuai, Y., Pilarski, M., Renault, T. et al. Community-based fact-checking reduces the spread of misleading posts on X (formerly Twitter). Nat Commun 17, 4070 (2026). https://doi.org/10.1038/s41467-026-72597-0

Schlüsselwörter: Fehlinformation, soziale Medien, Faktencheck, Community Notes, Online-Vertrauen