Clear Sky Science · zh

基于DCNN算法的音乐教学改革模式的人工智能技术

为普通学生打造更聪明的音乐课程

想象一下在练习钢琴或歌唱时,能够即时、客观地得到关于音准是否准确、节奏是否稳定以及表现是否符合乐曲情绪的反馈——而无需等到下一次课程。本研究探讨了人工智能如何充当无时无刻不在、永不疲倦的助教,在音乐教育中帮助教师和学生从猜测走向以数据为驱动的个性化学习。

传统音乐课堂为何不足

传统音乐教学在很大程度上依赖教师的耳朵、时间和注意力。在拥挤的课堂或繁忙的工作室里,很难为每位学生提供详尽且持续的反馈。评估可能带有主观性,为每个学习者量身定制练习计划也耗时费力。作者认为,擅长从声音中发现模式的计算机可以弥补这些不足。通过分析大约十秒的短音频片段,人工智能系统可以跟踪音高、节奏和音色,并将这些信息转换为可操作的建议,从而支持更精确、公平的评估。

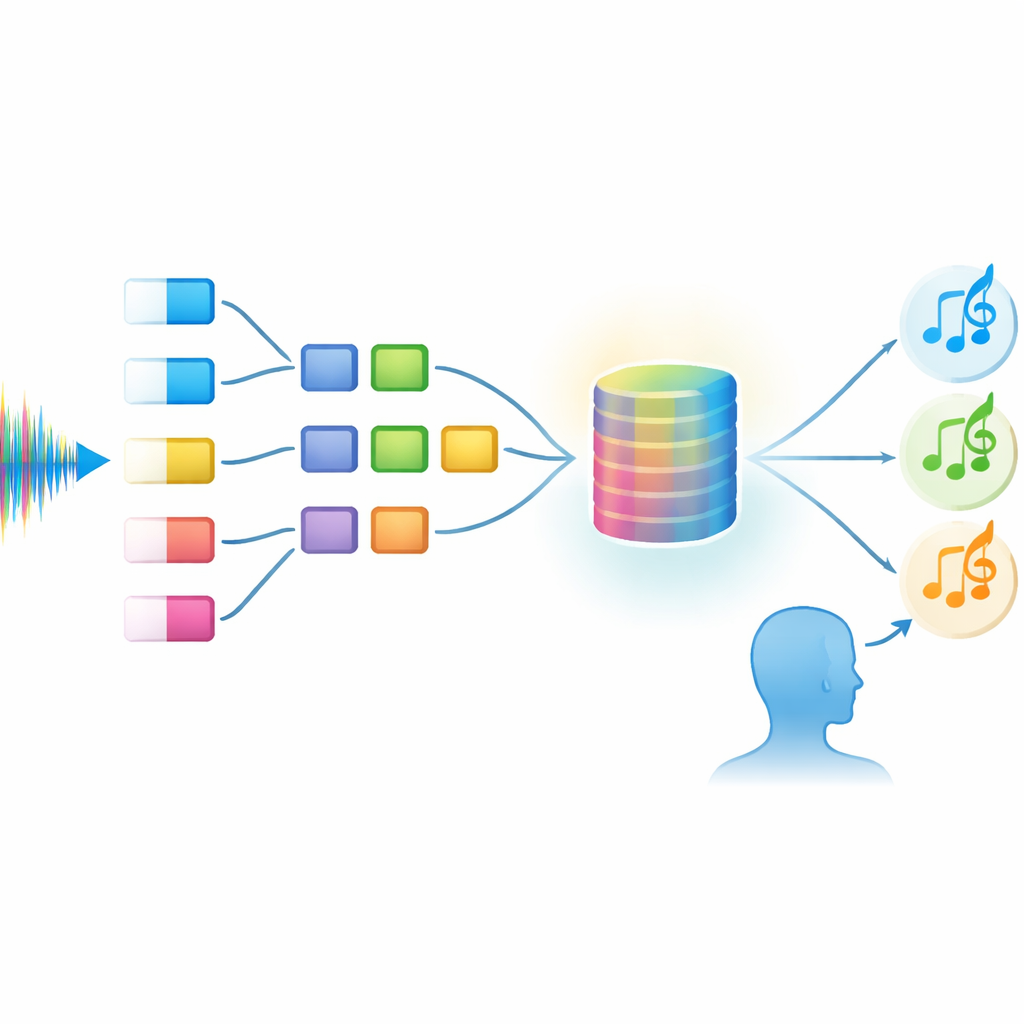

新的聆听引擎如何工作

研究的核心是一种名为MBFN-DCAM的新型音频识别模型。简单来说,它是由多个协同部件构成的数字“耳朵”。首先,系统将输入声音分解成多条并行流,以同时关注音乐的不同方面——例如音色和轮廓。称为膨胀卷积的特殊滤波器使系统能够在不使模型膨胀的情况下“聆听”整个十秒时段,因此它能理解的不只是孤立的音符,而是完整的音乐短语。注意力机制随后会突出最有信息量的声音切片,帮助系统在课堂噪音或录音瑕疵中保持聚焦。

从原始声音到实用教学建议

不同于许多仅报告准确率的技术论文,本研究贯穿了从识别到实际教学影响的完整路径。该模型在一个大型公开音频库中精心挑选的5000个片段上训练和测试,并通过加入回声和背景噪声来模拟真实课堂环境。系统学会可靠识别不同的音乐事件后,研究人员设计了从AI听到的内容到学生下一步应做事项的直接映射。例如,如果系统检测到频繁的音准错误,就会触发针对性的音准匹配练习;如果学生的节奏不稳,系统会推荐节拍训练;如果情感表达显得平淡,则建议参考示范演奏并进行有针对性的重复练习。

证明AI确实改变了学习效果

为了验证这个数字化“耳朵”是否不仅仅是在处理数据,作者进行了一个随机对照试验,涉及60名大学音乐学生,涵盖器乐、声乐和合奏场景。半数学生接受传统教学,另一半在此基础上获得实时AI反馈。使用AI系统的学生在音准准确性方面的提升更大,自我报告的音乐能力信心更高,并且自主练习时间更长。AI的评分与有经验教师的评分高度一致,系统运行速度也足够快——在一台小型低功耗设备上每个片段约82毫秒——能够在日常课堂或练习室中实际应用。

这对未来音乐课程的意义

总体而言,研究表明一个设计良好的AI听觉系统不仅能对声音进行标注:它还能驱动一个教学闭环,将机器所听到的内容直接转化为学生应练习的事项。该模型在使用更少计算资源的同时,优于若干领先的音频识别系统,使其适用于负担得起的硬件。对学习者而言,这可能意味着更客观的评分、更清晰的指导和更强的动力;对教师而言,它提供了一个处理常规评估的工具,使教师能够专注于音乐性和创造力。该工作指向了一个未来:个性化、具有情感感知能力的音乐辅导随时可得,而不再仅限于每周一次的课程。

引用: Liu, C., Shi, N. & Jiang, S. Artificial intelligence technology for music teaching reform mode under DCNN algorithm. Sci Rep 16, 14178 (2026). https://doi.org/10.1038/s41598-026-45027-w

关键词: 音乐教育, 音频识别, 人工智能, 个性化学习, 深度学习