Clear Sky Science · it

Tecnologia di intelligenza artificiale per il modello di riforma dell’insegnamento musicale basato sull’algoritmo DCNN

Lezioni di musica più intelligenti per studenti comuni

Immagina di esercitarti al pianoforte o nel canto e di ricevere un feedback immediato e oggettivo sul fatto che le note siano intonate, il ritmo sia stabile e l’espressione corrisponda al mood del brano—senza dover aspettare la lezione successiva. Questo studio esplora come l’intelligenza artificiale possa assumere il ruolo di assistente sempre presente e instancabile nell’educazione musicale, aiutando insegnanti e studenti a superare le valutazioni soggettive verso un apprendimento personalizzato e guidato dai dati.

Perché le lezioni tradizionali di musica non bastano

L’insegnamento musicale convenzionale si basa in gran parte sull’orecchio, il tempo e l’attenzione del docente. In classi affollate o in studi impegnati è difficile fornire a ogni studente un feedback dettagliato e continuo. Le valutazioni possono risultare soggettive e adattare piani di pratica alle esigenze individuali richiede molto tempo. Gli autori sostengono che i computer, che eccellono nell’individuare pattern nel suono, possono contribuire a colmare queste lacune. Analizzando brevi clip audio—di circa dieci secondi—un sistema di IA può tracciare intonazione, ritmo e timbro e tradurre queste informazioni in suggerimenti concreti che supportano una valutazione più precisa e imparziale.

Come funziona il nuovo motore di ascolto

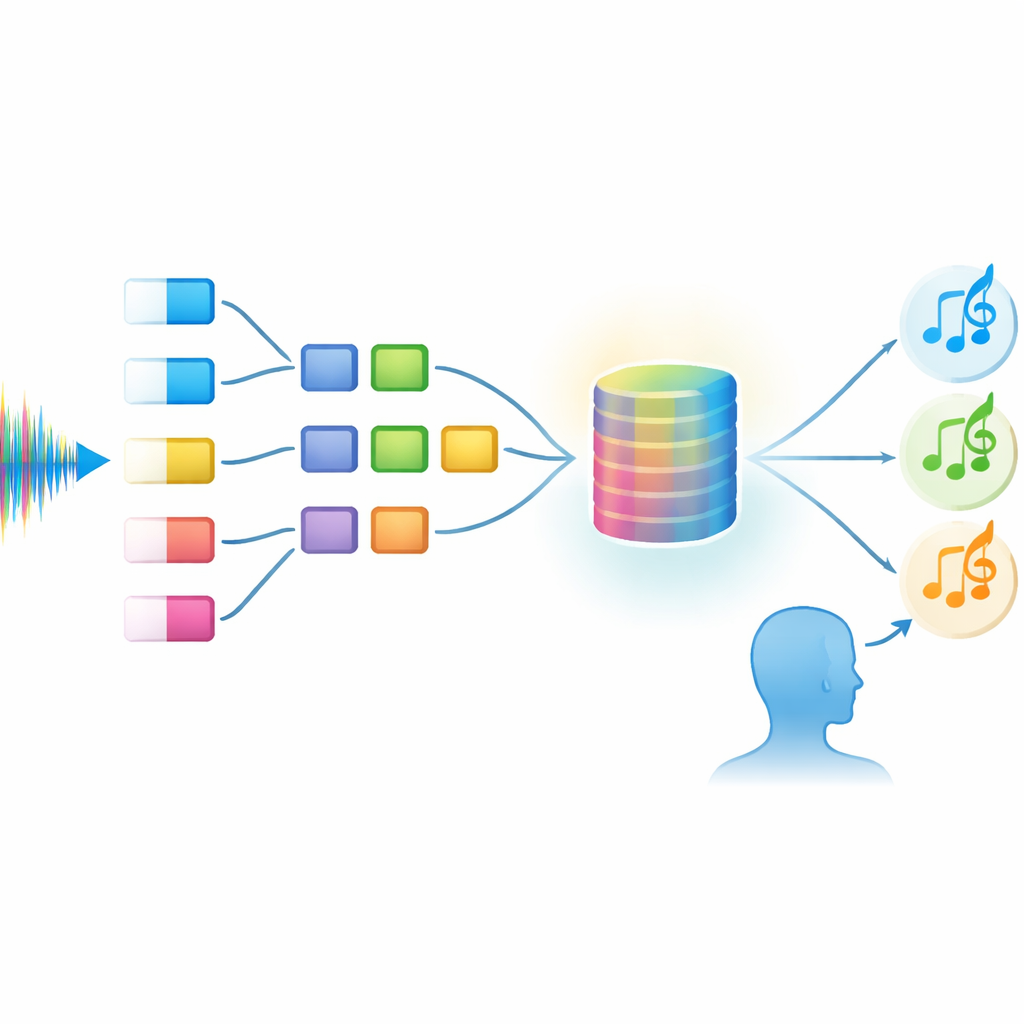

Al centro dello studio c’è un nuovo modello di riconoscimento audio dal nome complesso: MBFN-DCAM. In termini semplici, è un “orecchio” digitale composto da più parti che cooperano. Innanzitutto il sistema suddivide il suono in molti flussi paralleli così da poter prestare attenzione contemporaneamente a diversi aspetti della musica—come il timbro e il contorno melodico. Filtri speciali detti convoluzioni dilatate consentono al sistema di “ascoltare” l’intera finestra di dieci secondi senza esplodere in termini di dimensioni, permettendo di comprendere non solo note isolate ma intere frasi musicali. Un meccanismo di attenzione evidenzia quindi le porzioni di suono più informative, aiutando il modello a rimanere focalizzato nonostante rumori di aula o imperfezioni di registrazione.

Dal suono grezzo a consigli pratici per l’insegnamento

A differenza di molti articoli tecnici che si limitano a riportare numeri di accuratezza, questo studio segue l’intero percorso dal riconoscimento all’impatto didattico reale. Il modello viene addestrato e testato su 5.000 clip selezionate con cura da una vasta collezione audio pubblica, arricchite per simulare ambienti di aula reali con echi e rumore di fondo. Dopo che il sistema impara a identificare in modo affidabile diversi eventi musicali, i ricercatori progettano una mappatura diretta da ciò che l’IA rileva a ciò che lo studente dovrebbe fare dopo. Per esempio, se il sistema individua frequenti errori di intonazione, può attivare esercizi specifici di matching dell’altezza; se il timing dello studente è irregolare, raccomanda un allenamento sul battito; se l’espressione emotiva appare piatta, suggerisce esecuzioni modello e ripetizioni mirate.

La prova che l’aiuto dell’IA cambia davvero l’apprendimento

Per verificare se questo orecchio digitale fa più che elaborare dati, gli autori conducono uno studio randomizzato controllato con 60 studenti universitari di musica in ambito strumentale, vocale e d’insieme. Metà degli studenti riceve istruzione tradizionale, mentre l’altra metà ottiene anche feedback IA in tempo reale. Chi usa il sistema IA mostra miglioramenti molto maggiori nell’accuratezza dell’intonazione, segnala maggiore fiducia nelle proprie capacità musicali e si esercita più a lungo autonomamente. I punteggi dell’IA corrispondono da vicino a quelli di insegnanti esperti e il sistema è sufficientemente veloce—circa 82 millisecondi per clip su un dispositivo piccolo e a basso consumo—da essere praticabile in aule e sale di pratica quotidiane.

Cosa significa per le lezioni di musica future

Globalmente, lo studio mostra che un ascoltatore IA ben progettato può fare più che etichettare i suoni: può alimentare un ciclo didattico che collega ciò che la macchina sente a ciò che lo studente deve praticare dopo. Il modello supera diverse soluzioni di riconoscimento audio leader, pur utilizzando meno risorse di calcolo, rendendolo adatto a hardware economico. Per gli studenti, questo potrebbe tradursi in valutazioni più obiettive, indicazioni più chiare e maggiore motivazione. Per gli insegnanti, offre uno strumento che gestisce le valutazioni di routine così che possano concentrarsi sulla musicalità e la creatività. Il lavoro indica un futuro in cui il coaching musicale personalizzato e sensibile all’emozione sia disponibile in qualsiasi momento, non solo durante una lezione settimanale.

Citazione: Liu, C., Shi, N. & Jiang, S. Artificial intelligence technology for music teaching reform mode under DCNN algorithm. Sci Rep 16, 14178 (2026). https://doi.org/10.1038/s41598-026-45027-w

Parole chiave: educazione musicale, riconoscimento audio, intelligenza artificiale, apprendimento personalizzato, apprendimento profondo