Clear Sky Science · ja

DCNNアルゴリズムに基づく音楽教育改革モデルのための人工知能技術

日常の生徒のためのより賢い音楽レッスン

ピアノや歌の練習をしていて、音が正しく合っているか、リズムが安定しているか、表現が曲の雰囲気に合っているかを、次のレッスンを待たずに即座かつ客観的にフィードバックされると想像してみてください。本研究は、人工知能が音楽教育において常にそばにいて疲れないアシスタントの役割を果たし、教師と生徒の双方が勘に頼るのではなくデータに基づいた個別学習へと進める可能性を探ります。

なぜ従来の音楽授業は不十分なのか

従来の音楽教育は、教師の聴覚と時間、注意力に大きく依存しています。生徒が多い教室や忙しいスタジオでは、すべての生徒に詳細で継続的なフィードバックを与えるのは困難です。評価は主観的になりやすく、個々の学習者に合わせた練習計画を作るには時間がかかります。著者らは、音のパターンを見つけるのが得意なコンピュータがこれらのギャップを埋められると主張します。約10秒の短い音声クリップを解析することで、AIシステムは音程、リズム、音色を追跡し、より正確で公平な評価を支える具体的な提案に変換できます。

新しいリスニングエンジンの仕組み

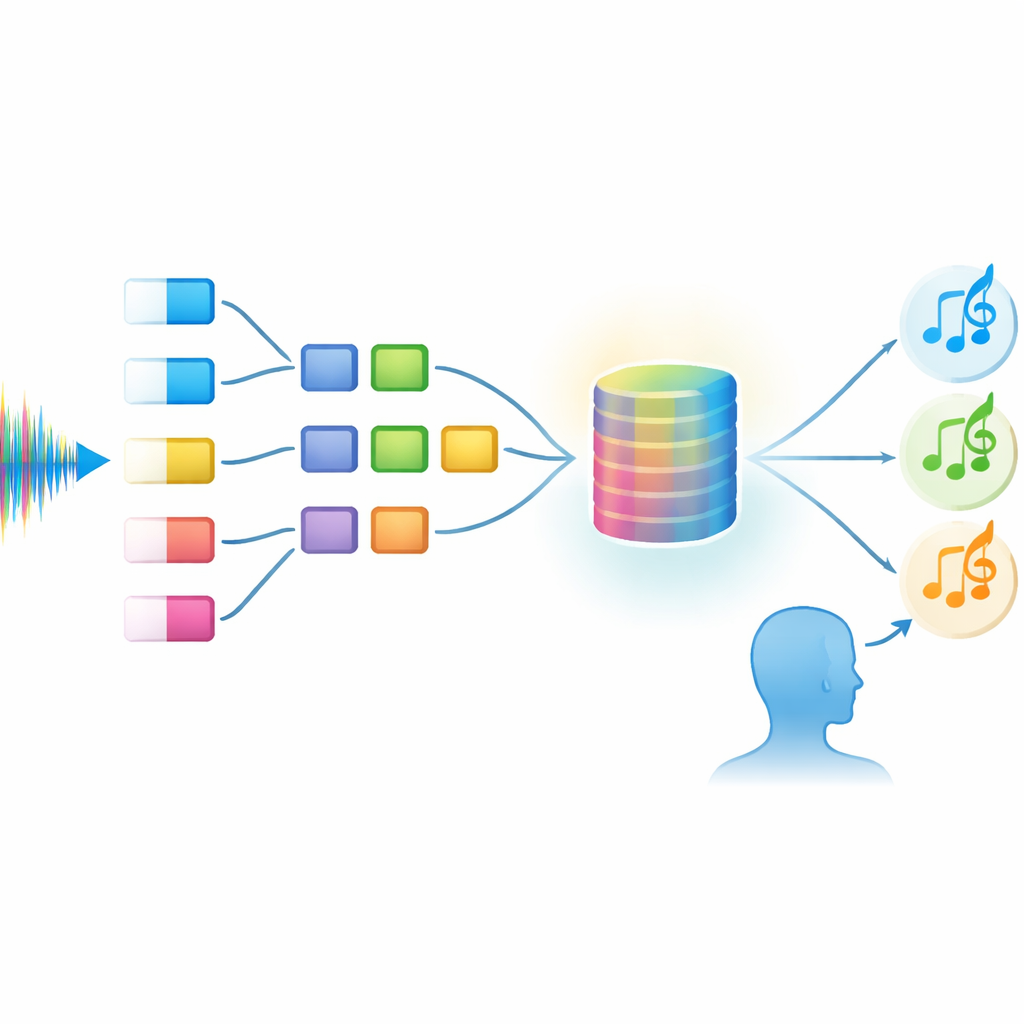

研究の中心には、MBFN-DCAMという複雑な名前の新しい音声認識モデルがあります。簡単に言えば、いくつかの協調する部位で構成されたデジタルの「耳」です。まず、システムは入力音を多数の並列ストリームに分割し、音色や輪郭など音楽の異なる側面に同時に注目できるようにします。拡張畳み込みと呼ばれる特殊なフィルタは、システムがサイズを爆発させずに全10秒間を「聞く」ことを可能にし、個々の音だけでなくフレーズ全体を理解できるようにします。さらに注意メカニズムが最も情報量の多い音の切片を強調し、教室の雑音や録音の欠陥に妨げられずに焦点を保ちます。

生の音から実用的な指導アドバイスへ

多くの技術論文が精度の数値を報告するにとどまるのに対し、本研究は認識から実際の指導効果までの全過程を追います。モデルは大規模な公開音声コレクションから慎重に選ばれた5,000のクリップで訓練・評価され、反響や背景雑音を模したデータ拡張が施されています。システムが異なる音楽的イベントを確実に識別できるようになると、研究者はAIが聞き取ったものを学生が次に行うべきことへ直接結びつけるマッピングを設計します。例えば、頻繁な音程ミスを検出した場合は特定の音程合わせ練習を提示し、タイミングが不均一ならばビートトレーニングを勧め、感情表現が平坦に聞こえれば模範演奏の提示や目的を絞った反復を推奨します。

AI支援が学習を本当に変えることの証明

このデジタルな耳が単に数値を処理するだけでないかを確認するために、著者らは楽器、歌、アンサンブルを含む大学の音楽学生60名を対象にランダム化比較試験を実施しました。学生の半数は従来の指導を受け、残りの半数はリアルタイムのAIフィードバックも受けました。AIを利用したグループは音程の正確さで大きな改善を示し、音楽的能力に対する自信が高まり、自主練習時間も長くなりました。AIのスコアは経験豊富な教師の評価とほぼ一致し、システムは小型の低消費電力デバイス上で1クリップあたり約82ミリ秒で動作するため、日常の教室や練習室で実用的です。

将来の音楽レッスンにとっての意味

総じて、本研究は設計の良いAIリスナーが音をラベル付けする以上の働きをし、機械が聞いたものを学生が次に練習すべきことにつなげる教育ループを実現できることを示しています。このモデルは主要な音声認識システムのいくつかを上回りつつ、計算資源を少なく使うため、手頃なハードウェアに適しています。学習者にとっては、より客観的な採点、明確な指導、そして高い動機付けを意味する可能性があります。教師にとっては、日常的な評価を処理するツールを提供し、音楽性や創造性に集中できるようにします。本研究は、週に一度のレッスンに限らない、いつでも利用できる個別で感情に配慮した音楽コーチングの未来を指し示しています。

引用: Liu, C., Shi, N. & Jiang, S. Artificial intelligence technology for music teaching reform mode under DCNN algorithm. Sci Rep 16, 14178 (2026). https://doi.org/10.1038/s41598-026-45027-w

キーワード: 音楽教育, 音声認識, 人工知能, 個別学習, 深層学習