Clear Sky Science · nl

Technologie voor kunstmatige intelligentie voor hervorming van muziekonderwijs onder DCNN-algoritme

Slimmere muzieklessen voor alledaagse leerlingen

Stel je voor dat je piano oefent of zingt en meteen objectieve terugkoppeling krijgt of je noten zuiver zijn, je ritme stabiel is en je expressie bij de sfeer van het stuk past—zonder te wachten op de volgende les. Deze studie onderzoekt hoe kunstmatige intelligentie de rol van een altijd aanwezige, onvermoeibare assistent in het muziekonderwijs kan vervullen, en zowel docenten als leerlingen kan helpen te bewegen van giswerk naar datagedreven, gepersonaliseerd leren.

Waarom traditionele muzieklessen tekortschieten

Conventioneel muziekonderwijs leunt zwaar op het gehoor, de tijd en de aandacht van een docent. In drukke klaslokalen of volle studio’s is het moeilijk om elke leerling gedetailleerde, continue feedback te geven. Beoordelingen kunnen subjectief zijn en het op maat maken van oefenplannen kost veel tijd. De auteurs stellen dat computers, die uitblinken in het herkennen van patronen in geluid, kunnen helpen deze hiaten op te vullen. Door korte audioclips—ongeveer tien seconden—te analyseren, kan een AI-systeem toonhoogte, ritme en klank volgen en deze informatie vertalen naar concrete suggesties die zorgen voor nauwkeurigere en eerlijkere evaluatie.

Hoe de nieuwe luistermotor werkt

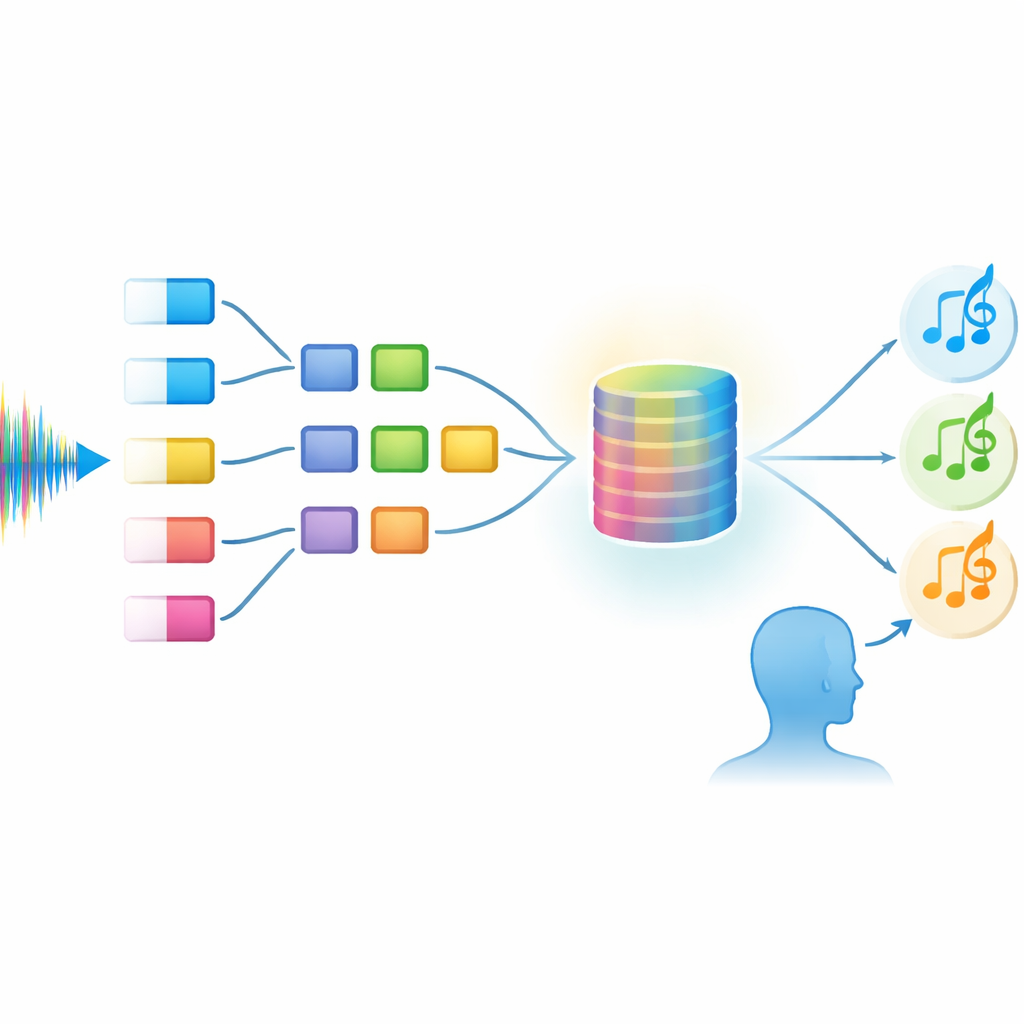

De kern van de studie is een nieuw audioherkenningsmodel met een complexe naam: MBFN-DCAM. In eenvoudige termen is het een digitaal “oor” opgebouwd uit meerdere samenwerkende onderdelen. Allereerst verdeelt het systeem binnenkomend geluid in vele parallelle stromen zodat het tegelijk aandacht kan besteden aan verschillende aspecten van de muziek—zoals timbre en contour. Speciale filters, dilated convolutions genoemd, stellen het systeem in staat over de volledige tien seconden te "luisteren" zonder in omvang te exploderen, zodat het niet alleen geïsoleerde noten maar hele muzikale zinnen kan begrijpen. Een attentiemechanisme markeert vervolgens de meest informatieve geluidsfragmenten, waardoor het systeem gefocust blijft ondanks klaslawaai of opname-onvolkomenheden.

Van ruw geluid naar praktische lesadviezen

In tegenstelling tot veel technische artikelen die stoppen bij het rapporteren van nauwkeurigheidscijfers, volgt deze studie de volledige reis van herkenning naar daadwerkelijke lesimpact. Het model is getraind en getest op 5.000 zorgvuldig geselecteerde clips uit een grote openbare audiocollectie, aangevuld om echte klasomstandigheden met echo’s en achtergrondgeluid na te bootsen. Nadat het systeem geleerd heeft betrouwbare muzikale gebeurtenissen te identificeren, ontwerpen de onderzoekers een directe koppeling van wat de AI hoort naar wat een leerling vervolgens zou moeten doen. Als het systeem bijvoorbeeld veel toonhoogtefouten detecteert, kan het specifieke toonmatching-oefeningen activeren; als iemands timing ongelijkmatig is, raadt het ritmetraining aan; als emotionele expressie vlak lijkt, stelt het modeluitvoeringen en gerichte herhaling voor.

Bewijs dat AI-hulp daadwerkelijk leren verandert

Om te onderzoeken of dit digitale oor meer doet dan getallen verwerken, voeren de auteurs een gerandomiseerde gecontroleerde trial uit met 60 universitaire muziekstudenten in instrumentale, vocale en ensemblecontexten. De helft van de studenten krijgt traditioneel onderwijs, terwijl de andere helft daarnaast realtime AI-feedback ontvangt. De studenten die het AI-systeem gebruiken laten veel grotere verbeteringen zien in toonhoogtenauwkeurigheid, rapporteren meer vertrouwen in hun muzikale vaardigheden en oefenen langer zelfstandig. De scores van de AI komen nauw overeen met die van ervaren docenten, en het systeem werkt snel genoeg—ongeveer 82 milliseconden per clip op een klein, energiezuinig apparaat—om praktisch inzetbaar te zijn in alledaagse klaslokalen of oefenruimtes.

Wat dit betekent voor toekomstige muzieklessen

Al met al laat de studie zien dat een goed ontworpen AI-luisteraar meer kan dan geluiden labelen: het kan een leslus aandrijven die koppelt wat de machine hoort aan wat de leerling vervolgens moet oefenen. Het model presteert beter dan enkele toonaangevende audioherkenningssystemen terwijl het minder computerbronnen gebruikt, waardoor het geschikt is voor betaalbare hardware. Voor leerlingen kan dit meer objectieve beoordeling, duidelijkere begeleiding en grotere motivatie betekenen. Voor docenten biedt het een instrument dat routinematige evaluatie afhandelt zodat zij zich kunnen richten op muzikaliteit en creativiteit. Het werk wijst op een toekomst waarin gepersonaliseerde, emotioneel gevoelige muziekcoaching altijd beschikbaar is, niet alleen tijdens een wekelijkse les.

Bronvermelding: Liu, C., Shi, N. & Jiang, S. Artificial intelligence technology for music teaching reform mode under DCNN algorithm. Sci Rep 16, 14178 (2026). https://doi.org/10.1038/s41598-026-45027-w

Trefwoorden: muziekonderwijs, audioherkenning, kunstmatige intelligentie, gepersonaliseerd leren, deep learning