Clear Sky Science · de

Künstliche Intelligenz-Technologie für ein Reformmodell des Musikunterrichts unter dem DCNN-Algorithmus

Intelligentere Musikstunden für Alltagsschüler

Stellen Sie sich vor, Sie üben Klavier oder Gesang und erhalten sofortiges, objektives Feedback dazu, ob Ihre Töne richtig intoniert sind, Ihr Rhythmus stabil ist und Ihre Ausdrucksweise zur Stimmung des Stücks passt—ohne auf die nächste Unterrichtsstunde warten zu müssen. Diese Studie untersucht, wie künstliche Intelligenz die Rolle eines stets präsenten, unermüdlichen Assistenten im Musikunterricht übernehmen kann, Lehrkräfte und Lernende von Vermutungen weg und hin zu datenbasiertem, individualisiertem Lernen zu führen.

Warum traditionelle Musikstunden nicht ausreichen

Konventioneller Musikunterricht hängt stark vom Gehör, der Zeit und der Aufmerksamkeit der Lehrperson ab. In überfüllten Klassenräumen oder geschäftigen Studios ist es schwer, jedem Schüler detailliertes, kontinuierliches Feedback zu geben. Bewertungen können subjektiv sein, und Übepläne auf die Bedürfnisse einzelner Lernender zuzuschneiden ist zeitaufwändig. Die Autoren argumentieren, dass Computer, die besonders gut Muster im Klang erkennen, helfen können, diese Lücken zu schließen. Durch die Analyse kurzer Audioclips—etwa zehn Sekunden lang—kann ein KI-System Tonhöhe, Rhythmus und Klangfarbe verfolgen und diese Informationen in konkrete Vorschläge übersetzen, die eine präzisere und fairere Bewertung unterstützen.

Wie die neue Hör-Engine funktioniert

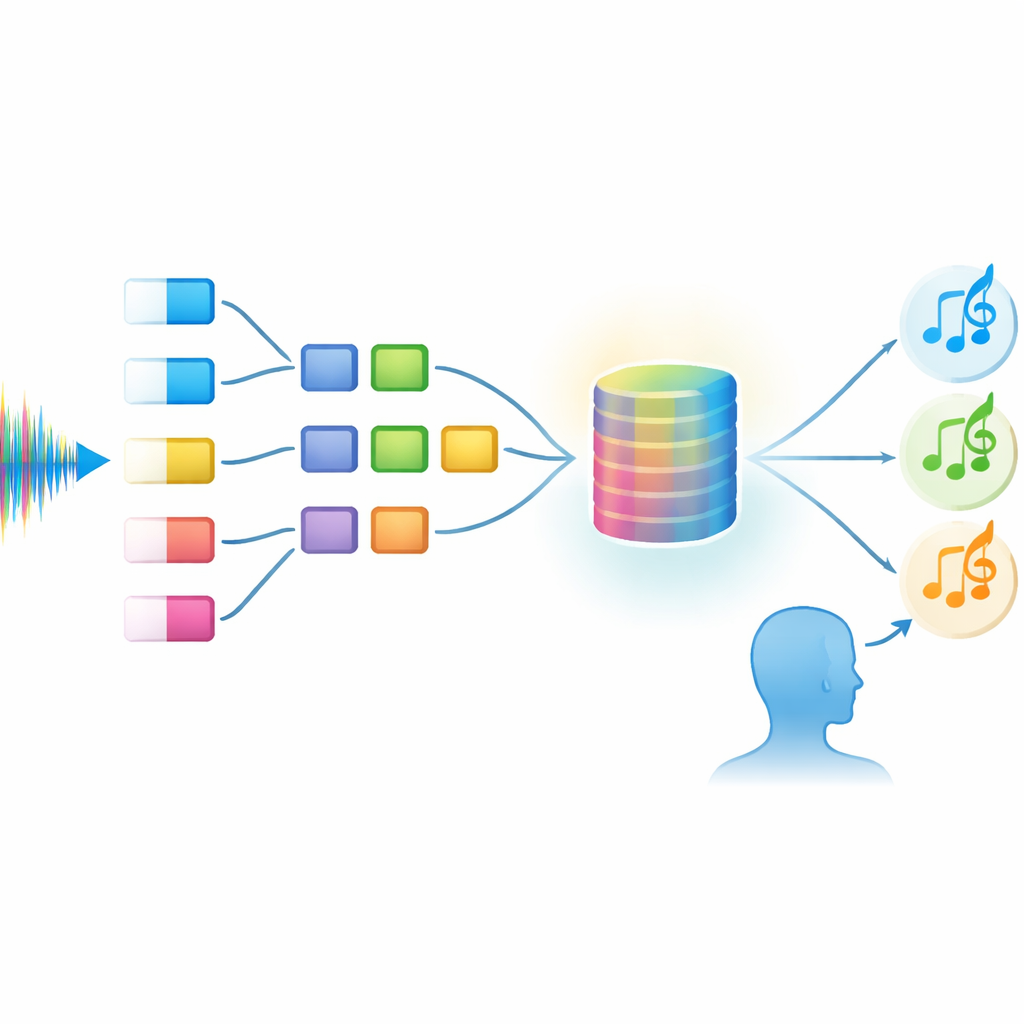

Kern der Studie ist ein neues Modell zur Audioerkennung mit dem komplexen Namen MBFN-DCAM. Einfach gesagt ist es ein digitales „Ohr“, das aus mehreren zusammenwirkenden Teilen aufgebaut ist. Zuerst zerlegt das System eingehenden Klang in viele parallele Ströme, sodass es gleichzeitig auf verschiedene Aspekte der Musik—wie Timbre und Kontur—achten kann. Spezielle Filter, sogenannte dilatierte Faltungen, ermöglichen es dem System, über die gesamte zehnsekündige Spanne „mitzuhören“, ohne unüberschaubar groß zu werden, sodass es nicht nur einzelne Töne, sondern ganze musikalische Phrasen erfassen kann. Ein Aufmerksamkeitsmechanismus hebt dann die aussagekräftigsten Klangabschnitte hervor und hilft dem System, trotz Klassengeräuschen oder Aufnahmefehlern fokussiert zu bleiben.

Vom Rohklang zu praktischen Unterrichtstipps

Im Gegensatz zu vielen technischen Arbeiten, die bei der Nennung von Genauigkeitswerten aufhören, verfolgt diese Studie den gesamten Weg von der Erkennung bis zur tatsächlichen Auswirkung auf den Unterricht. Das Modell wird an 5.000 sorgfältig ausgewählten Clips aus einer großen öffentlichen Audio-Sammlung trainiert und getestet, die zur Nachahmung realer Unterrichtsräume mit Hall und Hintergrundgeräuschen augmentiert wurden. Nachdem das System gelernt hat, verschiedene musikalische Ereignisse zuverlässig zu identifizieren, entwerfen die Forschenden eine direkte Abbildung dessen, was die KI hört, auf das, was eine Schülerin oder ein Schüler als Nächstes tun sollte. Erkennt das System beispielsweise häufige Intonationsfehler, kann es gezielte Tonhöhenausgleichsübungen auslösen; bei unregelmäßigem Timing empfiehlt es Schlagtraining; wirkt der Ausdruck emotional flach, schlägt es Modellperformances und gezielte Wiederholungen vor.

Beweis, dass KI-Hilfe Lernen wirklich verändert

Um zu prüfen, ob dieses digitale Ohr mehr leistet als Zahlen zu berechnen, führen die Autorinnen und Autoren eine randomisierte kontrollierte Studie mit 60 Hochschulmusikstudierenden in Instrumental-, Vokal- und Ensemblekonstellationen durch. Die Hälfte der Studierenden erhält traditionellen Unterricht, die andere Hälfte zusätzlich Echtzeit-KI-Feedback. Die mit dem KI-System arbeitenden Teilnehmenden zeigen deutlich größere Verbesserungen in der Tonhöhengenauigkeit, berichten von höherem Selbstvertrauen in ihre musikalischen Fähigkeiten und üben länger eigenständig. Die Bewertungen der KI stimmen eng mit denen erfahrener Lehrkräfte überein, und das System ist schnell genug—etwa 82 Millisekunden pro Clip auf einem kleinen, energieeffizienten Gerät—um im Alltag von Klassenräumen oder Proberäumen praktikabel zu sein.

Was das für zukünftige Musikstunden bedeutet

Insgesamt zeigt die Studie, dass ein gut gestalteter KI-Zuhörer mehr sein kann als ein bloßer Klang-Kennzeichner: Er kann eine Unterrichtsschleife antreiben, die das, was die Maschine hört, direkt mit dem verbindet, was der Lernende als Nächstes üben sollte. Das Modell übertrifft mehrere führende Systeme zur Audioerkennung und benötigt dabei weniger Rechenressourcen, was es für erschwingliche Hardware geeignet macht. Für Lernende könnte das objektivere Bewertungen, klarere Anleitung und größere Motivation bedeuten. Für Lehrkräfte bietet es ein Werkzeug, das routinemäßige Bewertungen übernimmt, sodass sie sich auf Musikalität und Kreativität konzentrieren können. Die Arbeit weist in Richtung einer Zukunft, in der personalisiertes, emotional sensibles Musikcoaching jederzeit verfügbar ist, nicht nur während einer wöchentlichen Stunde.

Zitation: Liu, C., Shi, N. & Jiang, S. Artificial intelligence technology for music teaching reform mode under DCNN algorithm. Sci Rep 16, 14178 (2026). https://doi.org/10.1038/s41598-026-45027-w

Schlüsselwörter: Musikpädagogik, Audioerkennung, Künstliche Intelligenz, personalisiertes Lernen, Deep Learning