Clear Sky Science · pl

Technologia sztucznej inteligencji dla trybu reformy nauczania muzyki w oparciu o algorytm DCNN

Inteligentniejsze lekcje muzyki dla zwykłych uczniów

Wyobraź sobie ćwiczenie gry na pianinie lub śpiewu i otrzymywanie natychmiastowej, obiektywnej informacji zwrotnej, czy Twoje dźwięki są czyste, rytm równy, a ekspresja odpowiada nastrojowi utworu — bez czekania na kolejną lekcję. W badaniu tym autorzy badają, jak sztuczna inteligencja może pełnić rolę stale obecnego, niestrudzonego asystenta w edukacji muzycznej, pomagając nauczycielom i uczniom przejść od domysłów do nauki opartej na danych i dopasowanej do indywidualnych potrzeb.

Dlaczego tradycyjne lekcje muzyki nie wystarczają

Konwencjonalne nauczanie muzyki opiera się w dużej mierze na słuchu, czasie i uwadze nauczyciela. W przepełnionych klasach lub zatłoczonych pracowniach trudno jest zapewnić każdemu uczniowi szczegółową, ciągłą informację zwrotną. Oceny bywają subiektywne, a dostosowanie planów ćwiczeń do potrzeb pojedynczych uczniów zajmuje dużo czasu. Autorzy twierdzą, że komputery, które świetnie rozpoznają wzorce w dźwięku, mogą pomóc wypełnić te luki. Analizując krótkie klipy audio — około dziesięciu sekund — system AI może śledzić wysokość dźwięku, rytm i barwę, a następnie przekształcać te informacje w konkretne sugestie wspierające dokładniejszą i sprawiedliwszą ocenę.

Jak działa nowy mechanizm nasłuchu

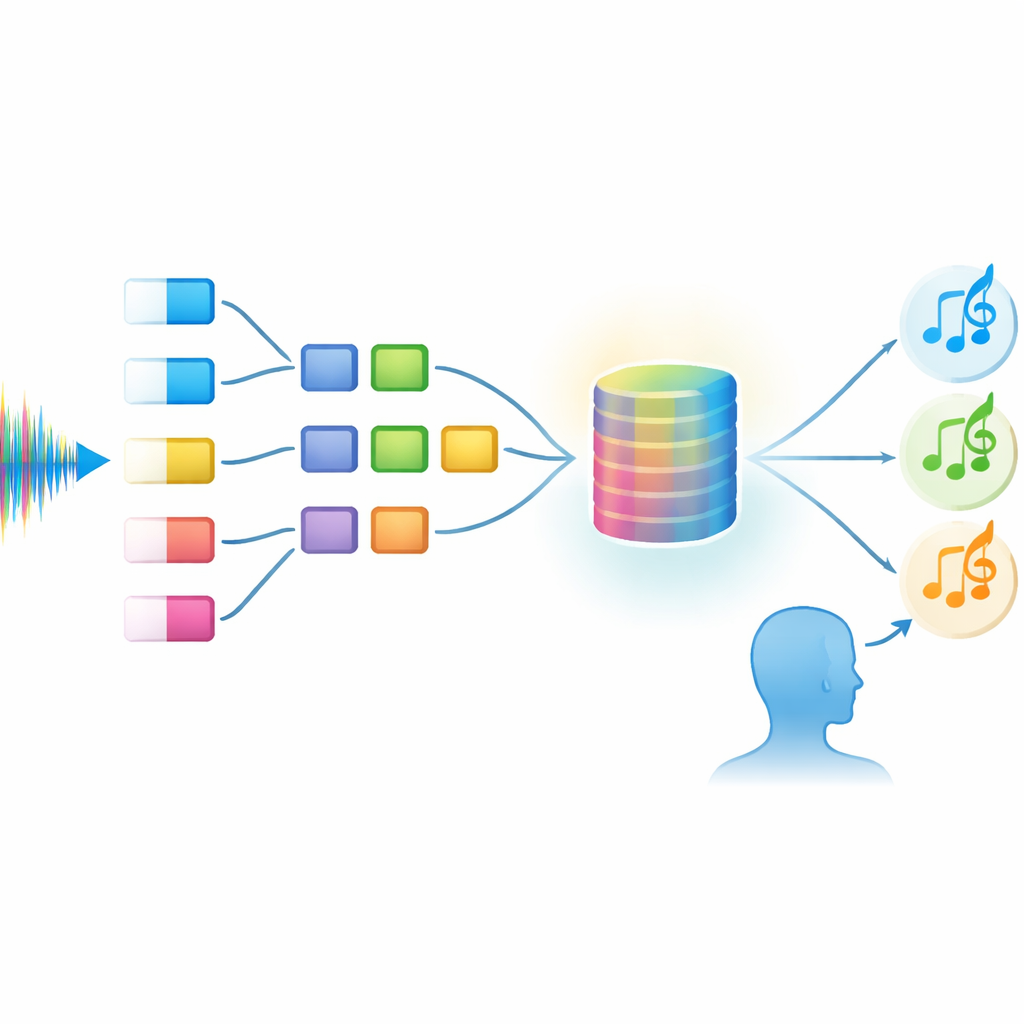

W centrum badania znajduje się nowy model rozpoznawania dźwięku o złożonej nazwie: MBFN-DCAM. W prostych słowach to cyfrowe „ucho” zbudowane z kilku współpracujących części. Najpierw system dzieli nadchodzący dźwięk na wiele równoległych strumieni, aby móc jednocześnie zwracać uwagę na różne aspekty muzyki — takie jak barwa czy kontur melodii. Specjalne filtry zwane rozwartymi splotami (dilated convolutions) pozwalają systemowi „słuchać” w całym dziesięciosekundowym zakresie bez nadmiernego wzrostu rozmiaru modelu, dzięki czemu rozumie nie tylko pojedyncze nuty, ale całe frazy muzyczne. Mechanizm uwagi następnie wyróżnia najbardziej informatywne fragmenty dźwięku, pomagając systemowi pozostać skoncentrowanym mimo hałasu w klasie czy niedoskonałości nagrań.

Od surowego dźwięku do praktycznych wskazówek dydaktycznych

W przeciwieństwie do wielu prac technicznych, które kończą na raportowaniu wyników dokładności, to badanie opisuje pełną drogę od rozpoznawania do rzeczywistego wpływu na nauczanie. Model jest trenowany i testowany na 5000 starannie wybranych klipach z dużego publicznego zbioru dźwięków, rozszerzonych tak, by naśladować warunki klasowe z echem i szumem tła. Gdy system nauczy się niezawodnie identyfikować różne zdarzenia muzyczne, badacze projektują bezpośrednie odwzorowanie tego, co AI słyszy, na kolejne kroki ucznia. Na przykład, jeśli system wykryje częste błędy wysokości dźwięku, może uruchomić konkretne ćwiczenia dopasowywania wysokości; jeśli rytm ucznia jest nieregularny, zaleci trening pulsu; jeśli ekspresja emocjonalna wydaje się płaska, zasugeruje wzorce wykonawcze i celowe powtórzenia.

Dowód, że AI faktycznie zmienia proces uczenia się

Aby sprawdzić, czy to cyfrowe ucho robi coś więcej niż liczy wyniki, autorzy przeprowadzili randomizowane badanie kontrolowane z udziałem 60 studentów kierunku muzycznego na uniwersytecie, obejmujące instrumentalistów, wokalistów i zespoły. Połowa uczniów otrzymała tradycyjne instrukcje, podczas gdy druga połowa dodatkowo otrzymywała informacje zwrotne AI w czasie rzeczywistym. Uczniowie korzystający z systemu AI wykazali znacznie większe postępy w dokładności intonacji, zgłaszali wyższą pewność swoich umiejętności muzycznych i dłużej ćwiczyli samodzielnie. Oceny AI były zbliżone do ocen doświadczonych nauczycieli, a system działał wystarczająco szybko — około 82 milisekundy na klip na małym, energooszczędnym urządzeniu — by być praktycznym w codziennych salach lekcyjnych czy pokojach ćwiczeń.

Co to oznacza dla przyszłych lekcji muzyki

Podsumowując, badanie pokazuje, że dobrze zaprojektowany słuchacz AI może robić więcej niż etykietować dźwięki: może zasilać pętlę nauczania, która łączy to, co maszyna słyszy, z tym, co uczeń powinien trenować dalej. Model przewyższa kilka wiodących systemów rozpoznawania audio przy jednoczesnym mniejszym wykorzystaniu zasobów obliczeniowych, co czyni go odpowiednim dla przystępnego sprzętu. Dla uczniów może to oznaczać bardziej obiektywne ocenianie, jaśniejsze wskazówki i większą motywację. Dla nauczycieli to narzędzie, które zajmie się rutynową oceną, pozwalając im skupić się na muzykalności i kreatywności. Praca wskazuje kierunek ku przyszłości, w której spersonalizowane, emocjonalnie świadome nauczanie muzyki będzie dostępne zawsze, a nie tylko raz w tygodniu podczas lekcji.

Cytowanie: Liu, C., Shi, N. & Jiang, S. Artificial intelligence technology for music teaching reform mode under DCNN algorithm. Sci Rep 16, 14178 (2026). https://doi.org/10.1038/s41598-026-45027-w

Słowa kluczowe: edukacja muzyczna, rozpoznawanie dźwięku, sztuczna inteligencja, uczenie spersonalizowane, głębokie uczenie