Clear Sky Science · zh

考虑电池衰退和可再生能源不确定性的深度强化学习自适应多目标微电网能量管理优化

更智能的本地用电,融入日常生活

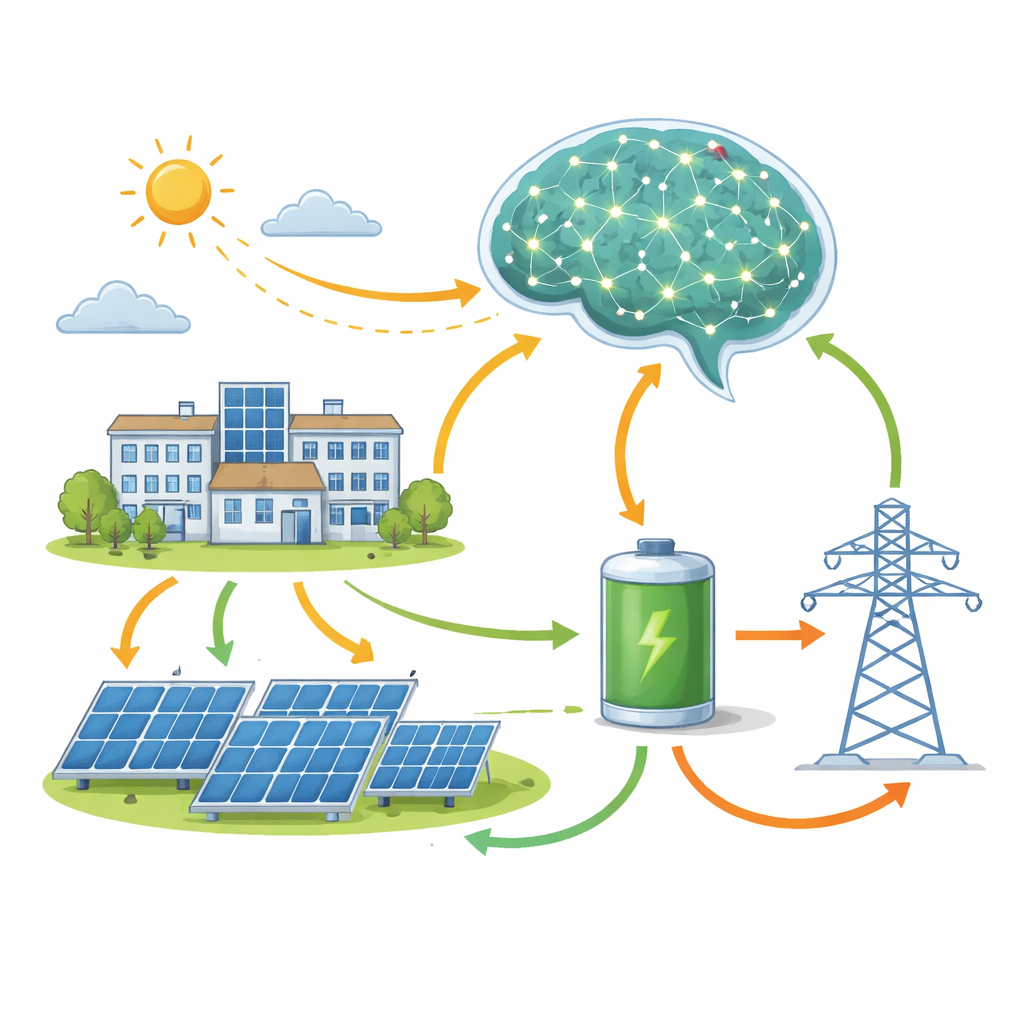

随着越来越多的住宅、校园和企业安装太阳能电池板和电池,决定何时购买、存储或使用电力变成了一场高风险的平衡考验。做得好可以降低账单和污染;做得不好则会浪费清洁电力并加速昂贵电池的老化。本文研究了一种称为深度强化学习的人工智能技术,如何作为太阳能+电池微电网的“数字操作员”,通过日复一日的学习,在即便天气预报不准的情况下,也能压低成本、提高可再生能源利用率并保护电池免于过早退化。

为何小型电力网络至关重要

微电网是将太阳能电池板、蓄电池、可控负载与主网连接在一起的紧凑电力系统。它们可以为校园或社区供电,并在主网承压时维持关键负载。但运行管理并不简单:光照和用电需求按分钟波动,电价日内变化,而且每一次充放电循环都会逐步损耗电池。传统控制方案依赖数学优化和准确的预测,这些方法在条件偏离预期或系统变得过于复杂时常常失效。

以经验训练的学习型控制器

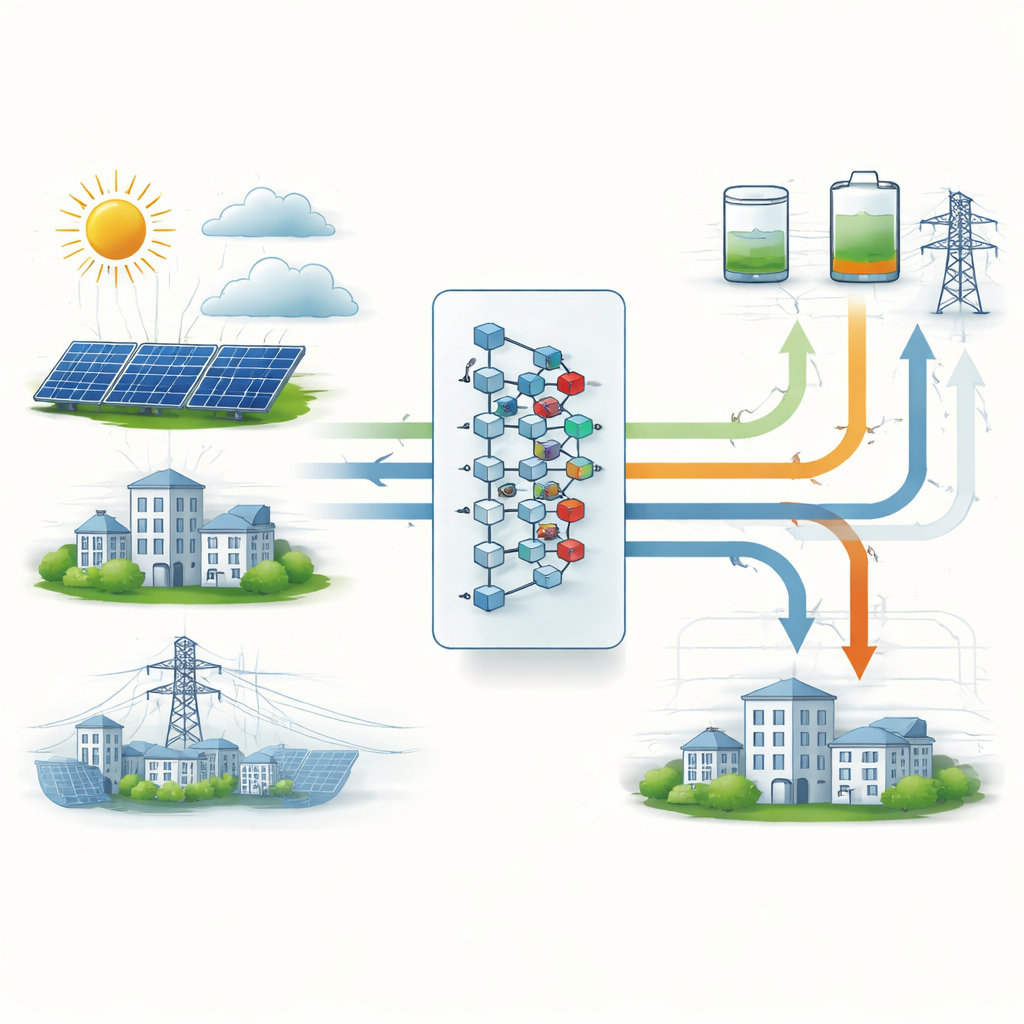

研究人员构建了一个沙特阿拉伯西部校园级微电网的详细数字孪生模型,包括300千瓦的光伏、电池组、可调与不可调负载,以及与主网的双向链接。随后他们训练了一个深度强化学习智能体——具体来说是一种先进的深度Q网络(Deep Q‑Network),以15分钟为步长在多年模拟环境中操作该虚拟系统。智能体观测电池荷电状态、短期光伏与负荷预测、电价和温度,并选择诸如电池充放电强度或是否启用可移位负载等动作。每一步它都会收到一个将三项目标混合在一起的奖励:降低用电支出、减缓电池磨损以及减少对化石能源电网的依赖。

在成本、电池寿命与清洁能源之间取得平衡

为了反映真实世界的权衡,团队将基于物理的电池老化模型直接嵌入到学习信号中。奖励函数既惩罚短期成本也惩罚长期容量损失,并严厉制裁诸如过充或过度放电等安全限制违规。经过约10,000个模拟日的训练后,智能体发现了许多人常常建议但并未明确教给它的策略:它学会偏好多次中等深度的充放电循环而非少数深循环,将电池维持在老化较慢的中等荷电区间,并在晴好时段来临前留出足够的电池容量以储存即将到来的太阳能,避免浪费。

击败传统的智能控制器

这一基于学习的控制器与工业上广泛使用、假定能获得良好预测的强基准——模型预测控制(MPC)——进行了直接对比。在一整年的天气和负荷数据测试中,学习得出的策略将总体运行成本降低了约12%,将电池容量损失减少了略超8%,并将本地光伏利用率提高了约10%。它还减少了从电网汲取的峰值功率,并将相关碳排放削减了近14%。也许最引人注目的是,一旦训练完成,AI控制器能在几千分之一秒内做出决策——远快于传统方法所需的数秒优化时间——因此适合部署在价格低廉的现场硬件上。

在天气预报出错时保持鲁棒

真实的微电网必须应对突如其来的多云和不完美的预测。研究人员在光伏预测误差逐步增大的条件下测试了两种控制器。随着预测误差扩大到严重程度,传统控制器的成本上升了超过五分之一,而基于学习的控制器成本上升不到十分之一。该AI智能体还更从容地应对快速变化的光照,利用电池平滑功率流而不诉诸有害的深度放电。它会将可移位负载安排在光伏发电和低价时段,进一步缓解电网压力。

这对未来电力系统意味着什么

通俗地说,该研究表明经过训练的AI可以像一位精明的操作员那样运行太阳能+电池系统,既关心当日的电费,也关心未来的电池健康与每千瓦时的气候影响。通过直接从数据中学习,而不是依赖完美预测和简化公式,该控制器能够提供更便宜、更清洁的电力并延长昂贵电池的寿命。尽管工作是在沙特校园微电网的仿真中完成的,但相同方法可适配至其他场址并扩展至微电网网络,为向更有弹性、更高效、更可持续的本地能源系统迈进提供了有前景的路径。

引用: Altimania, M.R.M., Basem, A., Saydullaev, B. et al. Adaptive multi-objective optimization of microgrid energy management using deep reinforcement learning considering battery degradation and renewable uncertainty. Sci Rep 16, 14296 (2026). https://doi.org/10.1038/s41598-026-44179-z

关键词: 微电网, 深度强化学习, 电池健康, 可再生能源, 能量管理