Clear Sky Science · pt

Otimização multiobjetivo adaptativa do gerenciamento de energia de microrredes usando aprendizado profundo por reforço considerando degradação de baterias e incerteza renovável

Energia local mais inteligente para o dia a dia

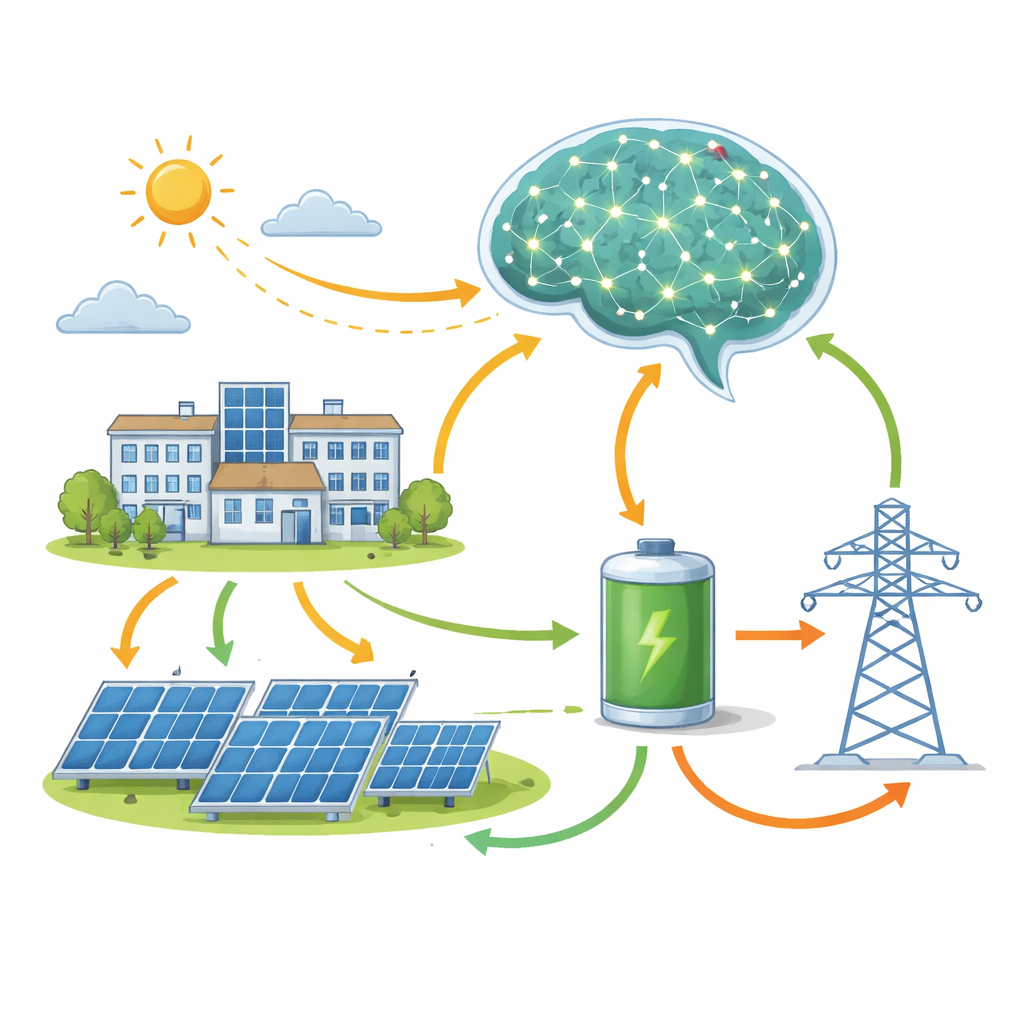

À medida que mais residências, campi e empresas instalam painéis solares e baterias, gerenciar quando comprar, armazenar ou usar eletricidade torna‑se um ato de equilíbrio de alto risco. Feito corretamente, reduz contas e poluição; feito de forma inadequada, desperdiça energia limpa e desgasta baterias caras. Este estudo explora como uma forma de inteligência artificial chamada aprendizado profundo por reforço pode atuar como um “operador digital” para uma microrrede com solar e bateria, aprendendo dia após dia como manter os custos baixos, usar mais energia renovável e proteger a bateria do envelhecimento prematuro — mesmo quando a previsão do tempo está errada.

Por que pequenas redes elétricas importam

Microrredes são sistemas de energia compactos que conectam painéis solares, armazenamento em bateria, cargas controláveis e uma conexão com a rede maior. Podem alimentar um campus ou bairro e manter cargas críticas funcionando quando a rede principal estiver sob estresse. Mas são difíceis de operar: a luz solar e a demanda mudam minuto a minuto, os preços da eletricidade variam ao longo do dia e cada ciclo de carga‑descarga degrada a bateria lentamente. Esquemas de controle tradicionais dependem de otimização matemática e previsões precisas, que frequentemente falham quando as condições se desviam do esperado ou quando o sistema se torna muito complexo.

Um controlador que aprende com a experiência

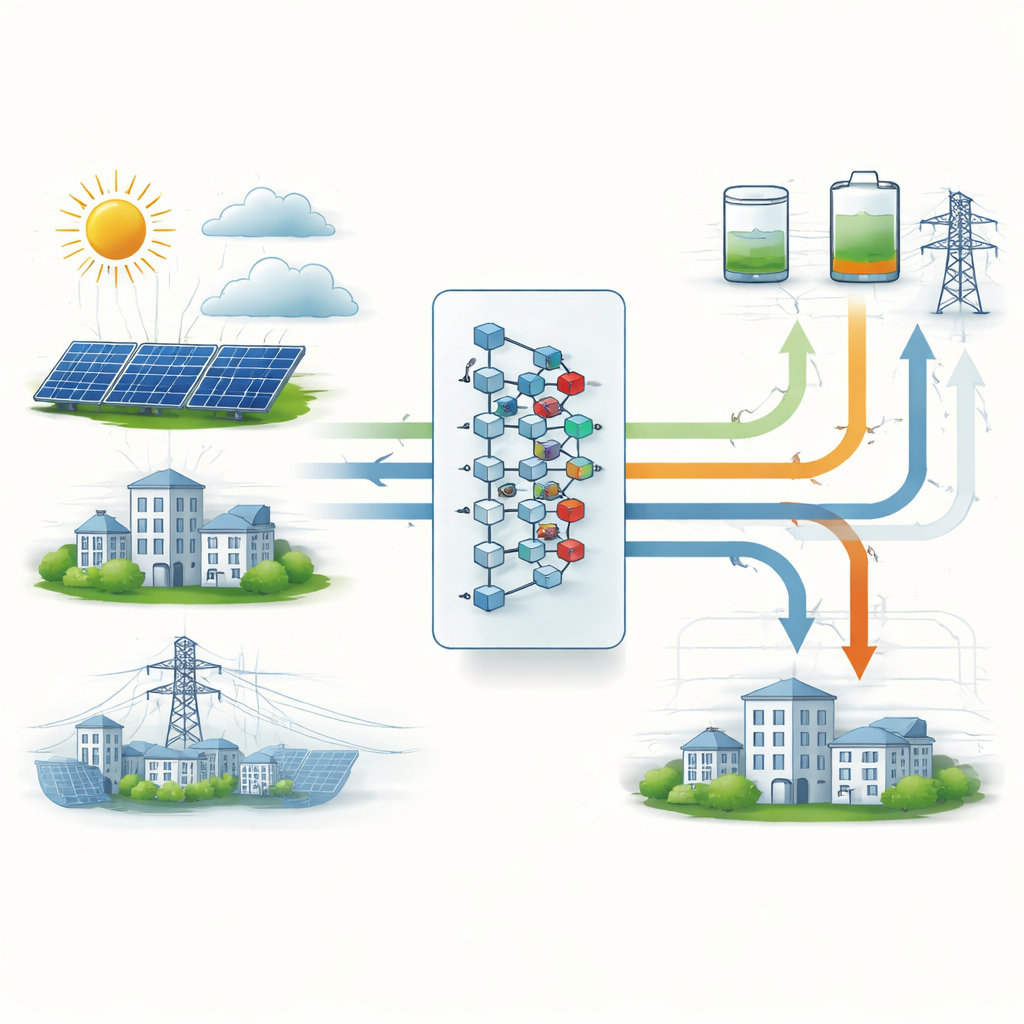

Os pesquisadores construíram um gêmeo digital detalhado de uma microrrede em escala de campus no oeste da Arábia Saudita, incluindo 300 kW de painéis solares, uma grande bateria de íons‑lítio, cargas flexíveis e inflexíveis e um link bidirecional com a rede principal. Em seguida, treinaram um agente de aprendizado profundo por reforço — especificamente, uma avançada Deep Q‑Network — para operar esse sistema virtual em passos de 15 minutos ao longo de muitos anos simulados. O agente observava o nível de carga da bateria, previsões de curto prazo para solar e demanda, preços da eletricidade e temperatura, e escolhia ações como a intensidade de carga ou descarga da bateria e se executaria cargas deslocáveis. Após cada passo, recebia uma recompensa que combinava três objetivos: pagar menos pela eletricidade, reduzir o desgaste da bateria e depender menos da energia da rede gerada por combustíveis fósseis.

Equilibrando custo, saúde da bateria e energia limpa

Para refletir as trocas do mundo real, a equipe incorporou um modelo físico de envelhecimento da bateria diretamente no sinal de aprendizado. A função de recompensa penalizava tanto os custos de curto prazo quanto a perda de capacidade de longo prazo, e desencorajava fortemente violações de limites de segurança como sobrecarga ou descarga excessiva da bateria. Ao longo de cerca de 10.000 dias simulados de prática, o agente descobriu estratégias que as pessoas frequentemente recomendam — mas que não foram ensinadas explicitamente. Aprendeu a favorecer muitos ciclos de profundidade moderada em vez de poucos ciclos profundos, a manter a bateria em um estado de carga intermediário onde o envelhecimento é mais lento, e a reservar espaço na bateria antes de horas ensolaradas para que a energia solar futura possa ser armazenada em vez de desperdiçada.

Superando um controlador inteligente convencional

O novo controlador baseado em aprendizado foi testado frente a frente contra um referencial robusto conhecido como controle preditivo por modelo, amplamente usado na indústria e que assume acesso a boas previsões. Ao longo de um ano completo de dados de tempo e demanda, a política aprendida reduziu os custos operacionais gerais em cerca de 12%, diminuiu a perda de capacidade da bateria em pouco mais de 8% e aumentou o uso da energia solar gerada localmente em aproximadamente 10%. Também reduziu a potência de pico retirada da rede e cortou as emissões de carbono associadas em quase 14%. Talvez mais notável, uma vez treinado, o controlador por IA tomava decisões em poucos milésimos de segundo — muito mais rápido que a otimização, que leva segundos no método convencional — tornando‑o adequado para hardware local barato.

Mantendo a robustez quando a previsão do tempo falha

Microrredes reais devem lidar com surpresas nubladas e previsões imperfeitas. Os pesquisadores testaram ambos os controladores com previsões solares cada vez mais imprecisas. À medida que os erros de previsão tornaram‑se severos, os custos do controlador tradicional subiram mais de um quinto, enquanto os custos do controlador baseado em aprendizado subiram menos de um décimo. O agente de IA também lidou com oscilações rápidas de insolação com mais elegância, usando a bateria para suavizar os fluxos de potência sem recorrer a descargas profundas prejudiciais. Agendou cargas flexíveis para coincidir com a produção solar e horas de preço baixo, aliviando ainda mais a pressão sobre a rede.

O que isso significa para sistemas de energia futuros

Em termos práticos, o estudo mostra que uma IA treinada pode operar um sistema solar e de baterias como um operador experiente que se preocupa com a conta de hoje, a saúde da bateria de amanhã e o impacto climático de cada quilowatt‑hora. Ao aprender diretamente a partir dos dados, em vez de depender de previsões perfeitas e fórmulas simplificadas, o controlador entrega energia mais barata e limpa ao mesmo tempo que prolonga a vida de baterias caras. Embora o trabalho tenha sido feito em simulação para uma microrrede de campus na Arábia Saudita, a mesma abordagem pode ser adaptada a outros locais e ampliada para redes de microrredes, oferecendo um caminho promissor para sistemas energéticos locais mais resilientes, eficientes e sustentáveis.

Citação: Altimania, M.R.M., Basem, A., Saydullaev, B. et al. Adaptive multi-objective optimization of microgrid energy management using deep reinforcement learning considering battery degradation and renewable uncertainty. Sci Rep 16, 14296 (2026). https://doi.org/10.1038/s41598-026-44179-z

Palavras-chave: microrredes, aprendizado profundo por reforço, saúde da bateria, energia renovável, gerenciamento de energia