Clear Sky Science · it

Ottimizzazione adattativa multi-obiettivo della gestione energetica di un microrete tramite deep reinforcement learning considerando il degrado della batteria e l'incertezza delle rinnovabili

Energia locale più intelligente per la vita di tutti i giorni

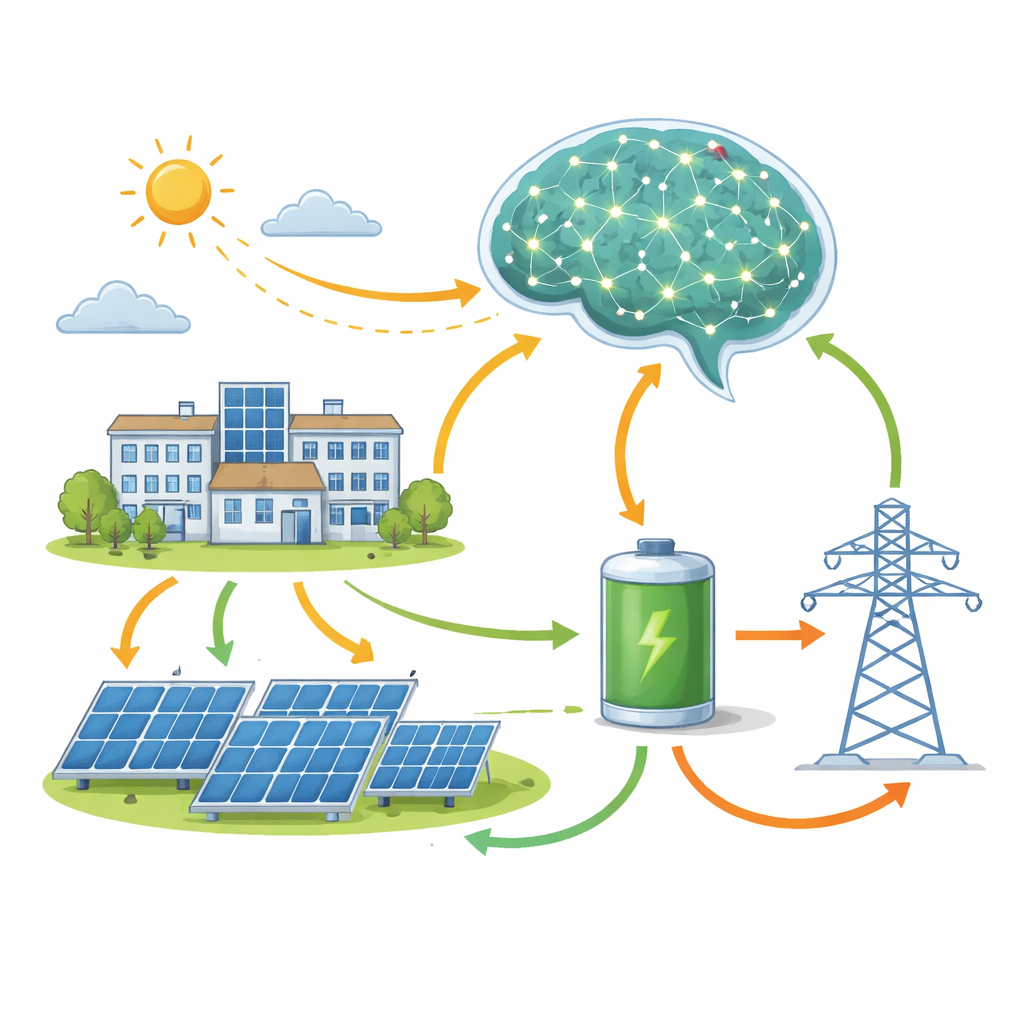

Con l’aumento delle installazioni di pannelli solari e batterie in case, campus e attività commerciali, gestire quando acquistare, immagazzinare o utilizzare elettricità diventa un esercizio ad alto rischio. Se fatto bene, riduce bollette e inquinamento; se fatto male, spreca energia pulita e accelera l’usura di batterie costose. Questo studio esplora come una forma di intelligenza artificiale chiamata deep reinforcement learning possa funzionare da “operatore digitale” per una microrete solare con batteria, imparando giorno per giorno a mantenere bassi i costi, usare più energia rinnovabile e proteggere la batteria dall’invecchiamento precoce—anche quando le previsioni meteorologiche sono sbagliate.

Perché le piccole reti elettriche contano

Le microreti sono sistemi elettrici compatti che collegano pannelli solari, accumulo in batteria, carichi controllabili e una connessione alla rete principale. Possono alimentare un campus o un quartiere e mantenere in funzione carichi critici quando la rete principale è sotto stress. Ma sono difficili da gestire: irraggiamento e domanda variano al minuto, i prezzi dell’elettricità cambiano durante la giornata e ogni ciclo di carica‑scarica degrada lentamente la batteria. Gli schemi di controllo tradizionali si basano su ottimizzazione matematica e previsioni accurate, che spesso falliscono quando le condizioni deviano dalle aspettative o il sistema diventa troppo complesso.

Un controllore che impara dall’esperienza

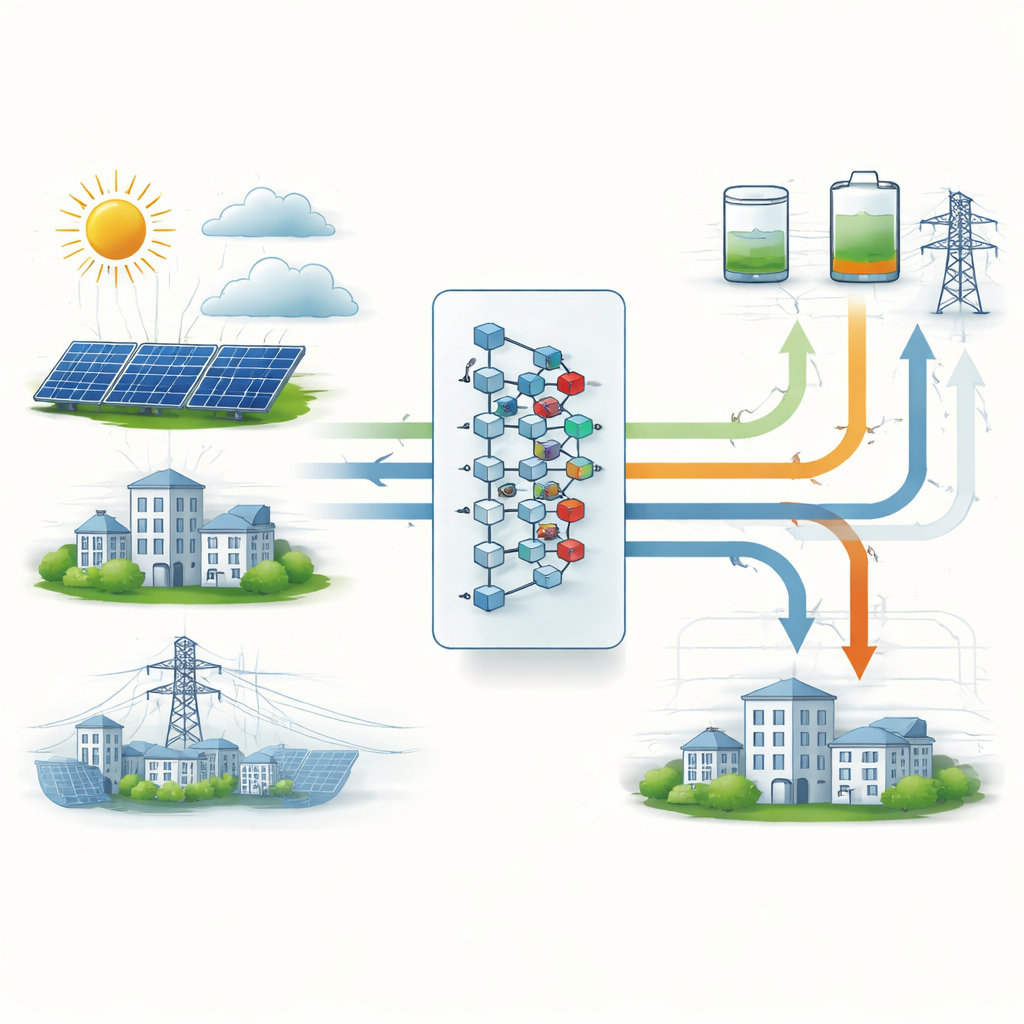

I ricercatori hanno costruito un gemello digitale dettagliato di una microrete a scala di campus nell’ovest dell’Arabia Saudita, includendo 300 kW di pannelli solari, una grande batteria agli ioni di litio, carichi flessibili e non flessibili e un collegamento bidirezionale alla rete principale. Hanno quindi addestrato un agente di deep reinforcement learning—specificamente, un avanzato Deep Q‑Network—per gestire questo sistema virtuale in passi da 15 minuti su molti anni simulati. L’agente osservava il livello di carica della batteria, le previsioni a breve termine per solare e domanda, i prezzi dell’elettricità e la temperatura, e sceglieva azioni come l’intensità di carica o scarica della batteria e se eseguire carichi spostabili. Dopo ogni passo riceveva una ricompensa che fondeva tre obiettivi: pagare meno per l’elettricità, rallentare l’usura della batteria e dipendere meno dalla rete alimentata a combustibili fossili.

Bilanciare costi, salute della batteria ed energia pulita

Per riflettere i compromessi del mondo reale, il team ha integrato un modello fisico del degrado della batteria direttamente nel segnale di apprendimento. La funzione di ricompensa penalizzava sia i costi a breve termine sia la perdita di capacità a lungo termine, e scoraggiava severamente le violazioni dei limiti di sicurezza come sovraccarico o scarica eccessiva della batteria. In circa 10.000 giorni simulati di pratica, l’agente ha scoperto strategie spesso raccomandate dagli esperti—ma che non gli erano mai state insegnate esplicitamente. Ha imparato a favorire molti cicli a profondità moderata invece di pochi cicli profondi, a mantenere la batteria in uno stato di carica intermedio dove l’invecchiamento è più lento, e a lasciare spazio nella batteria prima delle ore soleggiate in modo che l’energia solare in arrivo possa essere immagazzinata invece di andare sprecata.

Superare un controllore intelligente convenzionale

Il nuovo controllore basato sull’apprendimento è stato testato direttamente contro un solido riferimento noto come controllo predittivo basato sul modello, ampiamente usato nell’industria e che assume la disponibilità di buone previsioni. Su un anno completo di dati meteo e di domanda, la politica appresa ha ridotto i costi operativi complessivi di circa il 12%, ha diminuito la perdita di capacità della batteria di poco più dell’8% e ha aumentato l’uso dell’energia solare locale di circa il 10%. Ha anche ridotto la potenza di picco prelevata dalla rete e le emissioni di carbonio associate di quasi il 14%. Forse più significativo, una volta addestrato, il controllore AI prendeva decisioni in pochi millisecondi—molto più veloce dei secondi necessari all’ottimizzazione del metodo convenzionale—rendendolo adatto a hardware economico in loco.

Rimanere robusti quando il meteo è sbagliato

Le microreti reali devono affrontare imprevisti nuvolosi e previsioni imperfette. I ricercatori hanno messo sotto stress entrambi i controllori con previsioni solari sempre più imprecise. All’aumentare degli errori di previsione fino a livelli severi, i costi del controllore tradizionale sono aumentati di oltre un quinto, mentre quelli del controllore basato sull’apprendimento sono aumentati di meno di un decimo. L’agente AI ha anche gestito più agevolmente rapide variazioni di irraggiamento, usando la batteria per livellare i flussi di potenza senza ricorrere a scariche profonde dannose. Ha programmato i carichi flessibili in coincidenza con la produzione solare e le ore a basso costo, contribuendo ulteriormente a ridurre la pressione sulla rete.

Cosa significa per i sistemi energetici futuri

In termini pratici, lo studio mostra che un’IA addestrata può gestire un sistema solare con batteria come un operatore esperto che tiene conto della bolletta di oggi, della salute della batteria di domani e dell’impatto climatico di ogni kilowattora. Imparando direttamente dai dati, anziché affidarsi a previsioni perfette e formule semplificate, il controllore offre energia più economica e più pulita prolungando la vita delle batterie costose. Sebbene il lavoro sia stato condotto in simulazione per una microrete di campus in Arabia Saudita, lo stesso approccio potrebbe essere adattato ad altri siti ed esteso a reti di microreti, offrendo una strada promettente verso sistemi energetici locali più resilienti, efficienti e sostenibili.

Citazione: Altimania, M.R.M., Basem, A., Saydullaev, B. et al. Adaptive multi-objective optimization of microgrid energy management using deep reinforcement learning considering battery degradation and renewable uncertainty. Sci Rep 16, 14296 (2026). https://doi.org/10.1038/s41598-026-44179-z

Parole chiave: microreti, deep reinforcement learning, salute della batteria, energia rinnovabile, gestione energetica