Clear Sky Science · es

Optimización adaptable multiobjetivo de la gestión energética de microrredes mediante aprendizaje profundo por refuerzo considerando la degradación de baterías e incertidumbre renovable

Energía local más inteligente para la vida cotidiana

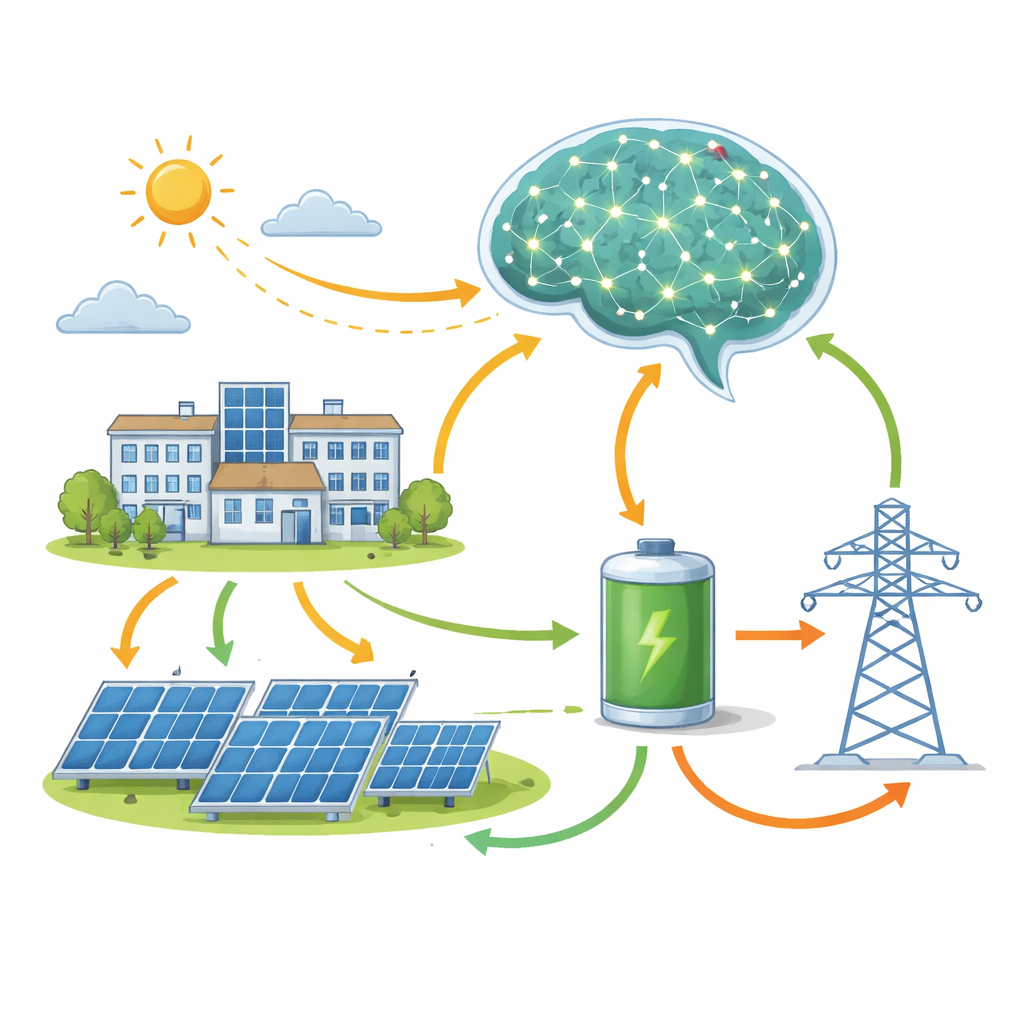

A medida que más viviendas, campus y empresas instalan paneles solares y baterías, gestionar cuándo comprar, almacenar o usar electricidad se convierte en un acto de equilibrio de alto riesgo. Si se hace bien, reduce facturas y contaminación; si se hace mal, desperdicia energía limpia y desgasta baterías costosas. Este estudio explora cómo una forma de inteligencia artificial llamada aprendizaje profundo por refuerzo puede actuar como un “operador digital” para una microrred solar con baterías, aprendiendo día a día a mantener bajos los costes, usar más energía renovable y proteger la batería del envejecimiento prematuro, incluso cuando la previsión meteorológica falla.

Por qué importan las pequeñas redes eléctricas

Las microrredes son sistemas eléctricos compactos que integran paneles solares, almacenamiento en baterías, cargas controlables y una conexión con la red mayor. Pueden alimentar un campus o un vecindario y mantener cargas críticas en funcionamiento cuando la red principal está bajo estrés. Pero son difíciles de operar: la radiación solar y la demanda cambian minuto a minuto, los precios de la electricidad varían a lo largo del día y cada ciclo de carga‑descarga degrada lentamente la batería. Los esquemas de control tradicionales dependen de optimizaciones matemáticas y previsiones precisas, que con frecuencia fallan cuando las condiciones se apartan de las expectativas o cuando el sistema se vuelve demasiado complejo.

Un controlador que aprende con la experiencia

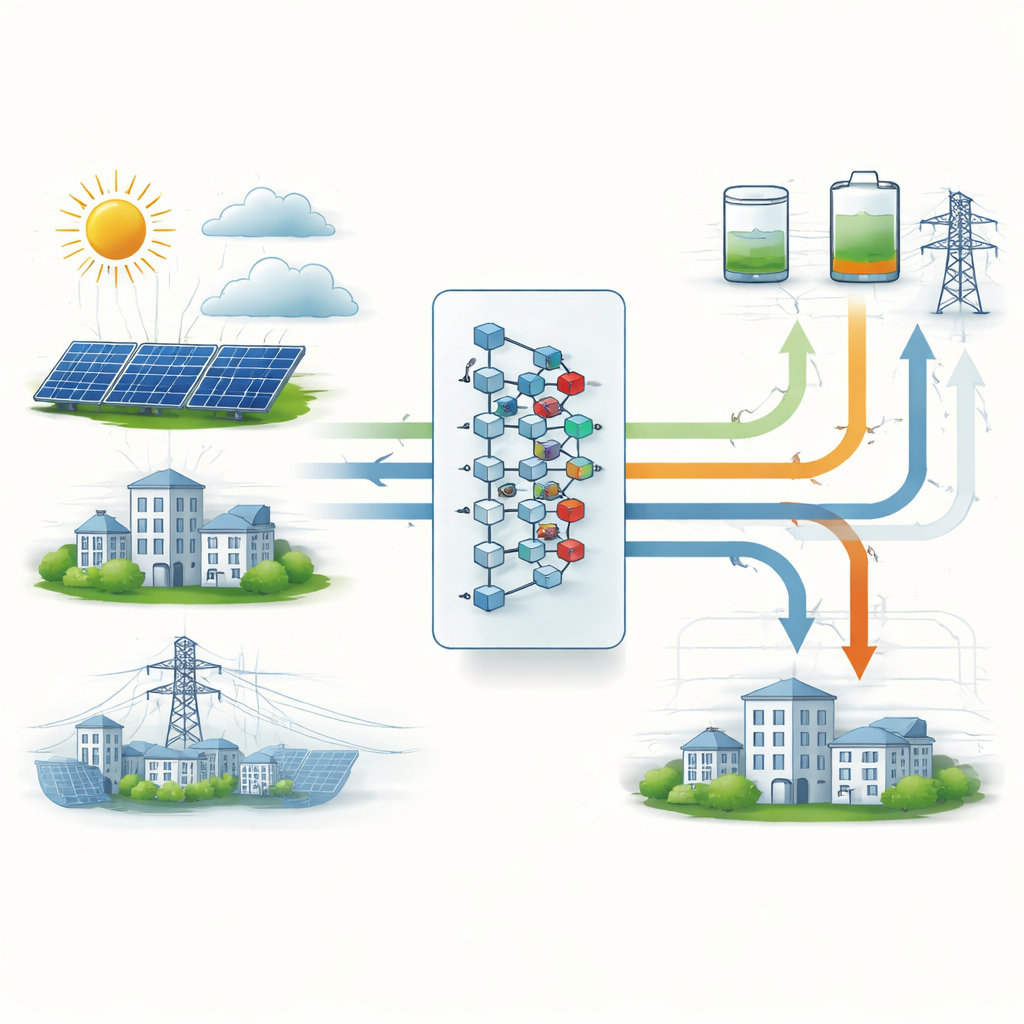

Los investigadores construyeron un gemelo digital detallado de una microrred a escala de campus en el oeste de Arabia Saudí, incluyendo 300 kW de paneles solares, una gran batería de ion‑litio, cargas flexibles e inflexibles y un enlace bidireccional con la red principal. A continuación, entrenaron a un agente de aprendizaje profundo por refuerzo—específicamente, una avanzada Deep Q‑Network—para operar este sistema virtual en pasos de 15 minutos a lo largo de muchos años simulados. El agente observaba el nivel de carga de la batería, previsiones a corto plazo de solar y demanda, precios de la electricidad y temperatura, y elegía acciones como la intensidad de carga o descarga de la batería y si ejecutar cargas desplazables. Tras cada paso recibía una recompensa que combinaba tres objetivos: pagar menos por la electricidad, ralentizar el desgaste de la batería y depender menos de la energía de la red fósil.

Equilibrando coste, salud de la batería y energía limpia

Para reflejar los compromisos del mundo real, el equipo incorporó un modelo físico de envejecimiento de la batería directamente en la señal de aprendizaje. La función de recompensa penalizaba tanto los costes a corto plazo como la pérdida de capacidad a largo plazo, y desalentaba severamente las violaciones de límites de seguridad como la sobrecarga o la sobredescarga de la batería. Tras unos 10 000 días simulados de práctica, el agente descubrió estrategias que la gente suele recomendar—pero que nunca se le enseñaron explícitamente. Aprendió a favorecer muchos ciclos de carga de profundidad moderada en lugar de pocos ciclos profundos, a mantener la batería en un estado de carga intermedio donde el envejecimiento es más lento y a reservar suficiente espacio en la batería antes de las horas soleadas para que la energía solar próxima pueda almacenarse en lugar de desperdiciarse.

Superando a un controlador inteligente convencional

El nuevo controlador basado en aprendizaje se enfrentó directamente a un fuerte referente conocido como control predictivo basado en modelos, ampliamente usado en la industria y que asume acceso a buenas previsiones. A lo largo de un año completo de datos de meteorología y demanda, la política aprendida redujo los costes operativos globales en aproximadamente un 12 por ciento, redujo la pérdida de capacidad de la batería en algo más del 8 por ciento e incrementó el uso de energía solar generada localmente en cerca de un 10 por ciento. También recortó la potencia máxima tomada de la red y redujo las emisiones de carbono asociadas en casi un 14 por ciento. Quizá lo más llamativo: una vez entrenado, el controlador IA tomaba decisiones en unas milésimas de segundo—muy por delante de la optimización de varios segundos requerida por el método convencional—lo que lo hace apto para hardware local económico.

Manteniendo la robustez cuando el tiempo falla

Las microrredes reales deben afrontar sorpresas nubosas y previsiones imperfectas. Los investigadores sometieron a ambos controladores a previsiones solares cada vez más inexactas. A medida que los errores de predicción crecieron hasta niveles severos, los costes del controlador tradicional aumentaron en más de una quinta parte, mientras que los costes del controlador basado en aprendizaje aumentaron en menos de una décima parte. El agente de IA también manejó oscilaciones rápidas de luz solar con mayor elegancia, usando la batería para suavizar los flujos de potencia sin recurrir a descargas profundas dañinas. Programó las cargas flexibles para coincidir con la producción solar y las horas de bajo precio, aliviando aún más la tensión en la red.

Qué significa esto para los sistemas eléctricos del futuro

En términos cotidianos, el estudio muestra que una IA entrenada puede operar un sistema solar con batería como un operador hábil que se preocupa por la factura de hoy, la salud futura de la batería y el impacto climático de cada kilovatio‑hora. Al aprender directamente de los datos, en lugar de fiarse de previsiones perfectas y fórmulas simplificadas, el controlador ofrece energía más barata y limpia a la vez que extiende la vida de baterías costosas. Aunque el trabajo se realizó en simulación para una microrred de campus en Arabia Saudí, el mismo enfoque podría adaptarse a otros emplazamientos y ampliarse a redes de microrredes, ofreciendo una vía prometedora hacia sistemas energéticos locales más resistentes, eficientes y sostenibles.

Cita: Altimania, M.R.M., Basem, A., Saydullaev, B. et al. Adaptive multi-objective optimization of microgrid energy management using deep reinforcement learning considering battery degradation and renewable uncertainty. Sci Rep 16, 14296 (2026). https://doi.org/10.1038/s41598-026-44179-z

Palabras clave: microrredes, aprendizaje profundo por refuerzo, salud de la batería, energía renovable, gestión energética